Wetenschap

Datafeminisme onderzoekt problemen van vooringenomenheid en macht die moderne informatie omringen

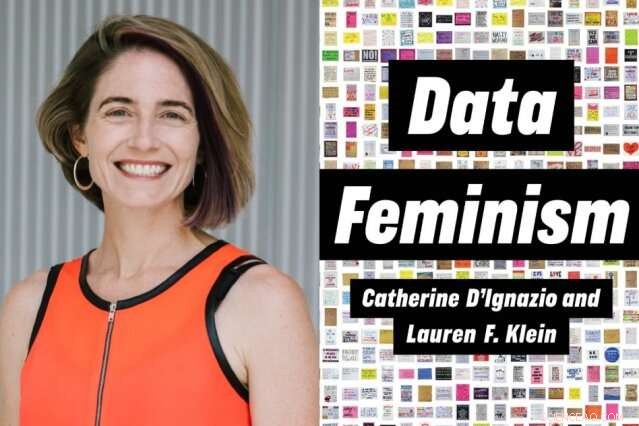

Krediet:Diana Levine en MIT Press

Stel dat u de sterftecijfers van vrouwen tijdens de bevalling wilt weten, op volgorde per land, rond de wereld. Waar zou je kijken? Een optie is het WomanStats Project, de website van een academische onderzoeksinspanning die de verbanden tussen de veiligheid en de activiteiten van natiestaten onderzoekt, en de veiligheid van de vrouwen die er wonen.

Het project, opgericht in 2001, voorziet in een behoefte door gegevens van over de hele wereld samen te voegen. Veel landen staan onverschillig tegenover het verzamelen van statistieken over het leven van vrouwen. Maar zelfs waar landen harder hun best doen om gegevens te verzamelen, er zijn duidelijke uitdagingen om tot bruikbare cijfers te komen - of het nu gaat om de fysieke veiligheid van vrouwen, eigendomsrechten, en overheidsparticipatie, onder vele andere kwesties.

Bijvoorbeeld:In sommige landen, schendingen van vrouwenrechten kunnen vaker worden gemeld dan op andere plaatsen. Dat betekent dat een sneller reagerend rechtssysteem de schijn van grotere problemen kan wekken, wanneer het vrouwen relatief meer steun biedt. Het WomanStats Project merkt veel van dergelijke complicaties op.

Zo biedt het WomanStats Project enkele antwoorden, bijvoorbeeld:Australië, Canada, en een groot deel van West-Europa heeft lage geboortesterftecijfers, terwijl het ook laat zien wat de uitdagingen zijn om cijfers op het eerste gezicht te nemen. Dit, volgens MIT-professor Catherine D'Ignazio, maakt de site ongebruikelijk, en waardevol.

"De gegevens spreken nooit voor zich, " zegt D'Ignazio, verwijzend naar het algemene probleem van het vinden van betrouwbare cijfers over het leven van vrouwen. "Er zijn altijd mensen en instellingen die spreken voor de gegevens, en verschillende mensen hebben hun eigen agenda's. De gegevens zijn nooit onschuldig."

Nu D'Ignazio, een assistent-professor bij de afdeling Stedelijke Studies en Planning van het MIT, heeft in een nieuw boek dieper ingegaan op deze kwestie, co-auteur met Lauren Klein, een universitair hoofddocent Engelse en kwantitatieve theorie en methoden aan de Emory University. In het boek, "Datafeminisme, " deze maand gepubliceerd door de MIT Press, de auteurs gebruiken de lens van intersectioneel feminisme om te onderzoeken hoe datawetenschap de sociale structuren weerspiegelt waaruit het voortkomt.

"Intersectioneel feminisme onderzoekt ongelijke macht, " schrijven D'Ignazio en Klein, in de inleiding van het boek. "En in onze hedendaagse wereld, data is ook macht. Omdat de kracht van data onterecht wordt gebruikt, het moet worden uitgedaagd en veranderd."

Het 4 procent probleem

Om een duidelijk geval te zien van machtsverhoudingen die vooringenomen gegevens genereren, D'Ignazio en Klein nota, overweeg onderzoek onder leiding van MIT's eigen Joy Buolamwini, die als afgestudeerde student in een klas gezichtsherkenningsprogramma's bestudeert, merkte op dat de software in kwestie haar gezicht niet kon "zien". Buolamwini ontdekte dat voor het gezichtsherkenningssysteem in kwestie, de software was gebaseerd op een reeks gezichten die voor 78 procent mannelijk en voor 84 procent wit waren; slechts 4 procent was vrouw en had een donkere huidskleur, zoals zijzelf.

Latere media-aandacht voor het werk van Buolamwini, D'Ignazio en Klein schrijven, bevatte "een vleugje shock." Maar de resultaten waren waarschijnlijk minder verrassend voor degenen die geen blanke mannen zijn, ze denken.

"Als het verleden racistisch is, benauwend, seksistisch, en bevooroordeeld, en dat zijn je trainingsgegevens, dat is waar je op afstemt, ' zegt D'Ignazio.

Of denk aan een ander voorbeeld, van techgigant Amazon, die een geautomatiseerd systeem testte dat AI gebruikte om veelbelovende cv's te sorteren die door sollicitanten waren ingestuurd. Eén probleem:omdat een hoog percentage van de werknemers van het bedrijf mannen waren, het algoritme gaf de voorkeur aan mannennamen, andere dingen die gelijk zijn.

"Ze dachten dat dit [het] proces zou helpen, maar wat het natuurlijk doet, is het AI [systeem] trainen om bevooroordeeld te zijn ten opzichte van vrouwen, omdat ze zelf niet zoveel vrouwen hebben aangenomen, ' merkt D'Ignazio op.

Tot eer van Amazon, hij herkende het probleem. Bovendien, D'Ignazio merkt op, dit soort problemen is een probleem dat kan worden aangepakt. "Sommige technologieën kunnen worden hervormd met een meer participatief proces, of betere trainingsgegevens. … Als we het erover eens zijn dat dat een goed doel is, een weg vooruit is om je trainingsset aan te passen en meer gekleurde mensen op te nemen, meer vrouwen."

"Wie zit er in het team? Wie had het idee? Wie heeft er baat bij?"

Nog altijd, de vraag wie participeert in data science is, zoals de auteurs schrijven, "de olifant in de serverruimte." vanaf 2011, slechts 26 procent van alle studenten die in de VS een diploma informatica ontvingen, was vrouw. Dat is niet alleen een laag cijfer, maar eigenlijk een daling ten opzichte van eerdere niveaus:in 1985, 37 procent van de afgestudeerden in de informatica was vrouw, het hoogste cijfer ooit.

Als gevolg van het gebrek aan diversiteit in het veld, D'Ignazio en Klein geloven, veel dataprojecten zijn radicaal beperkt in hun vermogen om alle facetten te zien van de complexe sociale situaties die ze beweren te meten.

"We willen proberen mensen af te stemmen op dit soort machtsverhoudingen en waarom ze er zo toe doen, " Zegt D'Ignazio. "Wie zit er in het team? Wie had het idee? Wie profiteert van het project? Wie wordt mogelijk geschaad door het project?"

In alles, D'Ignazio en Klein schetsen zeven principes van datafeminisme, van het onderzoeken en uitdagen van macht, om binaire systemen en hiërarchieën te heroverwegen, en het omarmen van pluralisme. (Die statistieken over geslacht en afgestudeerden in de informatica zijn beperkt, zij merken op, door alleen de categorieën "mannelijk" en "vrouwelijk" te gebruiken, dus het uitsluiten van mensen die zich in verschillende termen identificeren.)

Mensen die geïnteresseerd zijn in datafeminisme, de auteurs stellen, moet ook "meerdere vormen van kennis waarderen, " inclusief kennis uit de eerste hand die ertoe kan leiden dat we schijnbaar officiële gegevens in twijfel trekken. ze moeten altijd rekening houden met de context waarin gegevens worden gegenereerd, en "arbeid zichtbaar maken" als het gaat om data science. Dit laatste principe, de onderzoekers merken op, spreekt het probleem aan dat zelfs wanneer vrouwen en andere uitgesloten mensen bijdragen aan dataprojecten, ze krijgen vaak minder waardering voor hun werk.

Voor alle kritiek van het boek op bestaande systemen, programma's, en praktijken, D'Ignazio en Klein zijn ook voorzichtig met het opnemen van voorbeelden van positieve, succesvolle pogingen, zoals het WomanStats-project, die gedurende twee decennia is gegroeid en bloeide.

"Voor mensen die datamensen zijn maar nieuw zijn in het feminisme, we willen ze een heel toegankelijke introductie geven, en geef ze concepten en tools die ze in hun praktijk kunnen gebruiken, "zegt D'Ignazio. "We kunnen ons niet voorstellen dat mensen al feminisme in hun gereedschapskist hebben. Anderzijds, we proberen te praten met mensen die erg afgestemd zijn op feminisme of sociale rechtvaardigheidsprincipes, en benadruk voor hen de manieren waarop datawetenschap zowel problematisch is als maar kan worden opgesteld in dienst van de gerechtigheid."

Dit verhaal is opnieuw gepubliceerd met dank aan MIT News (web.mit.edu/newsoffice/), een populaire site met nieuws over MIT-onderzoek, innovatie en onderwijs.

Hoe een mengsel van suiker en water te scheiden

Hoe een mengsel van suiker en water te scheiden Chemicaliën die malaria genezen, kunnen ook onkruid doden

Chemicaliën die malaria genezen, kunnen ook onkruid doden Zijde kan de gevoeligheid verbeteren, flexibiliteit van draagbare lichaamssensoren

Zijde kan de gevoeligheid verbeteren, flexibiliteit van draagbare lichaamssensoren Wetenschappers ontwikkelen betere manier om virussen te blokkeren die luchtweginfecties bij kinderen veroorzaken

Wetenschappers ontwikkelen betere manier om virussen te blokkeren die luchtweginfecties bij kinderen veroorzaken Wat gebeurt er als de druk en temperatuur van een vast monster van gas daalt?

Wat gebeurt er als de druk en temperatuur van een vast monster van gas daalt?

Hoofdlijnen

- EU-handelsverbod verlaagt wereldhandel in wilde vogels met 90 procent

- Hoe de droogrot Serpula lacrymans zich aanpasten aan een nieuwe ecologische habitat

- Soorten berekenen Evenness

- Zit moraliteit in de hersenen?

- Wat zijn de belangrijkste functies van Cilia & Flagella?

- Research Paper Topics in Biochemistry

- Wat kunnen zebravissen ons leren over hoe we overleven als we worden geconfronteerd met mutaties?

- Wereldprimeur gebruikt satellieten en oceaanmodellen om de biodiversiteit op de Antarctische zeebodem te verklaren

- Live hersenactiviteit volgen met de nieuwe NeuBtracker open-source microscoop

- Onderzoek:Informatievaardigheden kunnen nepnieuws bestrijden

- Studenten vervoeren naar waar beslissingen worden genomen

- Nieuwe technologie vertelt ons welke botten van dieren werden gebruikt om oude gereedschappen te maken

- Hoogleraar economie ontdekt over effecten voor olie- en gasboomtowns

- Inzichten uit complexiteitswetenschap:meer vertrouwen in zelforganisatie nodig

EU geeft Google een nieuwe boete:bronnen

EU geeft Google een nieuwe boete:bronnen Cool touch-shirts kunnen ervoor zorgen dat je je koel voelt op warme dagen, maar welke materialen werken het beste?

Cool touch-shirts kunnen ervoor zorgen dat je je koel voelt op warme dagen, maar welke materialen werken het beste? Nieuwe methode voor nanomaterialen geeft antwoord op lastige uitdagingen

Nieuwe methode voor nanomaterialen geeft antwoord op lastige uitdagingen Fukushima-ramp:belangrijke tips 8 jaar later

Fukushima-ramp:belangrijke tips 8 jaar later Gammastraling-telescopen onthullen een hoogenergetische val in het centrum van ons melkwegstelsel

Gammastraling-telescopen onthullen een hoogenergetische val in het centrum van ons melkwegstelsel Een voorbeeld van plasmonen die rechtstreeks invloed hebben op moleculen

Een voorbeeld van plasmonen die rechtstreeks invloed hebben op moleculen We hebben eindelijk het gezoem op de bodem van de zee opgenomen

We hebben eindelijk het gezoem op de bodem van de zee opgenomen  Gesimuleerde berekeningen bevestigen met experimentresultaten

Gesimuleerde berekeningen bevestigen met experimentresultaten

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway | Italian |

-

Wetenschap © https://nl.scienceaq.com