Wetenschap

Experts pleiten voor verantwoord en transparant gebruik van algoritmen bij overheid

Algoritmen en algoritmische transparantie bestuderen vanuit meerdere analyseniveaus. Krediet:informatiepolitie.

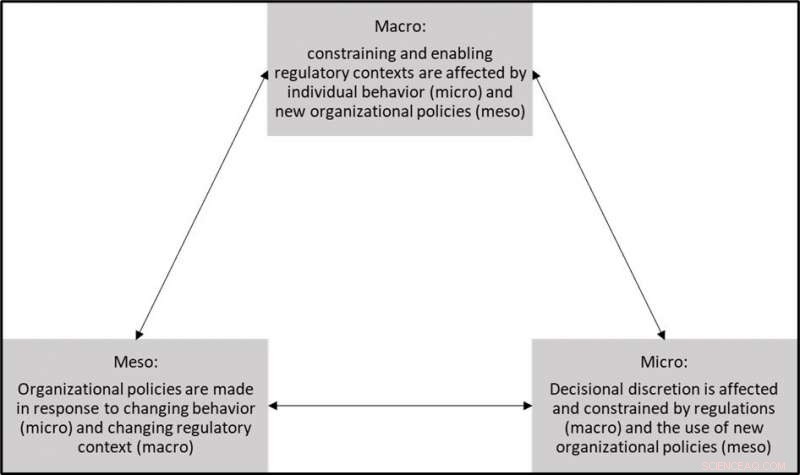

Het gebruik van algoritmen in de overheid verandert de manier waarop bureaucraten werken en beslissingen nemen op verschillende gebieden, zoals gezondheidszorg of strafrecht. Experts pakken de transparantie-uitdagingen aan van het gebruik van algoritmen in besluitvormingsprocedures op macro-, meso-, en microniveaus in deze speciale uitgave van Informatiebeleid .

Algoritmen voor machinaal leren hebben een enorm potentieel om overheidsdiensten eerlijker en effectiever te maken en hebben het potentieel om de besluitvorming te "bevrijden" van menselijke subjectiviteit, volgens recent onderzoek. Algoritmen worden in veel openbare-dienstcontexten gebruikt. Bijvoorbeeld, binnen de rechtsorde is aangetoond dat algoritmen recidive beter kunnen voorspellen dan strafrechter. Tegelijkertijd, critici wijzen op verschillende gevaren van algoritmische besluitvorming, zoals raciale vooroordelen en gebrek aan transparantie.

Sommige wetenschappers hebben betoogd dat de introductie van algoritmen in besluitvormingsprocedures diepgaande verschuivingen kan veroorzaken in de manier waarop bureaucraten beslissingen nemen en dat algoritmen bredere organisatorische routines en structuren kunnen beïnvloeden. Dit speciale nummer over transparantie van algoritmen presenteert zes bijdragen om ons conceptuele en empirische begrip van het gebruik van algoritmen in de overheid aan te scherpen.

"Er is een golf van kritiek geweest op de 'zwarte doos' van algoritmische besluitvorming in de overheid, " leggen gastredacteuren Sarah Giest (Universiteit Leiden) en Stephan Grimmelikhuijsen (Universiteit Utrecht) uit. "In deze special issue collection, laten we zien dat het niet voldoende is om de technische details van algoritmen uit te pakken, maar kijk ook naar institutionele, organisatorisch, en individuele context waarbinnen deze algoritmen werken om echt te begrijpen hoe we transparante en verantwoorde algoritmen bij de overheid kunnen bereiken. Bijvoorbeeld, regelgeving kan transparantiemechanismen mogelijk maken, toch creëren organisaties nieuw beleid over hoe algoritmen moeten worden gebruikt, en individuele ambtenaren creëren nieuw professioneel repertoire. Al deze niveaus werken op elkaar in en beïnvloeden de algoritmische transparantie in publieke organisaties."

De transparantie-uitdagingen voor het gebruik van algoritmen overstijgen verschillende overheidsniveaus - van Europees niveau tot individuele overheidsbureaucraten. Deze uitdagingen kunnen ook verschillende vormen aannemen; transparantie kan worden ingeschakeld of beperkt door technische hulpmiddelen, maar ook door regelgevende richtlijnen of organisatiebeleid. Artikelen in dit nummer gaan in op transparantie-uitdagingen van het gebruik van algoritmen op macro-, meso-, en microniveau. Het macroniveau beschrijft fenomenen vanuit institutioneel perspectief – welke nationale systemen, regelgeving en culturen spelen een rol bij algoritmische besluitvorming. Het mesoniveau besteedt vooral aandacht aan het organisatie- en teamniveau, terwijl het microniveau zich richt op individuele attributen, zoals overtuigingen, motivatie, interacties, en gedragingen.

"Oproepen om 'mensen op de hoogte te houden' kunnen betwistbare punten zijn als we niet begrijpen hoe algoritmen de menselijke besluitvorming beïnvloeden en hoe algoritmisch ontwerp de praktische mogelijkheden voor transparantie en menselijke discretie beïnvloedt, " merkt Rik Peeters op, onderzoekshoogleraar Bestuurskunde aan het Centrum voor Onderzoek en Onderwijs in Economie (CIDE) in Mexico-Stad. In een overzicht van recente academische literatuur over de dynamiek op microniveau van algoritmische systemen, hij bespreekt drie ontwerpvariabelen die de voorwaarden voor menselijke transparantie en discretie bepalen en identificeert vier belangrijke bronnen van variatie in 'mens-algoritme-interactie'.

Het artikel trekt twee belangrijke conclusies:ten eerste, menselijke agenten zijn zelden volledig "uit de lus, " en niveaus van toezicht en override ontworpen in algoritmen moeten worden begrepen als een continuüm. De tweede heeft betrekking op begrensde rationaliteit, bevredigend gedrag, automatisering vooringenomenheid, en frontline coping-mechanismen die een cruciale rol spelen in de manier waarop mensen algoritmen gebruiken in besluitvormingsprocessen.

Voor toekomstig onderzoek stelt Dr. Peeters voor om de gedragsmechanismen nader te bekijken in combinatie met het identificeren van relevante vaardigheden van bureaucraten in het omgaan met algoritmen. "Zonder een basiskennis van de algoritmen waarmee scherm- en straatbureaucraten moeten werken, het is moeilijk voor te stellen hoe ze hun discretie goed kunnen gebruiken en algoritmische procedures en resultaten kritisch kunnen beoordelen. Professionals moeten voldoende geschoold zijn om toezicht te houden op de algoritmen waarmee ze werken."

Op macroniveau is algoritmen kunnen een belangrijk instrument zijn om institutionele transparantie mogelijk te maken, schrijft Alex Ingrams, doctoraat, Bestuur en mondiale zaken, Instituut voor Openbaar Bestuur, Universiteit Leiden, Leiden, Nederland. Deze studie evalueert een machinale leerbenadering om openbare opmerkingen te openen voor beleidsvorming om de institutionele transparantie van openbare opmerkingen in een wetgevingsproces in de Verenigde Staten te vergroten. Het artikel past een onbewaakte machine learning-analyse toe van duizenden openbare opmerkingen die zijn ingediend bij de Transport Security Administration van de Verenigde Staten over een voorgestelde verordening uit 2013 voor het gebruik van nieuwe full body imaging-scanners op luchthavens. Het algoritme markeert opvallende onderwerpclusters in de openbare commentaren die beleidsmakers zouden kunnen helpen om open openbare commentarenprocessen te begrijpen. "Algoritmen moeten niet alleen onderhevig zijn aan transparantie, maar kunnen ook worden gebruikt als hulpmiddel voor transparantie in de besluitvorming van de overheid, " zegt Dr. Ingrams.

"Regelzekerheid in combinatie met organisatorische en managementcapaciteit zal de manier bepalen waarop de technologie wordt ontwikkeld en gebruikt en welke transparantiemechanismen er zijn voor elke stap, " merkt de gastredacteuren op. "Op zichzelf zijn dit grotere problemen om aan te pakken in termen van het ontwikkelen en aannemen van wetten of het geven van training en begeleiding aan openbare managers en bureaucraten. Het feit dat ze gekoppeld zijn, maakt dit proces nog ingewikkelder. Het benadrukken van deze verbanden is een eerste stap om een beter beeld te krijgen van waarom transparantiemechanismen in sommige scenario's wel en niet in andere worden ingevoerd, en opent de deur naar vergelijkende analyses voor toekomstig onderzoek en nieuwe inzichten voor beleidsmakers. Om een verantwoord en transparant gebruik van algoritmen te bepleiten, toekomstig onderzoek moet kijken naar de wisselwerking tussen micro-, meso-, en dynamiek op macroniveau."

"Met trots presenteren wij dit speciale nummer, het 100e nummer van Informatiebeleid . De focus op de governance van AI toont onze voortdurende wens om hedendaagse problemen op het gebied van e-overheid aan te pakken en het belang van de presentatie van uitstekend onderzoek en de inzichten die worden geboden door perspectieven op het gebied van informatiebeleid, " voegen professor Albert Meijer (Universiteit Utrecht) en professor William Webster (Universiteit van Stirling) toe, Hoofdredacteuren.

Huid reconstrueren op een chip

Huid reconstrueren op een chip Risicovrije gen-reactivering

Risicovrije gen-reactivering Onderzoekers ontwerpen zeldzame-aarde-extractiemiddelen met behulp van nieuwe software

Onderzoekers ontwerpen zeldzame-aarde-extractiemiddelen met behulp van nieuwe software Hoe de temperatuurdaling te berekenen als gevolg van een drukdaling

Hoe de temperatuurdaling te berekenen als gevolg van een drukdaling  Nieuw onderzoek naar nucleaire magnetische resonantiespectroscopie onthult de dynamiek van katalysatoren in de 3D-ruimte

Nieuw onderzoek naar nucleaire magnetische resonantiespectroscopie onthult de dynamiek van katalysatoren in de 3D-ruimte

Hoofdlijnen

- Wat is Feedback-inhibitie en waarom is het belangrijk bij het reguleren van de enzymactiviteit?

- Hoe een PCR-primer te ontwerpen

- Hoe zijn fotosynthese en cellulaire ademhaling gerelateerd?

- Hoe zuurstofgas wordt geproduceerd tijdens fotosynthese?

- Tropische kevers worden met uitsterven bedreigd

- Genetische veranderingen helpen muggen om aanvallen van pesticiden te overleven

- Cryo-EM-beeldvorming suggereert hoe de dubbele helix scheidt tijdens replicatie

- 5 waargebeurde verhalen over een bij de geboorte gescheiden tweeling

- Intra-rij onkruid wieden mogelijk met vision-systemen

- Onderzoekers vinden opmerkelijke hoefijzers

- Journalistiek is een aanvalsoppervlak voor degenen die verkeerde informatie verspreiden

- Een Neanderthaler-tand ontdekt in Servië onthult menselijke migratiegeschiedenis

- Niet drinken! Niet vechten! De wetten van het vroege Edo Japan om de vrede te bewaren

- Verleidelijke details belemmeren het leren

Hebben de TRAPPIST-1-planeten een atmosfeer?

Hebben de TRAPPIST-1-planeten een atmosfeer? Voordelen en nadelen van Convex Mirrors

Voordelen en nadelen van Convex Mirrors  NASA vindt dat Mekkhala uit elkaar valt na aanlanding in Zuidoost-China

NASA vindt dat Mekkhala uit elkaar valt na aanlanding in Zuidoost-China Meer dan 90% van de schorsingen van het rijbewijs heeft niets te maken met verkeersveiligheid

Meer dan 90% van de schorsingen van het rijbewijs heeft niets te maken met verkeersveiligheid Onderzoekers ontwikkelen techniek voor bewerking van oppervlakken op atomaire schaal

Onderzoekers ontwikkelen techniek voor bewerking van oppervlakken op atomaire schaal Welke olie laat er elke dag in de VS 2,5 miljard gallons water achter?

Welke olie laat er elke dag in de VS 2,5 miljard gallons water achter? Onderzoek is gericht op het voorkomen van sterfgevallen als gevolg van emissies van gipsgebonden mest

Onderzoek is gericht op het voorkomen van sterfgevallen als gevolg van emissies van gipsgebonden mest Snelle ontwerpmethode voor mini-eiwitten opent de weg om een nieuwe klasse geneesmiddelen te creëren

Snelle ontwerpmethode voor mini-eiwitten opent de weg om een nieuwe klasse geneesmiddelen te creëren

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com