Wetenschap

EduSense:onderzoekers ontwikkelen uitgebreid detectiesysteem in de klas

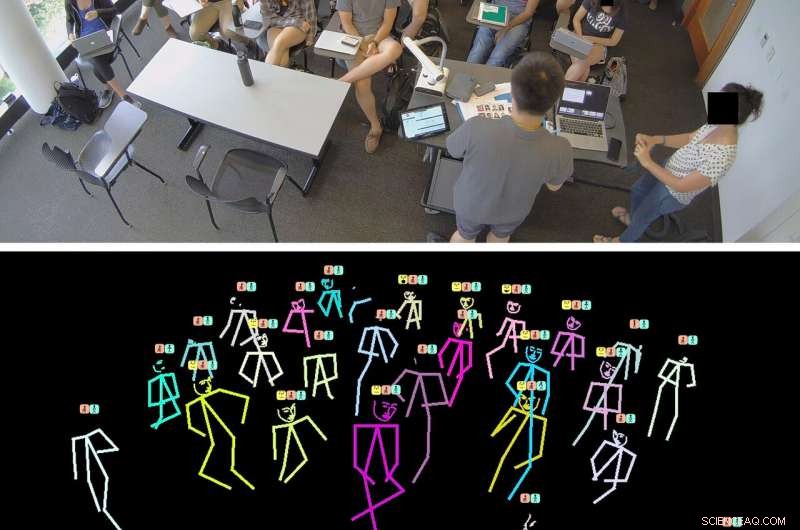

EduSense is een uitgebreid detectiesysteem in de klas dat instructeurs gedetailleerde gegevens biedt over hun eigen lesgeven en studentenbetrokkenheid. Krediet:Carnegie Mellon University

Hoewel er volop mogelijkheden zijn voor training en feedback voor K-12 docenten, hetzelfde kan niet gezegd worden van docenten in het hoger onderwijs. Momenteel, het meest effectieve mechanisme voor professionele ontwikkeling is dat een expert een lezing observeert en persoonlijke feedback geeft. Maar een nieuw systeem, ontwikkeld door onderzoekers van Carnegie Mellon University, biedt een uitgebreid realtime detectiesysteem dat goedkoop en schaalbaar is om een continue feedbacklus voor de instructeur te creëren.

Het systeem, genaamd EduSense, analyseert een verscheidenheid aan visuele en audiofuncties die verband houden met effectieve instructie. "Vandaag, de leraar fungeert als de sensor in de klas, maar dat is niet schaalbaar, " zei Chris Harrison, assistent-professor in het Human-Computer Interaction Institute (HCII) van CMU. Harrison zei dat de klasgrootte de afgelopen decennia enorm is toegenomen, en het is moeilijk om les te geven en effectief te zijn in grote klassen of klaslokalen.

EduSense is minimaal opdringerig. Het maakt gebruik van twee aan de muur gemonteerde camera's:één tegenover de studenten en één tegenover de instructeur. Het detecteert dingen zoals de houding van studenten om hun betrokkenheid te bepalen, en hoeveel tijd instructeurs pauzeren voordat ze een leerling oproepen. "Dit zijn gecodificeerde dingen die onderwijsbeoefenaars al tientallen jaren als best practices kennen, ' zei Harrison.

Een enkele kant-en-klare camera kan iedereen in de klas bekijken en automatisch informatie identificeren, zoals waar leerlingen naar kijken, hoe vaak ze hun hand opsteken en of de instructeur door de ruimte beweegt in plaats van achter een podium te blijven. Het systeem maakt gebruik van OpenPose, een ander CMU-project, lichaamshouding te extraheren. "Met de vooruitgang in computervisie en machine learning, we kunnen nu inzichten verschaffen die met handmatige observatie dagen, zo niet maanden zouden kosten, " zei Karan Ahuja, een lid van het onderzoeksteam dat zijn Ph.D. in de HCII.

Harrison zei dat lerende wetenschappers geïnteresseerd zijn in de instructiegegevens. "Omdat we het lichaam kunnen volgen, het is alsof je een pak versnellingsmeters draagt. We weten hoeveel u uw hoofd draait en uw handen beweegt. Het is alsof je een virtueel bewegingsregistratiesysteem draagt terwijl je lesgeeft."

Het gebruik van camera's met een hoge resolutie die 4K-video voor veel klassen tegelijk stomen, is een "computationele nachtmerrie, " zei Harrison. Om bij te blijven, bronnen worden elastisch toegewezen om de best mogelijke framesnelheid voor realtime gegevens te bieden.

Het project heeft ook een sterke focus op privacybescherming, geleid door Yuvraj Agarwal, een universitair hoofddocent bij het Institute for Software Research van de universiteit. Het team wilde geen individuele studenten identificeren, en EduSense niet. Er worden geen namen of identificerende informatie gebruikt, en aangezien cameragegevens in realtime worden verwerkt, het wordt snel weggegooid.

Nu het team heeft aangetoond dat ze de gegevens kunnen vastleggen, HCII-faculteitslid Amy Ogan zei dat hun huidige uitdaging het inpakken en presenteren is op een manier die educatief effectief is. Het team zal blijven werken aan op docenten gerichte apps om te zien of docenten de feedback in de praktijk kunnen integreren. "We hebben ons gefocust op het begrijpen hoe, wanneer en waar feedback op basis van deze gegevens het beste kan worden gegeven, zodat het zinvol en nuttig is voor instructeurs om hen te helpen hun praktijk te verbeteren, " ze zei.

Dit onderzoek is gepresenteerd op Ubicomp, de internationale conferentie van de leerwetenschappen, en zal in april worden gepresenteerd op de jaarlijkse bijeenkomst van de American Educational Research Association.

Nieuwe fotokatalytische methode zet biopolyolen en suikers om in methanol en syngas

Nieuwe fotokatalytische methode zet biopolyolen en suikers om in methanol en syngas AFRL bereikt schokkende doorbraak in materiaaltechnologie

AFRL bereikt schokkende doorbraak in materiaaltechnologie Elektrochemie opent nieuwe toegang tot belangrijke klassen van stoffen

Elektrochemie opent nieuwe toegang tot belangrijke klassen van stoffen Spinzijde inspireert een nieuw materiaal met buitengewone mechanische eigenschappen

Spinzijde inspireert een nieuw materiaal met buitengewone mechanische eigenschappen Chemici vinden nieuwe manier om de bouwstenen van veel medicijnen te maken

Chemici vinden nieuwe manier om de bouwstenen van veel medicijnen te maken

NASA-NOAA-satelliet vindt Lorenas sterke stormen die Mexico teisteren

NASA-NOAA-satelliet vindt Lorenas sterke stormen die Mexico teisteren Frankrijk gaat nieuwe belasting op vluchten in Europa voorstellen

Frankrijk gaat nieuwe belasting op vluchten in Europa voorstellen Wanneer groene oplossingen de ecologische voetafdruk daadwerkelijk vergroten

Wanneer groene oplossingen de ecologische voetafdruk daadwerkelijk vergroten Koolstofneutrale oplossing voor ontzilting:geothermische bronnen aanboren

Koolstofneutrale oplossing voor ontzilting:geothermische bronnen aanboren Meelwormen bieden plastic oplossing

Meelwormen bieden plastic oplossing

Hoofdlijnen

- Een door kracht aangedreven mechanisme voor het vaststellen van celpolariteit

- Plant- en diercelactiviteiten voor vierde graad

- Studie:Grote witte haaien zwemmen steeds dieper

- Lokale elektrische reacties in bladeren maken fotosynthese hittetolerant

- Wat zijn twee kenmerken van mRNA in eukaryoten?

- Vetzuur: definitie, metabolisme en functie

- 'Welke dag is het ook alweer?' De psychologie van dinsdag

- Een grotere rijkdom aan plantensoorten is misschien niet voldoende om ecosystemen te beschermen tegen de ergste gevolgen van klimaatextremen

- Wat is het voordeel van het feit dat het DNA goed is ingepakt in de chromosomen?

- Vox Media en eigenaar van New York magazine gaan fuseren

- Ontwerpen van lichtgewicht glas voor efficiënte auto's en windturbines

- Bug heeft mogelijk foto's van 7 miljoen Facebook-gebruikers blootgelegd

- Techbedrijven haasten zich om desinformatie te bestrijden voorafgaand aan de Britse stemming

- High-tech tekorten doemt op naarmate de sluitingen van het coronavirus fabrikanten raken

NTSB geeft details vrij over 2 crashes met Tesla Autopilot

NTSB geeft details vrij over 2 crashes met Tesla Autopilot Helling vinden op de TI Nspire

Helling vinden op de TI Nspire Hoe racisme bijdraagt aan een zeer ivoren toren

Hoe racisme bijdraagt aan een zeer ivoren toren Het diepe verleden van de Noordelijke IJszee biedt aanwijzingen voor de nabije toekomst

Het diepe verleden van de Noordelijke IJszee biedt aanwijzingen voor de nabije toekomst Mensen dringen de laatste wilde plekken van Antarctica binnen, bedreigt de kwetsbare biodiversiteit

Mensen dringen de laatste wilde plekken van Antarctica binnen, bedreigt de kwetsbare biodiversiteit Hersenengeïnspireerd computergebruik kan grote problemen op een kleine manier aanpakken

Hersenengeïnspireerd computergebruik kan grote problemen op een kleine manier aanpakken Nieuwe online tool helpt milieurechtvaardigheid beter te dienen

Nieuwe online tool helpt milieurechtvaardigheid beter te dienen Hoe Leverde Beta berekenen

Hoe Leverde Beta berekenen

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Spanish | Swedish | German | Dutch | Danish | Norway | Italian | Portuguese |

-

Wetenschap © https://nl.scienceaq.com