Wetenschap

Een nieuwe benadering voor steganografie onder machine learning agents

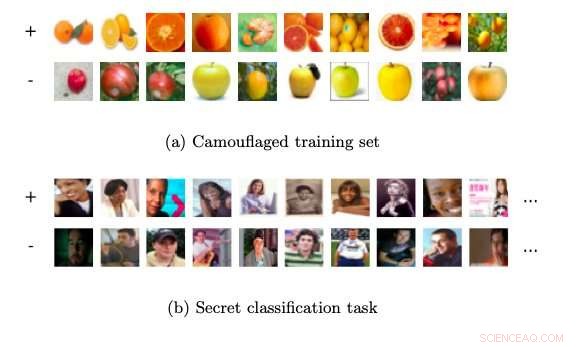

Voorbeeld trainingsset camouflage. Krediet:Sen et al.

Onderzoekers van de University of Wisconsin-Madison en Amherst College hebben onlangs een nieuwe vorm van steganografie geïntroduceerd op het gebied van machine learning, genaamd 'training set camouflage'. Hun kader, geschetst in een paper dat vooraf is gepubliceerd op arXiv, stelt een machine learning-agent in staat om de bedoeling en het doel van een taak te verbergen voor een externe waarnemer.

Steganografie is een coderingstechniek die gegevens beschermt of verbergt door berichten in andere berichten in te sluiten. In hun recente studie, de onderzoekers van UW-Madison overwogen specifiek een scenario waarin een machine learning-agent (Alice), probeert een tweede agent (Bob) te trainen in een geheime classificatietaak, zonder dat een derde agent (Eve) er iets over te weten komt.

"Stel je voor dat Alice een training heeft over een illegale classificatietaak voor machinaal leren, ', schrijven de onderzoekers in hun paper. 'Alice wil dat Bob (een machine learning-systeem) de taak leert. Echter, het verzenden van de trainingsset of het getrainde model naar Bob kan argwaan wekken als de communicatie wordt gecontroleerd."

In het scenario dat de onderzoekers voor ogen hadden, een derde agent genaamd Eve neemt de rol op zich van een gegevensverificateur die de communicatie tussen Alice en Bob controleert. Als Eve achterdochtig wordt over wat Alice Bob stuurt, ze kan de communicatie tussen hen beëindigen, weigeren de gegevens die ze uitwisselen te leveren. Eve treedt op als een auditor die probeert te achterhalen of een trainingsdataset legitiem is, alvorens het door te geven aan de leerling.

"Het verzenden van de privé-trainingsset zou de bedoeling van Alice onthullen; het sturen van de modelparameters zal ook argwaan wekken, ', leggen de onderzoekers uit in hun paper. 'Alice moet de communicatie camoufleren om het er alledaags uit te laten zien voor Eva, terwijl het vermijden van buitensporige codeertrucs met Bob vooraf."

De steganografie-benadering die door de onderzoekers is bedacht, stelt Alice in staat een tweede trainingsset te berekenen voor een geheel andere en schijnbaar goedaardige classificatietaak, zonder Eva's argwaan te wekken. Het doet dit door een dataset te vinden die lijkt te kunnen worden toegepast op een bepaalde taak, terwijl het in feite een agent kan leren om goed te presteren in een andere taak. Door zijn standaard leeralgoritme toe te passen op deze tweede trainingsset, Bob kan de classifier op de oorspronkelijke taak ongeveer herstellen.

De door de onderzoekers bedachte stenografische benadering was een beetje een toevalstreffer, zoals het voortkwam uit een niet-gerelateerd project op het gebied van machine learning. Een systeem dat ze hadden ontwikkeld, had een reeks lespakketten gecreëerd, waarvan er één een verkeerd gelabeld punt bevatte. Dit moedigde hen aan om te onderzoeken of een agent een andere agent kan leren hoe hij een taak moet voltooien, terwijl je het camoufleert met een andere taak.

De onderzoekers voerden een reeks experimenten uit met behulp van echte classificatietaken en toonden de haalbaarheid van hun aanpak aan. Hun onderzoek suggereert dat veel informatie kan worden verborgen door simpelweg gebruik te maken van het feit dat voor een bepaalde taak, er zijn verschillende modellen die er goed op kunnen presteren.

Een deel van de bij het onderzoek betrokken onderzoekers doet nu verder onderzoek op het gebied van steganografie. anderen, zoals Scott Alfeld, onderzoeken vijandige instellingen waarin een aanvaller trainingsinstanties in een continue ruimte verstoort, in plaats van een subset van voorbeelden te selecteren, zoals in het geval van camouflage van de trainingsset.

© 2019 Wetenschap X Netwerk

Verkeer bleek een belangrijke bron van atmosferische nanocluster-aerosolen

Verkeer bleek een belangrijke bron van atmosferische nanocluster-aerosolen Californische dieselemissieregels verminderen luchtvervuiling, kwetsbare gemeenschappen beschermen

Californische dieselemissieregels verminderen luchtvervuiling, kwetsbare gemeenschappen beschermen Waarom gewone mensen inspraak moeten hebben in waterbeheer

Waarom gewone mensen inspraak moeten hebben in waterbeheer Studie lokaliseert de oorsprong van gletsjerroetvervuiling in Noord-India

Studie lokaliseert de oorsprong van gletsjerroetvervuiling in Noord-India Riviermensen:leven langs de belangrijkste waterwegen van Azië

Riviermensen:leven langs de belangrijkste waterwegen van Azië

Hoofdlijnen

- The Krebs Cycle Made Easy

- De voordelen van de beperking van off-road voertuigen wegen zwaarder dan de kosten voor de nationale kust

- Hoe schat ik de celgrootte met behulp van een microscoop?

- Lovelorn koala gepakt na ontsnapping uit dierentuin op jacht naar partner

- Wat is het laatste nieuws over de darmflora? Concordia-studenten microbiologie publiceren hun bevindingen

- Uniek veldonderzoek levert eerste overzichtsfoto van diepzeevoedselwebben op

- Wat is een organel in een cel?

- Hoe slaap werkt

- Robuuste kaken en verpletterende beten zorgen ervoor dat zeeotters hun dieet kunnen specialiseren

Muzikale zon vermindert het bereik van magnetische activiteit

Muzikale zon vermindert het bereik van magnetische activiteit Onderzoekers meten wereldwijd stikstofgehalte in graslanden

Onderzoekers meten wereldwijd stikstofgehalte in graslanden 10 manieren om jezelf gelukkig te maken

10 manieren om jezelf gelukkig te maken  Diepe evolutionaire verbanden tussen monogamie en vaderschap zijn ingewikkelder dan we dachten

Diepe evolutionaire verbanden tussen monogamie en vaderschap zijn ingewikkelder dan we dachten Wat is Quartz-uurwerk bij horloges?

Wat is Quartz-uurwerk bij horloges?  Hoe Crash Forces berekenen

Hoe Crash Forces berekenen Verstoppen voor een warmer klimaat in het bos

Verstoppen voor een warmer klimaat in het bos Zelf-uitgezonden oppervlaktegolfingen in dynamische breuk van silicium eenkristal

Zelf-uitgezonden oppervlaktegolfingen in dynamische breuk van silicium eenkristal

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com