Wetenschap

Aanklagers in San Francisco wenden zich tot AI om raciale vooroordelen te verminderen

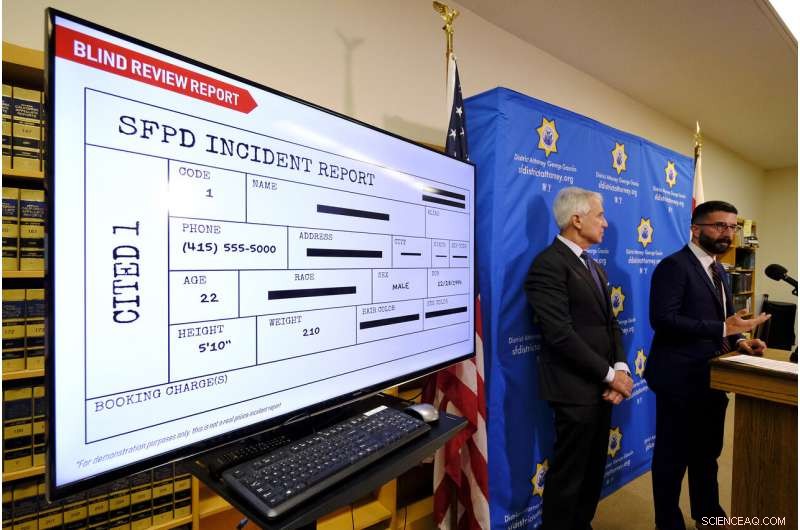

Met een blind politie-incidentrapport weergegeven, San Francisco officier van justitie George Gascon, links, en Alex Chohlas-Wood, Adjunct-directeur, Stanford Computational Policy Lab, praten over de implementatie van een kunstmatige-intelligentietool om mogelijke vooroordelen bij het nemen van beslissingen weg te nemen, tijdens een persconferentie woensdag 12 juni 2019, in San Francisco. In een eerste-van-zijn-soort experiment, Aanklagers van San Francisco wenden zich tot kunstmatige intelligentie om vooroordelen in de strafrechtbanken te verminderen. (AP Foto/Eric Risberg)

In een eerste-van-zijn-soort experiment, Aanklagers van San Francisco wenden zich tot kunstmatige intelligentie om raciale vooroordelen in de rechtbanken te verminderen, het aannemen van een systeem dat bepaalde identificerende details uit politierapporten haalt en alleen de belangrijkste feiten overlaat om beslissingen te nemen over de aanklacht.

Districtsadvocaat George Gascon kondigde woensdag aan dat zijn kantoor de technologie in juli zal gaan gebruiken om "race uit de vergelijking te halen" bij het beslissen of verdachten van een misdrijf moeten worden beschuldigd.

Experts op het gebied van strafrecht hebben nog nooit van een dergelijk project gehoord, en ze juichten het idee toe als een creatief, gedurfde poging om laadpraktijken kleurenblinder te maken.

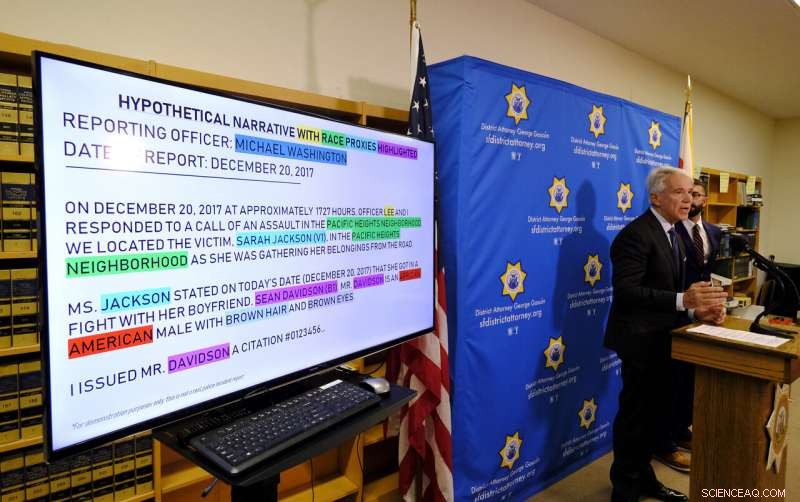

Het kantoor van Gascon werkte samen met datawetenschappers en ingenieurs van het Stanford Computational Policy Lab om een systeem te ontwikkelen dat elektronische politierapporten opneemt en automatisch de naam van een verdachte verwijdert. ras en haar- en oogkleuren. De namen van getuigen en politieagenten worden ook verwijderd, samen met specifieke buurten of wijken die het ras van de betrokkenen zouden kunnen aangeven.

"Het strafrechtsysteem heeft een verschrikkelijke impact gehad op gekleurde mensen in dit land, vooral Afro-Amerikanen, voor generaties, Gascon zei in een interview voorafgaand aan de aankondiging. "Als alle aanklagers de race uit beeld zouden nemen bij het nemen van beslissingen over de aanklacht, we zouden waarschijnlijk op een veel betere plaats zijn als een natie dan we nu zijn."

Met een hypothetisch politierapport weergegeven, De officier van justitie van San Francisco, George Gascon, spreekt over de implementatie van een kunstmatige-intelligentietool om mogelijke vooringenomenheid bij het aanrekenen van beslissingen weg te nemen tijdens een persconferentie woensdag, 12 juni 2019, in San Francisco. In een eerste-van-zijn-soort experiment, Aanklagers van San Francisco wenden zich tot kunstmatige intelligentie om vooroordelen in de strafrechtbanken te verminderen. Ze nemen een systeem aan dat bepaalde identificerende details uit politierapporten haalt en alleen de belangrijkste feiten overlaat om beslissingen over het aanrekenen te bepalen. Gascon kondigde aan dat zijn kantoor de technologie in juli zal gaan gebruiken om "race uit de vergelijking te halen" bij de beslissing om verdachten van een misdrijf te beschuldigen. (AP Foto/Eric Risberg)

Gascon zei dat het zijn doel was om een model te ontwikkelen dat elders kan worden gebruikt. en de technologie zal gratis worden aangeboden aan andere openbare aanklagers in het hele land.

"Ik beveel ze echt aan, het is een moedige zet, " zei Lucy Lang, een voormalige aanklager in New York City en uitvoerend directeur van het Institute for Innovation in Prosecution aan het John Jay College of Criminal Justice.

De technologie is afhankelijk van mensen om de eerste feiten te verzamelen, die nog steeds kan worden beïnvloed door raciale vooroordelen. Aanklagers zullen een eerste beslissing over de aanklacht nemen op basis van het geredigeerde politierapport. Dan bekijken ze het hele rapport, met details hersteld, om te zien of er verzachtende redenen zijn om de eerste beslissing te heroverwegen, aldus Gascon.

Lang en andere experts zeiden dat ze uitkijken naar de resultaten en dat ze verwachten dat het systeem een werk in uitvoering zal zijn.

-

San Francisco officier van justitie George Gascon, links, kondigt de implementatie aan van een kunstmatige-intelligentietool om mogelijke vooringenomenheid bij het nemen van beslissingen weg te nemen als Alex Chohlas-Wood, Adjunct-directeur, Stanford Computational Policy Lab, luistert tijdens een persconferentie woensdag, 12 juni 2019, in San Francisco. In een eerste-van-zijn-soort experiment, Aanklagers van San Francisco wenden zich tot kunstmatige intelligentie om vooroordelen in de strafrechtbanken te verminderen. (AP Foto/Eric Risberg)

-

San Francisco officier van justitie George Gascon, links, kondigt de implementatie aan van een kunstmatige-intelligentietool om mogelijke vooringenomenheid bij het nemen van beslissingen weg te nemen als Alex Chohlas-Wood, Adjunct-directeur, Stanford Computational Policy Lab, luistert tijdens een persconferentie woensdag, 12 juni 2019, in San Francisco. In een eerste-van-zijn-soort experiment, Aanklagers van San Francisco wenden zich tot kunstmatige intelligentie om vooroordelen in de strafrechtbanken te verminderen. (AP Foto/Eric Risberg)

-

Op deze dinsdag 16 februari 2016 bestandsfoto, San Francisco District Attorney George Gascon wordt getoond op een persconferentie in San Francisco, Op woensdag, 12 juni 2019, Gascon kondigt wat een eerste in zijn soort programma lijkt te zijn dat kunstmatige intelligentie gebruikt om vooroordelen in het strafrechtsysteem te verminderen. Vanaf volgende maand, openbare aanklagers zullen beslissen of ze een verdachte zullen aanklagen op basis van "kleurenblinde" politierapporten waarin namen, ras en andere identificerende details zijn verwijderd. (AP Foto/Jeff Chiu)

"Petje af voor het uitproberen van nieuwe dingen, " zei Phillip Atiba Goff, voorzitter van het Center for Policing Equity. "Er zijn zoveel contextuele factoren die op ras en etniciteit kunnen wijzen, dat het moeilijk voor te stellen is hoe zelfs een mens dat allemaal zou kunnen wegnemen."

Een onderzoek uit 2017 in opdracht van de officier van justitie van San Francisco vond "aanzienlijke raciale en etnische verschillen in de resultaten van het strafrecht." Afro-Amerikanen vertegenwoordigden slechts 6% van de bevolking van de provincie, maar waren goed voor 41% van de arrestaties tussen 2008 en 2014.

De studie vond "weinig bewijs van openlijke vooringenomenheid tegen een bepaald ras of etnische groep" onder aanklagers die strafbare feiten behandelen. Maar Gascon zei dat hij een manier wilde vinden om een impliciete vooringenomenheid te elimineren die zou kunnen worden veroorzaakt door de race van een verdachte. een etnisch klinkende naam of een door misdaad geteisterde buurt waar ze werden gearresteerd.

Nadat het is begonnen, het programma wordt wekelijks herzien, zei Maria Mckee, de DA's directeur van analyse en onderzoek.

De stap komt nadat San Francisco vorige maand de eerste Amerikaanse stad werd die het gebruik van gezichtsherkenning door politie en andere stadsdiensten verbood. Het besluit weerspiegelde een groeiend verzet tegen AI-technologie, aangezien steden toezicht door gemeentelijke instanties willen reguleren.

© 2019 The Associated Press. Alle rechten voorbehouden.

Suikerniveaus van verschillende frisdranken voor wetenschappelijke projecten

Suikerniveaus van verschillende frisdranken voor wetenschappelijke projecten Nieuwe methode gebruikt kunstmatige intelligentie om levende cellen te bestuderen

Nieuwe methode gebruikt kunstmatige intelligentie om levende cellen te bestuderen Infraroodsensor dient als een nieuw hulpmiddel voor het ontdekken van medicijnen

Infraroodsensor dient als een nieuw hulpmiddel voor het ontdekken van medicijnen Hoe verzadigingsdruk te berekenen

Hoe verzadigingsdruk te berekenen Chemicus synthetiseert nieuwe verbindingen met sterke antidiabetische eigenschappen

Chemicus synthetiseert nieuwe verbindingen met sterke antidiabetische eigenschappen

Hoofdlijnen

- Profase: wat gebeurt er in dit stadium van mitose en meiose?

- Hoe hersenspoeling werkt

- Onderzoekers zoeken burgerwetenschappers om bij te dragen aan het wereldwijd opsporen van muggen

- Aussie uilen vallen door rattengif

- Hoe celbrochures te maken

- Hoe u uw hersenen kunt stimuleren

- G2-fase: wat gebeurt er in deze subfase van de celcyclus?

- Hoe krijgen mensen stikstof in hun lichaam?

- Wat is de brugfase van glycolyse?

- Onderzoek toont aan dat vrouwen vaker te maken hebben met meningsverschillen over het schrijven van technische papers

- Waarom het aanpakken van ondervoeding de sleutel is tot empowerment van vrouwen

- Een nieuw idee:integratie van stedelijke en landelijke vangnetten in Afrika tijdens de pandemie

- Verzet tegen de rechten van seksuele en genderminderheden gekoppeld aan steun voor christelijke dominantie

- Het systeem oproepen:meer gezichten van zwarte en etnische minderheden in culturele ruimtes

Waarnemingen werpen meer licht op de atmosfeer van witte dwerg GD 424

Waarnemingen werpen meer licht op de atmosfeer van witte dwerg GD 424 Back-to-the-future planten geven inzicht in klimaatverandering

Back-to-the-future planten geven inzicht in klimaatverandering Hoe maak je een 3D-model van een koolstof-atoom

Hoe maak je een 3D-model van een koolstof-atoom  Simulaties repareren de scheuren in magnetische spiegels

Simulaties repareren de scheuren in magnetische spiegels Nieuwe EU-regels laten je Netflix kijken, BBC in het buitenland

Nieuwe EU-regels laten je Netflix kijken, BBC in het buitenland Washington produceert recordoogst wijndruiven in 2016

Washington produceert recordoogst wijndruiven in 2016 Resistentiewaarde berekenen

Resistentiewaarde berekenen Hoe een marginale kostenfunctie te vinden

Hoe een marginale kostenfunctie te vinden

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Spanish | Portuguese | Swedish | Dutch | Danish | Norway | Italian | German |

-

Wetenschap © https://nl.scienceaq.com