Wetenschap

Mona Lisa-gast op tv? Onderzoekers werken pratende hoofden uit foto's, kunst

Krediet:Egor Zakharov et al.

Een paper waarin een prestatie op het gebied van kunstmatige intelligentie wordt besproken, die nu op arXiv staat, geeft tech-watchers nog een andere reden om te denken dat dit het tijdperk van angst is.

"Few-shot contradictorisch leren van realistische neurale pratende hoofdmodellen" door Egor Zakharov, Aliaksandra Shysheya, Egor Burkov en Victor Lempitsky onthullen hun techniek die foto's en schilderijen kan veranderen in geanimeerde pratende hoofden. Auteursaffiliaties zijn onder meer het Samsung AI Center, Moskou en het Skolkovo Instituut voor Wetenschap en Technologie.

De hoofdrolspeler in dit alles? Samsung. Het opende onderzoekscentra in Moskou, Cambridge en Toronto vorig jaar en het eindresultaat zou wel eens meer krantenkoppen in de AI-geschiedenis kunnen zijn.

Ja, de Mona Lisa kan eruitzien alsof ze haar tv-presentator vertelt waarom ze de voorkeur geeft aan leave-in conditioners. Albert Einstein kan eruitzien alsof hij pleit voor helemaal geen haarproducten.

Ze schreven dat "we rekening houden met het probleem van het synthetiseren van fotorealistische gepersonaliseerde hoofdafbeeldingen op basis van een reeks gezichtsoriëntatiepunten, die de animatie van het model aansturen." Eén shot leren van een enkel frame, ook al, is mogelijk.

Khari Johnson, VentureBeat , merkte op dat ze realistische geanimeerde pratende hoofden van afbeeldingen kunnen genereren zonder vertrouwen op traditionele methoden zoals 3D-modellering.

De auteurs benadrukten dat "cruciaal, het systeem kan de parameters van zowel de generator als de discriminator op een persoonsspecifieke manier initialiseren, zodat training kan worden gebaseerd op slechts een paar afbeeldingen en snel kan worden gedaan, ondanks de noodzaak om tientallen miljoenen parameters af te stemmen."

Wat is hun aanpak? Ivan Mehta Het volgende web leidde lezers door de stappen die hun techniek vormen.

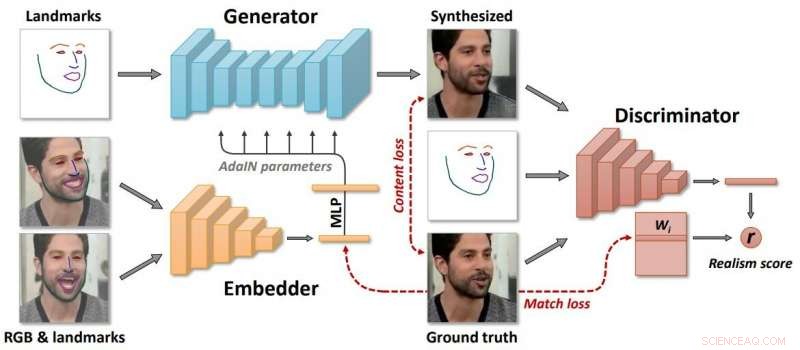

"Samsung zei dat het model tijdens het leerproces drie neurale netwerken creëert. het creëert een ingebed netwerk dat frames met betrekking tot gezichtsoriëntatiepunten koppelt met vectoren. Met behulp van die gegevens, het systeem creëert een generatornetwerk dat oriëntatiepunten in kaart brengt in de gesynthetiseerde video's. Eindelijk, het discriminatornetwerk beoordeelt het realisme en de pose van gegenereerde frames."

De auteurs beschreven "langdurig meta-leren" op een grote dataset van video's, en in staat om enkele en eenmalige leren van neurale pratende hoofdmodellen van voorheen onzichtbare mensen te framen als vijandige trainingsproblemen, met generatoren en discriminators met hoge capaciteit.

Wie zou dit systeem eigenlijk gebruiken? Rapporten vermeldden telepresence, games voor meerdere spelers en de special effects-industrie.

Niettemin, Johnson en anderen die hun rapporten indienden, waren niet van plan het risico van technologische vooruitgang in verkeerde handen te negeren, waar de ondeugden nep kunnen produceren met slechte bedoelingen.

"Zulke technologie zou duidelijk ook kunnen worden gebruikt om deepfakes te maken, ’ schreef Johnson.

Dus, we zouden die gedachte misschien even willen pauzeren. Alleen dat schrijvers nu zo terloops verwijzen naar de "deep fake"-resultaten die uit sommige kunstmatige-intelligentieprojecten komen. En schrijvers vragen zich af wat deze Samsung-stap in technologie zou kunnen betekenen in deepfakes.

Jon Christian had een overzicht in futurisme . "De afgelopen jaren we hebben de snelle opkomst gezien van 'deepfake'-technologie die machine learning gebruikt om beelden van echte mensen te analyseren - en vervolgens overtuigende video's te maken van hen die dingen doen die ze nooit hebben gedaan of dingen zeggen die ze nooit hebben gezegd."

Joan Solsman in CNET:"De snelle vooruitgang van kunstmatige intelligentie betekent dat elke keer dat een onderzoeker een doorbraak deelt in het maken van deepfake, slechte acteurs kunnen beginnen met het bij elkaar schrapen van hun eigen door de jury gemanipuleerd gereedschap om het na te bootsen."

interessant, hoe meer het publiek zich bewust is van AI-fake, hoe gemakkelijker ze accepteren dat sommige animaties nep zijn - of niet? Een kijkerscommentaar op de videopagina:"In de toekomst, chanteren is onmogelijk omdat iedereen weet dat je overal gemakkelijk een video van kunt maken."

© 2019 Wetenschap X Netwerk

Onderzoekers ontwikkelen brandvertragende coating met hernieuwbare materialen

Onderzoekers ontwikkelen brandvertragende coating met hernieuwbare materialen Het gebruik van fosfor in gloeilampen

Het gebruik van fosfor in gloeilampen  Sleutel tot uitbreiding van genetische code beschreven

Sleutel tot uitbreiding van genetische code beschreven Flessen gemaakt van lignocellulose, parfums gemaakt van appels

Flessen gemaakt van lignocellulose, parfums gemaakt van appels Hoe werkt papierchromatografie en waarom scheiden pigmenten op verschillende punten?

Hoe werkt papierchromatografie en waarom scheiden pigmenten op verschillende punten?

Hoofdlijnen

- Ideeën voor het maken van een 3D-model van een cel

- Welke organismen voeren fotosynthese uit?

- Waarom is de zon zo helder?

- Louis Pasteur: Biografie, uitvindingen, experimenten en feiten

- Celstructuurdefinities

- Kan de groei van volwassen hersencellen de manier waarop we denken over veroudering veranderen?

- Wat zijn lobben in een kern?

- Wat is het verschil tussen NADH en NADPH?

- Verbergen of opgegeten worden, urinechemicaliën vertellen modderkrabben

- Ex-Nissan-baas Ghosn kan zes maanden de cel in

- Kantoren zijn te warm of te koud - is er een betere manier om de kamertemperatuur te regelen?

- In China's eSport-scholen leren studenten dat het loont om te spelen

- PlayStation verlaagt prijs van cloud-videogameservice

- Alibaba, Russisch technologiebedrijf Mail.ru sluit gezamenlijke e-commerce-onderneming af

Nieuwe methode voor nanomaterialen geeft antwoord op lastige uitdagingen

Nieuwe methode voor nanomaterialen geeft antwoord op lastige uitdagingen Klimaatverandering en verwaarlozing bedreigen Senegals Saint Louis

Klimaatverandering en verwaarlozing bedreigen Senegals Saint Louis Luchtvervuilingsgegevens in vijf Chinese steden verschillen voor lokale VS Amerikaanse meetstations

Luchtvervuilingsgegevens in vijf Chinese steden verschillen voor lokale VS Amerikaanse meetstations Glasvezelkabels vangen gerommel van onweer op

Glasvezelkabels vangen gerommel van onweer op De taal van gedrag vertalen met kunstmatig intelligente motion capture

De taal van gedrag vertalen met kunstmatig intelligente motion capture Hoe Microprocessor-programmering te leren

Hoe Microprocessor-programmering te leren  Van stof tot kiezelstenen tot planeten – inzicht in de geboorte van een zonnestelsel

Van stof tot kiezelstenen tot planeten – inzicht in de geboorte van een zonnestelsel Redactioneel:Bescherm de milieu-erfenis van Californië tegen de aanvallen van Trump

Redactioneel:Bescherm de milieu-erfenis van Californië tegen de aanvallen van Trump

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com