Wetenschap

Emotie-leestechnologie faalt in de test voor raciale vooroordelen

Basketbalspelers Darren Collision (links) en Gordon Hayward (rechts). Krediet:basketball-reference.com

De technologie voor gezichtsherkenning is zo ver gevorderd dat het nu emoties in gezichtsuitdrukkingen interpreteert. Dit type analyse wordt in het dagelijks leven steeds vaker gebruikt. Bijvoorbeeld, bedrijven kunnen gezichtsherkenningssoftware gebruiken om te helpen bij het nemen van beslissingen. Andere programma's scannen de gezichten in menigten om bedreigingen voor de openbare veiligheid te identificeren.

Helaas, deze technologie worstelt om de emoties van zwarte gezichten te interpreteren. Mijn nieuwe studie, vorige maand gepubliceerd, toont aan dat technologie voor emotionele analyse meer negatieve emoties toewijst aan gezichten van zwarte mannen dan aan gezichten van blanke mannen.

Dit is niet de eerste keer dat gezichtsherkenningsprogramma's bevooroordeeld zijn. Google bestempelde zwarte gezichten als gorilla's. Camera's identificeerden Aziatische gezichten als knipperend. Gezichtsherkenningsprogramma's hadden moeite om het geslacht correct te identificeren voor mensen met een donkere huid.

Mijn werk draagt bij aan een groeiende roep om de verborgen vooringenomenheid in kunstmatige-intelligentiesoftware beter te begrijpen.

Vooringenomenheid meten

Om de vooringenomenheid te onderzoeken in de gezichtsherkenningssystemen die de emoties van mensen analyseren, Ik gebruikte een dataset van 400 NBA-spelersfoto's van het seizoen 2016 tot 2017, omdat spelers qua kleding op elkaar lijken, atletisch, leeftijd en geslacht. Ook, aangezien dit professionele portretten zijn, de spelers kijken naar de camera op de foto.

Ik heb de afbeeldingen door twee bekende soorten emotionele herkenningssoftware gehaald. Beiden gaven zwarte spelers gemiddeld meer negatieve emotionele scores, hoeveel ze ook lachten.

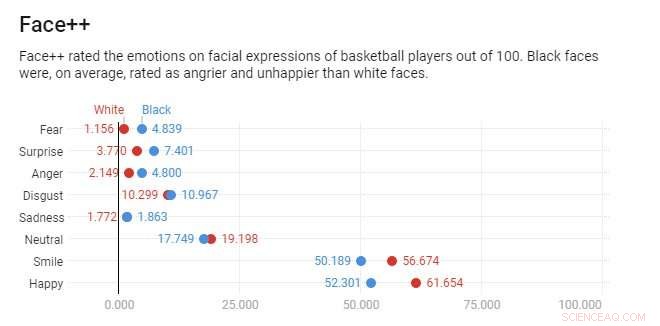

Credit:Grafiek:Het gesprek, CC-BY-ND Bron:SSRN (2018)

Bijvoorbeeld, kijk eens naar de officiële NBA-foto's van Darren Collison en Gordon Hayward. Beide spelers glimlachen, en, volgens het gezichtsherkennings- en analyseprogramma Face++, Darren Collison en Gordon Hayward hebben vergelijkbare lachscores - 48,7 en 48,1 van de 100, respectievelijk.

Echter, Face++ beoordeelt de gezichtsuitdrukking van Hayward als 59,7 procent blij en 0,13 procent boos en de gezichtsuitdrukking van Collison als 39,2 procent blij en 27 procent boos. Collison wordt gezien als bijna net zo boos als blij en veel bozer dan Hayward - ondanks dat het gezichtsherkenningsprogramma zelf herkent dat beide spelers glimlachen.

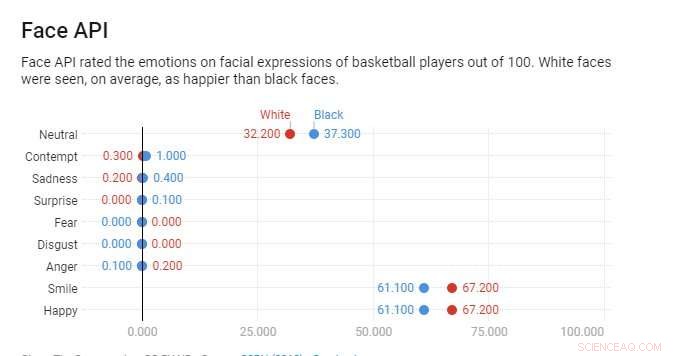

In tegenstelling tot, Microsoft's Face API beschouwde beide mannen als gelukkig. Nog altijd, Collison wordt als minder gelukkig gezien dan Hayward, met 98 en 93 procent geluksscores, respectievelijk. Ondanks zijn glimlach, Collison wordt zelfs met een beetje minachting gescoord, terwijl Hayward er geen heeft.

Over alle NBA-foto's heen, komt hetzelfde patroon naar voren. Gemiddeld, Face++ beoordeelt zwarte gezichten twee keer zo boos als blanke gezichten. Face API beoordeelt zwarte gezichten als drie keer minachtend dan witte gezichten. Na het matchen van spelers op basis van hun glimlach, beide gezichtsanalyseprogramma's wijzen nog steeds vaker de negatieve emoties van woede of minachting toe aan zwarte gezichten.

Stereotype door AI

Mijn onderzoek toont aan dat programma's voor gezichtsherkenning twee verschillende soorten vooroordelen vertonen.

Credit:Grafiek:Het gesprek, CC-BY-ND Bron:SSRN (2018)

Eerst, zwarte gezichten werden consequent gescoord als bozer dan witte gezichten voor elke glimlach. Face++ toonde dit soort vooroordelen. Tweede, zwarte gezichten werden altijd als bozer beoordeeld als er onduidelijkheid bestond over hun gezichtsuitdrukking. Face API vertoonde dit soort ongelijkheid. Zelfs als zwarte gezichten gedeeltelijk glimlachen, mijn analyse toonde aan dat de systemen meer negatieve emoties aannamen in vergelijking met hun witte tegenhangers met vergelijkbare uitdrukkingen. De gemiddelde emotionele scores lagen veel dichter bij de races, maar er waren nog steeds merkbare verschillen voor zwarte en witte gezichten.

Deze observatie sluit aan bij ander onderzoek, wat suggereert dat zwarte professionals positieve emoties moeten versterken om gelijkheid te krijgen in hun evaluaties van hun werkplekprestaties. Studies tonen aan dat mensen zwarte mannen als meer fysiek bedreigend ervaren dan blanke mannen, ook als ze even groot zijn.

Sommige onderzoekers beweren dat gezichtsherkenningstechnologie objectiever is dan mensen. Maar mijn onderzoek suggereert dat gezichtsherkenning dezelfde vooroordelen weerspiegelt als mensen. Gezichtsuitdrukkingen van zwarte mannen worden vaker gescoord met emoties die verband houden met bedreigend gedrag dan blanke mannen, zelfs als ze glimlachen. Er is goede reden om aan te nemen dat het gebruik van gezichtsherkenning reeds bestaande stereotypen zou kunnen formaliseren in algoritmen, automatisch in te bedden in het dagelijks leven.

Totdat gezichtsherkenning zwarte en witte gezichten op dezelfde manier beoordeelt, zwarte mensen moeten misschien hun positieve gezichtsuitdrukkingen overdrijven - in wezen meer glimlachen - om dubbelzinnigheid en mogelijk negatieve interpretaties door de technologie te verminderen.

Hoewel innovatief, kunstmatige intelligentie kan de bestaande machtsdynamiek verstoren en verergeren, wat leidt tot een ongelijksoortige impact tussen raciale/etnische groepen. Enige maatschappelijke verantwoordelijkheid is nodig om eerlijkheid voor alle groepen te garanderen, omdat gezichtsherkenning, zoals de meeste kunstmatige intelligentie, is vaak onzichtbaar voor de mensen die het meest worden getroffen door zijn beslissingen.

Dit artikel is opnieuw gepubliceerd vanuit The Conversation onder een Creative Commons-licentie. Lees het originele artikel.

De zomer kan een lange hittegolf zijn als de temperatuur met slechts 2C stijgt

De zomer kan een lange hittegolf zijn als de temperatuur met slechts 2C stijgt Wereldwijde CO2-belasting is mogelijk haalbaarder dan eerder werd gedacht

Wereldwijde CO2-belasting is mogelijk haalbaarder dan eerder werd gedacht Hernieuwbare energie en de strijd om de Guatemalteekse rivieren

Hernieuwbare energie en de strijd om de Guatemalteekse rivieren Toenemende kooldioxide in de atmosfeer leert oude eiken nieuwe trucs

Toenemende kooldioxide in de atmosfeer leert oude eiken nieuwe trucs Ideeën voor Science Fair-projecten op vis

Ideeën voor Science Fair-projecten op vis

Hoofdlijnen

- Grote katten in Groot-Brittannië - stedelijke mythe of wetenschappelijk feit?

- Thomas Malthus: Biografie, Populatietheorie & Feiten

- Afwijkende hyfen veroorzaakt door immuunreacties van de gastheer op plantpathogene schimmel

- Wat kan er gebeuren als Meiose verkeerd gaat?

- Depolarisatie en herpolarisatie van het celmembraan

- Mottenvrouwtjes gebruiken geurnabijheid om partners aan te trekken

- Wetenschappers identificeren nieuwe gastheren voor vectoren van de ziekte van Chagas

- Kuikenembryo's leveren waardevolle genetische gegevens voor het begrijpen van de menselijke ontwikkeling

- Vliegenjager heeft 30 nieuwe soorten beschreven

- Waterstof-aardgashydraten gewonnen door aardgas

- Door crisis getroffen Nissan benoemt hoofd van Chinese eenheid Makoto Uchida als nieuwe CEO

- Oakland, Californië, weerhoudt de stad van het gebruik van gezichtsherkenningstechnologie

- Winst Nokia daalt omdat klanten op hun hoede zijn voor uitgaven aan nieuwe netwerken

- Zelfrijdende minibusjes van Waymo rijden naar meer Amerikaanse wegen

AI:agenten vertonen verrassend gedrag in verstoppertje

AI:agenten vertonen verrassend gedrag in verstoppertje EPA stelt definitieve beslissing over transparantieregel voor wetenschap uit

EPA stelt definitieve beslissing over transparantieregel voor wetenschap uit Zeldzame tropische storm gedegradeerd na het raken van het noordoosten van de VS

Zeldzame tropische storm gedegradeerd na het raken van het noordoosten van de VS Fotonische stralingssensoren overleven enorme doses onbeschadigd

Fotonische stralingssensoren overleven enorme doses onbeschadigd Onderzoekers behalen herkenningspercentages van 100 procent voor halve en driekwart gezichten

Onderzoekers behalen herkenningspercentages van 100 procent voor halve en driekwart gezichten NASA ziet Pineapple Express zware regenval bezorgen, overstromingen naar Californië

NASA ziet Pineapple Express zware regenval bezorgen, overstromingen naar Californië Veertig jaar later,

Veertig jaar later,  Opruimen van de Mississippi-rivier

Opruimen van de Mississippi-rivier

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com