Wetenschap

Kunnen AI-robots zelf vooroordelen ontwikkelen?

Krediet:CC0 Publiek Domein

Het tonen van vooroordelen jegens anderen vereist geen hoog niveau van cognitief vermogen en kan gemakkelijk worden vertoond door kunstmatig intelligente machines, nieuw onderzoek heeft gesuggereerd.

Informatica- en psychologie-experts van Cardiff University en MIT hebben aangetoond dat groepen autonome machines vooroordelen kunnen aantonen door simpelweg te identificeren, dit gedrag kopiëren en van elkaar leren.

Het lijkt misschien dat vooroordelen een mensspecifiek fenomeen zijn dat menselijke cognitie vereist om een mening te vormen over, of stereotyperen, een bepaalde persoon of groep.

Hoewel sommige soorten computeralgoritmen al vooroordelen vertonen, zoals racisme en seksisme, gebaseerd op het leren van openbare registers en andere gegevens die door mensen zijn gegenereerd, dit nieuwe werk toont de mogelijkheid aan dat AI op zichzelf bevooroordeelde groepen ontwikkelt.

De nieuwe bevindingen, die in het tijdschrift zijn gepubliceerd Wetenschappelijke rapporten , zijn gebaseerd op computersimulaties van hoe gelijkaardige bevooroordeelde individuen, of virtuele agenten, kunnen een groep vormen en met elkaar omgaan.

In een spel van geven en nemen, elk individu beslist of ze doneren aan iemand binnen hun eigen groep of in een andere groep, op basis van de reputatie van een persoon en hun eigen donatiestrategie, waaronder hun mate van vooroordelen jegens buitenstaanders.

Terwijl het spel zich ontvouwt en een supercomputer duizenden simulaties verzamelt, elk individu begint nieuwe strategieën te leren door anderen te kopiëren, hetzij binnen hun eigen groep of de hele bevolking.

Co-auteur van de studie Professor Roger Whitaker, van het Crime and Security Research Institute van Cardiff University en de School of Computer Science and Informatics, zei:"Door deze simulaties duizenden en duizenden keren uit te voeren, we beginnen te begrijpen hoe vooroordelen zich ontwikkelen en de omstandigheden die dit bevorderen of belemmeren.

"Onze simulaties laten zien dat vooroordelen een krachtige natuurkracht zijn en door evolutie, het kan gemakkelijk worden gestimuleerd in virtuele populaties, ten koste van een bredere verbinding met anderen. Bescherming tegen benadeelde groepen kan er onbedoeld toe leiden dat individuen verdere benadeelde groepen vormen, resulterend in een versplinterde populatie. Dergelijke wijdverbreide vooroordelen zijn moeilijk om te keren."

De bevindingen hebben betrekking op individuen die hun vooroordelen bijwerken door bij voorkeur degenen te kopiëren die een hogere kortetermijnuitbetaling behalen, wat betekent dat deze beslissingen niet per se geavanceerde cognitieve vaardigheden vereisen.

"Het is mogelijk dat autonome machines met het vermogen om zich te identificeren met discriminatie en anderen te kopiëren in de toekomst vatbaar zouden kunnen zijn voor nadelige verschijnselen die we zien in de menselijke bevolking, ’ vervolgde professor Whitaker.

"Veel van de AI-ontwikkelingen die we zien, hebben te maken met autonomie en zelfcontrole, wat betekent dat het gedrag van apparaten ook wordt beïnvloed door anderen om hen heen. Voertuigen en het internet der dingen zijn twee recente voorbeelden. Onze studie geeft een theoretisch inzicht waar gesimuleerde agenten periodiek een beroep doen op anderen voor een soort hulpbron."

Een andere interessante bevinding uit het onderzoek was dat onder bepaalde omstandigheden, waaronder meer verschillende subpopulaties die aanwezig zijn binnen een populatie, het was moeilijker voor vooroordelen om stand te houden.

"Met een groter aantal subpopulaties, allianties van onschadelijke groepen kunnen samenwerken zonder te worden uitgebuit. Dit vermindert ook hun status als minderheid, het verminderen van de gevoeligheid voor vooroordelen. Echter, dit vereist ook omstandigheden waarin agenten een grotere neiging hebben tot interactie buiten hun groep, ’ concludeerde professor Whitaker.

Hoofdlijnen

- Hoe een DNA-structuur te labelen

- Hoe menselijke Wang-cellen te observeren onder een lichtmicroscoop

- Tsunami onthult menselijke geluidsoverlast in Hawaiiaanse wateren

- Verbazingwekkende diversiteit aan soorten gerapporteerd over Solent oesterrestauratieproject

- De nadelen van Western Blotting

- De definitie van abiotische en biotische factoren

- Naar huis vliegen? IJstijd heeft de vogeltrek mogelijk afgeremd

- Rollende dobbelstenen voor specificatie van celgrootte in epidermis van planten

- 4 manieren om te vertellen of gezondheidsrapportage nepnieuws kan zijn

- Waymo blaast zelfrijdende auto's op in de buurt van Motor City

- De hightech evolutie van wetenschappelijke informatica

- Kunstmatige intelligentie krijgt zijn dag voor de rechtbank

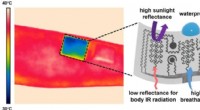

- Ingenieurs ontwerpen elektronisch apparaat op de huid dat een persoonlijke airconditioner biedt zonder dat er elektriciteit nodig is

- Privacy krijgt de hoogste facturering in Firefox-bewegingen

Mysterie van zeldzame vulkanen op Venus

Mysterie van zeldzame vulkanen op Venus Metalen drijfveren van de ziekte van Alzheimer

Metalen drijfveren van de ziekte van Alzheimer Vrouwelijke presidenten worden aan hogere normen gehouden dan mannen

Vrouwelijke presidenten worden aan hogere normen gehouden dan mannen Mini-tornado's van sporen verlicht tijdens regendruppelinslag

Mini-tornado's van sporen verlicht tijdens regendruppelinslag Nieuwe geometrieën:onderzoekers creëren nieuwe vormen van kunstmatige microcompartimenten

Nieuwe geometrieën:onderzoekers creëren nieuwe vormen van kunstmatige microcompartimenten Nieuw onderzoek analyseert modelleringstechnieken voor koolstofafvangtechnologie

Nieuw onderzoek analyseert modelleringstechnieken voor koolstofafvangtechnologie Nieuwe EU-brede tests om voedselapartheid aan te pakken

Nieuwe EU-brede tests om voedselapartheid aan te pakken Nanobiomateriaal stimuleert neuronale groei bij muizen met ruggenmergletsel

Nanobiomateriaal stimuleert neuronale groei bij muizen met ruggenmergletsel

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com