Wetenschap

Denken mensen dat computers eerlijke beslissingen nemen?

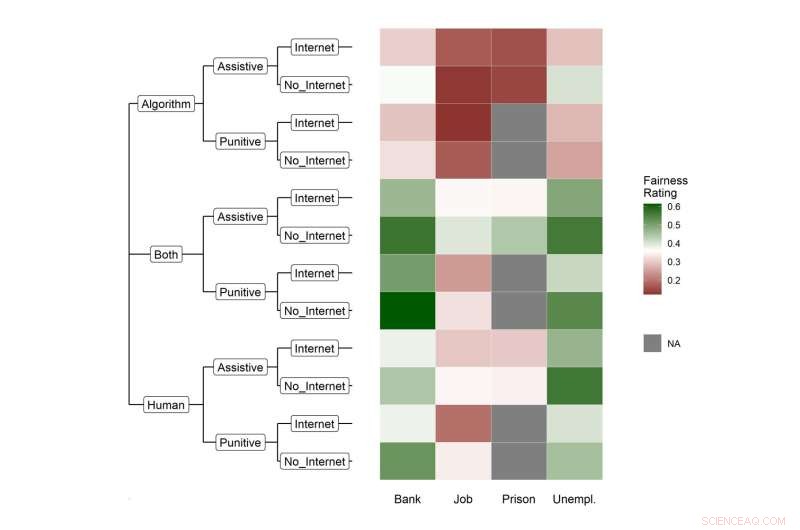

De heatmap toont relatieve frequenties van respondenten die een scenario beoordeelden als "Redelijk" (d.w.z. "Enigszins redelijk" of "Zeer redelijk"). De kleurenschaal is gecentreerd op de gemiddelde eerlijkheidsbeoordeling over alle experimenten. Credit:Patterns/Gordon en Kern et al.

Tegenwoordig helpt machine learning bij het bepalen van de lening waarvoor we in aanmerking komen, de baan die we krijgen en zelfs wie naar de gevangenis gaat. Maar als het gaat om deze mogelijk levensveranderende beslissingen, kunnen computers dan eerlijk bellen? In een studie gepubliceerd op 29 september in het tijdschrift Patterns , toonden onderzoekers uit Duitsland aan dat mensen met menselijk toezicht denken dat de beslissing van een computer net zo eerlijk kan zijn als een beslissing die primair door mensen wordt genomen.

"Veel van de discussies over eerlijkheid bij machine learning waren gericht op technische oplossingen, zoals het oplossen van oneerlijke algoritmen en het eerlijk maken van systemen", zegt computationeel sociaal wetenschapper en co-auteur Ruben Bach van de Universiteit van Mannheim, Duitsland. "Maar onze vraag is:wat vinden mensen eerlijk? Het gaat niet alleen om het ontwikkelen van algoritmen. Ze moeten worden geaccepteerd door de samenleving en voldoen aan normatieve overtuigingen in de echte wereld."

Geautomatiseerde besluitvorming, waarbij een conclusie uitsluitend door een computer wordt gemaakt, blinkt uit in het analyseren van grote datasets om patronen te detecteren. Computers worden vaak als objectief en neutraal beschouwd in vergelijking met mensen, wiens vooroordelen oordelen kunnen vertroebelen. Toch kan vooringenomenheid in computersystemen binnensluipen als ze leren van gegevens die discriminerende patronen in onze wereld weerspiegelen. Het begrijpen van eerlijkheid in computer- en menselijke beslissingen is cruciaal voor het opbouwen van een meer rechtvaardige samenleving.

Om te begrijpen wat mensen eerlijk vinden over geautomatiseerde besluitvorming, hebben de onderzoekers 3.930 personen in Duitsland ondervraagd. De onderzoekers gaven hen hypothetische scenario's met betrekking tot de bank-, baan-, gevangenis- en werkloosheidsstelsels. Binnen de scenario's vergeleken ze verder verschillende situaties, waaronder of de beslissing tot een positief of negatief resultaat leidt, waar de gegevens voor evaluatie vandaan komen en wie de uiteindelijke beslissing neemt:mens, computer of beide.

"Zoals verwacht zagen we dat volledig geautomatiseerde besluitvorming niet de voorkeur had", zegt computationeel sociaal wetenschapper en co-eerste auteur Christoph Kern van de Universiteit van Mannheim. "Maar wat interessant was, is dat wanneer je menselijke supervisie hebt over de geautomatiseerde besluitvorming, het niveau van waargenomen eerlijkheid vergelijkbaar wordt met mensgerichte besluitvorming." De resultaten toonden aan dat mensen een beslissing als eerlijker ervaren als er mensen bij betrokken zijn.

Mensen maakten zich ook meer zorgen over eerlijkheid bij beslissingen die verband hielden met het strafrechtelijk systeem of de vooruitzichten op een baan, waar de inzet hoger is. Mogelijk gezien het gewicht van verliezen groter dan het gewicht van winsten, beschouwden de deelnemers beslissingen die tot positieve resultaten kunnen leiden, eerlijker dan negatieve. Vergeleken met systemen die alleen vertrouwen op scenariogerelateerde gegevens, werden systemen die gebruikmaken van aanvullende niet-gerelateerde gegevens van internet als minder eerlijk beschouwd, wat het belang van gegevenstransparantie en privacy bevestigt. Samen lieten de resultaten zien dat context ertoe doet. Geautomatiseerde besluitvormingssystemen moeten zorgvuldig worden ontworpen wanneer er bezorgdheid over eerlijkheid ontstaat.

Hoewel hypothetische situaties in de enquête mogelijk niet volledig worden vertaald naar de echte wereld, is het team al aan het brainstormen over de volgende stappen om eerlijkheid beter te begrijpen. Ze zijn van plan het onderzoek verder te brengen om te begrijpen hoe verschillende mensen rechtvaardigheid definiëren. Ze willen ook soortgelijke enquêtes gebruiken om meer vragen te stellen over ideeën zoals verdelende rechtvaardigheid, de billijkheid van de toewijzing van middelen onder de gemeenschap.

"In zekere zin hopen we dat mensen in de industrie deze resultaten als stof tot nadenken kunnen beschouwen en als dingen die ze moeten controleren voordat ze een geautomatiseerd besluitvormingssysteem ontwikkelen en implementeren", zegt Bach. "We moeten er ook voor zorgen dat mensen begrijpen hoe de gegevens worden verwerkt en hoe beslissingen op basis daarvan worden genomen." + Verder verkennen

Morele illusies kunnen ons gedrag veranderen

Laserstraalexcitatie heeft geen invloed op de nucleofiele substitutiereactie

Laserstraalexcitatie heeft geen invloed op de nucleofiele substitutiereactie Zee-egelproteïne geeft inzicht in zelfassemblage van skeletstructuren

Zee-egelproteïne geeft inzicht in zelfassemblage van skeletstructuren Slechts een klein stukje papier kan het waterverbruik veiliger maken

Slechts een klein stukje papier kan het waterverbruik veiliger maken Simulaties maken het mogelijk om stereochemie te kiezen voor je eigen avontuur

Simulaties maken het mogelijk om stereochemie te kiezen voor je eigen avontuur Zeer stabiele waterelektrolysekatalysator voor de productie van waterstof en zuurstof

Zeer stabiele waterelektrolysekatalysator voor de productie van waterstof en zuurstof

Doden door zware moesson stijgen tot bijna 140 in Oost-India

Doden door zware moesson stijgen tot bijna 140 in Oost-India NASA vindt een minder langwerpig potentieel Tropical Cyclone Six

NASA vindt een minder langwerpig potentieel Tropical Cyclone Six Giftige algenbloei wordt erger, maar overzicht ontbreekt

Giftige algenbloei wordt erger, maar overzicht ontbreekt NASA-wetenschappers vliegen over Groenland om smeltend ijs te volgen

NASA-wetenschappers vliegen over Groenland om smeltend ijs te volgen Met een PFAS-opruimingsprijskaartje van $ 3 miljard op de loer, Pentagon kijkt naar de industrie voor ideeën

Met een PFAS-opruimingsprijskaartje van $ 3 miljard op de loer, Pentagon kijkt naar de industrie voor ideeën

Hoofdlijnen

- Artificiële intelligentie gebruiken om tuberculosebehandelingen te verbeteren

- Hoe Body Dysmorphic Disorder werkt

- Hoe beïnvloedt CO2 de opening van de huidmondjes?

- Zebra-poepwetenschap verbetert de inspanningen voor natuurbehoud

- EP-leden dringen aan op onderzoek naar de invloed van Monsanto op onderzoek

- 10 bizarre behandelingen die artsen vroeger dachten dat ze legitiem waren

- Moet je intelligent zijn om slecht te zijn?

- Vooruitgang bereikt in droge conservering van spermacellen van zoogdieren

- Uit onderzoek blijkt dat wassen effectief lood verwijdert uit groenten die in stedelijke grond worden verbouwd

- Pilotenstaking sleept SAS-nettoverlies verder naar beneden

- 30% van het Britse aardgas zou kunnen worden vervangen door waterstof, CO2-uitstoot verminderen

- Slechte week op sociale media wordt erger; Twitter gehamerd

- Lufthansa annuleert 23, 000 vluchten in april vanwege virus

- Streeft naar technische problemen die winkels verstoppen met lange kassa's

Onderzoekers ontwikkelen slimme gouden nanokooien om chemoresistentie te doorbreken

Onderzoekers ontwikkelen slimme gouden nanokooien om chemoresistentie te doorbreken Zwitserse autoriteiten waarschuwen voor instorting gletsjer gebied evacueren

Zwitserse autoriteiten waarschuwen voor instorting gletsjer gebied evacueren Stadsuitbreiding in Perth die het seksleven van planten beïnvloedt

Stadsuitbreiding in Perth die het seksleven van planten beïnvloedt UWA Zadko-telescoop helpt bij het reconstrueren van barbaarse asteroïden

UWA Zadko-telescoop helpt bij het reconstrueren van barbaarse asteroïden Maatschappelijke kosten van koolstof:wat is het, en waarom moeten we het berekenen?

Maatschappelijke kosten van koolstof:wat is het, en waarom moeten we het berekenen? Topsport wordt een platform om de transgemeenschap te targeten

Topsport wordt een platform om de transgemeenschap te targeten De lijn wordt vager:asteroïden en kometen lijken misschien meer op elkaar dan we denken

De lijn wordt vager:asteroïden en kometen lijken misschien meer op elkaar dan we denken Hoe nauwkeurig zijn diepzee-oliescanners?

Hoe nauwkeurig zijn diepzee-oliescanners?

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com