Wetenschap

Verdient kunstmatige intelligentie dezelfde ethische bescherming die we aan dieren geven?

Krediet:CC0 Publiek Domein

In de HBO-show Westworld , robots ontworpen om emoties weer te geven, pijn voelen, en sterf zoals mensen een uitgestrekt themapark in westerse stijl bevolken voor rijke gasten die betalen om hun fantasieën uit te voeren. Naarmate de voorstelling vordert, en de robots leren meer over de wereld waarin ze leven, ze beginnen te beseffen dat ze het speelgoed zijn van de persoon die ze heeft geprogrammeerd.

Kijkers zouden kunnen concluderen dat mensen zich robots met zulke geavanceerde kunstmatige intelligentie moeten veroorloven, zoals die in Westworld -dezelfde ethische bescherming die we elkaar bieden. Maar Westworld is een fictief tv-programma. En robots met de cognitieve verfijning van mensen bestaan niet.

Maar door de vooruitgang op het gebied van kunstmatige intelligentie door universiteiten en technologiebedrijven zijn we dichter dan ooit bij het creëren van machines die "ongeveer zo cognitief geavanceerd zijn als muizen of honden, " zegt John Basl, die een assistent-professor filosofie is aan de Northeastern University. Hij stelt dat deze machines dezelfde ethische bescherming verdienen die we geven aan dieren die bij onderzoek betrokken zijn.

"Het nachtmerriescenario is dat we een machinegeest creëren, en zonder het te weten, doe er iets aan dat pijnlijk is, " zegt Basl. "We creëren een bewust wezen en laten het dan lijden."

Comités voor dierenverzorging en -gebruik houden wetenschappelijk onderzoek nauwlettend in de gaten om ervoor te zorgen dat dieren niet onnodig lijden, en de normen zijn nog hoger voor onderzoek waarbij menselijke stamcellen betrokken zijn, zegt Bazel.

Naarmate wetenschappers en ingenieurs dichter bij het creëren van kunstmatig intelligente machines komen die bewust zijn, de wetenschappelijke gemeenschap moet een soortgelijk raamwerk bouwen om deze intelligente machines te beschermen tegen lijden en pijn, te, zegt Bazel.

"Meestal wachten we tot we een ethische catastrofe hebben, en maak daarna regels om te voorkomen dat het nog een keer gebeurt, " zegt Basl. "We zeggen dat we hier nu over moeten gaan nadenken, voordat we een catastrofe hebben."

Basl en zijn collega aan de Universiteit van Californië, rivieroever, de oprichting van toezichtcomités voorstellen, bestaande uit cognitieve wetenschappers, kunstmatige intelligentie ontwerpers, filosofen, en ethici - om onderzoek met kunstmatige intelligentie zorgvuldig te evalueren. En ze zeggen dat het waarschijnlijk is dat dergelijke commissies al het huidige onderzoek naar kunstmatige intelligentie als toelaatbaar zullen beoordelen.

Maar aan de basis van dit alles ligt een filosofische vraag:hoe weten we wanneer we een machine hebben gemaakt die vreugde en lijden kan ervaren, vooral als die machine die gevoelens niet aan ons kan overbrengen?

Er is geen eenvoudig antwoord op deze vraag, Bazel zegt, gedeeltelijk omdat wetenschappers het niet eens zijn over wat bewustzijn eigenlijk is.

Sommige mensen hebben een "liberale" kijk op bewustzijn, zegt Bazel. Ze geloven dat alles wat nodig is om bewustzijn te laten bestaan "goed georganiseerde informatieverwerking, " en een middel om aandacht te besteden aan en plannen te maken voor de lange termijn. Mensen met meer "conservatieve" opvattingen, hij zegt, vereisen dat robots specifieke biologische kenmerken hebben, zoals een brein dat lijkt op dat van een zoogdier.

Op dit punt, Bazel zegt, het is niet duidelijk welke opvatting de juiste zou kunnen zijn, of dat er een andere manier is om bewustzijn te definiëren die we nog niet hebben overwogen. Maar, als we de meer liberale definitie van bewustzijn gebruiken, wetenschappers kunnen binnenkort intelligente machines maken die pijn en lijden kunnen voelen, en die ethische bescherming verdienen, zegt Bazel.

"We kunnen heel ver verwijderd zijn van het creëren van een bewuste AI, of we zouden dichtbij kunnen zijn, ' zegt Basl. 'We moeten voorbereid zijn voor het geval we in de buurt zijn.'

Verbindingen in monsterradijs kunnen hart- en vaatziekten helpen temmen

Verbindingen in monsterradijs kunnen hart- en vaatziekten helpen temmen Geleidende aard in kristalstructuren onthuld bij een vergroting van 10 miljoen keer

Geleidende aard in kristalstructuren onthuld bij een vergroting van 10 miljoen keer Slimme spons kan olielekkages opruimen

Slimme spons kan olielekkages opruimen Eiwitkameleon kleurt langetermijngeheugen

Eiwitkameleon kleurt langetermijngeheugen Wetenschappers maken galactische bouwstenen om de ruimte tussen sterren te bestuderen

Wetenschappers maken galactische bouwstenen om de ruimte tussen sterren te bestuderen

In opmerkelijke verschuiving, vier op de vijf Texanen zeggen dat klimaatverandering echt is. Wat nu?

In opmerkelijke verschuiving, vier op de vijf Texanen zeggen dat klimaatverandering echt is. Wat nu? Wat zijn de eerste eukaryote fossielen?

Wat zijn de eerste eukaryote fossielen?  Mossen die worden gebruikt om de atmosferische omstandigheden in stedelijke gebieden te evalueren

Mossen die worden gebruikt om de atmosferische omstandigheden in stedelijke gebieden te evalueren Tsunami in Indonesië toont blinde vlekken in wereldwijde waarschuwingssystemen

Tsunami in Indonesië toont blinde vlekken in wereldwijde waarschuwingssystemen NASA ziet Pineapple Express zware regenval bezorgen, overstromingen naar Californië

NASA ziet Pineapple Express zware regenval bezorgen, overstromingen naar Californië

Hoofdlijnen

- DNA-bewijs onthult twee vergeten Noord-Amerikaanse migraties

- De positieve kant van een besmettelijk eiwit:stresssensoren bevorderen de overleving van gistcellen

- Het zijn voornamelijk moeders die mitochondriën doorgeven - en een nieuwe theorie zegt dat dit te wijten is aan het eerste seksuele conflict

- Vergelijk en vergelijk DNA & RNA

- Indonesische smokkelaars stopten exotische vogels in pijpen:politie

- Is schizofrenie samen met onze hersenen geëvolueerd?

- Onderzoek details genetische resistentie tegen plotselinge dood syndroom in sojabonen

- Onderzoekers vinden dat diffusie een ongebruikelijke signaalrol speelt in Drosophila-embryo's

- In Zuid Afrika, bijen voorkomen dat olifanten bomen vertrappen

- Singapore stopt Zoom voor online onderwijs terwijl hackers toeslaan

- Specificatiekwetsbaarheid in apparaten die Bluetooth spreken is verholpen

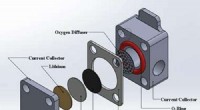

- Onderzoek naar lithium-zuurstofbatterijen zou de prestaties van elektronica kunnen verbeteren, auto's

- Europese prijzenoorlog knijpt Lufthansa hard onder druk

- Chinese miljardair Li Shufu koopt grootste aandeel in Daimler

Om leerlingen te helpen in 3D te denken, een geoloog wendt zich tot het maken van papieren modellen

Om leerlingen te helpen in 3D te denken, een geoloog wendt zich tot het maken van papieren modellen Feiten over olieboringen

Feiten over olieboringen  US West worstelt om doelen te bereiken door vuur met vuur te bestrijden

US West worstelt om doelen te bereiken door vuur met vuur te bestrijden Nieuwe methode om malariabehandeling op grote schaal te produceren

Nieuwe methode om malariabehandeling op grote schaal te produceren Doorbraak in satellietbeeldvorming verbetert het vermogen om plantengroei te meten

Doorbraak in satellietbeeldvorming verbetert het vermogen om plantengroei te meten Parker Solar Probe traceert zonnewind naar de bron op het oppervlak van de zon:coronale gaten

Parker Solar Probe traceert zonnewind naar de bron op het oppervlak van de zon:coronale gaten Complexe organische stoffen borrelen op uit de diepten van de oceaanwereld Enceladus

Complexe organische stoffen borrelen op uit de diepten van de oceaanwereld Enceladus Het klimaat in de toendra

Het klimaat in de toendra

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Portuguese | Swedish | German | Dutch | Danish | Norway | Spanish |

-

Wetenschap © https://nl.scienceaq.com