Wetenschap

3D-modellen bouwen van onbekende objecten terwijl ze door robots worden gemanipuleerd

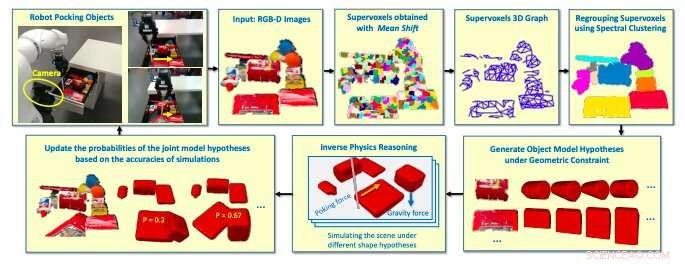

Workflow van het geïntegreerde systeem. Krediet:Song &Bouularias.

Onderzoekers van de Rutgers University hebben onlangs een probabilistische benadering ontwikkeld voor het bouwen van 3D-modellen van onbekende objecten terwijl ze worden gemanipuleerd door een robot. Hun aanpak, geschetst in een paper dat vooraf is gepubliceerd op arXiv, gebruikt een physics-engine om veronderstelde geometrieën in simulaties te verifiëren.

De meeste primaten leren van nature een verscheidenheid aan objecten te manipuleren in hun vroege levensjaren. Door deze schijnbaar triviale mogelijkheid in robots te repliceren, echter, is tot nu toe zeer uitdagend gebleken.

Eerdere studies hebben geprobeerd dit te bereiken met behulp van een verscheidenheid aan manipulatie-algoritmen, die doorgaans kennis vereisen van de geometrische modellen die horen bij de objecten die de robot gaat manipuleren. Deze modellen kunnen handig zijn als de objecten die de robot tegenkomt van tevoren bekend zijn, toch falen ze vaak wanneer deze objecten onbekend zijn.

"We beschouwen manipulatietaken specifiek in stapels rommel die voorheen onzichtbare objecten bevatten, " schreven de onderzoekers van de Rutgers University in hun paper. "Een van de nieuwe aspecten van dit werk is het gebruik van een fysica-engine voor het verifiëren van veronderstelde geometrieën in simulatie. Het bewijs geleverd door natuurkundige simulaties wordt gebruikt in een probabilistisch raamwerk dat verklaart dat de mechanische eigenschappen van de objecten onzeker zijn."

Het door de onderzoekers ontwikkelde geïntegreerde systeem bestaat uit verschillende componenten:een robotmanipulator, een segmentatie- en clusteringmodule, en een inverse fysieke redeneereenheid. De robotmanipulator is ontworpen om objecten in een stapel rommel te duwen of te porren, terwijl de segmentatie- en clustermodule objecten in RGB-D-beelden kan detecteren.

Eindelijk, de inverse fysieke redeneereenheid, dat is het onderscheidende kenmerk van hun aanpak, leidt ontbrekende delen van objecten af door de acties van de robot in simulatie opnieuw af te spelen. Eigenlijk, de eenheid gebruikt meerdere hypothetische vormen en kent hogere kansen toe aan de vormen die het beste overeenkomen met de waargenomen RGB-D-beelden.

De onderzoekers ontwikkelden een inverse physics reasoning (IPR) algoritme dat geoccludeerde delen van objecten kan afleiden op basis van hun waargenomen bewegingen en onderlinge interacties. Om hun systeem te trainen en te evalueren, ze gebruikten twee datasets:een Voxlets-dataset en een nieuwe dataset gemaakt met YCB-benchmarkobjecten. De Voxlets-dataset bevat statische afbeeldingen van tafelobjecten, terwijl de nieuwe database die door hen is samengesteld, dichtere stapels objecten bevat.

Het team evalueerde de nieuwe aanpak in een reeks experimenten met een Kuka-robotarm gemonteerd op een Clearpath mobiel platform en uitgerust met een Robotiq-hand- en dieptesensor. Bij deze testen de robot kreeg in verschillende scenario's onbekende objecten te zien. De bevindingen van de onderzoekers waren veelbelovend, met hun IPR-algoritme dat vormen beter afleidt dan andere benaderingen.

"Experimenten met een robot laten zien dat deze aanpak efficiënt is voor het construeren van fysiek realistische 3D-modellen, wat handig kan zijn voor manipulatieplanning, " schreven de onderzoekers. "Experimenten tonen ook aan dat de voorgestelde aanpak aanzienlijk beter presteert dan alternatieve benaderingen in termen van vormnauwkeurigheid."

De nieuwe probabilistische benadering van de onderzoekers zou kunnen helpen om de prestaties van robots bij manipulatietaken te verbeteren. In hun toekomstige werk, ze zijn van plan hun aanpak verder te ontwikkelen, zodat het tegelijkertijd 3-D en mechanische modellen kan afleiden.

© 2019 Wetenschap X Netwerk

Zeewater thuis repliceren

Zeewater thuis repliceren Nieuwe bio-geïnspireerde dynamische materialen transformeren zichzelf

Nieuwe bio-geïnspireerde dynamische materialen transformeren zichzelf Hoe een interesse in geneesmiddelen voor bipolaire stoornis leidde tot een beter begrip van leukemie

Hoe een interesse in geneesmiddelen voor bipolaire stoornis leidde tot een beter begrip van leukemie Hou je van een drankje? Japans team vindt houtalcohol uit

Hou je van een drankje? Japans team vindt houtalcohol uit Wetenschappers onthullen structuur van aminozuurtransporter die betrokken is bij kanker

Wetenschappers onthullen structuur van aminozuurtransporter die betrokken is bij kanker

Veranderingen in neerslagpatronen beïnvloeden natuurlijke selectie op wereldschaal

Veranderingen in neerslagpatronen beïnvloeden natuurlijke selectie op wereldschaal Wat maakt diamanten blauw? Boor uit oceanische korstresten in de onderste mantel van de aarde

Wat maakt diamanten blauw? Boor uit oceanische korstresten in de onderste mantel van de aarde Antimicrobiële resistentie in het milieu veroorzaakt door slecht beheerd stedelijk afvalwater

Antimicrobiële resistentie in het milieu veroorzaakt door slecht beheerd stedelijk afvalwater Orkaan Maria gaf ecologen een zeldzame kans om te bestuderen hoe tropische droge bossen zich herstellen

Orkaan Maria gaf ecologen een zeldzame kans om te bestuderen hoe tropische droge bossen zich herstellen Soorten Cyclonen

Soorten Cyclonen

Hoofdlijnen

- Wat maakt mensen gelukkiger -- objecten of ervaringen?

- Een plantenceldiagram maken

- Hands-on Science Activiteiten op Blood

- De Atlantische steuren verblijven

- Onderzoek naar klimaatverandering van de achteruitgang van de jongen van lederschildpadden levert geen antwoorden op

- Gentherapie kan kreupelheid bij paarden genezen, onderzoek vindt

- Hersenloos,

- Het verschil tussen glycolyse en gluconeogenese

- Hoe een biologisch diagram te tekenen

- Microsoft herziet hoe het wangedrag op kantoor onderzoekt

- Onderzoek naar gegevensprivacy centraal tijdens een evenement voor menselijke computerinteractie

- Google Maps voor tissues

- Bandbreedte voor alomtegenwoordige 5G en daarbuiten is misschien net om de hoek met dit nieuwe microsysteem

- Nissan bestrijdt EV-weggeluid met tralieval

Dupliceren of spiegelen? Laserlicht bepaalt chiraliteit van moleculen

Dupliceren of spiegelen? Laserlicht bepaalt chiraliteit van moleculen NASA vangt het 1-daagse leven van tropische cycloon Neil

NASA vangt het 1-daagse leven van tropische cycloon Neil Zonnebrand, genees uzelf:Exosoomtherapie kan een beter herstel van de zon mogelijk maken, door ouderdom beschadigde huid

Zonnebrand, genees uzelf:Exosoomtherapie kan een beter herstel van de zon mogelijk maken, door ouderdom beschadigde huid Goedkope techniek voor het etsen van nanogaten in silicium zou de basis kunnen vormen voor nieuwe filtratie- en nanofotonische apparaten

Goedkope techniek voor het etsen van nanogaten in silicium zou de basis kunnen vormen voor nieuwe filtratie- en nanofotonische apparaten Wetenschap in wetenschapscommunicatie zetten

Wetenschap in wetenschapscommunicatie zetten Nieuwe baanbrekende ontdekking:elk kwantumdeeltje reist achteruit

Nieuwe baanbrekende ontdekking:elk kwantumdeeltje reist achteruit Wat het veranderende klimaat van de aarde ons kan leren over het veranderen van het oppervlak van Mars

Wat het veranderende klimaat van de aarde ons kan leren over het veranderen van het oppervlak van Mars Hoe een driedimensionale Atom

Hoe een driedimensionale Atom

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Swedish | Dutch | Danish | Norway | Spanish | Portuguese | German |

-

Wetenschap © https://nl.scienceaq.com