Wetenschap

Team ontwikkelde technieken om duizenden uren NASA-tape te analyseren

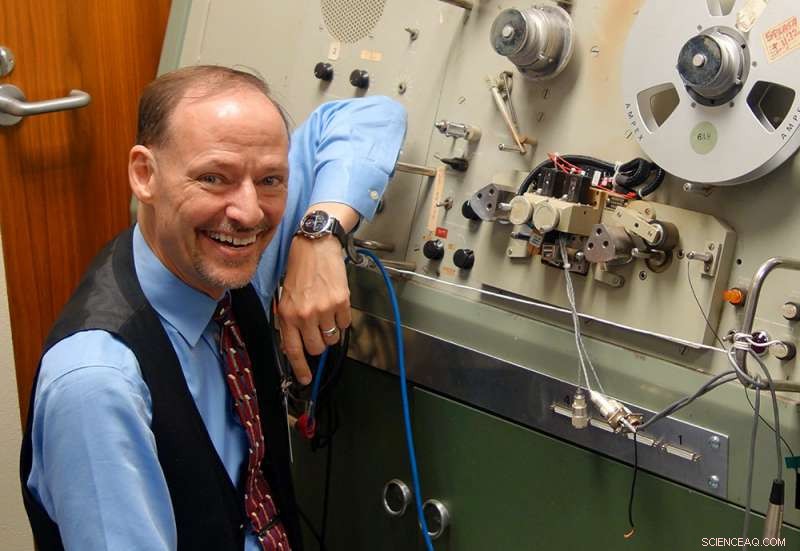

Van links:Dr. John H.L. Hansen, Chengzhu Yu PhD'17, Dr. Abhijeet Sangwan en Lakshmish Kaushik poseren met een model van een astronaut in het NASA Johnson Space Center in Houston. De vier hielden toezicht op het project om spraakverwerkingstechnieken te ontwikkelen om duizenden uren audio van NASA's maanmissies te reconstrueren en te transformeren. Krediet:de Universiteit van Texas in Dallas

NASA heeft duizenden uren audio opgenomen van de Apollo-maanmissies, toch hebben de meesten van ons alleen de hoogtepunten kunnen horen.

Het bureau registreerde alle communicatie tussen de astronauten, missiecontrolespecialisten en ondersteunend personeel in de achterkamer tijdens de historische maanmissies naast de beroemde citaten van Neil Armstrong uit Apollo 11 in juli 1969.

De meeste audio bleef tientallen jaren opgeslagen op verouderde analoge banden totdat onderzoekers van de Universiteit van Texas in Dallas een project lanceerden om de audio te analyseren en toegankelijk te maken voor het publiek.

Onderzoekers van het Center for Robust Speech Systems (CRSS) aan de Erik Jonsson School of Engineering and Computer Science (ECS) ontvingen in 2012 een National Science Foundation-beurs om spraakverwerkingstechnieken te ontwikkelen om het enorme audioarchief te reconstrueren en om te zetten in Explore Apollo , een website die openbare toegang tot de materialen biedt. Het project, in samenwerking met de Universiteit van Maryland, inclusief audio van heel Apollo 11 en het grootste deel van Apollo 13, Apollo 1 en Gemini 8 missies.

Een gigantische technologische sprong

Het transcriberen en reconstrueren van het enorme audioarchief zou een enorme sprong in spraakverwerking en taaltechnologie vergen. de communicatie werd vastgelegd op meer dan 200 analoge banden van 14 uur, elk met 30 audiotracks. De oplossing zou communicatie moeten ontcijferen met onleesbare spraak, technische storing en overlappende audioloops. Stel je voor dat Siri van Apple probeert om discussies te transcriberen te midden van willekeurige onderbrekingen en maar liefst 35 mensen op verschillende locaties, vaak sprekend met regionale Texaanse accenten.

Het project, onder leiding van CRSS-oprichter en directeur Dr. John H.L. Hansenand-onderzoeker Dr. Abhijeet Sangwan, inclusief een team van promovendi die werkten om oplossingen te vinden om de audio te digitaliseren en te organiseren. Ze ontwikkelden ook algoritmen om te verwerken, herkennen en analyseren van de audio om te bepalen wie wat heeft gezegd en wanneer. De algoritmen worden beschreven in het novembernummer van IEEE/ACM-transacties op audio, Toespraak, en taalverwerking .

Zeven niet-gegradueerde senior ontwerpteams onder toezicht van het CRSS hielpen bij het creëren van Explore Apollo om de informatie openbaar toegankelijk te maken. Het project kreeg ook hulp van het Science and Engineering Education Center (SEEC) van de universiteit, die de Explore Apollo-site evalueerde.

Vijf jaar later, het team voltooit zijn werk, wat heeft geleid tot technologische vooruitgang om spraak om te zetten in tekst, sprekers analyseren en begrijpen hoe mensen hebben samengewerkt om de missies te volbrengen.

"CRSS heeft aanzienlijke vooruitgang geboekt op het gebied van machinaal leren en kennisextractie om menselijke interactie te beoordelen voor een van de meest uitdagende technische taken in de geschiedenis van de mensheid, " zei Hansen, associate dean voor onderzoek in ECS, hoogleraar elektrotechniek en computertechniek, hoogleraar aan de School of Behavioural and Brain Sciences, en Distinguished Chair in Telecommunicatie. Retro-apparatuur verfijnen

Toen ze met hun werk begonnen, onderzoekers ontdekten dat ze eerst de audio moesten digitaliseren. Het overbrengen van de audio naar een digitaal formaat bleek op zich al een technisch hoogstandje te zijn. De enige manier om de rollen te spelen was op een apparaat uit de jaren 60 in het NASA Johnson Space Center in Houston, een SoundScriber genaamd.

"NASA wees ons op de SoundScriber en zei:doe wat je moet doen, ' zei Hansen.

Dr. John H.L. Hansen staat naast de SoundScriber, het enige apparaat dat de analoge opnames van duizenden uren communicatie tijdens NASA's maanmissies kon afspelen. Krediet:de Universiteit van Texas in Dallas

Het apparaat kon slechts één track tegelijk lezen. De gebruiker moest mechanisch een hendel draaien om de leeskop van de band van het ene spoor naar het andere te verplaatsen. Volgens de schatting van Hansen het zou minstens 170 jaar duren om alleen de audio van de Apollo 11-missie te digitaliseren met behulp van de technologie.

"We konden dat systeem niet gebruiken, dus moesten we een nieuwe ontwerpen, "Zei Hansen. "We hebben onze eigen leeskop met 30 sporen ontworpen, en bouwde een parallelle oplossing om alle 30 tracks in één keer vast te leggen. Dit is de enige oplossing die er op aarde bestaat."

De nieuwe leeskop bracht het digitaliseringsproces terug van jaren naar maanden. Die taak werd de taak van Tuan Nguyen, een senior biomedische technologie die een semester in Houston heeft gewerkt.

Stemmen van helden achter de helden versterken

Nadat ze de audio van de rollen naar digitale bestanden hadden overgebracht, onderzoekers moesten software maken die spraakactiviteit kon detecteren, inclusief het volgen van elke persoon die aan het woord is en wat ze zeiden en wanneer, een proces dat diarisatie wordt genoemd. Ze moesten ook sprekerkenmerken volgen om onderzoekers te helpen analyseren hoe mensen reageren in gespannen situaties. In aanvulling, de banden bevatten audio van verschillende kanalen die in chronologische volgorde moesten worden geplaatst.

De onderzoekers die aan het project werkten, zeiden dat een van de meest uitdagende onderdelen was om uit te zoeken hoe de dingen bij NASA werkten tijdens de missies, zodat ze konden begrijpen hoe ze de enorme hoeveelheid audio konden reconstrueren.

"Dit is niet iets dat je in een klas kunt leren, " zei Chengzhu Yu PhD'17. Yu begon zijn doctoraatsprogramma bij de start van het project en studeerde afgelopen voorjaar af. Nu, hij werkt als onderzoekswetenschapper die zich richt op spraakherkenningstechnologie in het onderzoekscentrum voor kunstmatige intelligentie van Tencent in Seattle.

Lakshmish Kaushik, een promovendus die een vorige baan heeft verlaten om aan het project te werken, wil ook zijn carrière wijden aan spraakherkenningstechnologie. Zijn rol was om algoritmen te ontwikkelen die de reeks stemmen op meerdere kanalen onderscheiden.

"De afgelopen vier jaar waren echt opwindend, ' zei Kaushik.

Het team heeft de interactieve website gedemonstreerd in het Perot Museum of Nature and Science in Dallas. voor Hansen, het project was een kans om het werk te belichten van de vele mensen die betrokken zijn bij de maanmissies buiten de astronauten.

"Als je aan Apollo denkt, we voelen ons aangetrokken tot de enorme bijdragen van de astronauten die duidelijk onze lof en bewondering verdienen.

Echter, de helden achter de helden vertegenwoordigen de talloze ingenieurs, wetenschappers en specialisten die hun STEM-ervaring gezamenlijk hebben samengebracht om het succes van het Apollo-programma te verzekeren, "Zei Hansen. "Laten we hopen dat studenten vandaag hun ervaring in STEM-gebieden blijven inzetten om de uitdagingen van morgen aan te gaan."

Een nieuwe katalysator met één atoom kan in uitzonderlijke snelheid waterstof produceren uit ureum

Een nieuwe katalysator met één atoom kan in uitzonderlijke snelheid waterstof produceren uit ureum Een vereenvoudigd nieuw proces zet houtafval uit landbouw en bosbeheer om in ethanol

Een vereenvoudigd nieuw proces zet houtafval uit landbouw en bosbeheer om in ethanol Wetenschappers ontwikkelen milieuvriendelijke pollenspons om waterverontreinigingen aan te pakken

Wetenschappers ontwikkelen milieuvriendelijke pollenspons om waterverontreinigingen aan te pakken Kunstblad als minifabriek voor medicijnen

Kunstblad als minifabriek voor medicijnen ORNL onderzoekt complexe uraniumoxiden met hulp van CADES-bronnen

ORNL onderzoekt complexe uraniumoxiden met hulp van CADES-bronnen

Lang, koude winter heeft geen invloed op het vuurseizoen, zegt expert

Lang, koude winter heeft geen invloed op het vuurseizoen, zegt expert Nieuwe factor in de koolstofcyclus van de Zuidelijke Oceaan geïdentificeerd

Nieuwe factor in de koolstofcyclus van de Zuidelijke Oceaan geïdentificeerd Bodemwetenschappers gebruiken mijnafval om door mensen veroorzaakte woestenij te herstellen

Bodemwetenschappers gebruiken mijnafval om door mensen veroorzaakte woestenij te herstellen Bacteriën kunnen de toekomst van afvalwaterzuivering een boost geven

Bacteriën kunnen de toekomst van afvalwaterzuivering een boost geven Amazonische jagers putten dieren in het wild uit, maar maken geen bossen leeg

Amazonische jagers putten dieren in het wild uit, maar maken geen bossen leeg

Hoofdlijnen

- Hoe hebben Watson en Crick baseparing bepaald?

- Nieuwe studie wijst op onverwachte voordelen van rabiësvaccinatie bij honden

- Probeer deze 5 dagelijkse gewoonten om je leven dit jaar te verbeteren

- VN schotelt vijgcactus voor als antwoord op voedselzekerheid

- Zijn er evolutionaire wortels voor menselijke obesitas?

- Is schizofrenie samen met onze hersenen geëvolueerd?

- Interessante feiten over plantencellen

- Grote katten in Groot-Brittannië - stedelijke mythe of wetenschappelijk feit?

- Wetenschappers volgen haaien die DNA-fragmenten uit de zee plukken

- Nog een klap voor de interpretatie van donkere materie van de overmaat aan galactische centra

- Wetenschappers twijfelen aan veronderstellingen over planeetvorming

- Hoe gaan we andere planeten koloniseren?

- Team legt gegevens vast van de lancering van de ongewapende Minuteman III-test

- Burger zoekt nieuwe planeet in zonnestelsel

Begrijpen hoe planten zonlicht gebruiken

Begrijpen hoe planten zonlicht gebruiken Onderzoekers gaan uitdagingen aan op het gebied van optica en gegevensoverdracht met 3D-geprinte lens

Onderzoekers gaan uitdagingen aan op het gebied van optica en gegevensoverdracht met 3D-geprinte lens 4D-terugprojectiemethode onthult seismische activiteit die in 2015 in de onderste mantel begon

4D-terugprojectiemethode onthult seismische activiteit die in 2015 in de onderste mantel begon Welke soorten materialen worden gebruikt om Obsidiaan te snijden?

Welke soorten materialen worden gebruikt om Obsidiaan te snijden?  Duitse kruisboog YouTuber vecht videogigant voor rechten

Duitse kruisboog YouTuber vecht videogigant voor rechten Deeltjes verzameld door Hayabusa geven absolute leeftijd van asteroïde Itokawa

Deeltjes verzameld door Hayabusa geven absolute leeftijd van asteroïde Itokawa Een lange rit:50 jaar geleden, een generale repetitie voor de maanlanding

Een lange rit:50 jaar geleden, een generale repetitie voor de maanlanding Canada, VS proberen de afhankelijkheid van China voor zeldzame aardmineralen te verminderen

Canada, VS proberen de afhankelijkheid van China voor zeldzame aardmineralen te verminderen

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Portuguese | Swedish | German | Dutch | Danish | Norway | Spanish |

-

Wetenschap © https://nl.scienceaq.com