Wetenschap

Nieuwe machine learning-techniek voor het simuleren van de dagelijkse taak van aankleden

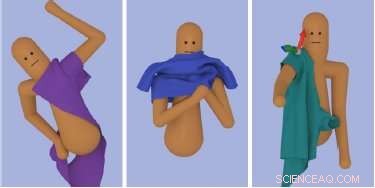

Computerwetenschappers van het Georgia Institute of Technology en Google Brain, Google's onderzoeksafdeling voor kunstmatige intelligentie, hebben een nieuwe rekenmethode ontwikkeld, gedreven door machine learning technieken, om met succes en realistisch het meerstapsproces van het aantrekken van kleding te simuleren. Krediet:SIGGRAPH Azië

Het aantrekken van kleding is een dagelijkse, alledaagse taak die de meesten van ons met weinig of geen nadenken uitvoeren. We mogen nooit rekening houden met de meerdere stappen en fysieke bewegingen die erbij komen kijken als we ons 's ochtends aankleden. Maar dat is precies wat onderzocht moet worden bij het vastleggen van de beweging van het aankleden en het simuleren van kleding voor computeranimatie.

Computerwetenschappers van het Georgia Institute of Technology en Google Brain, Google's onderzoeksafdeling voor kunstmatige intelligentie, hebben een nieuwe rekenmethode ontwikkeld, gedreven door machine learning technieken, om met succes en realistisch het meerstapsproces van het aantrekken van kleding te simuleren. Wanneer ontleed, de taak van aankleden is vrij complex, en omvat verschillende fysieke interacties tussen het personage en zijn of haar kleding, voornamelijk geleid door de tastzin van de persoon.

Het maken van animaties van een personage dat kleding aantrekt is een uitdaging vanwege de complexe interacties tussen het personage en het gesimuleerde kledingstuk. Het meeste werk in zeer beperkte karakteranimatie houdt zich bezig met statische omgevingen die niet erg reageren op de beweging van het karakter, merkt de onderzoekers op. In tegenstelling tot, kleding kan direct en drastisch reageren op kleine veranderingen in de lichaamshouding; kleding heeft de neiging om te vouwen, vasthouden en vasthouden aan het lichaam, haptisch maken, of aanrakingssensatie, essentieel voor de taak.

Een andere unieke uitdaging bij aankleden is dat het personage een langdurige reeks bewegingen moet uitvoeren met een diverse reeks subtaken, zoals het vastpakken van de voorste laag van een shirt, een hand in de opening van het shirt steken en een hand door een mouw duwen.

"Aankleden lijkt voor velen van ons gemakkelijk omdat we het elke dag oefenen. In werkelijkheid, de dynamiek van stof maakt het erg uitdagend om vanaf het begin te leren hoe je je moet kleden, " zegt Alexander Clegg, hoofdauteur van het onderzoek en een informatica Ph.D. student aan het Georgia Institute of Technology. "We gebruiken simulatie om een neuraal netwerk te leren deze complexe taken uit te voeren door de taak op te splitsen in kleinere stukjes met goed gedefinieerde doelen, waardoor het personage de taak duizenden keren kan proberen en belonings- of strafsignalen geeft wanneer het personage gunstige of nadelige veranderingen in zijn beleid probeert."

De methode van de onderzoekers werkt vervolgens het neurale netwerk stap voor stap bij om de ontdekte positieve veranderingen in de toekomst waarschijnlijker te maken. "Op deze manier, we leren het personage hoe te slagen in de taak, " merkt Clegg op.

Clegg en zijn medewerkers bij Georgia Tech zijn onder meer computerwetenschappers Wenhao Yu, Greg Turk en Karen Liu. Samen met Google Brain-onderzoeker Jie Tan, de groep zal hun werk presenteren op SIGGRAPH Asia 2018 in Tokyo van 4 december tot 7 december. De jaarlijkse conferentie bevat de meest gerespecteerde technische en creatieve leden op het gebied van computergraphics en interactieve technieken, en toont toonaangevend onderzoek in de wetenschap, kunst, gamen en animatie, onder andere sectoren.

In dit onderzoek, demonstreerden de onderzoekers hun aanpak bij verschillende aankleedtaken:een t-shirt aantrekken, het aandoen van een jas en robotgeassisteerd aankleden van een mouw. Met het getrainde neurale netwerk, ze waren in staat om complexe re-enactment te bereiken van verschillende manieren waarop een geanimeerd personage kleding aantrekt. De sleutel is om de tastzin in hun raamwerk op te nemen om de uitdagingen in doeksimulatie te overwinnen. De onderzoekers ontdekten dat een zorgvuldige selectie van de doekobservaties en de beloningsfuncties in hun getrainde netwerk cruciaal zijn voor het succes van het raamwerk. Als resultaat, deze nieuwe benadering maakt niet alleen enkele aankleedsequenties mogelijk, maar maakt ook een personagecontroller mogelijk die zich onder verschillende omstandigheden met succes kan aankleden.

"We hebben de deur geopend naar een nieuwe manier om meerstapsinteractietaken in complexe omgevingen te animeren met behulp van versterkend leren, "zegt Clegg. "Er is nog veel werk aan de winkel om op deze weg voort te gaan, waardoor simulatie ervaring en oefening kan bieden voor taaktraining in een virtuele wereld." Bij het uitbreiden van dit werk, het team werkt momenteel samen met andere onderzoekers in het Healthcare Robotics-lab van Georgia Tech om de toepassing van robotica voor hulp bij het aankleden te onderzoeken.

Realisatie van kleurfiltervrije beeldsensoren

Realisatie van kleurfiltervrije beeldsensoren Ideeën voor schoolreizen voor de middelbare school Scheikunde

Ideeën voor schoolreizen voor de middelbare school Scheikunde Ladingsverandering:hoe elektrische krachten variëren in colloïden

Ladingsverandering:hoe elektrische krachten variëren in colloïden Onderzoekers halen natuurlijk voorkomende melanine op grote schaal uit paddenstoelen

Onderzoekers halen natuurlijk voorkomende melanine op grote schaal uit paddenstoelen Hoe beïnvloeden stromingskrachten van geladen oppervlakken/deeltjes en oppervlakteactieve stoffen in vloeistoffen?

Hoe beïnvloeden stromingskrachten van geladen oppervlakken/deeltjes en oppervlakteactieve stoffen in vloeistoffen?

Korstmossen die leven in de toendra

Korstmossen die leven in de toendra  Wat zijn goede protisten?

Wat zijn goede protisten?  Soorten mariene groei

Soorten mariene groei

Universeel gesproken zou "mariene groei" verwijzen naar al het leven in de oceaan, inclusief waterplanten, schaaldieren, vissen en in het water levende zoogdieren zoals walvissen. Binnen de scheepvaartindustrie is 'mariene gro

Badlands in New Mexico helpen onderzoekers om lavastromen uit het verleden van Mars te begrijpen

Badlands in New Mexico helpen onderzoekers om lavastromen uit het verleden van Mars te begrijpen Team ondersteund door mede-oprichter van Microsoft lokaliseert wrak USS Helena

Team ondersteund door mede-oprichter van Microsoft lokaliseert wrak USS Helena

Hoofdlijnen

- Woordproblemen schrijven voor Math

- Dominante fysische genen in Humans

- Cytoskeleton: definitie, structuur en functie (met diagram)

- Opnieuw geïntroduceerde buideldieren kunnen een nieuwe bedreiging vormen voor op de grond levende vogels

- Het Mandela-effect:waarom we ons gebeurtenissen herinneren die niet hebben plaatsgevonden

- Celfysiologie: een overzicht van structuur, functie en gedrag

- Hoeveel calorieën verbrand ik als ik lach?

- De voordelen van het gebruik van Sticky End Enzymen

- Nieuwe mierenvogelsoort ontdekt in Peru

- Verticale landbouw in Dubai om dorst naar eigen toeleveringsketen te lessen

- Uit peiling blijkt dat vrouwen zich meer zorgen maken over het verliezen van banen door handel en offshoring dan kunstmatige intelligentie

- Chinas Baidu rolt zelfrijdende bussen uit

- Van datingdeelnemers tot rouwende weduwen, Facebook zet zwaar in op entertainment, maar zullen mensen kijken?

- Digitale atletiek in analoge stadions

Onderzoek toont aan dat de Falklandeilanden potentieel CO2-negatief kunnen worden

Onderzoek toont aan dat de Falklandeilanden potentieel CO2-negatief kunnen worden Op maat gemaakte kunstmatige parelmoer

Op maat gemaakte kunstmatige parelmoer Herziening van microfinancieringsstudies vindt veel gebreken, geen conclusies

Herziening van microfinancieringsstudies vindt veel gebreken, geen conclusies Grootste genetische studie van muggen onthult verspreiding van resistentie tegen insecticiden in Afrika

Grootste genetische studie van muggen onthult verspreiding van resistentie tegen insecticiden in Afrika De eerste ooit foto van een zwart gat is een ENORME Deal

De eerste ooit foto van een zwart gat is een ENORME Deal  De oude kunst van kirigami inspireert een nieuwe klasse materialen

De oude kunst van kirigami inspireert een nieuwe klasse materialen Stropers richten zich op Afrikaanse leeuwen, gieren met vergif

Stropers richten zich op Afrikaanse leeuwen, gieren met vergif Purdue drug discovery is gericht op het vinden van betere medicijnen, vermijd medicatietragedies zoals thalidomide

Purdue drug discovery is gericht op het vinden van betere medicijnen, vermijd medicatietragedies zoals thalidomide

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway | French |

-

Wetenschap © https://nl.scienceaq.com