Wetenschap

Lab bestudeert technologie die via aanraking communiceert

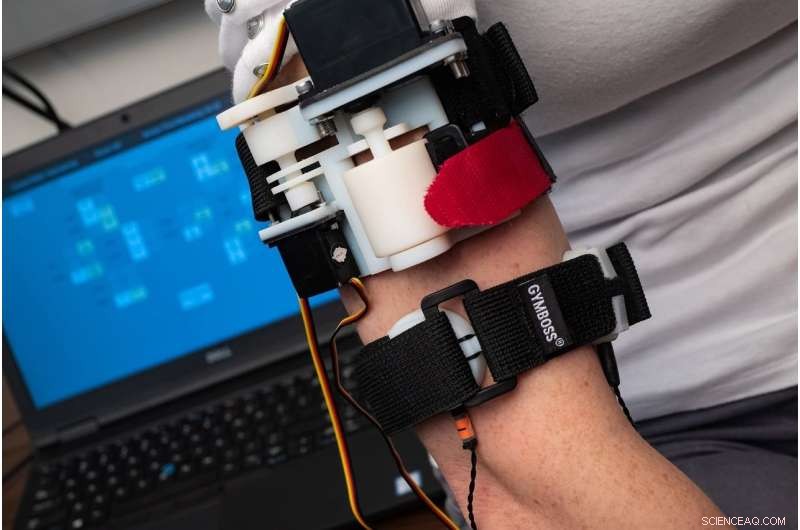

Een nieuwe studie door onderzoekers van het Mechatronics and Haptic Interfaces Laboratory van Rice University wees uit dat gebruikers minder dan twee uur training nodig hadden om de meeste woorden te leren "voelen" die werden verzonden door een haptische armband die communiceert met signalen die bestaan uit knijpen, rekken en trillen. Krediet:Jeff Fitlow/Rice University

Stel je de paniek voor. Brandalarmen loeien. Rook vult de kamer, en je blijft alleen achter met de tastzin, wanhopig langs muren terwijl je probeert de deuropening te vinden.

Stel je nu eens voor dat technologie je begeleidt door middel van tastzin. Uw smartwatch, gealarmeerd door dezelfde alarmen, begint te "spreken" door je huid, aanwijzingen geven met gecodeerde trillingen, knijpt en trekt met betekenissen zo duidelijk als gesproken woorden.

Dat scenario zou zich in de toekomst kunnen afspelen dankzij de technologie die in ontwikkeling is in het laboratorium van Rice werktuigbouwkundig ingenieur Marcia O'Malley, die meer dan 15 jaar heeft bestudeerd hoe mensen haptische zintuigen kunnen gebruiken om met technologie om te gaan, of het nu robots, prothetische ledematen of beroerte-revalidatiesoftware.

"De huid bedekt ons hele lichaam en bevat vele soorten receptoren, en we zien dat als een onderbenut informatiekanaal, " zei O'Malley, directeur van het Rice Robotics Initiative en Rice's Mechatronics and Haptic Interfaces Laboratory (MAHI).

Noodsituaties zoals het hierboven beschreven brandscenario zijn slechts een voorbeeld. O'Malley zei dat er veel "andere situaties zijn waarin je misschien niet naar een scherm wilt kijken, of je hebt al veel dingen visueel weergegeven. Bijvoorbeeld, een chirurg of een piloot kan het erg handig vinden om een ander communicatiekanaal te hebben."

Rice University afgestudeerde student Nathan Dunkelberger aan het werk in het MAHI-lab. Krediet:Jeff Fitlow/Rice University

Met nieuwe financiering van de National Science Foundation, Allison Okamura, een medewerker van O'Malley en Stanford University, zal binnenkort beginnen met het ontwerpen en testen van zachte, draagbare apparaten die directe op aanraking gebaseerde communicatie van nabijgelegen robots mogelijk maken. de financiering, die mogelijk wordt gemaakt door het National Robotics Initiative, is gericht op het ontwikkelen van nieuwe vormen van communicatie die visuele rommel en ruis omzeilen om snel en duidelijk te communiceren.

"Sommige magazijnen en fabrieken hebben al meer robots dan menselijke arbeiders, en technologieën zoals zelfrijdende auto's en fysiek ondersteunende apparaten zullen de interactie tussen mens en robot in de nabije toekomst veel gebruikelijker maken, " zei O'Malley, Rice's Stanley C. Moore hoogleraar werktuigbouwkunde en hoogleraar informatica en elektrotechniek en computertechniek.

Zacht, draagbare apparaten kunnen deel uitmaken van een uniform, als een mouw, handschoen, horlogeband of riem. Door een reeks haptische signalen af te geven, zoals hard of zacht knijpen, of een stuk van de huid in een bepaalde richting en plaats, O'Malley zei dat het mogelijk zou kunnen zijn om een significante "vocabulaire" op te bouwen van sensaties die specifieke betekenissen hebben.

"Ik zie de richtingaanwijzer van een auto, maar alleen als ik ernaar kijk, " O'Malley zei. "We willen technologie waarmee mensen de robots om hen heen kunnen voelen en duidelijk kunnen begrijpen wat die robots gaan doen en waar ze op het punt staan te zijn. Ideaal, als we dit goed doen, de aanwijzingen zullen gemakkelijk te leren en intuïtief zijn."

Rice University afgestudeerde studenten Jenny Sullivan (links) en Nathan Dunkelberger demonstreren de MISSIVE haptische armband in het Mechatronics and Haptic Interfaces Laboratory. Krediet:Jeff Fitlow/Rice University

Bijvoorbeeld, in een studie die deze maand werd gepresenteerd op het International Symposium on Wearable Computers (ISWC) in Singapore, MAHI-afgestudeerde student Nathan Dunkelberger toonde aan dat gebruikers minder dan twee uur training nodig hadden om de meeste woorden te leren "voelen" die werden verzonden door een haptische armband. De door MAHI ontwikkelde "multi-sensorische interface van stretch, knijp en geïntegreerde vibrotactiele elementen, " of MISSIEVE, bestaat uit twee banden die om de bovenarm passen. Een van deze kan zachtjes knijpen, als een bloeddrukmanchet, en kan de huid ook lichtjes in één richting uitrekken of trekken. De tweede band heeft vibrotactiele motoren - dezelfde trilalarmen die in de meeste mobiele telefoons worden gebruikt - aan de voorkant, rug, linker- en rechterkant van de arm.

Door deze signalen in combinatie te gebruiken, MAHI creëerde een vocabulaire van 23 van de meest voorkomende vocale geluiden voor Engelstaligen. Deze geluiden, die fonemen worden genoemd, worden in combinatie gebruikt om woorden te maken. Bijvoorbeeld, de woorden "ouch" en "chow" bevatten dezelfde twee fonemen, "ow" en "ch, " in andere volgorde. O'Malley zei dat communiceren met fonemen sneller is dan het letter voor letter spellen van woorden, en proefpersonen hoeven niet te weten hoe een woord gespeld is, alleen hoe het wordt uitgesproken.

Dunkelberger zei dat Engelstaligen 39 fonemen gebruiken, maar voor de proof-of-concept-studie, hij en collega's van MAHI gebruikten 23 van de meest voorkomende. Bij testen, proefpersonen kregen een beperkte training - slechts 1 uur, 40 minuten - waarbij je het gesproken foneem hoorde terwijl je het ook voelde weergegeven door MISSIVE. Bij latere proeven proefpersonen werden gevraagd om 150 gesproken woorden te identificeren die elk uit twee tot zes fonemen bestonden. De getesten hadden 86 procent van de woorden correct.

"Wat dit laat zien, is dat het mogelijk is, met een beperkte opleiding, om mensen een kleine woordenschat te leren die ze zich met grote nauwkeurigheid kunnen herinneren, " zei O'Malley. "En er zijn zeker dingen die we zouden kunnen optimaliseren. We kunnen de signalen opvallender maken. We kunnen het trainingsprotocol verfijnen. Dit was onze prototype-aanpak, en het werkte vrij goed."

In het NSF-project ze zei dat het team zich niet zal concentreren op het overbrengen van woorden, maar het overbrengen van non-verbale informatie.

"Er zijn veel potentiële toepassingen voor draagbare haptische feedbacksystemen om communicatie tussen individuen mogelijk te maken, tussen individuen en robots of tussen individuen en virtuele agenten zoals Google maps, "Zei O'Malley. "Stel je een smartwatch voor die een hele taal van signalen rechtstreeks aan je kan overbrengen, en privé, zodat je helemaal niet naar je scherm hoeft te kijken."

Studie van zirkoonkristallen doet twijfel rijzen over bewijs voor vroege ontwikkeling van magnetisch veld

Studie van zirkoonkristallen doet twijfel rijzen over bewijs voor vroege ontwikkeling van magnetisch veld Top 5 energiezuinige computers

Top 5 energiezuinige computers  Wetenschappers verfijnen profiel van een schimmelboommoordenaar

Wetenschappers verfijnen profiel van een schimmelboommoordenaar Grondwaterafvoer beïnvloedt de waterkwaliteit in kustwateren

Grondwaterafvoer beïnvloedt de waterkwaliteit in kustwateren Onderzoek toont aan dat het verlies van tropisch bos wordt vergroot door grootschalige landaankopen

Onderzoek toont aan dat het verlies van tropisch bos wordt vergroot door grootschalige landaankopen

Hoofdlijnen

- Inleiding tot hoe gigantische virussen werken

- Het verschil tussen een sporofyt en gametofyt

- Projectideeën voor biotechnologie

- Correct gebruikte neonaten hebben geen nadelige invloed op bijenvolken, nieuwe onderzoeksresultaten

- Deze dans wordt uitgevoerd:honderden mannelijke kikkersoorten veranderen van kleur rond de paringstijd

- Luipaarden doden minstens 3 kinderen op het Indiase platteland

- De genetische handtekening van de zeeschelp lezen

- Op pinguïn gemonteerde video legt gastronomische ontmoetingen van het gelatineuze soort vast

- Wat zijn enkele kenmerken van DNA?

- Nieuwe tool stroomlijnt het maken van bewegende beelden

- Computerwetenschappers maken programmeerbaar zelfassemblerend DNA

- Kleine binnenkassen laten appartementsbewoners groenten verbouwen

- Insiders op rolletjes met de YourPhone-app voor Windows 10

- Renault zegt dat het bestuur dinsdag bijeenkomt om te reageren op het bod van Fiat Chrysler

Grafeen ontladen en moleculaire afscherming

Grafeen ontladen en moleculaire afscherming In een uitgebreide nieuwe test, de EmDrive genereert geen stuwkracht

In een uitgebreide nieuwe test, de EmDrive genereert geen stuwkracht Koolstof uit de lucht halen

Koolstof uit de lucht halen Datalek onthult persoonlijke informatie van duizenden LAPD-officieren en sollicitanten

Datalek onthult persoonlijke informatie van duizenden LAPD-officieren en sollicitanten De zonnecorona verwarmen

De zonnecorona verwarmen een 50, 000-jarige geschiedenis van de huidige stroom levert nieuwe klimaataanwijzingen op

een 50, 000-jarige geschiedenis van de huidige stroom levert nieuwe klimaataanwijzingen op Een blik op 377 metro's:kunnen lokale voedselproducten voldoen aan de lokale vraag van huishoudens?

Een blik op 377 metro's:kunnen lokale voedselproducten voldoen aan de lokale vraag van huishoudens? Gloeiende zandduinerosie aan de kant van de Mars Kaiser Crater

Gloeiende zandduinerosie aan de kant van de Mars Kaiser Crater

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com