Wetenschap

BinaryGAN:een generatief vijandig netwerk met binaire neuronen

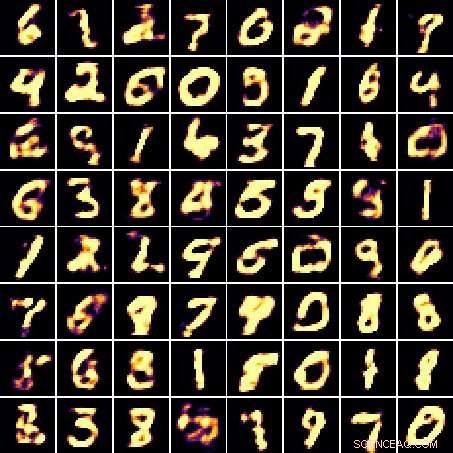

Voorgeactiveerde uitgangen (d.w.z. de echt gewaardeerde, tussenliggende waarden vlak voor de binarisatiebewerking; zie paragraaf 2.2) voor het voorgestelde model geïmplementeerd door MLP's en getraind met de WGAN-GP-doelstelling. Voorgesteld model met DBN's (voorgeactiveerd). Krediet:Dong en Yang.

Onderzoekers van het onderzoekscentrum voor IT-innovatie van Academia Sinica, in Taiwan, hebben onlangs een nieuw generatief adversarial netwerk (GAN) ontwikkeld met binaire neuronen aan de uitgangslaag van de generator. Dit model, gepresenteerd in een paper dat vooraf is gepubliceerd op arXiv, kan direct voorspellingen met binaire waarden genereren op testtijd.

Tot dusver, GAN-benaderingen hebben opmerkelijke resultaten opgeleverd bij het modelleren van continue distributies. Niettemin, het toepassen van GAN's op discrete gegevens was tot nu toe enigszins uitdagend, met name vanwege problemen bij het optimaliseren van de modeldistributie naar de doeldatadistributie in een hoogdimensionale discrete ruimte.

Hao-Wen Dong, een van de onderzoekers die het onderzoek heeft uitgevoerd, vertelde Tech Xplore , "Ik werk momenteel aan het genereren van muziek in het Music and AI Lab van Academia Sinica. Naar mijn mening, componeren kan worden geïnterpreteerd als een reeks beslissingen, bijvoorbeeld wat betreft de instrumentatie, akkoorden en zelfs de exacte noten die u moet gebruiken. Om de grootse visie van een solide AI-componist te bereiken, Ik ben vooral geïnteresseerd in de vraag of diepe generatieve modellen zoals GAN's in staat zijn om beslissingen te nemen. Daarom, dit werk onderzocht of we een GAN kunnen trainen die binaire neuronen gebruikt om binaire beslissingen te nemen met behulp van backpropagation, het standaard trainingsalgoritme."

Dong en zijn adviseur Yi-Hsuan Yang ontwikkelden een model dat tijdens de test direct voorspellingen met binaire waarden kan genereren. Vervolgens gebruikten ze het om binaire MNIST-cijfers te genereren en de prestaties van verschillende soorten binaire neuronen te vergelijken, GAN-doelstellingen en netwerkarchitecturen.

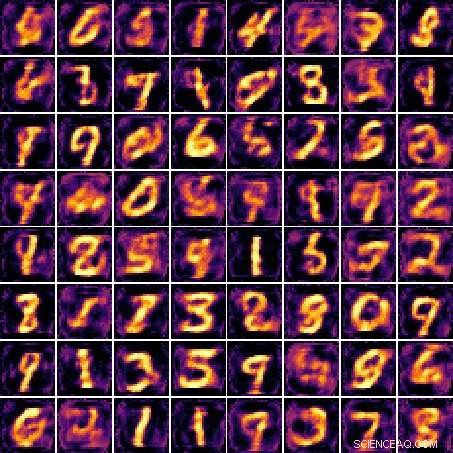

Voorbeeld gegenereerde cijfers en vooraf geactiveerde uitgangen (d.w.z. de echt gewaardeerde, tussenliggende waarden vlak voor de binarisatiebewerking; zie paragraaf 2.2) voor het voorgestelde model geïmplementeerd door MLP's en getraind met de WGAN-GP-doelstelling. Voorgesteld model met SBN's (vooraf geactiveerd). Krediet:Dong en Yang.

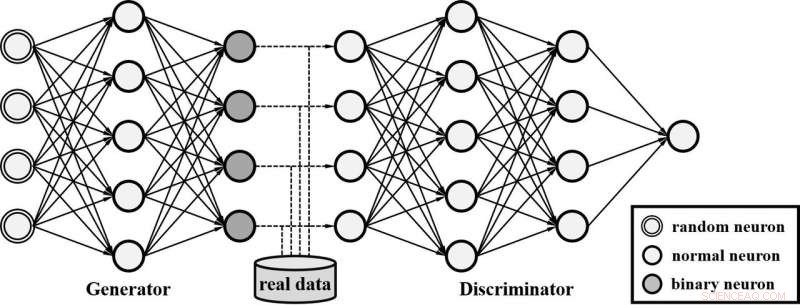

"In een notendop, BinaryGAN is een GAN dat binaire neuronen aanneemt, neuronen die ofwel een één of een nul uitvoeren, aan de uitgangslaag van de generator, Dong zei. "Een GAN heeft twee hoofdcomponenten:de generator en de discriminator. De generator is bedoeld om nepgegevensmonsters te produceren die de discriminator voor de gek kunnen houden door gegenereerde monsters als echt te classificeren. Anderzijds, het doel van de discriminator is om valse van echte gegevens te onderscheiden. De feedback van de discriminator wordt vervolgens gebruikt om de generator te verbeteren. Na de opleiding, de generator kan vervolgens worden gebruikt om nieuwe gegevensmonsters te genereren."

De onderzoekers waren in staat om BinaryGAN effectief te trainen, hun generatieve model met binaire neuronen. Hun bevindingen suggereren ook dat het gebruik van gradiëntschatters een veelbelovende benadering zou kunnen zijn om discrete distributies met GAN's te modelleren.

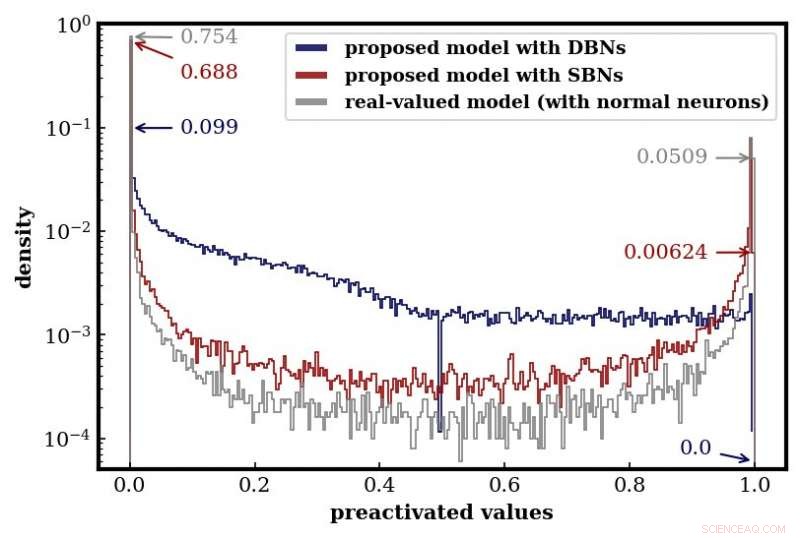

Histogrammen van de voorgeactiveerde outputs voor het voorgestelde model en de probabilistische voorspellingen voor het model met reële waarden. De twee modellen zijn beide geïmplementeerd door MLP's en getraind met de WGAN-GP-doelstelling. Krediet:Dong en Yang.

"Met het gebruik van gradiëntschatters, we waren in staat om BinaryGAN te trainen, met behulp van het backpropagation-algoritme, " zei Dong. "Bovendien, de in het model aangenomen binarisatie resulteerde in duidelijke kenmerken van de intermediaire representaties die door de diepe neurale netwerken werden geleerd. Dit benadrukt ook het belang van het opnemen van binarisatie-operaties in de training, zodat deze binaire bewerkingen ook kunnen worden geoptimaliseerd."

Dong en Yang zijn nu op zoek naar een GAN die binaire neuronen gebruikt voor de realisatie van een voorwaardelijke berekeningsgrafiek. Op dit moment, sommige componenten zouden worden geactiveerd en gedeactiveerd, volgens de beslissingen van de binaire neuronen van het netwerk.

Systeemdiagram van het voorgestelde model geïmplementeerd door MLP's. Merk op dat binaire neuronen alleen worden gebruikt in de uitgangslaag van de generator. Krediet:Dong en Yang.

"Dit is belangrijk omdat het ons in staat stelt een complexer model te bouwen dat vertrouwt op beslissingen die in vroege lagen van het netwerk zijn genomen, " zei Dong. "Bijvoorbeeld, we zouden een AI-componist kunnen bouwen die leert om eerst de instrumentatie en akkoorden te beslissen en dienovereenkomstig componeert."

© 2018 Tech Xplore

Hoe Nobel-winnende scheikundigen evolutie gebruikten en leidden

Hoe Nobel-winnende scheikundigen evolutie gebruikten en leidden Hoe te bepalen of er een reactie was in een chemische vergelijking

Hoe te bepalen of er een reactie was in een chemische vergelijking  Collageen in kraakbeenweefsel gedraagt zich als vloeibare kristallen op een smartphonescherm

Collageen in kraakbeenweefsel gedraagt zich als vloeibare kristallen op een smartphonescherm Kleine chemische reactoren met microdruppels zorgen voor een revolutie in wetenschappelijke experimenten

Kleine chemische reactoren met microdruppels zorgen voor een revolutie in wetenschappelijke experimenten Op ijzer gebaseerde zonnecellen op weg om efficiënter te worden

Op ijzer gebaseerde zonnecellen op weg om efficiënter te worden

Mooi moment om te proberen:een moestuin beginnen

Mooi moment om te proberen:een moestuin beginnen Hoe inkomen en houding de uitstoot van broeikasgassen beïnvloeden

Hoe inkomen en houding de uitstoot van broeikasgassen beïnvloeden Wat is het proces van waterbehandeling?

Wat is het proces van waterbehandeling?  Afbeelding:Sentinel-2A-satelliet legt Sevilla vast

Afbeelding:Sentinel-2A-satelliet legt Sevilla vast wetenschappelijke waarschuwingen, Amerikaanse retraite voegt urgentie toe aan VN-klimaatbesprekingen

wetenschappelijke waarschuwingen, Amerikaanse retraite voegt urgentie toe aan VN-klimaatbesprekingen

Hoofdlijnen

- Weefsels regenereren met moleculen die gericht zijn op genen

- Laatste gemeenschappelijke aap-menselijke voorouder was waarschijnlijk zo groot als een gibbon

- Biomedical Engineering Project Onderwerpen voor High School

- Een door kracht aangedreven mechanisme voor het vaststellen van celpolariteit

- Wetenschappers onderzoeken hoe verschillende huizen en levensstijlen van invloed zijn op welke insecten bij ons leven

- Hadley Cell Effects

- Verander je geliefde in een boom met Bios Urn

- Wat is apoptose?

- Wat zijn de kenmerken die alle bacteriën gemeenschappelijk hebben?

- Een systeem om nieuwe songteksten te genereren die passen bij de stijl van specifieke artiesten

- VW investeert 340 miljoen dollar meer in fabriek in Tennessee

- Onderzoekers vinden kritieke beveiligingsfouten in AMD-chips

- Gedeelde data en krimpende vliegtuigstoelen om reistijden in Europa te verkorten

- Hoe u de gevreesde taak van gegevensinvoer minder veracht kunt maken?

Waarom uw tonijn 36 keer meer chemicaliën kan bevatten dan andere

Waarom uw tonijn 36 keer meer chemicaliën kan bevatten dan andere Volcano Science Fair Project voor kinderen

Volcano Science Fair Project voor kinderen  De hittecyclus van de oceanen laat zien dat koolstof in de atmosfeer ergens anders heen kan gaan

De hittecyclus van de oceanen laat zien dat koolstof in de atmosfeer ergens anders heen kan gaan Wat is de functie van aerobe ademhaling?

Wat is de functie van aerobe ademhaling?  Nieuw artikel biedt ontwerpprincipes voor ziektegevoelige nanomaterialen

Nieuw artikel biedt ontwerpprincipes voor ziektegevoelige nanomaterialen Het palet met plasmonische schilders uitbreiden

Het palet met plasmonische schilders uitbreiden Sociaal beleid kan niet alleen het economisch welzijn verbeteren, maar ook gezondheid

Sociaal beleid kan niet alleen het economisch welzijn verbeteren, maar ook gezondheid Hoe TEM & SEM te vergelijken

Hoe TEM & SEM te vergelijken

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway | French |

-

Wetenschap © https://nl.scienceaq.com