Wetenschap

Een mensachtige planner waarmee robots objecten in een rommelige omgeving kunnen bereiken

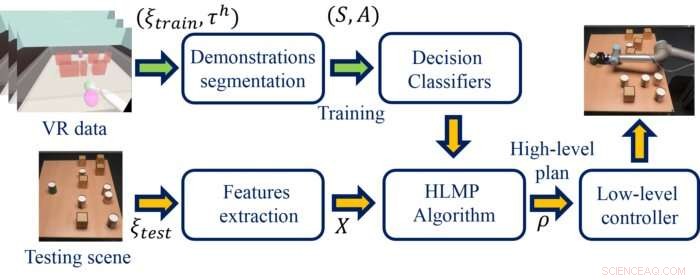

Figuur waarin wordt geschetst hoe de mensachtige planner werkt. Krediet:Hasan et al.

Hoewel onderzoek op het gebied van robotica de afgelopen jaren tot aanzienlijke vooruitgang heeft geleid, er zijn nog steeds grote verschillen in de manier waarop mensen en robots met objecten omgaan. In feite, zelfs de meest geavanceerde robots die tot nu toe zijn ontwikkeld, hebben moeite om de objectmanipulatievaardigheden van de gemiddelde peuter te evenaren. Een specifiek aspect van objectmanipulatie dat de meeste robots nog niet onder de knie hebben, is het bereiken en grijpen naar specifieke objecten in een rommelige omgeving.

Om deze beperking te overwinnen, als onderdeel van een door EPSRC gefinancierd project, onderzoekers van de Universiteit van Leeds hebben onlangs een mensachtige robotplanner ontwikkeld die virtual reality (VR) en machine learning (ML) technieken combineert. Deze nieuwe planner, geïntroduceerd in een paper dat vooraf is gepubliceerd op arXiv en zal worden gepresenteerd op de International Conference on Robotics and Automation (ICRA), zou de prestaties van een verscheidenheid aan robots bij taken voor objectmanipulatie kunnen verbeteren.

"Ons onderzoeksdoel is om betere robotsystemen te ontwikkelen; systemen die mensen kunnen helpen bij een reeks taken, variërend van het verkennen van gevaarlijke omgevingen tot het helpen van een kind om te leren schrijven, "Prof. Anthony G. Cohn, hoofdonderzoeker van het onderzoek, vertelde TechXplore. "Dus vormden we een multidisciplinaire groep van psychologen en computerwetenschappers om te onderzoeken of we het gedrag van mensen konden vastleggen en de regels die mensen gebruiken bij het reiken naar objecten kunnen reverse-engineeren."

In tegenstelling tot andere onderzoekers die machine learning classifiers trainden op afbeeldingen van rommelige omgevingen, Cohn en zijn collega's wilden trainingsgegevens genereren met behulp van nieuwe immersieve technologieën. In hun studie hebben ze gebruikten dus VR-apparatuur om gegevens te verzamelen over mensen die manipulatietaken uitvoeren.

Vervolgens, ze gebruikten ML-classificaties om de VR-gegevens die ze verzamelden te analyseren en algemene regels te extraheren die aan menselijke besluitvorming ten grondslag kunnen liggen. De planner gebruikt deze regels om efficiënte strategieën te plannen voor robots die taken voor objectmanipulatie uitvoeren.

"We wilden dat de resulterende plannen die door de robot werden uitgevoerd ook 'menselijk leesbaar, " in de zin dat zij degenen zouden zijn die een mens zou verwachten dat een ander mens zou uitvoeren, wat bij veel huidige robotplannen niet het geval is, ’ legde Cohn uit.

De beslissingen van mensen die manipulatietaken uitvoeren, lijken meestal te worden geleid door kwalitatieve representaties (d.w.z. niet de exacte afstand en richting van alle objecten in hun omgeving, maar eerder relatieve afstanden en richtingen). In hun studie hebben de onderzoekers probeerden deze besluitvormingsprocessen beter te begrijpen om ze deels te reproduceren in ML-classificaties.

"We hebben onderzocht hoe mensen reiken in scenario's waarin de objecten die ze grijpen bepaalde ruimtelijke relaties hebben en gebruikten methoden die zijn ontwikkeld door AI-onderzoekers van de Universiteit van Leeds om kwalitatief te beschrijven waar de objecten zich bevonden, "Dr. Mohamed Hasan, een research fellow die aan het project werkt, uitgelegd. "Dit betekende dat de planner de kwalitatieve ruimtelijke relaties tussen objecten kon classificeren en vervolgens de acties kon selecteren die mensen in dat scenario zouden gebruiken."

De door Cohn en zijn collega's voorgestelde aanpak stelt robots in staat om veel sneller effectieve acties te identificeren om naar een object in een rommelige ruimte te reiken dan wanneer ze alle mogelijke acties zouden moeten overwegen. Het doet dit door een plan op hoog niveau op te stellen, die wordt weergegeven als een opeenvolging van belangrijke waypoints en bewegingen. Dit plan wordt doorgegeven aan een standaard low-level planner, die het gebruikt om gedetailleerde trajecten voor de arm van de robot te plannen.

"Onze planner werkt op een manier die lijkt op het proces van het plannen van een reis door te kiezen door welke steden we gaan en pas later precies te beslissen welke wegen en rijstroken we moeten nemen, "Zei Cohn. "We ontdekten dat deze aanpak onze mensachtige planner veel efficiënter maakt dan bestaande planners."

De onderzoekers evalueerden hun planner in een reeks experimenten, het testen in VR-scenario's waarbij mensen manipulatietaken voltooiden in op fysica gebaseerde robotsimulaties en met behulp van een echte robotgrijper. Alle drie de evaluaties leverden veelbelovende resultaten op, waarbij de mensachtige planner beter presteert dan een state-of-the-art, standaard trajectoptimalisatie-algoritme.

De planner van Cohn en zijn collega's was in staat om effectieve strategieën te genereren waarmee robots sneller en efficiënter naar objecten in onoverzichtelijke omgevingen konden reiken dan wanneer ze de standaard technieken voor trajectoptimalisatie zouden gebruiken. Naast de introductie van een veelbelovende mensachtige planner voor robotmanipulatietaken, het onderzoek laat zien dat VR-technologie kan worden gebruikt om menselijk gedrag te bestuderen en besluitvormingsprocessen beter te begrijpen.

"Ons VR-platform, die in-house is ontwikkeld aan de Universiteit van Leeds, stelde ons in staat om in korte tijd honderden bereiken vast te leggen, maar we zouden ook de lay-out van de omgeving tussen elke proef kunnen veranderen en gemakkelijk precies dezelfde omgeving kunnen presenteren aan verschillende menselijke deelnemers, " zei prof. Mark Mon-Williams, co-onderzoeker en een cognitief psycholoog, uitgelegd. "Onze bevindingen ondersteunen onze recente suggesties dat VR een van de meest alomtegenwoordige hulpmiddelen in psychologisch onderzoek zal worden. Maar we hebben ook ontdekt dat regels die ten grondslag liggen aan de selectie van menselijke acties kunnen worden vastgelegd door ML-methoden."

In de toekomst, de door Cohn en zijn collega's ontwikkelde planner zou kunnen helpen om de manipulatievaardigheden van zowel bestaande als nieuwe robots te verbeteren, waardoor machines acties efficiënter kunnen selecteren en mogelijk zelfs de "redenering" achter hun beslissingen kunnen uitleggen. Deze recente studie zou ook andere onderzoekers kunnen aanmoedigen om VR-gegevens te gebruiken bij het onderzoeken van menselijke besluitvormingsprocessen, die dan beter in machines zou kunnen worden gereproduceerd.

Het uiteindelijke doel van het onderzoek is om intelligente robots te bouwen die menselijke bedoelingen begrijpen en anticiperen in scenario's voor samenwerking tussen mens en robot. Ideaal, dergelijke robots zouden ook in staat zijn om op mensachtige manieren te reageren, communiceren met menselijke gebruikers op dezelfde manier als een ander mens zou doen.

"Het huidige werk is een proof of concept, dus we zijn nu van plan om de methode die we hebben ontwikkeld te gebruiken en het enorme potentieel ervan te benutten, Mon-Williams zei. "Het is duidelijk geworden dat deze combinatie van computerwetenschap en psychologie een zeer nuttige benadering is die het potentieel heeft om licht te werpen op de selectie van menselijke acties, wat om een aantal redenen belangrijk is, inclusief inzicht in de behandeling van medische aandoeningen zoals beroertes, en ons helpen efficiëntere robots te ontwerpen. We werken momenteel aan onze volgende reeks experimenten en projecten."

© 2020 Wetenschap X Netwerk

Ingenieurs testen medicijnoverdracht met placenta-op-een-chip

Ingenieurs testen medicijnoverdracht met placenta-op-een-chip Wat wordt overgebracht tussen een geconjugeerd zuur basepaar?

Wat wordt overgebracht tussen een geconjugeerd zuur basepaar?  Wetenschappers ontwikkelen een nieuw materiaal voor het manipuleren van moleculen

Wetenschappers ontwikkelen een nieuw materiaal voor het manipuleren van moleculen Zoutzuur verhoogt de activiteit van de katalysator

Zoutzuur verhoogt de activiteit van de katalysator Prijs van gegalvaniseerd staal versus Roestvrij staal

Prijs van gegalvaniseerd staal versus Roestvrij staal

Is het beleid ter bevordering van het fietsgebruik maatschappelijk rendabel?

Is het beleid ter bevordering van het fietsgebruik maatschappelijk rendabel? Basisweerinstrumenten

Basisweerinstrumenten  Supercomputersimulaties tonen aan dat bebossing van graslanden contraproductief kan zijn

Supercomputersimulaties tonen aan dat bebossing van graslanden contraproductief kan zijn TV-verslaggeving van wielerwedstrijden kan helpen de effecten van klimaatverandering vast te leggen

TV-verslaggeving van wielerwedstrijden kan helpen de effecten van klimaatverandering vast te leggen Naarmate het klimaat warmer wordt, zomermoessons om minder stroom te produceren

Naarmate het klimaat warmer wordt, zomermoessons om minder stroom te produceren

Hoofdlijnen

- Welk proces voeren Ribosomes uit?

- De voor- en nadelen van grote oren voor vleermuissoorten

- Verschillen tussen codering en sjabloonstrengen

- Verschillen tussen lichaamscellen en neuronen

- De rol van microben in de industrie

- Onderzoek onthult dat controversiële insecticiden giftig zijn voor zangvogels

- Naar huis vliegen? IJstijd heeft de vogeltrek mogelijk afgeremd

- Cyanobacteriële studies onderzoeken de celstructuur tijdens stikstofgebrek

- Mexico vangt zeldzame vaquita-bruinvis om soorten te redden

- Maak kennis met Lindsey:Shell be your guide today

- Team lokaliseert bijna alle Amerikaanse zonnepanelen in een miljard afbeeldingen met machine learning

- Israël probeert de groeiende wereldwijde honger naar voedseltechnologie te voeden

- Sony, Amazone, anderen stoppen met grote technische show vanwege virus

- Parijse onderzoekers beginnen Ethiopische jetrecorder te bestuderen

Voorzorgsmaatregelen bij het gebruik van een microscoop

Voorzorgsmaatregelen bij het gebruik van een microscoop Wegenbouw in Papoea-Nieuw-Guinea bedreigt milieu, gemeenschappen en economie

Wegenbouw in Papoea-Nieuw-Guinea bedreigt milieu, gemeenschappen en economie Hoe religie financiële stress kan verhogen of helpen?

Hoe religie financiële stress kan verhogen of helpen? Afbeelding:Strook van Saturnus

Afbeelding:Strook van Saturnus Wiskundig model voorspelt de beweging van microplastics in de oceaan

Wiskundig model voorspelt de beweging van microplastics in de oceaan Testen van Hawking-straling in laboratoriumanalogen van zwart gat

Testen van Hawking-straling in laboratoriumanalogen van zwart gat Licht uit exotische deeltjestoestanden

Licht uit exotische deeltjestoestanden Schatting van de volledigheid van de carbonaatlaag via stratigrafische voorwaartse modellering

Schatting van de volledigheid van de carbonaatlaag via stratigrafische voorwaartse modellering

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com