Wetenschap

Een slimme kunstmatige hand voor geamputeerden combineert gebruikers- en robotbesturing

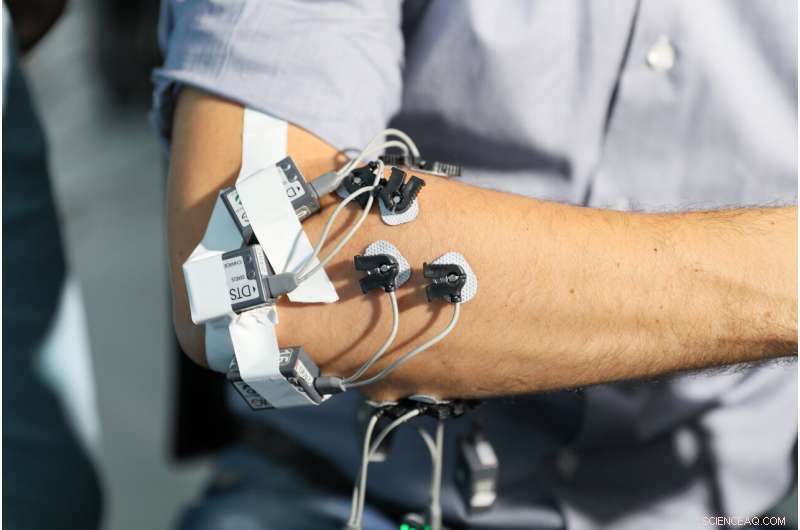

Krediet:Ecole Polytechnique Federale de Lausanne

EPFL-wetenschappers ontwikkelen nieuwe benaderingen voor verbeterde controle van robothanden, met name voor geamputeerden, die individuele vingercontrole en automatisering combineren voor beter grijpen en manipuleren. Deze interdisciplinaire proof of concept tussen neuroengineering en robotica is met succes getest op drie geamputeerden en zeven gezonde proefpersonen. De resultaten zijn gepubliceerd in het huidige nummer van Intelligentie van de natuurmachine .

De technologie combineert twee concepten uit twee verschillende vakgebieden. Ze allebei samen implementeren was nog nooit eerder gedaan voor robothandbesturing, en draagt bij aan het opkomende gebied van gedeelde controle in neuroprothesen.

één begrip, van neuro-engineering, omvat het ontcijferen van de beoogde vingerbeweging uit spieractiviteit op de stomp van de geamputeerde voor individuele vingercontrole van de prothetische hand, wat nog nooit eerder is gedaan. De andere, van robotica, stelt de robothand in staat om objecten vast te pakken en er contact mee te houden voor stevig vastgrijpen.

"Als je een voorwerp in je hand houdt, en het begint te slippen, je hebt maar een paar milliseconden om te reageren, ", legt Aude Billard uit, die leiding geeft aan EPFL's Learning Algorithms and Systems Laboratory. "De robothand kan binnen 400 milliseconden reageren. Uitgerust met druksensoren langs de vingers, het kan reageren en het object stabiliseren voordat de hersenen daadwerkelijk kunnen waarnemen dat het object wegglijdt. "

Hoe gedeeld beheer werkt

Het algoritme leert eerst de intentie van de gebruiker te decoderen en vertaalt dit in vingerbewegingen van de prothesehand. De geamputeerde moet een reeks handbewegingen uitvoeren om het algoritme te trainen dat gebruikmaakt van machine learning. Sensoren op de stomp van de geamputeerde detecteren spieractiviteit, en het algoritme leert welke handbewegingen overeenkomen met welke patronen van spieractiviteit. Zodra de beoogde vingerbewegingen van de gebruiker zijn begrepen, deze informatie kan worden gebruikt om individuele vingers van de prothesehand aan te sturen.

"Omdat spiersignalen luidruchtig kunnen zijn, we hebben een algoritme voor machinaal leren nodig dat betekenisvolle activiteit uit die spieren haalt en ze vertaalt in bewegingen, ", zegt Katie Zhuang, eerste auteur van de publicatie.

Volgende, de wetenschappers hebben het algoritme zo ontworpen dat robotautomatisering in werking treedt wanneer de gebruiker een object probeert te grijpen. Het algoritme vertelt de prothesehand om zijn vingers te sluiten wanneer een object in contact komt met sensoren op het oppervlak van de prothesehand. Dit automatisch grijpen is een aanpassing van een eerdere studie voor robotarmen die zijn ontworpen om de vorm van objecten af te leiden en ze vast te pakken op basis van alleen tactiele informatie, zonder de hulp van visuele signalen.

-

Krediet:Ecole Polytechnique Federale de Lausanne

-

Krediet:Ecole Polytechnique Federale de Lausanne

Er zijn nog veel uitdagingen om het algoritme te ontwikkelen voordat het kan worden geïmplementeerd in een commercieel verkrijgbare handprothese voor geamputeerden. Voor nu, het algoritme wordt nog getest op een robot van een externe partij.

"Onze gedeelde benadering om robothanden te besturen, kan worden gebruikt in verschillende neuroprothetische toepassingen, zoals bionische handprothesen en brain-to-machine-interfaces, het vergroten van de klinische impact en bruikbaarheid van deze apparaten, "Silvestro Micera, EPFL's Bertarelli Foundation Chair in Translational Neuroengineering, en hoogleraar bio-elektronica aan Scuola Superiore Sant'Anna.

Moleculaire geheimen onthuld:antipsychoticum gedokt in zijn receptor

Moleculaire geheimen onthuld:antipsychoticum gedokt in zijn receptor Onderzoekers onthullen verborgen genetische regels voor hoe het leven op aarde begon

Onderzoekers onthullen verborgen genetische regels voor hoe het leven op aarde begon Hoe het percentage ionisatie te berekenen Gegeven de pH

Hoe het percentage ionisatie te berekenen Gegeven de pH  Hoe maak je een Vitamine C-indicator

Hoe maak je een Vitamine C-indicator Biologisch geïnspireerd membraan zuivert kolengestookte rook van broeikasgassen

Biologisch geïnspireerd membraan zuivert kolengestookte rook van broeikasgassen

Onderzoek daagt de populaire overtuiging uit dat biobrandstoffen beter zijn voor het milieu

Onderzoek daagt de populaire overtuiging uit dat biobrandstoffen beter zijn voor het milieu Magnetisme van Himalaya-rotsen onthult de complexe tektonische geschiedenis van de bergen

Magnetisme van Himalaya-rotsen onthult de complexe tektonische geschiedenis van de bergen Kunnen nanokristallen de volgende grote brandstofbron zijn?

Kunnen nanokristallen de volgende grote brandstofbron zijn?  Om het klimaat te redden, koolstof belasten tegen $ 75 per ton:IMF

Om het klimaat te redden, koolstof belasten tegen $ 75 per ton:IMF Inzicht in tropische regenval, zowel verleden als heden

Inzicht in tropische regenval, zowel verleden als heden

Hoofdlijnen

- Wat zijn dromen?

- Stuctuur van een celmembraan

- Wat doet ethanol in een DNA-extractie?

- Vrouwelijke vissen houden van zingende mannetjes

- Wat is Feedback-inhibitie en waarom is het belangrijk bij het reguleren van enzymactiviteit?

- Hoe kan een mutatie in DNA de eiwitsynthese beïnvloeden?

- Moeite met onthouden? Vertel je vrienden om een wandeling te maken

- Linkshandige vis en asymmetrische hersenen

- Foster-kikkervisjes triggeren het ouderlijk instinct bij gifkikkers

- Toyota's magneet vermindert de afhankelijkheid van veelgebruikte zeldzame-aarde-elementen

- Bel me niet voordat je sms't:de nieuwe communicatieregels in het digitale tijdperk

- Hoe Comcast het kabelspel probeert te veranderen

- 2,7 miljard tweets bevestigen dat echokamers op Twitter heel echt zijn

- Kan een holografisch scherm een nieuwe telefoon helpen uitbreken?

Licht smokkelen door ondoorzichtige materialen

Licht smokkelen door ondoorzichtige materialen Katalysator gemaakt van ijzer kan een belangrijke reactie veroorzaken voor het maken van organische verbindingen

Katalysator gemaakt van ijzer kan een belangrijke reactie veroorzaken voor het maken van organische verbindingen Opinie:het wegen van in het laboratorium gekweekte biefstuk - de problemen met het eten van vlees zijn geen Silicon Valleys om op te lossen

Opinie:het wegen van in het laboratorium gekweekte biefstuk - de problemen met het eten van vlees zijn geen Silicon Valleys om op te lossen 3D nanosupergeleiders maken met DNA

3D nanosupergeleiders maken met DNA De ringen van Saturnus schitteren in het nieuwste portret van Hubble

De ringen van Saturnus schitteren in het nieuwste portret van Hubble Flexibele tv's en hoogwaardige draagbare slimme technologie een stap dichterbij

Flexibele tv's en hoogwaardige draagbare slimme technologie een stap dichterbij Grote aandeelhouder bij Yelp wil een herschikking van het bestuur

Grote aandeelhouder bij Yelp wil een herschikking van het bestuur Onderzoekers verbeteren methode voor het onderzoeken van halfgeleidende kristallen met licht om defecten en onzuiverheden te detecteren

Onderzoekers verbeteren methode voor het onderzoeken van halfgeleidende kristallen met licht om defecten en onzuiverheden te detecteren

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com