Wetenschap

Kunnen computers worden getraind om lichaamstaal te begrijpen?

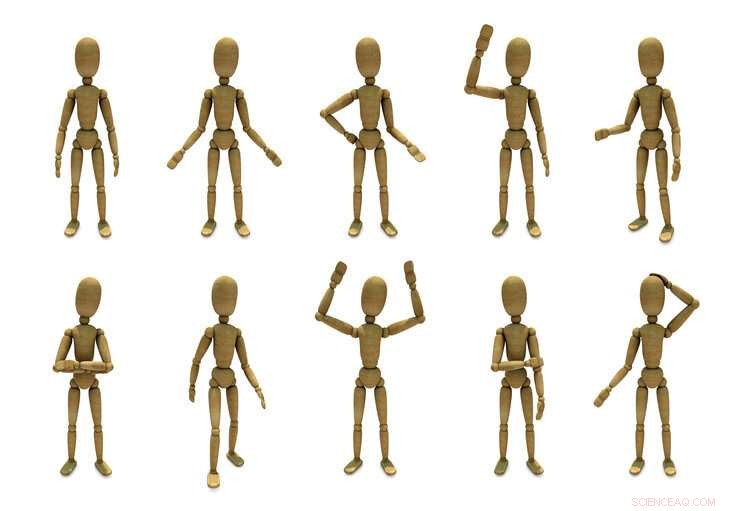

Onderzoekers van Penn State onderzoeken of computers kunnen worden getraind om de lichaamstaal van anderen te 'lezen' voor aanwijzingen over hun emotionele toestand, zoals mensen dat kunnen. Krediet:Adobe Stock:Sergio Lamacchia

Mensen zijn in staat om de lichaamstaal van anderen te "lezen" voor aanwijzingen over hun emotionele toestand. Bijvoorbeeld, merken dat een vriend nerveus is door hun tikkende voet, of dat een geliefde die rechtop staat zich zelfverzekerd voelt. Nutsvoorzieningen, een team van onderzoekers van Penn State onderzoekt of computers kunnen worden getraind om hetzelfde te doen.

Het team onderzoekt of moderne computervisietechnieken het cognitieve vermogen van mensen kunnen evenaren bij het herkennen van lichamelijke uitdrukkingen in de echte wereld, situaties zonder beperkingen. Als, deze capaciteiten kunnen een groot aantal innovatieve toepassingen mogelijk maken op gebieden zoals informatiebeheer en -opvraging, publieke veiligheid, patiëntenzorg en sociale media, aldus de onderzoekers.

"Computers en robots zullen in de toekomst met meer mensen communiceren, " zei James Wang, professor aan het College of Information Sciences and Technology (IST) en lid van het onderzoeksteam. "De computers van tegenwoordig, grotendeels, volg gewoon bevelen op. In de toekomst, robots en computers zullen meer als partners van mensen optreden en samenwerken. En om dat te doen, ze zullen hun emoties moeten begrijpen."

College van IST-promovendus Yu Luo, werken met Wang en andere docenten in het team, een groot aantal filmclips verwerkt en een dataset van meer dan 13 opgebouwd, 000 menselijke karakters met bijna 10, 000 lichaamsbewegingen. Volgens de onderzoekers is studies hebben aangetoond dat het menselijk lichaam meer diagnostisch is dan het gezicht bij het herkennen van menselijke emoties.

"De term in de psychologie heet 'socio-editing, '" zei Luo. "Mensen kunnen het gebruiken om hun gezichtsuitdrukking te manipuleren, maar het is veel moeilijker om hun lichaam onder controle te houden. De lichaamstaal projecteert verschillende emoties."

Volgende, de onderzoekers gebruikten computervisiemethoden om elke persoon in verschillende frames in de scène te lokaliseren en te volgen, uiteindelijk markeert elk individu in een clip met een uniek ID-nummer. Eindelijk, de onderzoekers gebruikten crowdsourced menselijke annotators om de filmclips te beoordelen en de emotie van elk individu te identificeren dat voorkomt in een van de 26 categorische emoties, d.w.z., vrede, affectie, achting, anticipatie, betrokkenheid, vertrouwen, blijheid, genoegen, spanning, verrassing, sympathie, verwardheid, ontkoppeling, vermoeidheid, verlegenheid, verlangen, afkeuring, afkeer, ergernis, woede, gevoeligheid, droefheid, onrust, angst, pijn en lijden, evenals in drie dimensies van emotie, d.w.z., valentie, opwinding en dominantie.

"We ontdekten dat het interpreteren van emoties op basis van lichaamstaal complex is, " zei Wang. "Er zijn veel subtiliteiten die we proberen te begrijpen. Zelfs voor mensen zijn er veel inconsistenties.

"Mensen zijn het niet met elkaar eens als het gaat om het interpreteren van emoties, "voegde hij eraan toe. "Je denkt misschien dat een persoon gelukkig is, Ik denk misschien dat ze opgewonden zijn, en misschien hebben we allebei gelijk. Er is vaak geen grondwaarheid, wat datagestuurde modellering zeer uitdagend maakt."

Nadat de onderzoekers de dataset hadden gebouwd en de door mensen waargenomen emotionele annotaties voor elk individu hadden toegepast, ze gebruikten state-of-the-art statistische technieken om hun kwaliteitscontrolemechanismen te valideren en analyseerden grondig het consensusniveau van hun geverifieerde datalabels. Verder, ze construeerden geautomatiseerde emotieherkenningssystemen van menselijke skeletten en beeldsequenties. specifiek, diepgaande leertechnieken en met de hand gemaakt, Op Laban-bewegingsanalyse gebaseerde functies toonden de effectiviteit voor de taak aan.

Ze ontdekten dat het computermodel opwinding kon identificeren, of hoe energiek de ervaring voelt, met een hoge mate van precisie. Echter, de onderzoekers ontdekten ook dat mensen beter zijn dan computers in het identificeren van de valentie - hoe negatief of positief de ervaring aanvoelt.

De huidige resultaten zijn mogelijk gemaakt door een seed-subsidie van het College of IST en lopend onderzoek wordt ondersteund door een recente prijs van het Amazon Research Award-programma. Het team ontving onlangs ook een planningsproject van de National Science Foundation om een gemeenschap op te bouwen om de data-infrastructuur te ontwikkelen die in dit onderzoek zal worden gebruikt.

Wang en Luo werkten samen met andere Penn State-onderzoekers aan het project, inclusief Jianbo Ye, voormalig doctoraatsstudent en laboratoriumgenoot in het College van IST; Reginald Adams en Michelle Newman, professoren psychologie; en Jia Li, hoogleraar statistiek. Er is onlangs een voorlopige octrooiaanvraag ingediend, en het werk zal worden gepubliceerd in een volgend nummer van de Internationaal tijdschrift voor computervisie .

"De toetredingsdrempel voor deze onderzoekslijn is behoorlijk hoog, " zei Wang. "Je moet kennis uit de psychologie gebruiken, je moet data science-methoden ontwikkelen en integreren, en je moet statistische modellering gebruiken om affectieve gegevens op de juiste manier te verzamelen. Dit laat zien dat we in dit belangrijke informatiesubdomein voorop lopen op het gebied van wetenschap en technologie."

Hoofdlijnen

- Onkruidverdelger veroorzaakt boze verdeeldheid onder Amerikaanse boeren

- Wat zijn de drie belangrijkste verschillen tussen een plantencel en een dierlijke cel?

- Waarom liegen mensen over dingen die gemakkelijk weerlegd kunnen worden?

- Projectideeën om het menselijk spijsverteringssysteem op de middelbare school voor studenten te laten zien

- Welke conclusies kunnen worden getrokken uit de overeenkomsten van de genetische code tussen levende organismen?

Als je door het park loopt en een straathond door het gras ziet rennen, is het niet zo moeilijk om delen van het erfgoed te identificer

- Eukaryotische cel: definitie, structuur en functie (met analogie en diagram)

- Hoe het Human Microbiome-project werkt

- Schimmel is afhankelijk van bacteriën om de belangrijkste componenten van zijn voortplantingsmechanisme te reguleren

- Onderzoekers vinden eerste wilde alligator brekende schildpad in Illinois sinds 1984

- Onderzoekers creëren een spelerskenmerkmodel dat gepersonaliseerde games mogelijk maakt

- BMW breidt terugroepactie Britse auto's opnieuw uit

- Twitteren in geval van nood

- Oceaanleven in 3D:fytoplankton in kaart brengen met een slimme AUV

- Schuldspel over 830 miljoen euro schikking in VW's Duitse dieselzaken

Toegepaste natuurkundigen creëren bouwstenen voor een nieuwe klasse optische circuits

Toegepaste natuurkundigen creëren bouwstenen voor een nieuwe klasse optische circuits Op muziekfestivals kunnen mensen een duurzamere levensstijl uitproberen

Op muziekfestivals kunnen mensen een duurzamere levensstijl uitproberen Wetenschappers onthullen zwakke vooroordelen in de Pacifische Noord-equatoriale tegenstroom in oceaanmodellen

Wetenschappers onthullen zwakke vooroordelen in de Pacifische Noord-equatoriale tegenstroom in oceaanmodellen De swingdoctors:natuurkundige kraakt code op materiaal dat zowel als dirigent, isolator

De swingdoctors:natuurkundige kraakt code op materiaal dat zowel als dirigent, isolator Waarom vermoorden mannen hun families? Dit is wat het onderzoek zegt

Waarom vermoorden mannen hun families? Dit is wat het onderzoek zegt Nieuw Mars-onderzoek toont bewijs van een complexe mantel onder de vulkanische provincie Elysium

Nieuw Mars-onderzoek toont bewijs van een complexe mantel onder de vulkanische provincie Elysium Gefrustreerde wetenschappers overtuigen astronomietijdschrift om trans-inclusief beleid voor naamsverandering te implementeren

Gefrustreerde wetenschappers overtuigen astronomietijdschrift om trans-inclusief beleid voor naamsverandering te implementeren Zijn wetenschappelijke laboratoria echt inclusief als ze niet toegankelijk zijn voor hulphondengeleiders?

Zijn wetenschappelijke laboratoria echt inclusief als ze niet toegankelijk zijn voor hulphondengeleiders?

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com