Wetenschap

Onderzoekers werken aan algoritme dat gezichtswisselingen onthult

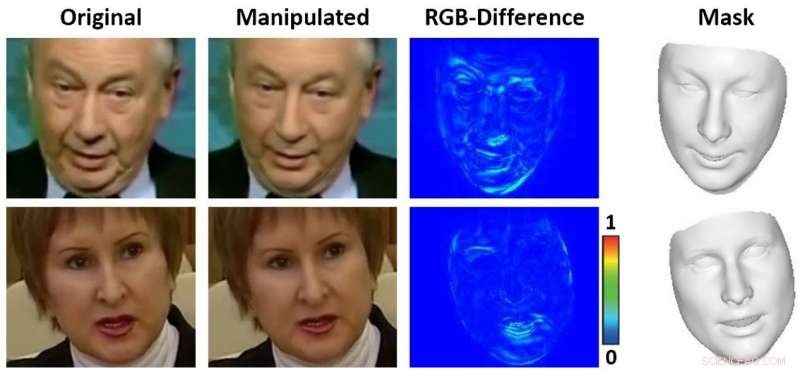

Nep of echt? Voorbeelden van de FaceForensics Self-Re-enactment Dataset. Van links naar rechts:originele invoerafbeelding, zelf nagespeeld uitvoerbeeld, kleurverschilplot en gezichtsmasker dat wordt gebruikt tijdens de synthese van het uitvoerbeeld. Krediet:arXiv:1803.09179 [cs.CV]

Beeldmanipulatie in dit geavanceerde stadium van het digitale tijdperk is niet zo leuk, maar een gevaarlijk wapen, in de schaduw van nepnieuws, om meningen te beïnvloeden en schandalen aan te wakkeren.

Face-swapping, vooral, klinkt leuk als je het ziet als een grinnik aan een familietafel terwijl kinderen en volwassenen verschillende gezichten bij verschillende mensen uitproberen. Echter, het is ook een hulpmiddel voor veel ergere motieven. Swapna Krishna in Engadget merkte op dat "Mensen hebben, natuurlijk, profiteerde van deze tool voor sommige verontrustende toepassingen, inclusief het van gezicht wisselen van mensen in pornografische video's - de ultieme wraakporno."

In MIT Technology Review , de "Emerging Technology from the arXiv", zei:"Er zijn pornovideo's met de naam 'deepfakes' verschenen op websites waarop de gezichten van beroemde personen te zien zijn op de lichamen van acteurs."

onderzoekers, echter, geïnteresseerd in het verkennen van de tool en hoe u kunt zien of deze wordt gebruikt, hebben een algoritme bedacht, zeg waarnemers, die andere beschikbare technieken kan overtreffen. Ze hebben een manier bedacht om een face swap te detecteren via het algoritme, het oppikken van vervalste video's zodra ze zijn gepost.

Analytics Vidhya commentaar, "Iets dat lijkt op dit algoritme was hard nodig om de strijd aan te gaan tegen het gebruik van gezichtsswaps om de verkeerde redenen. Bij het vrijgeven van de onderzoekspaper aan het publiek, de onderzoekers hopen dat anderen ook het stokje overnemen en aan dit onderzoek werken om het nauwkeuriger en nauwkeuriger te maken."

Andreas Rossler was teamleider van de deelnemers van de Technische Universiteit van München, Universiteit Federico II van Napels en de Universiteit van Erlangen-Neurenberg.

Ze trainden het algoritme, XceptionNet, met behulp van een groot aantal gezichtswisselingen, zei Engadget .

"We hebben een sterke basislijn van resultaten vastgesteld voor het detecteren van gezichtsmanipulatie met moderne deep-learning-architecturen, " zeiden Rossler en team in MIT Technology Review . Grootte deed er toe.

De omvang van deze database was een aanzienlijke verbetering ten opzichte van wat eerder beschikbaar was. "We introduceren een nieuwe dataset van gemanipuleerde video's die alle bestaande openbaar beschikbare forensische datasets in orde van grootte overtreft, ’ zei Rossler.

In hun krant de auteurs zeiden dat ze een dataset voor gezichtsmanipulatie hebben geïntroduceerd, GezichtForensisch, "van ongeveer een half miljoen bewerkte afbeeldingen (van meer dan 1000 video's)."

Het artikel is getiteld "FaceForensics:A Large-scale Video Dataset for Forgery Detection in Human Faces, " op arXiv. Auteurs zijn Andreas Rössler, Davide Cozzolino, Luisa Verdoliva, Christelijke Riess, Justus Thies en Matthias Nießner.

De auteurs vestigden de aandacht op de moeilijkheid - voor mensen en computers - om onderscheid te maken tussen originele en gemanipuleerde video, "vooral wanneer de video's zijn gecomprimeerd of een lage resolutie hebben, zoals het vaak gebeurt op sociale netwerken."

Ze vestigden ook de aandacht op het feit dat "onderzoek naar de detectie van gezichtsmanipulaties ernstig is belemmerd door het ontbreken van adequate datasets."

Er zit een nuance in hun succes, Hoewel, dat verdient ook aandacht. Het artikel "Emerging Technology from the arXiv" noemde het de "steek in de staart". Wat is het? "Dezelfde diepgaande leertechniek die face-swapvideo's kan herkennen, kan ook worden gebruikt om de kwaliteit van face-swaps te verbeteren - en dat zou ze moeilijker te detecteren kunnen maken."

Engadget gelijk gezegd, "XceptionNet presteert duidelijk beter dan zijn rivaliserende technieken bij het detecteren van dit soort nepvideo's, maar het verbetert ook de kwaliteit van de vervalsingen. Het team van Rossler kan de grootste kenmerken van een gezichtswissel gebruiken om de manipulatie naadloos te maken. Het houdt XceptionNet niet voor de gek, maar op den duur het zou het voor andere methoden moeilijker kunnen maken om vervalste video's te detecteren."

Pranav Dar, in Analytics Vidhya , woog ook in op wat hij "een waarschuwing noemde bij dit algoritme - het kan mogelijk ook worden gebruikt om de kwaliteit van de gezichtswisselingen te verbeteren, waardoor het moeilijker wordt om de nep te detecteren. zodra een algoritme voor het detecteren van vervalsingen wordt gelanceerd, de oplichters proberen altijd hun model te verfijnen om een stap voor te blijven."

Niettemin, de auteurs zeiden, "onze raffinaderij verbetert vooral de visuele kwaliteit, maar het bemoeilijkt de detectie van vervalsing slechts in geringe mate voor een diepgaande leermethode die precies is getraind op de vervalste uitvoergegevens."

© 2018 Tech Xplore

Hoofdlijnen

- Nieuwe histonmodificaties koppelen metabolisme aan genactiviteit

- Nieuwe biobronnen voor plantaardige peptidehormonen met behulp van technologie voor het bewerken van genen

- Nieuwe interactieve technologie maakt zeldzame celtypes zichtbaar

- Definitie van biologische opvolging

- Detectorhonden bieden hoop om numbats te redden

- Waarom zijn mensen hun staart kwijtgeraakt?

- De Krebs-cyclus gemakkelijk gemaakt

- Hoe hoogte te bepalen via het skelet

- Zoektocht naar nieuwe medicijnen kan worden geholpen door celontdekking

- Amerikaanse senioren vervullen dromen, bestrijd depressie met virtual reality

- Virus hamert zakenreizen als op hun hoede bedrijven nix trips

- Vraag en antwoord:Trump, het postkantoor en Amazon

- Eerste programmeerbare memristorcomputer wil AI-verwerking uit de cloud halen

- Duitsland pompt 1 miljard euro in gênante mobiele dode zones

Museum:Eeuwenoude Torah niet verbrand in Rio-brand

Museum:Eeuwenoude Torah niet verbrand in Rio-brand Astronomen observeren mysterieus dimmen van een jonge nabije ster

Astronomen observeren mysterieus dimmen van een jonge nabije ster Video:Het historische avontuur van Cassini-Huygens

Video:Het historische avontuur van Cassini-Huygens 3D-geprinte batterijen kunnen de druk aan

3D-geprinte batterijen kunnen de druk aan Wetenschappers ontwikkelen plastic flexibel magnetisch geheugenapparaat

Wetenschappers ontwikkelen plastic flexibel magnetisch geheugenapparaat Hoogvermogen laserlicht afgeven op de limiet van plasmadichtheid

Hoogvermogen laserlicht afgeven op de limiet van plasmadichtheid Onderzoek toont aan dat het gebruik van groene producten leidt tot een warme gloed bij shoppers

Onderzoek toont aan dat het gebruik van groene producten leidt tot een warme gloed bij shoppers Hoe maak je een vacuümbuisje Light Up

Hoe maak je een vacuümbuisje Light Up

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com