Wetenschap

Een computationele snelkoppeling voor neurale netwerken

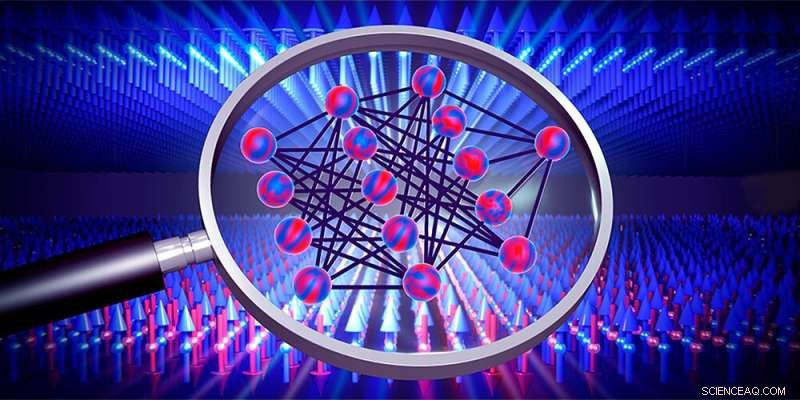

Neurale netwerken (midden) kunnen worden gebruikt om faseovergangen te onderzoeken, bijvoorbeeld van magnetische materialen (pijlen). Credit:Afdeling Natuurkunde, Universiteit van Basel

Neurale netwerken zijn leeralgoritmen die de oplossing voor een taak benaderen door te trainen met beschikbare gegevens. Het is echter meestal onduidelijk hoe ze dit precies bereiken. Twee jonge Bazelse natuurkundigen hebben nu wiskundige uitdrukkingen afgeleid waarmee je de optimale oplossing kunt berekenen zonder een netwerk te hoeven trainen. Hun resultaten geven niet alleen inzicht in hoe die leeralgoritmen werken, maar kunnen in de toekomst ook helpen om onbekende faseovergangen in fysieke systemen te detecteren.

Neurale netwerken zijn gebaseerd op het werkingsprincipe van de hersenen. Dergelijke computeralgoritmen leren door herhaalde training problemen op te lossen en kunnen bijvoorbeeld objecten onderscheiden of gesproken taal verwerken.

Sinds enkele jaren proberen natuurkundigen ook neurale netwerken te gebruiken om faseovergangen te detecteren. Faseovergangen zijn ons bekend uit de dagelijkse ervaring, bijvoorbeeld wanneer water bevriest tot ijs, maar ze komen ook in meer complexe vorm voor tussen verschillende fasen van magnetische materialen of kwantumsystemen, waar ze vaak moeilijk te detecteren zijn.

Julian Arnold en Frank Schäfer, twee Ph.D. studenten in de onderzoeksgroep van Prof. Dr. Christoph Bruder aan de Universiteit van Basel, hebben nu eigenhandig wiskundige uitdrukkingen afgeleid waarmee dergelijke faseovergangen sneller dan voorheen ontdekt kunnen worden. Ze publiceerden onlangs hun resultaten in Physical Review X .

Training overslaan bespaart tijd

Een neuraal netwerk leert door in veel trainingsrondes systematisch parameters te variëren om de door het netwerk berekende voorspellingen steeds beter af te stemmen op de ingevoerde trainingsgegevens. Die trainingsgegevens kunnen de pixels van afbeeldingen zijn of in feite de resultaten van metingen op een fysiek systeem met faseovergangen waarover men iets zou willen leren.

"Neurale netwerken zijn al behoorlijk goed geworden in het detecteren van faseovergangen", zegt Arnold, "maar hoe ze dat precies doen, blijft meestal volledig onduidelijk." Om die situatie te veranderen en wat licht in de "black box" van een neuraal netwerk te laten schijnen, keken Arnold en Schäfer naar het speciale geval van netwerken met een oneindig aantal parameters die in principe ook oneindig veel trainingsrondes doorlopen.

Over het algemeen is het al lang bekend dat de voorspellingen van dergelijke netwerken altijd neigen naar een bepaalde optimale oplossing. Arnold en Schäfer namen dit als uitgangspunt voor het afleiden van wiskundige formules waarmee je die optimale oplossing direct kunt berekenen zonder dat je het netwerk daadwerkelijk hoeft te trainen. "Die snelkoppeling vermindert de rekentijd enorm", legt Arnold uit:"De tijd die nodig is om onze oplossing te berekenen, is slechts zo lang als een enkele trainingsronde van een klein netwerk."

Inzicht in het netwerk

Naast tijdwinst heeft de door de Bazelse fysici ontwikkelde methode ook het voordeel dat de afgeleide vergelijkingen enig inzicht geven in de werking van de neurale netwerken en daarmee van de onderzochte fysische systemen.

Tot nu toe hebben Arnold en Schäfer hun methode getest op door de computer gegenereerde gegevens. Binnenkort willen ze de methode ook toepassen op echte meetgegevens. Hiermee kunnen in de toekomst nog onbekende faseovergangen worden gedetecteerd, bijvoorbeeld in kwantumsimulatoren of in nieuwe materialen. + Verder verkennen

Nieuwe methode om neurale netwerken te vergelijken legt bloot hoe kunstmatige intelligentie werkt

Ingenieurs ontdekken nieuwe rol van water bij productie van hernieuwbare brandstoffen

Ingenieurs ontdekken nieuwe rol van water bij productie van hernieuwbare brandstoffen Bewaar ambachtelijk bier op een koele plaats en consumeer het zo vers mogelijk

Bewaar ambachtelijk bier op een koele plaats en consumeer het zo vers mogelijk Tips voor roest en spuitwerk Smeedijzeren gazebo

Tips voor roest en spuitwerk Smeedijzeren gazebo Onderzoekers ontwerpen transistors op basis van ionische gel gemaakt van een geleidend polymeer

Onderzoekers ontwerpen transistors op basis van ionische gel gemaakt van een geleidend polymeer Kristallijne kunstmatige spier zorgt ervoor dat papieren pop sit-ups doet

Kristallijne kunstmatige spier zorgt ervoor dat papieren pop sit-ups doet

Koolstofafvang en de opslageffecten van langdurig gebruik

Koolstofafvang en de opslageffecten van langdurig gebruik  Koralen uit de schemerzone:wie eet wat op een diep Rode Zee-rif

Koralen uit de schemerzone:wie eet wat op een diep Rode Zee-rif Wereldwijde hotspots voor mogelijke watergeschillen

Wereldwijde hotspots voor mogelijke watergeschillen Traditionele hydrologische modellen kunnen sneeuw ten onrechte als regen aanduiden, nieuwe gegevens over burgerwetenschap

Traditionele hydrologische modellen kunnen sneeuw ten onrechte als regen aanduiden, nieuwe gegevens over burgerwetenschap Winterbanden met noppen kosten meer levens dan ze besparen, bijdragen aan een wereldwijd conflict

Winterbanden met noppen kosten meer levens dan ze besparen, bijdragen aan een wereldwijd conflict

Hoofdlijnen

- Het potentieel van agroforestry benutten

- Een bacterieel stroomdiagram maken

- Lijst met celorganellen en hun functies

- Gedetailleerd overzicht van oude Britse vogels onthult potentiële kandidaten voor herwildering

- Biologen onderzoeken de moleculaire onderbouwing van cellen die herstellen van de rand van geprogrammeerde dood

- Human Heart Science Projects

- Inzicht in virtueel geheugen CD8+ T-cellen

- Relatie tussen DNA-basen Genen, eiwitten en eigenschappen

- Zelfgemaakte UV-sterilisator

- Een nieuwe leerbenadering voor ontwikkelingsversterking voor vergroting van de sensomotorische ruimte

- Facebook bestrijdt verspreiding van verkeerde informatie over virussen online

- Zimbabwe waarschuwt voor cryptocurrencies

- Zie je die ski-kandidaten? Het zijn robots (en laat staan dat ze vallen)

- Onderzoekers leren robots handschrift en tekenen

Rapport onthult groeiende dreiging van cyberaanvallen op voedselveiligheid

Rapport onthult groeiende dreiging van cyberaanvallen op voedselveiligheid Het detecteren van niet-uniformiteiten in 2D-materialen kan leiden tot nieuwe medische sensoren

Het detecteren van niet-uniformiteiten in 2D-materialen kan leiden tot nieuwe medische sensoren Waarom worden avocado's rood?

Waarom worden avocado's rood?  Verhoogde organisatorische steun voor de adoptie-inspanningen van werknemers levert positieve voordelen op

Verhoogde organisatorische steun voor de adoptie-inspanningen van werknemers levert positieve voordelen op Ingenieurs lossen datastoring op NASA's Voyager 1 op

Ingenieurs lossen datastoring op NASA's Voyager 1 op Door elektronen te bevriezen, komen ze in een rij te staan

Door elektronen te bevriezen, komen ze in een rij te staan Southampton naar Shanghai met de trein:een zoektocht van onderzoekers naar klimaatverandering om vliegen te vermijden

Southampton naar Shanghai met de trein:een zoektocht van onderzoekers naar klimaatverandering om vliegen te vermijden Onderzoekers ontdekken een nieuwe gunstige functie van een oud eiwit

Onderzoekers ontdekken een nieuwe gunstige functie van een oud eiwit

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com