Wetenschap

De kloof tussen mens- en machinevisie overbruggen

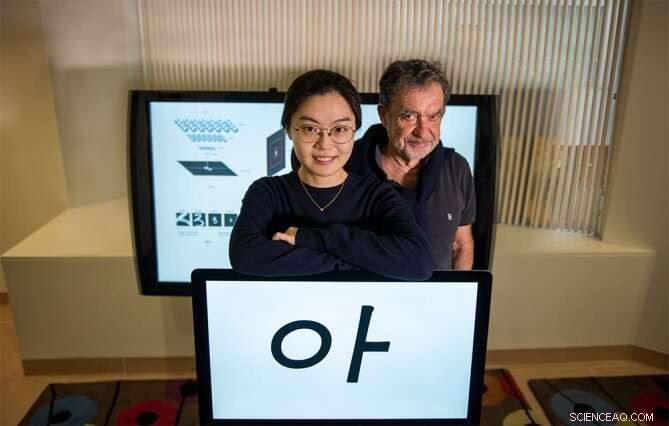

Yena Han (links) en Tomaso Poggio staan met een voorbeeld van de visuele stimuli die in een nieuw psychofysisch onderzoek worden gebruikt. Krediet:Kris Brewer

Stel je voor dat je van een paar meter afstand kort kijkt naar een persoon die je nog nooit eerder hebt ontmoet. Stap een paar passen achteruit en kijk opnieuw. Kun je haar gezicht herkennen? "Ja, natuurlijk, " denk je waarschijnlijk. Als dit waar is, het zou betekenen dat ons visuele systeem, een enkel beeld van een object hebben gezien, zoals een specifiek gezicht, herkent het robuust ondanks veranderingen in de positie en schaal van het object, bijvoorbeeld. Anderzijds, we weten dat state-of-the-art classifiers, zoals vanille diepe netwerken, zal deze eenvoudige test niet doorstaan.

Om een specifiek gezicht te herkennen onder een reeks transformaties, neurale netwerken moeten worden getraind met veel voorbeelden van het gezicht onder de verschillende omstandigheden. Met andere woorden, ze kunnen onveranderlijkheid bereiken door te onthouden, maar kan dit niet doen als er maar één afbeelding beschikbaar is. Dus, begrijpen hoe menselijke visie deze opmerkelijke prestatie kan leveren, is relevant voor ingenieurs die hun bestaande classificaties willen verbeteren. Het is ook belangrijk voor neurowetenschappers die het visuele systeem van primaten modelleren met diepe netwerken. Vooral, het is mogelijk dat de invariantie met eenmalig leren van biologische visie een nogal andere rekenstrategie vereist dan die van diepe netwerken.

Een nieuw artikel van MIT Ph.D. kandidaat in elektrotechniek en informatica Yena Han en collega's in Natuurwetenschappelijke rapporten , getiteld "Schaal- en vertaalinvariantie voor nieuwe objecten in het menselijk gezichtsvermogen, " bespreekt hoe ze dit fenomeen zorgvuldiger bestuderen om nieuwe biologisch geïnspireerde netwerken te creëren.

"Mensen kunnen van heel weinig voorbeelden leren, in tegenstelling tot diepe netwerken. Dit is een enorm verschil met enorme implicaties voor de engineering van vision-systemen en voor het begrijpen hoe menselijke visie echt werkt, " stelt co-auteur Tomaso Poggio - directeur van het Center for Brains, Minds and Machines (CBMM) en de Eugene McDermott Professor of Brain and Cognitive Sciences aan het MIT. "Een belangrijke reden voor dit verschil is de relatieve invariantie van het visuele systeem van primaten op schaal, verschuiving, en andere transformaties. Vreemd, dit is meestal verwaarloosd in de AI-gemeenschap, gedeeltelijk omdat de psychofysische gegevens tot dusver minder duidelijk waren. Han's werk heeft nu solide metingen opgeleverd van fundamentele invarianties van het menselijk gezichtsvermogen."

Om invariantie die voortkomt uit intrinsieke berekening te onderscheiden van die van ervaring en onthouden, de nieuwe studie mat het bereik van invariantie in eenmalig leren. Een eenmalige leertaak werd uitgevoerd door Koreaanse letterstimuli te presenteren aan mensen die de taal niet kenden. Deze letters werden aanvankelijk één keer aangeboden onder één specifieke conditie en getest op andere schalen of posities dan de oorspronkelijke conditie. Het eerste experimentele resultaat is dat - zoals je al geraden had - mensen significante schaalinvariante herkenning vertoonden na slechts een enkele blootstelling aan deze nieuwe objecten. Het tweede resultaat is dat het bereik van positie-invariantie beperkt is, afhankelijk van de grootte en plaatsing van objecten.

Volgende, Han en haar collega's voerden een vergelijkbaar experiment uit in diepe neurale netwerken die waren ontworpen om deze menselijke prestatie te reproduceren. De resultaten suggereren dat om invariante herkenning van objecten door mensen te verklaren, neurale netwerkmodellen moeten expliciet ingebouwde schaalinvariantie bevatten. In aanvulling, beperkte positie-invariantie van het menselijk zicht wordt beter gerepliceerd in het netwerk door de receptieve velden van de modelneuronen te vergroten naarmate ze verder van het centrum van het gezichtsveld verwijderd zijn. Deze architectuur verschilt van veelgebruikte neurale netwerkmodellen, waarbij een afbeelding wordt verwerkt onder uniforme resolutie met dezelfde gedeelde filters.

"Ons werk biedt een nieuw begrip van de hersenrepresentatie van objecten vanuit verschillende gezichtspunten. Het heeft ook implicaties voor AI, omdat de resultaten nieuwe inzichten bieden in wat een goed architectonisch ontwerp is voor diepe neurale netwerken, " merkt Han op, CBMM-onderzoeker en hoofdauteur van de studie.

Dit verhaal is opnieuw gepubliceerd met dank aan MIT News (web.mit.edu/newsoffice/), een populaire site met nieuws over MIT-onderzoek, innovatie en onderwijs.

Hoofdlijnen

- Evolutionair gewasonderzoek:Egoplanten geven lagere opbrengst

- Habitat: definitie, soorten en voorbeelden

- Waarom bevatten niet alle plantencellen chloroplasten?

- Binaire splijting: definitie & proces

- Hoe is zuurstof belangrijk voor de afgifte van energie in de celademhaling?

- Accuplacer-regels

- Wat is de complementaire basispaarregel?

- Wat gebeurt er als dieren geïsoleerd evolueren?

- Geluidsoverlast storend voor scholende vissen

- Tesla komt wanneer hij wordt gebeld, maar kan zenuwen rafelen

- VK eist actie van techgiganten wegens online kindermisbruik

- Nieuwe algoritmen trainen AI om specifiek slecht gedrag te voorkomen

- Productiesystemen met mensachtige zintuigen

- Apple onthult premium iPhone XS, gezondheidsfuncties voor horloge (update)

Hoe maak je polymeer polymeerballen thuis

Hoe maak je polymeer polymeerballen thuis Hoe T-Mobile, AT&T, Verizon en Sprint bestrijden robocalls op hun netwerk

Hoe T-Mobile, AT&T, Verizon en Sprint bestrijden robocalls op hun netwerk Sentinels moderniseren Europa's landbouwbeleid

Sentinels moderniseren Europa's landbouwbeleid Embryonale ontwikkeling van een kikker

Embryonale ontwikkeling van een kikker Hoogwaardige polarisatiegevoelige fotodetectoren op 2D-halfgeleider

Hoogwaardige polarisatiegevoelige fotodetectoren op 2D-halfgeleider Rapport identificeert opties om het risico op falen van onderzeese bouten op offshore booreilanden te verminderen

Rapport identificeert opties om het risico op falen van onderzeese bouten op offshore booreilanden te verminderen Nieuw klimaatrapport is een onmiddellijke oproep tot actie

Nieuw klimaatrapport is een onmiddellijke oproep tot actie Wetenschappers verbijsterd door kwik springen in vis uit Grote Meren

Wetenschappers verbijsterd door kwik springen in vis uit Grote Meren

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com