Wetenschap

Auto's leren rijden met een vooruitziende blik

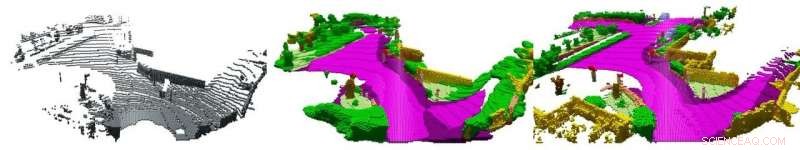

Enkele LiDAR-scan (links), de gesuperponeerde gegevens (rechts) met beschrijvingen (kleuren) geleverd door een menselijke waarnemer en het resultaat van de software (midden). Credit:AG Computer Vision der Universität Bonn

Goede chauffeurs anticiperen op gevaarlijke situaties en passen hun rijstijl aan voordat het hachelijk wordt. Onderzoekers van de Universiteit van Bonn willen deze vaardigheid nu ook aanleren aan zelfrijdende auto's. Ze zullen een bijbehorend algoritme presenteren op de International Conference on Computer Vision die op vrijdag wordt gehouden, 1 november, in Seoul. Ze zullen ook een dataset presenteren die ze hebben gebruikt om hun aanpak te trainen en te testen. Het zal het in de toekomst veel gemakkelijker maken om dergelijke processen te ontwikkelen en te verbeteren.

Een lege straat, een rij geparkeerde auto's aan de zijkant:niets wijst erop dat je voorzichtig moet zijn. Maar wacht:is er geen zijstraat verderop, half bedekt door de geparkeerde auto's? Misschien kan ik beter mijn voet van het gas halen - wie weet of er iemand van de zijkant komt. Tijdens het autorijden komen we dit soort situaties voortdurend tegen. Om ze correct te interpreteren en de juiste conclusies te trekken, is veel ervaring vereist. In tegenstelling tot, zelfrijdende auto's gedragen zich soms in zijn eerste les als een leerling-bestuurder. "Ons doel is om ze een meer anticiperende rijstijl aan te leren, " legt computerwetenschapper prof. dr. Jürgen Gall uit. "Dan zouden ze veel sneller kunnen reageren op gevaarlijke situaties."

Gall is voorzitter van de "Computer Vision"-werkgroep aan de Universiteit van Bonn, die, in samenwerking met zijn universitaire collega's van het Instituut voor Fotogrammetrie en de werkgroep "Autonome Intelligente Systemen", doet onderzoek naar een oplossing voor dit probleem. De wetenschappers presenteren nu een eerste stap op weg naar dit doel op het toonaangevende symposium van Gall's discipline, de internationale conferentie over computervisie in Seoul. "We hebben een algoritme verfijnd dat de zogenaamde LiDAR-gegevens aanvult en interpreteert, " legt hij uit. "Hierdoor kan de auto in een vroeg stadium anticiperen op mogelijke gevaren."

Probleem:te weinig data

LiDAR is een roterende laser die op het dak van de meeste zelfrijdende auto's wordt gemonteerd. De laserstraal wordt gereflecteerd door de omgeving. Het LiDAR-systeem meet wanneer het gereflecteerde licht op de sensor valt en gebruikt deze tijd om de afstand te berekenen. "Het systeem detecteert de afstand tot ongeveer 120, 000 punten rond het voertuig per omwenteling, ' zegt Gall.

Het probleem hiermee:de meetpunten worden "verdund" naarmate de afstand groter wordt - de afstand ertussen wordt groter. Dit is als het schilderen van een gezicht op een ballon:als je hem opblaast, de ogen bewegen steeds verder uit elkaar. Zelfs voor een mens is het daarom bijna onmogelijk om uit een enkele LiDAR-scan (d.w.z. de afstandsmetingen van een enkele omwenteling) een juist begrip van de omgeving te krijgen. "Een paar jaar geleden, de Universiteit van Karlsruhe (KIT) heeft grote hoeveelheden LiDAR-gegevens geregistreerd, in totaal 43, 000 scans, " legt Dr. Jens Behley van het Instituut voor Fotogrammetrie uit. "We hebben nu sequenties van enkele tientallen scans genomen en deze over elkaar heen gelegd." De op deze manier verkregen gegevens bevatten ook punten die de sensor alleen had geregistreerd toen de auto al een paar keer had gereden tientallen meters verder op de weg. ze tonen niet alleen het heden, maar ook de toekomst.

"Deze bovenop elkaar geplaatste puntenwolken bevatten belangrijke informatie zoals de geometrie van de scène en de ruimtelijke afmetingen van de objecten die het bevat, die niet in één scan beschikbaar zijn, " benadrukt Martin Garbade, die momenteel promoveert aan het Institute of Computer Science. "Aanvullend, we hebben elk punt erin gelabeld, bijvoorbeeld:er is een trottoir, er is een voetganger en weer een motorrijder." De wetenschappers voedden hun software met een gegevenspaar:een enkele LiDAR-scan als invoer en de bijbehorende overlay-gegevens inclusief semantische informatie als gewenste uitvoer. Ze herhaalden dit proces voor enkele duizenden van dergelijke paren.

"Tijdens deze opleidingsfase het algoritme leerde individuele scans in te vullen en te interpreteren, ", legt prof. Gall uit. "Dit betekende dat het op plausibele wijze ontbrekende metingen kon toevoegen en interpreteren wat in de scans werd gezien." De voltooiing van de scène werkt al relatief goed:het proces kan ongeveer de helft van de ontbrekende gegevens correct invullen. De semantische interpretatie, d.w.z. afleiden welke objecten zich achter de meetpunten bevinden, werkt niet zo goed:hier, de computer haalt een maximale nauwkeurigheid van 18 procent.

Echter, de wetenschappers beschouwen deze onderzoekstak nog in de kinderschoenen. "Tot nu, er was simpelweg een gebrek aan uitgebreide datasets om overeenkomstige kunstmatige-intelligentiemethoden te trainen, " benadrukt Gall. "We dichten hier een gat met ons werk. Ik ben optimistisch dat we de nauwkeurigheid van semantische interpretatie de komende jaren aanzienlijk kunnen verhogen." Hij beschouwt 50 procent als redelijk realistisch, die een enorme invloed kunnen hebben op de kwaliteit van autonoom rijden.

Op zijde gebaseerde apparaten met antisense-miRNA-therapeutica kunnen de botregeneratie verbeteren

Op zijde gebaseerde apparaten met antisense-miRNA-therapeutica kunnen de botregeneratie verbeteren Laser volgt therapieën, voedingsstoffen, gifstoffen

Laser volgt therapieën, voedingsstoffen, gifstoffen Methoden voor waterzuivering

Methoden voor waterzuivering Verbetering van de waarneming van eiwitbinding

Verbetering van de waarneming van eiwitbinding Nieuw klein antilichaamfragment - een waardevol hulpmiddel bij kristallografie

Nieuw klein antilichaamfragment - een waardevol hulpmiddel bij kristallografie

Klimaatmigranten zullen binnenkort de bevolking van veel landen verschuiven, zegt Wereldbank

Klimaatmigranten zullen binnenkort de bevolking van veel landen verschuiven, zegt Wereldbank Carbon Footprint Wood Pellets Vs. hout

Carbon Footprint Wood Pellets Vs. hout  Hoe een water te identificeren Moccasin

Hoe een water te identificeren Moccasin Best case-doelen voor klimaatopwarming die nog steeds kunnen resulteren in een enorm natuurbrandrisico

Best case-doelen voor klimaatopwarming die nog steeds kunnen resulteren in een enorm natuurbrandrisico De wijdverbreide voetafdruk van microvezels van blauwe jeans

De wijdverbreide voetafdruk van microvezels van blauwe jeans

Hoofdlijnen

- Hier ziet u hoe het einde van de zomertijd u kan beïnvloeden

- De voordelen van Anaerobe Ademhaling

- Wat zijn de 3 meest voorkomende elementen in menselijke lichamen?

- Sommige planten worden groter - en gemener - als ze worden geknipt, studie vondsten

- Mysterieuze nieuwe zeebodemsoorten werpen licht op vroege evolutie van dieren

- Kun je je familie aanzien voor bedriegers?

- Een mogelijke verklaring voor hoe kiemlijnen worden verjongd

- Twee soorten Cilia in een Paramecium

- Kan iemand zich herinneren dat hij geboren is?

- Heroverweging van diep leren overwint een groot obstakel in de AI-industrie

- Facebook-gebruik neemt af in de VS omdat sociale media onder druk staan

- Machine learning in de landbouw:wetenschappers leren computers om stress bij soja te diagnosticeren

- Robots leren taken van mensen

- Facebook zegt dat het met FTC heeft gesproken over de chat-app voor kinderen die een fout had

Velcro-methode voor een preciezere binding van medicijndeeltjes

Velcro-methode voor een preciezere binding van medicijndeeltjes Klimaatverandering kan de voedselketens in de oceaan veranderen, wat leidt tot veel minder vissen in de zee

Klimaatverandering kan de voedselketens in de oceaan veranderen, wat leidt tot veel minder vissen in de zee Skunk Water:een wapen dat stank gebruikt om menigten onder controle te houden

Skunk Water:een wapen dat stank gebruikt om menigten onder controle te houden  Onderzoekers ontwikkelen semi-vloeibare metaalanode voor batterijen van de volgende generatie

Onderzoekers ontwikkelen semi-vloeibare metaalanode voor batterijen van de volgende generatie Hoe kwantumstippen met elkaar kunnen praten

Hoe kwantumstippen met elkaar kunnen praten Welke producten worden gemaakt van bomen?

Welke producten worden gemaakt van bomen?  Diamant van nanoformaat zal materialen voor maritiem transport verbeteren

Diamant van nanoformaat zal materialen voor maritiem transport verbeteren Online geweld net zo destructief als offline geweld

Online geweld net zo destructief als offline geweld

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com