Wetenschap

Bestrijd aanstootgevende taal op sociale media met onbewaakte overdracht van tekststijl

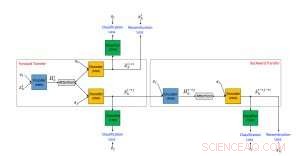

Voorgesteld raamwerk van een neuraal algoritme voor tekststijloverdracht met behulp van niet-parallelle gegevens. Krediet:IBM

Online sociale media zijn een van de belangrijkste manieren geworden om te communiceren en ideeën uit te wisselen. Helaas, het discours wordt vaak verlamd door grof taalgebruik dat schadelijke effecten kan hebben op gebruikers van sociale media. Bijvoorbeeld, een recent onderzoek door YouGov.uk ontdekte dat, onder de informatie die werkgevers online kunnen vinden over sollicitanten, agressieve of aanstootgevende taal is de meest professionele schadelijke activiteit op sociale media. Online sociale-medianetwerken pakken normaal gesproken het aanstootgevende taalprobleem aan door een bericht eenvoudigweg uit te filteren wanneer het als aanstootgevend wordt gemarkeerd.

In de krant "Bestrijding van aanstootgevend taalgebruik op sociale media met onbewaakte overdracht van tekststijlen, " die werd gepresenteerd in de 56e jaarvergadering van de Association for Computational Linguistics (ACL 2018), introduceren we een geheel nieuwe aanpak om dit probleem aan te pakken. Onze aanpak maakt gebruik van onbewaakte overdracht van tekststijlen om aanstootgevende zinnen te vertalen in overeenkomstige niet-aanstootgevende vormen. Voor zover wij weten, al het eerdere werk dat het probleem van aanstootgevend taalgebruik op sociale media aanpakte, was alleen gericht op tekstclassificatie. Deze methoden kunnen dus voornamelijk worden gebruikt om de aanstootgevende inhoud te markeren en uit te filteren, maar onze voorgestelde aanpak gaat een stap vooruit en produceert een alternatieve, niet-aanstootgevende versie van de inhoud. Dit heeft twee potentiële voordelen voor gebruikers van sociale media. Voor die gebruikers die van plan zijn een beledigend bericht te plaatsen, een waarschuwing ontvangen dat de inhoud aanstootgevend is en wordt geblokkeerd, samen met een meer beleefde versie van het bericht dat kan worden gepost, zou hen kunnen aanmoedigen om van gedachten te veranderen en de godslastering te vermijden. Aanvullend, voor gebruikers die online inhoud consumeren, hierdoor kunnen ze de boodschap nog steeds zien en begrijpen, maar op een niet-aanstootgevende en beleefde toon.

Een architectuur om aanstootgevende taal te vervangen

Onze methode is gebaseerd op de nu populaire encoder-decoder neurale netwerkarchitectuur, dat is de state-of-the-art benadering voor machinevertaling. Bij machinevertaling, de training van het encoder-decoder neuraal netwerk veronderstelt het bestaan van een "Rosetta Stone" waar dezelfde tekst is geschreven in zowel de bron- als de doeltaal. Met deze gekoppelde gegevens kunnen ontwikkelaars eenvoudig bepalen of een systeem correct vertaalt en daarom een encoder-decodersysteem trainen om het goed te doen. Helaas, in tegenstelling tot machinevertaling, zo ver we weten, er is geen dataset van gepaarde data beschikbaar voor beledigende tot niet-offensieve straffen. Bovendien, de overgedragen tekst moet een vocabulaire gebruiken dat gebruikelijk is in een bepaald toepassingsdomein. Daarom, niet-gecontroleerde methoden die geen gepaarde gegevens gebruiken, zijn nodig om deze taak uit te voeren.

We stelden een aanpak voor onbewaakte overdracht van tekststijlen voor, bestaande uit drie hoofdcomponenten:krijgen elk een aparte taak tijdens de training. Eén (een RNN-encoder) ontleedt een aanstootgevende zin en comprimeert de meest relevante informatie tot een echt gewaardeerde vector. Dit wordt gelezen door een andere component (een RNN-decoder), die een nieuwe zin genereert die de vertaalde versie van de originele is. De vertaalde zin wordt vervolgens geëvalueerd door de derde component (een CNN-classificatie) om te bepalen of de uitvoer correct is vertaald van de aanstootgevende stijl naar een niet-aanstootgevende stijl. Aanvullend, de gegenereerde zin wordt ook "terugvertaald" van niet-aanstootgevend naar aanstootgevend en vergeleken met de oorspronkelijke zin om te controleren of de inhoud bewaard is gebleven. Als de resultaten van een van de bovenstaande evaluaties fouten bevatten, het systeem wordt daarop aangepast. De encoder en decoder zijn ook, parallel, getraind met behulp van een autocoderingsopstelling waarbij het doel bestaat in het reconstrueren van de invoerzin. We gebruiken ook het aandachtsmechanisme dat helpt om inhoud te behouden. Onze belangrijkste bijdrage op het gebied van architectuur is het gecombineerde gebruik van een collaboratieve classifier, aandacht, en terugoverdracht.

Aanstootgevende taal vertalen

We hebben onze voorgestelde methode getest met behulp van gegevens van twee populaire sociale medianetwerken:Twitter en Reddit. We hebben datasets gemaakt van aanstootgevende en niet-aanstootgevende teksten door ongeveer 10 miljoen berichten te classificeren met behulp van een aanstootgevende taalclassificatie die is voorgesteld door Davidson et al. (2017). De volgende tabel toont voorbeelden van originele aanstootgevende zinnen en de niet-aanstootgevende vertalingen die zijn gegenereerd door een methode voor het overbrengen van tekststijlen voorgesteld door Shen et al. (2017) en door onze aanpak. Ons systeem presteerde beter bij het vertalen van aanstootgevende zinnen in niet-aanstootgevende zinnen met behoud van de algehele inhoud, maar produceert soms vreemde zinnen.

Dit werk is een eerste stap in de richting van een nieuwe veelbelovende aanpak voor het bestrijden van beledigende berichten op sociale media. Ongecontroleerde overdracht van tekststijlen is een onderzoeksgebied dat net een aantal veelbelovende resultaten begint te zien. Ons werk is een goed bewijs van het concept dat de huidige, niet-gecontroleerde methodes voor het overbrengen van tekststijlen kunnen worden toegepast op nuttige taken. Echter, het is belangrijk op te merken dat de huidige benaderingen voor overdracht van tekststijlen zonder toezicht alleen goed kunnen omgaan met de gevallen waarin het aanstootgevende taalprobleem lexicaal is (zoals de voorbeelden in de tabel) en kan worden opgelost door een paar woorden te wijzigen of te verwijderen. De modellen die we hebben gebruikt, zullen niet effectief zijn in gevallen van impliciete vooringenomenheid waar normaal onaanstootgevende woorden aanstootgevend worden gebruikt.

Wij zijn van mening dat verbeterde versies van de voorgestelde methode, samen met het gebruik van veel grotere hoeveelheden trainingsgegevens, in staat zal zijn om te gaan met andere beledigende berichten, zoals berichten met aanzetten tot haat, racisme, en seksisme. We stellen ons voor dat onze methode kan worden gebruikt om de gespreks-AI te verbeteren, door ervoor te zorgen dat chatbots die leren door online met gebruikers te communiceren, later geen aanstootgevende taal en haatzaaiende taal zullen reproduceren. Ouderlijk toezicht is een ander potentieel gebruik van het voorgestelde systeem.

Dit verhaal is opnieuw gepubliceerd met dank aan IBM Research.

Landherstel in Latijns-Amerika toont groot potentieel voor mitigatie van klimaatverandering

Landherstel in Latijns-Amerika toont groot potentieel voor mitigatie van klimaatverandering Bloomberg belooft $ 500 miljoen om klimaatverandering te bestrijden

Bloomberg belooft $ 500 miljoen om klimaatverandering te bestrijden Dieren van de Coastal Desert Biome

Dieren van de Coastal Desert Biome  Arctic kan geconfronteerd worden met een nieuwe verzengende annus horribilis

Arctic kan geconfronteerd worden met een nieuwe verzengende annus horribilis Onderzoekers tonen aan dat tropische riffen onder dezelfde omstandigheden koraal- of zeewiergemeenschappen kunnen herbergen

Onderzoekers tonen aan dat tropische riffen onder dezelfde omstandigheden koraal- of zeewiergemeenschappen kunnen herbergen

Hoofdlijnen

- Wat betekent ##### in Excel?

- Maleisië redt 140 schubdieren van vermoedelijke smokkelaars

- Een benadering van het hele lichaam om chemosensorische cellen te begrijpen

- Bijenschadelijke pesticiden in 75 procent van de honing wereldwijd:studie

- We kregen te maken met misbruik omdat we mensen vroegen om wespen te doden voor de wetenschap - hier is waarom het de moeite waard was

- Hoefijzerkrabben bedreigd door biomedische bloedvergieten

- 3 Eigenschappen van een cel

- Het gebruik van pinguïns om de gezondheid van de oceaan te monitoren is mogelijk niet effectief

- Bestaat er zoiets als een werkelijk onzelfzuchtige daad?

- Zonnevlammen, bellen ringen, en inktkroonluchters

- Fatale Uber-crash:zelfrijdende software zou naar verluidt objecten op de weg negeren

- Facebook zegt dat 50 miljoen gebruikersaccounts zijn getroffen door beveiligingsinbreuk

- Texaan zegt dat hij 3D-geprinte wapenplannen verkoopt na uitspraak

- Hulu verhoogt prijs voor live-tv-service, snijdt basispakket prijs

Waarom we oude olieplatforms in zee moeten laten, en waarom doen we dat niet?

Waarom we oude olieplatforms in zee moeten laten, en waarom doen we dat niet? Wat zijn dromen?

Wat zijn dromen?  Hoe Whole Foods de supermarktbranche een jaar na de Amazon-deal heeft beïnvloed

Hoe Whole Foods de supermarktbranche een jaar na de Amazon-deal heeft beïnvloed ATLAS-experiment bestudeert foton-gelabelde jet-quenching in het quark-gluon-plasma

ATLAS-experiment bestudeert foton-gelabelde jet-quenching in het quark-gluon-plasma Astronomen observeren zwart gat dat koude produceert, brandstof voor het maken van sterren uit hete plasmastralen en bellen

Astronomen observeren zwart gat dat koude produceert, brandstof voor het maken van sterren uit hete plasmastralen en bellen De rotsen lezen:geoloog vindt aanwijzingen voor oude klimaatpatronen in chert

De rotsen lezen:geoloog vindt aanwijzingen voor oude klimaatpatronen in chert Gebrek aan voedsel draagt bij aan een slechte gezondheid van studenten en ziekteverzuim

Gebrek aan voedsel draagt bij aan een slechte gezondheid van studenten en ziekteverzuim Doorbraak in dunne elektrisch geleidende platen maakt weg vrij voor kleinere elektronische apparaten

Doorbraak in dunne elektrisch geleidende platen maakt weg vrij voor kleinere elektronische apparaten

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- Italian | Spanish | Swedish | German | Dutch | Danish | Norway | French | Portuguese |

-

Wetenschap © https://nl.scienceaq.com