Wetenschap

Het reguleren van Facebook zal datalekken niet voorkomen

Krediet:Shutterstock

Na onthullingen dat politiek adviesbureau Cambridge Analytica zich Facebook-gebruikersgegevens zou hebben toegeëigend om de Amerikaanse presidentiële campagne van 2016 van Donald Trump te adviseren, velen pleiten voor meer regulering van sociale medianetwerken, zeggen dat er een "enorme datalek" heeft plaatsgevonden.

Het idee dat overheden hun manier kunnen regelen om de privacy van burgers te beschermen, is aantrekkelijk, maar ik geloof dat het de plank mis slaat.

Wat er met Cambridge Analytica gebeurde, was geen lek of lek. Het was een wilde schending van de academische onderzoeksethiek. Het verhaal is nog in ontwikkeling, maar een universiteitsonderzoeker heeft nu erkend dat hij de gegevens van Facebook-gebruikers heeft verzameld en aan een ander bedrijf heeft gegeven.

Een geleerde en zijn bedrijf slaagden er niet in om gevoelige onderzoeksgegevens te beschermen. Een universiteit deed niet genoeg om hem te stoppen. Het reguleren van Facebook lost deze problemen niet op.

Wat Kogan verkeerd heeft gedaan?

Ik ben een professor in media- en informatiebeleid aan het Quello Center van de Michigan State University, en ik was een van de eerste academici die het internet bestudeerde. De kwaliteit en integriteit van digitaal onderzoek baart mij grote zorgen.

Ik denk dat het Cambridge Analytica-Facebook-incident een totale ramp is. Ik denk alleen niet dat het een regelgevende fout van de overheid is.

Hier is het verhaal, althans wat de media tot nu toe hebben bevestigd.

Aleksandr Kogan is datawetenschapper aan de Universiteit van Cambridge en docent aan de afdeling psychologie. Buiten de universiteit, Kogan verzamelde en analyseerde ook Facebook-gebruikersgegevens – vermoedelijk met medeweten van Facebook – voor zijn bedrijf Global Science Research.

Via online-enquêtes, hij was naar verluidt in staat om gevoelige persoonlijke informatie te verzamelen over tientallen miljoenen Amerikaanse Facebook-gebruikers, inclusief demografische gegevens, Prive berichten, informatie over hun vrienden en mogelijk zelfs informatie over de vrienden van hun vrienden.

Kogan verstrekte deze gegevens vervolgens aan een politiek adviesbureau, Cambridge Analytica. Volgens de New York Times, het bedrijf analyseerde die informatie, met als doel de boodschappen van de Trump-campagne van 2016 vorm te geven en potentiële Trump-kiezers te identificeren.

Dat was nooit zijn bedoeling, zei Kogan in een BBC-radio-interview op 21 maart. Hij meldt "verbijsterd" te zijn dat zijn "perfect legale" onderzoek naar het geluk en welzijn van Facebook-gebruikers werd ingezet als politiek instrument.

Wat Facebook fout heeft gedaan

Dus deed Facebook iets verkeerd, dan? Naar mijn mening, niet echt.

Facebook heeft al strikte richtlijnen die aangeven wat wel en niet met gebruikersgegevens kan worden gedaan, die de onderzoeker lijkt te hebben geschonden door de door hem verzamelde persoonlijke gegevens door te geven aan Cambridge Analytica.

Toen Facebook in 2004 werd gelanceerd, het werd al snel een goudmijn voor sociale onderzoekers. Plotseling, studies die voorheen alleen op enquêtegegevens vertrouwden om informatie over individuen te verzamelen, konden direct zien hoe mensen met elkaar verbonden waren, wat ze leuk vonden, en wat groepen samenbindt.

In de vroege jaren, het bedrijf nam een open en experimentele houding aan ten opzichte van dit soort datamining, zelfs samenwerken met onderzoekers om te bestuderen hoe het aanpassen van bepaalde functies van individuele Facebook-pagina's de opkomst van kiezers beïnvloedde, zeggen, of hun gemoedstoestand beïnvloedde.

Die onderzoeken, uitgevoerd zonder de geïnformeerde toestemming van de deelnemers - Facebook-gebruikers - werden veel bekritiseerd door sociaalwetenschappelijke onderzoekers. In 2014, Facebook heeft zijn bestaande richtlijnen voor het verzamelen van gebruikersgegevens aangescherpt, geanalyseerd en gebruikt.

Vandaag, het bedrijf vereist een uitgebreide interne beoordeling van elk verzoek om persoonlijke gegevens van gebruikers te verkrijgen voor onderzoeksdoeleinden.

Met andere woorden, Facebook zelfregulerend.

Het kan laks zijn geweest bij het handhaven van zijn richtlijnen, Hoewel. Het bedrijf zegt dat zodra het vernam dat Cambridge Analytica de dataset van Kogan voor ongeoorloofde doeleinden had gebruikt, het drong erop aan dat de gegevens worden verwijderd.

Volgens de huidige persberichten Cambridge Analytica voldeed niet. Voor een poosje, het lijkt, Facebook deed niets om het bedrijf te straffen.

Ik geloof dat deze gevolgen van dit schandaal – inclusief een onderzoek van de Federal Trade Commission – Facebook ertoe zal aanzetten om de handhaving veel serieuzer te nemen.

Ten slotte, zoals CEO Mark Zuckerberg zei in een Facebook-bericht van 21 maart:het bedrijf "heeft fouten gemaakt" en het "heeft de verantwoordelijkheid om zijn gebruikers te beschermen".

Het Facebook-account van Cambridge Analytica is nu opgeschort. En volgens zowel de Amerikaanse als de Britse wet, personen of bedrijven die worden beschuldigd van ongeoorloofde openbaarmaking van persoonlijke informatie, kunnen worden vervolgd.

Wat de academische wereld verkeerd doet?

Voor mij, wat het Cambridge Analytica-fiasco aan het licht brengt, is dat universitaire ethische beoordelingsprocessen nog niet zijn uitgerust voor het digitale tijdperk.

Universitaire onderzoekers zijn gebonden aan strikte ethische richtlijnen. Over de hele wereld - vooral in het VK, met zijn sterke sociale onderzoekstradities - academici die de houding of het gedrag van particulieren willen bestuderen, moeten eerst een streng beoordelingsproces doorstaan. Ze moeten ook expliciete, geïnformeerde toestemming van degenen die deelnemen aan hun onderzoek.

Ik kan me onmogelijk voorstellen dat een ethische commissie van de Universiteit van Cambridge ooit zou hebben goedgekeurd dat Kogan zijn gegevens met Cambridge Analytica deelt.

Universiteiten over de hele wereld moedigen faculteiten aan om ondernemende bedrijven te ontwikkelen, zoals Kogan deed. Dat helpt hun onderzoek verder te reiken dan de campus om innovatie in het bedrijfsleven te bevorderen, industrie en overheid.

Maar de normen en regels die deelnemers aan wetenschappelijk onderzoek beschermen – zoals het niet delen van identificeerbare persoonsgegevens – stoppen niet bij de universiteit.

Kogans heldendaden tonen aan dat de externe banen van professoren tot belangenverstrengeling kunnen leiden en mogelijk buiten het bereik van institutionele toetsing zijn gebleven. Dit is een gebied van academisch ingehuurd werk dat universiteiten moeten herzien met het oog op het actualiseren van de manier waarop ze onderzoeksethiek afdwingen.

Ik heb institutionele beoordelingscommissies ingelicht bij een aantal universiteiten, en ik kan bevestigen dat leden vaak niet begrijpen hoe internet de manier waarop gegevens worden gemaakt heeft veranderd, verzameld, geanalyseerd en gedeeld op internet en sociale medianetwerken.

Vaak, de autoriteiten die professoren en studenten toestemming geven om hun studie te verrichten, zijn verankerd in de normen van medisch onderzoek, geen moderne sociale wetenschappen.

Veel scholen begrijpen over het algemeen ook niet hoe geavanceerd sommige academische velden zijn geworden. Big data en computationele analyse is tegenwoordig een van de meest innovatieve wetenschappelijke gebieden.

Rechtmatig, door het bedrijf goedgekeurde toegang tot gebruikersgegevens van sociale media stelt onderzoekers in staat enkele van de meest urgente problemen van de 21e eeuw te bestuderen, inclusief nepnieuws, politieke echokamers en technologische trends. Het is dan ook niet verwonderlijk dat politieke campagnes zich deze onderzoekspraktijken zouden willen toe-eigenen.

Totdat ze met nieuwe regels komen, Ik vrees dat het gebrek aan digitale kennis van universiteiten een bedreiging zal blijven voor de online privacy.

Dit artikel is oorspronkelijk gepubliceerd op The Conversation. Lees het originele artikel.

Hoofdlijnen

- Wat zijn de vijf klassen van immunoglobulines?

- Ocean meeting haalt meer dan $7 miljard op voor mariene bescherming

- Atrazine verandert de sex-ratio in Blanchards krekelkikkers

- Chloroplast & Mitochondria: wat zijn de overeenkomsten en verschillen?

- Gewassen evolueerden 10 millennia eerder dan gedacht

- Canadese kariboes, habitat blijft afnemen:rapport

- Nieuwe studie wijst op onverwachte voordelen van rabiësvaccinatie bij honden

- Wanneer citroenen je leven geven:Herpetofauna-aanpassing aan citrusboomgaarden in Belize

- Natuurlijke enzymen filteren hormoonverstorende chemicaliën uit rioolwater

- Pinterest prijzen IPO op $ 19 om donderdag te beginnen met handelen

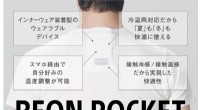

- Crowdfunding van een hemdapparaat voor zinderende pakken

- Op origami geïnspireerde zelfvergrendelende opvouwbare robotarm

- De eerste rankachtige zachte robot die kan klimmen

- Een slimme elektrische scooter om de stedelijke mobiliteit te verbeteren

Ruimtevaartuig is ontworpen om vuur te overleven, surft op zijn eigen golf

Ruimtevaartuig is ontworpen om vuur te overleven, surft op zijn eigen golf Waterstofbrandstof Vs. Fossil Fuel

Waterstofbrandstof Vs. Fossil Fuel Welke klasse van enzymen hoort Lactase te zijn?

Welke klasse van enzymen hoort Lactase te zijn?  Zonnebrandcrèmes worden onder zonlicht afgebroken tot gevaarlijke chemische verbindingen

Zonnebrandcrèmes worden onder zonlicht afgebroken tot gevaarlijke chemische verbindingen Het Mikulski-archief voor ruimtetelescopen maakt alle Kepler-gegevens openbaar beschikbaar

Het Mikulski-archief voor ruimtetelescopen maakt alle Kepler-gegevens openbaar beschikbaar Californische bemanningen klauteren om te voorkomen dat vlammen huizen bereiken

Californische bemanningen klauteren om te voorkomen dat vlammen huizen bereiken Natuurkundigen opgewonden door ontdekking van nieuwe vorm van materie, excitonium

Natuurkundigen opgewonden door ontdekking van nieuwe vorm van materie, excitonium NASA's Curiosity-rover wil zijn ritme terugkrijgen

NASA's Curiosity-rover wil zijn ritme terugkrijgen

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway | French |

-

Wetenschap © https://nl.scienceaq.com