Wetenschap

Deep learning zal toekomstige Marsrovers helpen verder te gaan, sneller, en doe meer wetenschap

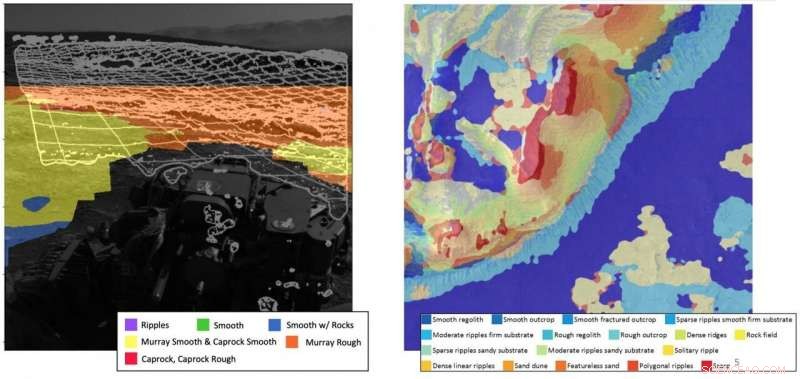

Het programma Machine Learning-based Analytics for Autonomous Rover Systems (MAARS) omvat een reeks gebieden waar kunstmatige intelligentie nuttig kan zijn. Het team presenteerde de resultaten van het MAARS-project op de IEEE Aerospace Conference in maart 2020. Het project was finalist voor de NASA Software Award. Krediet:NASA JPL

NASA's Marsrovers zijn een van de grote wetenschappelijke en ruimtesuccessen van de afgelopen twee decennia.

Vier generaties rovers hebben de rode planeet doorkruist om wetenschappelijke gegevens te verzamelen, suggestieve foto's terugsturen, en het overleven van ongelooflijk zware omstandigheden - allemaal met behulp van boordcomputers die minder krachtig zijn dan een iPhone 1. De nieuwste rover, Doorzettingsvermogen, werd gelanceerd op 30 juli, 2020, en ingenieurs dromen al van een toekomstige generatie rovers.

Hoewel een belangrijke prestatie, deze missies hebben alleen de oppervlakte (letterlijk en figuurlijk) van de planeet en zijn geologie bekrast, geografie, en sfeer.

"De oppervlakte van Mars is ongeveer gelijk aan de totale oppervlakte van het land op aarde, " zei Masahiro (Hiro) Ono, groepsleider van de Robotic Surface Mobility Group bij het NASA Jet Propulsion Laboratory (JPL) - dat alle Mars-rover-missies heeft geleid - en een van de onderzoekers die de software hebben ontwikkeld waarmee de huidige rover kan werken.

"Stel je voor, je bent een buitenaards wezen en je weet bijna niets over de aarde, en je landt op zeven of acht punten op aarde en rijdt een paar honderd kilometer. Weet die buitenaardse soort genoeg over de aarde?' vroeg Ono. 'Nee. Als we de enorme diversiteit van Mars willen weergeven, hebben we meer metingen op de grond nodig, en de sleutel is aanzienlijk langere afstand, hopelijk duizenden kilometers afleggen."

Reizend door de diverse, verraderlijk terrein met beperkte rekenkracht en een beperkt energiedieet - alleen zoveel zon als de rover kan vangen en omzetten in stroom op één enkele Marsdag, of sol—is een enorme uitdaging.

De eerste rover, bijwoner, bedekt 330 voet meer dan 91 sols; de seconde, Geest, reisde 4,8 mijl in ongeveer vijf jaar; Mogelijkheid, reisde 28 mijl over 15 jaar; en Curiosity heeft meer dan 12 mijl afgelegd sinds het landde in 2012.

"Ons team werkt aan de autonomie van Mars-robots om toekomstige rovers intelligenter te maken, om de veiligheid te vergroten, om de productiviteit te verbeteren, en vooral om sneller en verder te rijden, ' zei Ono.

nieuwe hardware, Nieuwe mogelijkheden

De Perseverance-rover, die deze zomer gelanceerd werd, berekent met behulp van RAD 750s:stralingsbestendige computers met één bord, vervaardigd door BAE Systems Electronics.

toekomstige missies, echter, mogelijk nieuwe krachtige, multi-core straling geharde processors ontworpen via het High Performance Spaceflight Computing (HPSC) -project. (De Snapdragon-processor van Qualcomm wordt ook getest voor missies.) Deze chips zullen ongeveer honderd keer de rekencapaciteit van de huidige vluchtprocessors leveren met dezelfde hoeveelheid stroom.

"Alle autonomie die je ziet op onze nieuwste Mars-rover is grotendeels human-in-the-loop" - wat betekent dat het menselijke interactie vereist om te werken, volgens Chris Mattmann, de plaatsvervangend chief technology and innovation officer bij JPL. "Een van de redenen daarvoor zijn de limieten van de processors die erop draaien. Een van de kernmissies voor deze nieuwe chips is om aan deep learning en machine learning te doen, zoals we op aarde doen, aan boord. Wat zijn de killer-apps in die nieuwe computeromgeving?"

Het Machine Learning-based Analytics for Autonomous Rover Systems (MAARS)-programma - dat drie jaar geleden van start ging en dit jaar zal eindigen - omvat een reeks gebieden waar kunstmatige intelligentie nuttig kan zijn. Het team presenteerde de resultaten van het MAARS-project op de hIEEE Aerospace Conference in maart 2020. Het project was finalist voor de NASA Software Award.

"Terrestrische high-performance computing heeft ongelooflijke doorbraken mogelijk gemaakt in autonome voertuignavigatie, machinaal leren, en data-analyse voor op aarde gebaseerde toepassingen, ', schreef het team in hun IEEE-paper. "De belangrijkste wegversperring voor een Mars-exploratie-uitrol van dergelijke vooruitgang is dat de beste computers op aarde zijn, terwijl de meest waardevolle gegevens zich op Mars bevinden."

Machine learning-modellen trainen op de Maverick2-supercomputer in het Texas Advanced Computing Center (TACC), evenals op Amazon Web Services en JPL-clusters, Ono, Mattmann en hun team hebben twee nieuwe mogelijkheden ontwikkeld voor toekomstige Marsrovers, die ze Drive-By Science en Energy-Optimal Autonomous Navigation noemen.

Energie-optimale autonome navigatie

Ono maakte deel uit van het team dat de on-board pathfinding-software voor Perseverance schreef. De software van Perseverance bevat enkele machine learning-mogelijkheden, maar de manier waarop het pathfinding doet, is nog steeds vrij naïef.

"We willen dat toekomstige rovers een mensachtig vermogen hebben om terrein te zien en te begrijpen, ' zei Ono. 'Voor rovers, energie is erg belangrijk. Er is geen verharde snelweg op Mars. De rijeigenschappen variëren aanzienlijk op basis van het terrein, bijvoorbeeld strand versus. fundament. Dat wordt momenteel niet overwogen. Een pad bedenken met al deze beperkingen is ingewikkeld, maar dat is het rekenniveau dat we aankunnen met de HPSC- of Snapdragon-chips. Maar om dat te doen, moeten we het paradigma een beetje veranderen."

Ono legt uit dat het nieuwe paradigma het beleid afdwingt, a middle ground between the human-dictated:"Go from A to B and do C, " and the purely autonomous:"Go do science."

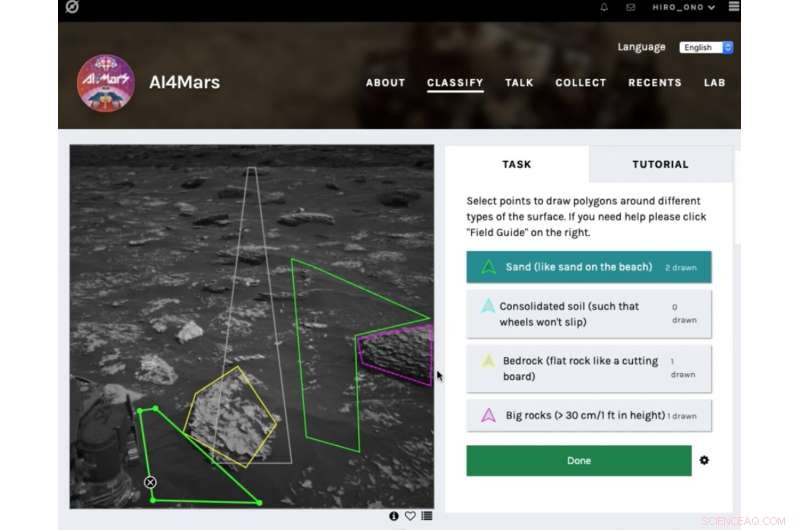

The public tool AI4Mars shows different kinds of Martian terrain as seen by NASA's Curiosity rover. By drawing borders around terrain features and assigning one of four labels to them, users can help train an algorithm that will automatically identify favorable and hazardous terrain for Curiosity's rover planners. Krediet:NASA/JPL-Caltech

Commanding by policy involves pre-planning for a range of scenarios, and then allowing the rover to determine what conditions it is encountering and what it should do.

"We use a supercomputer on the ground, where we have infinite computational resources like those at TACC, to develop a plan where a policy is:if X, then do this; if y, then do that, " Ono explained. "We'll basically make a huge to-do list and send gigabytes of data to the rover, compressing it in huge tables. Then we'll use the increased power of the rover to de-compress the policy and execute it."

The pre-planned list is generated using machine learning-derived optimizations. The on-board chip can then use those plans to perform inference:taking the inputs from its environment and plugging them into the pre-trained model. The inference tasks are computationally much easier and can be computed on a chip like those that may accompany future rovers to Mars.

"The rover has the flexibility of changing the plan on board instead of just sticking to a sequence of pre-planned options, " Ono said. "This is important in case something bad happens or it finds something interesting."

Drive-By Science

Current Mars missions typically use tens of images a Sol from the rover to decide what to do the next day, according to Mattmann. "But what if in the future we could use one million image captions instead? That's the core tenet of Drive-By Science, " he said. "If the rover can return text labels and captions that were scientifically validated, our mission team would have a lot more to go on."

Mattmann and the team adapted Google's Show and Tell software—a neural image caption generator first launched in 2014—for the rover missions, the first non-Google application of the technology.

The algorithm takes in images and spits out human-readable captions. These include basic, but critical information, like cardinality—how many rocks, how far away?—and properties like the vein structure in outcrops near bedrock. "The types of science knowledge that we currently use images for to decide what's interesting, " Mattmann said.

De afgelopen jaren is planetary geologists have labeled and curated Mars-specific image annotations to train the model.

"We use the one million captions to find 100 more important things, " Mattmann said. "Using search and information retrieval capabilities, we can prioritize targets. Humans are still in the loop, but they're getting much more information and are able to search it a lot faster."

Results of the team's work appear in the September 2020 issue of Planetary and Space Science .

TACC's supercomputers proved instrumental in helping the JPL team test the system. On Maverick 2, the team trained, validated, and improved their model using 6, 700 labels created by experts.

The ability to travel much farther would be a necessity for future Mars rovers. An example is the Sample Fetch Rover, proposed to be developed by the European Space Association and launched in late 2020s, whose main task will be to pick up samples dug up by the Mars 2020 rover and collect them.

"Those rovers in a period of years would have to drive 10 times further than previous rovers to collect all the samples and to get them to a rendezvous site, " Mattmann said. "We'll need to be smarter about the way we drive and use energy."

Before the new models and algorithms are loaded onto a rover destined for space, they are tested on a dirt training ground next to JPL that serves as an Earth-based analog for the surface of Mars.

The team developed a demonstration that shows an overhead map, streaming images collected by the rover, and the algorithms running live on the rover, and then exposes the rover doing terrain classification and captioning on board. They had hoped to finish testing the new system this spring, but COVID-19 shuttered the lab and delayed testing.

Ondertussen, Ono and his team developed a citizen science app, AI4Mars, that allows the public to annotate more than 20, 000 images taken by the Curiosity rover. These will be used to further train machine learning algorithms to identify and avoid hazardous terrains.

The public have generated 170, 000 labels so far in less than three months. "People are excited. It's an opportunity for people to help, " Ono said. "The labels that people create will help us make the rover safer."

The efforts to develop a new AI-based paradigm for future autonomous missions can be applied not just to rovers but to any autonomous space mission, from orbiters to fly-bys to interstellar probes, Ono says.

"The combination of more powerful on-board computing power, pre-planned commands computed on high performance computers like those at TACC, and new algorithms has the potential to allow future rovers to travel much further and do more science."

Op polyoxometalaat gebaseerde coördinatiekaders voor de vorming van methaan bij de fotoreductie van koolstofdioxide

Op polyoxometalaat gebaseerde coördinatiekaders voor de vorming van methaan bij de fotoreductie van koolstofdioxide Een nieuwe methode kan tomaten veiliger maken om te eten

Een nieuwe methode kan tomaten veiliger maken om te eten 3 eenvoudige wetenschapshacks om je Thanksgiving te maken Maaltijd Tastier

3 eenvoudige wetenschapshacks om je Thanksgiving te maken Maaltijd Tastier Hoop op nieuwe katalysatoren met hoge activiteit

Hoop op nieuwe katalysatoren met hoge activiteit Onderzoekers beeld atomaire structuur van belangrijke immuunregulator af

Onderzoekers beeld atomaire structuur van belangrijke immuunregulator af

Vervuild Libanonmeer spuwt tonnen dode vis uit

Vervuild Libanonmeer spuwt tonnen dode vis uit Gemeentelijke obligatierendementen laten zien dat beleggers bereid zijn premie te betalen voor schulden die klimaatverandering aanpakken

Gemeentelijke obligatierendementen laten zien dat beleggers bereid zijn premie te betalen voor schulden die klimaatverandering aanpakken Natuurlijke ecosystemen beschermen tegen klimaatverandering

Natuurlijke ecosystemen beschermen tegen klimaatverandering Koralen overleven om het verhaal van de nieuwste eilanduitbarsting van de aarde te vertellen

Koralen overleven om het verhaal van de nieuwste eilanduitbarsting van de aarde te vertellen Studie werpt nieuw inzicht op bosverlies en -degradatie in het Braziliaanse Amazonegebied

Studie werpt nieuw inzicht op bosverlies en -degradatie in het Braziliaanse Amazonegebied

Hoofdlijnen

- RNA-ontdekking kan de plantwarmte helpen verhogen, droogtetolerantie

- Moeten we de genen van buitengewone mensen sparen voor klonen?

- Meisjes zullen jongens zijn:geslachtsverandering bij drakenhagedissen

- Factoren die betrokken zijn bij celdifferentiatie

- Welke voordelen bieden celwanden plantencellen die contact maken met zoet water?

- Nieuwe high-throughput sequencing-technologieën onthullen een wereld van op elkaar inwerkende micro-organismen

- 3 fasen van interfase

- Is de Krebs-cyclus aëroob of anaëroob?

- Hoe je geur te verbergen voor honden

- Staat de enorme vulkaan op Jupiters maan Io deze maand op uitbarsten?

- Ponsen boven zijn gewicht, een bruine dwerg lanceert een parsec-schaal jet

- Tatooine-planeten ter grootte van de aarde kunnen bewoonbaar zijn

- NASA bouwt zijn volgende Mars rover-missie

- OSIRIS-REx ontdekt water op asteroïde, bevestigt Bennu als uitstekend missiedoel

Onderzoekers ontwikkelen dun hitteschild voor supersnelle vliegtuigen

Onderzoekers ontwikkelen dun hitteschild voor supersnelle vliegtuigen Satellietsensor EPIC detecteert aerosolen in de atmosfeer van de aarde

Satellietsensor EPIC detecteert aerosolen in de atmosfeer van de aarde Inteelt en populatie/demografische verschuivingen kunnen hebben geleid tot het uitsterven van de Neanderthalers

Inteelt en populatie/demografische verschuivingen kunnen hebben geleid tot het uitsterven van de Neanderthalers Hout omzetten in voedsel

Hout omzetten in voedsel Een Bobcat ontwijken

Een Bobcat ontwijken Wereldwijd ijsverlies neemt in recordtempo toe

Wereldwijd ijsverlies neemt in recordtempo toe Offshore olie- en gasplatforms stoten meer methaan uit dan eerder geschat

Offshore olie- en gasplatforms stoten meer methaan uit dan eerder geschat Duitse invallen wegens vermoedelijke Mitsubishi-dieselfraude

Duitse invallen wegens vermoedelijke Mitsubishi-dieselfraude

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com