Wetenschap

Onderzoekers pleiten voor gebruik, regulering van AI

Krediet:CC0 Publiek Domein

Kunstmatige intelligentie lijkt "ongelijkheid te vergroten, " en de inzet ervan moet worden onderworpen aan strenge voorschriften en limieten, vooral voor gevoelige technologieën zoals gezichtsherkenning, een onderzoeksrapport zei donderdag.

Het AI Now Instituut, een centrum van de New York University dat de sociale implicaties van kunstmatige intelligentie bestudeert, zei dat naarmate deze technologieën wijdverbreid worden, de negatieve effecten beginnen zich te manifesteren.

Het 93 pagina's tellende rapport onderzocht zorgen die werden geuit "van AI-geactiveerd management van werknemers, tot algoritmische bepaling van uitkeringen en sociale diensten, voor het bewaken en volgen van immigranten en ondervertegenwoordigde gemeenschappen, ’ schreven de onderzoekers.

"Wat duidelijk wordt, is dat in verschillende domeinen en contexten, AI vergroot de ongelijkheid, het plaatsen van informatie en controle in de handen van degenen die al macht hebben en het verder ontkrachten van degenen die dat niet hebben."

De onderzoekers zeiden dat AI-systemen worden ingezet in gebieden zoals gezondheidszorg, opleiding, werkgelegenheid, strafrecht "zonder passende waarborgen of verantwoordingsstructuren."

Volgens het rapport moeten regeringen en bedrijven het gebruik van gezichtsherkenning stopzetten "in gevoelige sociale en politieke contexten" totdat de risico's beter worden begrepen, en die ene subset - 'herkenning van invloed' of het lezen van emoties door computertechnologie - moet worden verboden in het licht van twijfels of het werkt.

Emotieherkenning "mag geen rol spelen bij belangrijke beslissingen over mensenlevens, zoals wie wordt geïnterviewd of aangenomen voor een baan, de prijs van de verzekering, pijnbeoordelingen van patiënten, of leerlingprestaties op school, " aldus het rapport.

Het riep ook op tot technische werknemers "het recht te hebben om te weten wat ze bouwen en om onethisch of schadelijk gebruik van hun werk aan te vechten."

Het AI Now-rapport zei dat medische organisaties die geavanceerde technologieën gebruiken, gegevensbeschermingsbeleid moeten implementeren en mensen "positieve goedkeuring" moeten geven om zich terug te trekken uit de studie of behandeling, en van onderzoek met behulp van hun medische informatie.

Breder, de onderzoekers zeiden dat de AI-industrie "structurele veranderingen" moet doorvoeren om ervoor te zorgen dat algoritmen racisme niet versterken, vooroordelen of gebrek aan diversiteit.

"De AI-industrie is opvallend homogeen, grotendeels te danken aan de behandeling van vrouwen, mensen van kleur, gender minderheden, en andere ondervertegenwoordigde groepen, " aldus het rapport.

Er worden inspanningen geleverd om AI-systemen te reguleren, maar "worden voorbijgestreefd door de goedkeuring door de overheid van AI-systemen voor toezicht en controle, " volgens het rapport.

"Ondanks de groeiende publieke bezorgdheid en regelgevende maatregelen, de uitrol van gezichtsherkenning en andere risicovolle AI-technologieën is nauwelijks vertraagd, ’ schreven de onderzoekers.

"Zogenaamde 'smart city'-projecten over de hele wereld consolideren de macht over het maatschappelijk leven in de handen van technologiebedrijven met winstoogmerk, waardoor ze verantwoordelijk zijn voor het beheer van kritieke bronnen en informatie."

© 2019 AFP

Bladluis-gestresste dennen vertonen verschillende secundaire organische aerosolvorming

Bladluis-gestresste dennen vertonen verschillende secundaire organische aerosolvorming Wat is wolfraam staal?

Wat is wolfraam staal?

Staal, een legering van ijzer en koolstof, is er in veel verschillende soorten. Gemengd met andere metalen neemt het verschillende eigenschappen aan. Tungsten was een van de eerste metalen die werd gebruikt om staal te verbet

Onderzoekers kijken in de databank van waterclusters, treinnetwerk om energielandschappen te voorspellen

Onderzoekers kijken in de databank van waterclusters, treinnetwerk om energielandschappen te voorspellen Chemici synthetiseren elektroden voor accu's uit koffiedik

Chemici synthetiseren elektroden voor accu's uit koffiedik Een-twee-stempel katalysatoren die koolstofdioxide opvangen voor schonere brandstoffen

Een-twee-stempel katalysatoren die koolstofdioxide opvangen voor schonere brandstoffen

Hoofdlijnen

- Bacteriën levenscyclus

- De chemie van melanine

- Vogels zonder eigen broed helpen andere vogels met opvoeden, maar niet onbaatzuchtig

- Overeenkomsten en verschillen tussen osmose en diffusie

- Verschillen en overeenkomsten tussen Unicellular & Cellular

- Waarom heeft de evolutie ons niet het vermogen gegeven om zoet water te ruiken?

- Hoe uw dieet het dierenwelzijn kan verbeteren

- Hoe maak je een celmodel van een Amoeba

- Wat is een Mordant in de microbiologie?

- Silicon Valley uitvinder van knippen, kopieer en plak sterft

- Zonnepark in Kings Park om 1 van stroom te voorzien 000 woningen

- Tesla-aandelen vallen opnieuw door twijfels over go-private deal

- Apple onthult potloodondersteuning voor iPad van $ 329 op schoolevenement

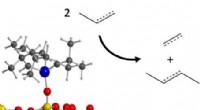

- Oppervlakte-organometaalchemie zou nieuwe wegen kunnen openen voor synthetische brandstoffen en energiedragers

Volksgezondheidsdeskundige:we moeten naar een nieuw type normaal gaan

Volksgezondheidsdeskundige:we moeten naar een nieuw type normaal gaan Kunstmatige intelligentie leert elementaire deeltjessignalen voorspellen

Kunstmatige intelligentie leert elementaire deeltjessignalen voorspellen Juno-ruimtevaartuig vliegt 10 juli over Jupiters Grote Rode Vlek

Juno-ruimtevaartuig vliegt 10 juli over Jupiters Grote Rode Vlek Professioneel, niet persoonlijk, vertrouwdheid werkt voor virtuele teams

Professioneel, niet persoonlijk, vertrouwdheid werkt voor virtuele teams Onderzoekers onderzoeken eigenschappen van supernova SN 2012au

Onderzoekers onderzoeken eigenschappen van supernova SN 2012au GPM-satelliet onderzocht tropische storm Chris-kracht

GPM-satelliet onderzocht tropische storm Chris-kracht Onderzoekers identificeren zeven soorten nepnieuws, helpen bij een betere detectie

Onderzoekers identificeren zeven soorten nepnieuws, helpen bij een betere detectie Welke organen werken met het oog?

Welke organen werken met het oog?

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com