Wetenschap

De kruising van visie en taal

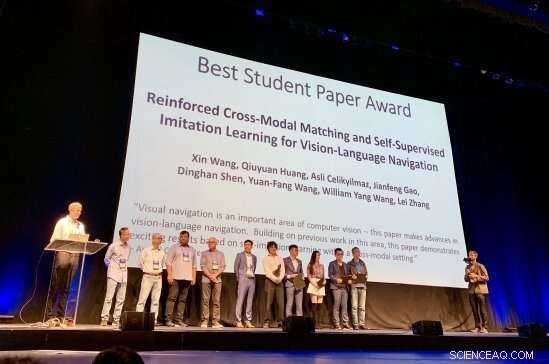

De onderzoekers achter de CVPR Best Student Paper Award 2019 worden erkend voor hun werk Credit:Matthew Turk

Negenduizend tweehonderd onderzoekers op het gebied van kunstmatige intelligentie. Vijfduizend honderdvijfenzestig onderzoekspapers ingediend, waarvan slechts 1 300 werden aangenomen. Een beste studentenkrant.

En de prijs ging naar:UC Santa Barbara, informatica-promovendus Xin Wang. Zijn studentenkrant, "Versterkte cross-modale matching en zelf-gecontroleerd imitatieleren voor visie-taalnavigatie, " kwam naar voren als nummer 1 in zijn categorie op de 31e IEEE / CVF-conferentie over computervisie en patroonherkenning (CVPR), een van de belangrijkste conferenties op het gebied van informatica van vandaag. De prijsuitreiking vond plaats in Long Beach, op dinsdag, 18 juni.

"Xin begon in 2017 met mij te werken als promovendus op onderwerpen gerelateerd aan taal- en visieonderzoek, " zei William Wang, assistent-professor bij de afdeling Computerwetenschappen aan het UCSB's College of Engineering. "Sinds maart 2018 we hebben het zicht-taal-navigatieprobleem bestudeerd:hoe gebruik je verbale instructies om robots te leren bestemmingen te targeten, zonder toegang tot een kaart?"

Een robot die kan navigeren op basis van visie en taken kan uitvoeren onder instructies in gewone taal klinkt als sciencefiction, maar het is dichter bij de realiteit dan je zou denken.

"Ik werk al een tijdje op het snijvlak van visie en taal, "Xin Wang zei:"en ik geloof dat een van de grote bewegingen van AI is om robots te laten interageren met de visuele en fysieke wereld, vooral via natuurlijke taal.

"Vision-taalnavigatie kan veel praktische toepassingen mogelijk maken, bijvoorbeeld, robots in huis, " ging hij verder. "Iedereen, vooral gehandicapten, kan de robot vragen om bepaalde taken uit te voeren, bijvoorbeeld 'Ga naar de keuken en breng een kopje water naar me toe.' Visie-taalnavigatie dient als een basistaak om zowel visuele scènes als natuurlijke taalinstructies te begrijpen, evenals fysieke acties uitvoeren om banen op hoog niveau te vervullen."

Maar wat zo natuurlijk is voor mensen - navigeren door een scène en taken uitvoeren met behulp van realtime omgevingssignalen en menselijke concepten - vereist een flexibele, maar elegant kader waarin robots kunnen leren om de gegevens die ze oppikken te verbinden met de betekenis van de instructies die ze krijgen. Het is een iteratief proces, versterking nodig hebben, feedback en aanpassing. het werk van Xin Wang, volgens zijn adviseur "Introduceert verschillende innovatieve ideeën om de veralgemening van het vision-taal-navigatie-algoritme te verbeteren."

"Deze doorbraak in taal- en visieonderzoek stelt robots in staat om mensen beter te helpen bij veel dagelijkse en speciale routines, inclusief schoonmaak en onderhoud van het huis, item zoeken en ophalen, afstandsbediening, blinden helpen, rampenbestrijding, enzovoort, William Wang zei. "Het heeft het potentieel om miljoenen mensen te beïnvloeden en de levenskwaliteit van mensen te verbeteren, inclusief het bevrijden van mensen van vervelende huishoudelijke taken, zodat we tijd kunnen maken voor creatieve activiteiten."

Het onderzoek voor de CVPR Best Student Paper 2019, die voortbouwt op eerdere samenwerkingen bij UCSB op het gebied van modelgebaseerd en modelvrij versterkend leren met Ph.D. student Wenhan Xiong, is in de zomer van 2018 uitgevoerd tijdens een stage bij Microsoft Research (MSR), onder mentoren Qiuyuan Huang, Asli Celikyilmaz, Jianfeng Gao en Lei Zhang.

Volgens de CVPR Best Paper commissie, "Visuele navigatie is een belangrijk gebied van computervisie - dit document boekt vooruitgang in navigatie in vision-taal. Voortbouwend op eerder werk op dit gebied, dit artikel demonstreert opwindende resultaten op basis van zelf-imitatie leren in een cross-modale setting."

"We willen Xin Wang en William Wang feliciteren met deze uiterst prestigieuze erkenning voor hun werk in een gebied dat aan de top van de computerwetenschap staat, " zei College of Engineering Dean Rod Alferness. "We zijn verheugd dat ze deel uitmaken van de UCSB-gemeenschap."

"Ik ben zeer vereerd met deze prijs, " zei Xin Wang. "Ik wil mijn adviseurs William en Yuan-Fang oprecht bedanken, en de MSR-medewerkers voor hun krachtige steun en waardevolle begeleiding. Wat de toekomst betreft, Ik hoop dat steeds meer onderzoekers kunnen werken aan deze spannende en noodzakelijke onderzoeksrichting, naar meer praktische en interactieve robots die visie en taal voor mensen overbruggen. Ik zal me er zeker voor inzetten om het voor elkaar te krijgen."

Nieuw NIST-onderzoek kan de kosten van het maken van stuivers verlagen

Nieuw NIST-onderzoek kan de kosten van het maken van stuivers verlagen Een hologramprojector maken

Een hologramprojector maken Nieuwe inzichten in processen op moleculair niveau kunnen corrosie helpen voorkomen en de katalytische conversie verbeteren

Nieuwe inzichten in processen op moleculair niveau kunnen corrosie helpen voorkomen en de katalytische conversie verbeteren Elementen die worden gebruikt voor het maken van X-Rays

Elementen die worden gebruikt voor het maken van X-Rays CRISPR/Cas-gendoping detecteren

CRISPR/Cas-gendoping detecteren

Wanhopige Grieken vluchten als branden het eiland Evia verwoesten

Wanhopige Grieken vluchten als branden het eiland Evia verwoesten Het lot van tropische bossen op de lange termijn is misschien niet zo nijpend als gedacht, studie zegt:

Het lot van tropische bossen op de lange termijn is misschien niet zo nijpend als gedacht, studie zegt: Wat zijn de functies van fotosynthese?

Wat zijn de functies van fotosynthese?  Moss tapijten helpen erosie te stoppen

Moss tapijten helpen erosie te stoppen Wetenschappers hanteren een metamaterialenbenadering van aardbevingsschade

Wetenschappers hanteren een metamaterialenbenadering van aardbevingsschade

Hoofdlijnen

- Instructies voor het maken van een JELL-O Cell

- Nucleïnezuurfuncties

- De twee soorten exocriene secretoire cellen in de maag

- De sleutelrol van enzymen in de embryonale ontwikkeling begrijpen

- Wat veroorzaakt psychische aandoeningen?

- Nieuw onderzoek benadrukt de noodzaak om te leren van klimaatveranderingen uit het verleden

- Hoe beïnvloedt het hebben van twee van elk soort chromosoom de genen die een persoon heeft?

- Deze boom is het oudste levende organisme van Europa - een soort van,

- Vijf soorten isolatie in de biologie

- Hardwareversnellers aan het werk zetten met automatische codevertaling

- Drone-ontwerpen komen voort uit vlinderstudie:golvende vlucht bespaart vorsten energie

- Onderzoekers ontdekken nieuwe tweedimensionale halfgeleider

- Bosch wil leemtes opvullen over autoveiligheid in elektrische voertuigen

- Google ontkomt niet aan auteursrechtwetten:Frances Macron

Wat is het Human Epigenome Project?

Wat is het Human Epigenome Project?  Superaarde ontdekt:gegevens zullen planetaire atmosfeermodellen karakteriseren

Superaarde ontdekt:gegevens zullen planetaire atmosfeermodellen karakteriseren Een kristallen bruiloft in de nanokosmos

Een kristallen bruiloft in de nanokosmos Nieuwe elektrodeconfiguratie verbetert de volumetrische prestaties van supercondensatoren

Nieuwe elektrodeconfiguratie verbetert de volumetrische prestaties van supercondensatoren Koolstofneutrale oplossing voor ontzilting:geothermische bronnen aanboren

Koolstofneutrale oplossing voor ontzilting:geothermische bronnen aanboren Bioplastics bevatten stoffen die net zo giftig zijn als die in gewone plastics

Bioplastics bevatten stoffen die net zo giftig zijn als die in gewone plastics Marskrater herinnert aan Apollo-maanwandeling

Marskrater herinnert aan Apollo-maanwandeling Smartphones kunnen worden gebruikt om het weer beter te voorspellen

Smartphones kunnen worden gebruikt om het weer beter te voorspellen

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com