Wetenschap

Efficiënte evaluatie van de robuustheid van AI-modellen met beperkte toegang

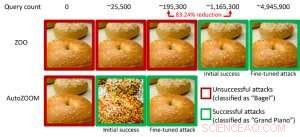

Afbeelding 1:Prestatievergelijking bij het omzetten van een bagelafbeelding in een vijandige bagelafbeelding geclassificeerd als een "vleugel" met behulp van ZOO- en AutoZOOM-aanvallen. Krediet:IBM

Recente onderzoeken hebben het gebrek aan robuustheid in de huidige AI-modellen vastgesteld tegen voorbeelden van tegenstanders:opzettelijk gemanipuleerde voorspellingsontwijkende gegevensinvoer die vergelijkbaar is met normale gegevens, maar ervoor zorgt dat goed opgeleide AI-modellen zich misdragen. Bijvoorbeeld, visueel onmerkbare verstoringen van een stopbord kunnen gemakkelijk worden gemaakt en een zeer nauwkeurig AI-model leiden tot misclassificatie. In onze vorige paper gepubliceerd op de European Conference on Computer Vision (ECCV) in 2018, we hebben gevalideerd dat 18 verschillende classificatiemodellen getraind op ImageNet, een grote dataset voor herkenning van openbare objecten, zijn allemaal kwetsbaar voor vijandige verstoringen.

Opmerkelijk, vijandige voorbeelden worden vaak gegenereerd in de "white-box"-instelling, waarbij het AI-model volledig transparant is voor een tegenstander. In de praktijksituatie bij het inzetten van een zelfgetraind AI-model als een service, zoals een online beeldclassificatie-API, men kan ten onrechte denken dat het robuust is voor voorbeelden van tegenstanders vanwege beperkte toegang en kennis over het onderliggende AI-model (ook bekend als de "black-box" -instelling). Echter, ons recente werk gepubliceerd op AAAI 2019 toont aan dat de robuustheid als gevolg van beperkte modeltoegang niet gegrond is. We bieden een algemeen raamwerk voor het genereren van tegenstrijdige voorbeelden van het beoogde AI-model met alleen de input-outputreacties van het model en enkele modelquery's. In vergelijking met het vorige werk (ZOO-aanval), ons voorgestelde kader, genaamd AutoZOOM, vermindert gemiddeld ten minste 93% modelquery's terwijl vergelijkbare aanvalsprestaties worden bereikt, het bieden van een query-efficiënte methodologie voor het evalueren van de robuustheid van KI-systemen met beperkte toegang. Een illustratief voorbeeld wordt getoond in figuur 1, waar een vijandige bagelafbeelding die is gegenereerd op basis van een black-box-afbeeldingsclassificator, wordt geclassificeerd als het aanvalsdoel "vleugel". Dit artikel is geselecteerd voor mondelinge presentatie (29 januari, 11:30-12:30 @ Coral 1) en posterpresentatie (29 januari, 18.30-20.30 uur) op AAAI 2019.

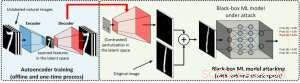

In de whitebox-instelling, vijandige voorbeelden worden vaak gemaakt door gebruik te maken van de gradiënt van een ontworpen aanvalsdoel ten opzichte van de gegevensinvoer voor het begeleiden van vijandige verstoring, wat vereist dat u de modelarchitectuur kent, evenals de modelgewichten voor gevolgtrekking. Echter, in de blackbox-instelling is het verwerven van de gradiënt onhaalbaar vanwege de beperkte toegang tot deze modeldetails. In plaats daarvan, een tegenstander heeft alleen toegang tot de input-outputreacties van het ingezette AI-model, net als gewone gebruikers (bijv. upload een afbeelding en ontvang de voorspelling van een online afbeeldingsclassificatie-API). Tijdens de ZOO-aanval werd voor het eerst aangetoond dat het genereren van vijandige voorbeelden van modellen met beperkte toegang mogelijk is met behulp van gradiëntschattingstechnieken. Echter, het kan een enorme hoeveelheid modelquery's kosten om een vijandig voorbeeld te maken. Bijvoorbeeld, in figuur 1, Bij een ZOO-aanval zijn meer dan 1 miljoen modelquery's nodig om het vijandige bagelbeeld te vinden. Om de query-efficiëntie te versnellen bij het vinden van voorbeelden van tegenstanders in de black-box-instelling, ons voorgestelde AutoZOOM-raamwerk heeft twee nieuwe bouwstenen:(i) een adaptieve schattingsstrategie voor willekeurige gradiënten om het aantal zoekopdrachten en vervorming in evenwicht te brengen, en (ii) een autoencoder die ofwel offline is getraind met niet-gelabelde gegevens of een bilineaire resizing-bewerking voor versnelling. Voor (ik), AutoZOOM beschikt over een geoptimaliseerde en query-efficiënte gradiëntschatter, die een adaptief schema heeft dat weinig zoekopdrachten gebruikt om de eerste succesvolle tegenstrijdige verstoring te vinden en vervolgens meer zoekopdrachten gebruikt om de vervorming te verfijnen en het tegenstrijdige voorbeeld realistischer te maken. Voor (ii), zoals weergegeven in figuur 2, AutoZOOM implementeert een techniek genaamd "dimensiereductie" om de complexiteit van het vinden van tegenstrijdige voorbeelden te verminderen. De dimensiereductie kan worden gerealiseerd door een offline getrainde autoencoder om gegevenskenmerken vast te leggen of een eenvoudige bilineaire beeldresizer die geen training vereist.

Afbeelding 2:Illustratie van de techniek voor het verkleinen van dimensies die in AutoZOOM wordt gebruikt voor het inwisselen van query's. De decoder kan een offline getrainde autoencoder zijn of een bilineaire resizing-bewerking waarvoor geen training vereist is. Krediet:IBM

Met deze twee kerntechnieken, onze experimenten op black-box diepe neurale netwerkgebaseerde beeldclassificaties getraind op MNIST, CIFAR-10 en ImageNet laten zien dat AutoZOOM vergelijkbare aanvalsprestaties behaalt, terwijl het een significante vermindering (minstens 93%) van het gemiddelde aantal zoekopdrachten realiseert in vergelijking met de ZOO-aanval. Op ImageNet, deze drastische reductie betekent miljoenen minder modelquery's, waardoor AutoZOOM een efficiënt en praktisch hulpmiddel wordt voor het evalueren van de robuustheid van AI-modellen met beperkte toegang. Bovendien, AutoZOOM is een algemene versneller voor het inwisselen van zoekopdrachten die gemakkelijk kan worden toegepast op verschillende methoden voor het genereren van tegenstrijdige voorbeelden in de praktische black-box-omgeving.

De AutoZOOM-code is open source en is hier te vinden. Bekijk ook IBM's Adversarial Robustness Toolbox voor meer implementaties van vijandige aanvallen en verdedigingen.

Dit verhaal is opnieuw gepubliceerd met dank aan IBM Research. Lees hier het originele verhaal.

Hoe onze bossen zich aanpassen aan klimaatverandering

Hoe onze bossen zich aanpassen aan klimaatverandering NASA-satelliet ontdekt dat orkaan Florence de oogmuren ondergaat

NASA-satelliet ontdekt dat orkaan Florence de oogmuren ondergaat Branden in Californië brengen meer reddingen met helikopters, stroomuitschakelingen

Branden in Californië brengen meer reddingen met helikopters, stroomuitschakelingen Oceanische dode zones bloeiden tijdens de laatste ijstijd, nieuw bewijs toont

Oceanische dode zones bloeiden tijdens de laatste ijstijd, nieuw bewijs toont EPA-chef belooft het opruimen van vervuiling door Superfund te stroomlijnen

EPA-chef belooft het opruimen van vervuiling door Superfund te stroomlijnen

Hoofdlijnen

- Eksters kunnen vriendschappen sluiten met mensen - dit is hoe

- Wat is een homoloog allel?

- Doorbraak in genetisch onderzoek om gerstproductie te stimuleren

- Hoe het boren naar olie in het Arctic National Wildlife Refuge van invloed kan zijn op dieren in het wild

- Transformatie, transductie en vervoeging: gentransfer in Prokaryotes

- Hoe geel en blauw groen maken bij papegaaien

- The Krebs Cycle Made Easy

- Oudste Homo Sapiens-fossielen die ooit zijn gevonden, suggereren een herschrijving van menselijke evolutie

- Nieuwe gen-editor gebruikt om ziekte in embryo's op te lossen:studie

- Wetenschappers zetten koolstofemissies om in bruikbare energie

- De nieuwste:klachten versus Google, Facebook onder nieuwe EU-wetgeving

- SMAC in de DARQ:de technische trends die 2020 vormgeven

- Amazon onderzoekt datalekken van personeel

- Tesla benoemt nieuwe bestuursvoorzitter in schikking met toezichthouders (update)

Nieuwe antimicrobiële coating kan de sleutel zijn in de strijd tegen ziekenhuisinfecties

Nieuwe antimicrobiële coating kan de sleutel zijn in de strijd tegen ziekenhuisinfecties Houtdocumenten De impact van orkaan Doriërs op de Bahama's

Houtdocumenten De impact van orkaan Doriërs op de Bahama's Onderzoekers ontwikkelen afstembare microdeeltjes die kunnen worden samengevoegd tot grotere structuren

Onderzoekers ontwikkelen afstembare microdeeltjes die kunnen worden samengevoegd tot grotere structuren Waarom waren vastbesloten om veiligheidsadviezen te negeren tijdens een hittegolf?

Waarom waren vastbesloten om veiligheidsadviezen te negeren tijdens een hittegolf? Baidu-winst stijgt met 45% door groei in nieuws-app en AI-push

Baidu-winst stijgt met 45% door groei in nieuws-app en AI-push Een licht schijnen op de betrouwbaarheid van elektriciteit in Sub-Sahara Afrika

Een licht schijnen op de betrouwbaarheid van elektriciteit in Sub-Sahara Afrika Verschil tussen een staafdiagram & cirkeldiagram

Verschil tussen een staafdiagram & cirkeldiagram  Londense politie zet gezichtsscantechnologie in, angst voor privacy aanwakkeren

Londense politie zet gezichtsscantechnologie in, angst voor privacy aanwakkeren

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com