Wetenschap

Pixel 3:Een wending naar machine learning voor diepteschattingen

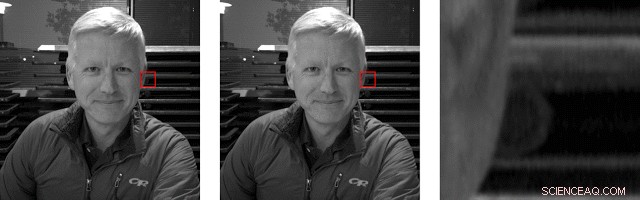

De twee PDAF-afbeeldingen links en in het midden lijken erg op elkaar, maar in de uitsnede rechts zie je de parallax ertussen. Het valt het meest op aan de cirkelvormige structuur in het midden van het gewas. Krediet:Google-blog

TechSpot zegt wat het denkt over de Pixel 3 en het is geen advertentie:"Pixel 3 is misschien wel de beste cameratelefoon op de markt." Tyler Lee in Ubergizmo staat in de volledige complimentenmodus. "Het lijdt geen twijfel dat al het harde werk en onderzoek van Google zijn vruchten heeft afgeworpen, aangezien de Pixel 3 een van de betere camera's heeft die er zijn."

OKE, we begrijpen het. In de altijd gedrang van leveranciers om de smartphonemarkt te overweldigen, Pixel 3 markeert met succes zijn eigen terrein als de telefoon met zeer goede cameramogelijkheden. En, nu, een recente blog op de Google AI-blog zal Pixel 3-fans alleen maar bekoren, omdat het beschrijft hoe "Portretmodus" werd bereikt op Pixel 3.

Denk aan een team dat zich richt op machine learning, TensorFlow en diepteperceptiedoelen tot in de puntjes.

Scott Adam Gordon in Android-autoriteit deelde met lezers wat nogal slim was aan de aanpak en technieken van Google. "Met de camera van de Google Pixel 3, Google heeft meer diepte-aanwijzingen toegevoegd om dit vervagingseffect te informeren voor een grotere nauwkeurigheid. Evenals parallax, Google gebruikte scherpte als diepte-indicator - verder weg gelegen objecten zijn minder scherp dan dichterbij gelegen objecten - en objectidentificatie in de echte wereld. Bijvoorbeeld, de camera kan het gezicht van een persoon in een scène herkennen, en bereken hoe dichtbij of ver het was op basis van het aantal pixels ten opzichte van objecten eromheen."

Rahul Garg, onderzoeker en Neal Wadhwa, software ontwikkelaar, de blog geplaatst. "Dit jaar, op de Pixel 3, we gaan over op machine learning om de diepte-inschatting te verbeteren en nog betere resultaten in de portretmodus te produceren."

(Google hield tot nu toe de magie voor zichzelf, zei Isaiah Mayersen in TechSpot . "Terwijl Google de weg blijft effenen voor smartphonefotografie, we zullen moeten afwachten wat concurrenten naar de tafel brengen.")

Wacht, wat is portretmodus? Webopedia , bedankt:

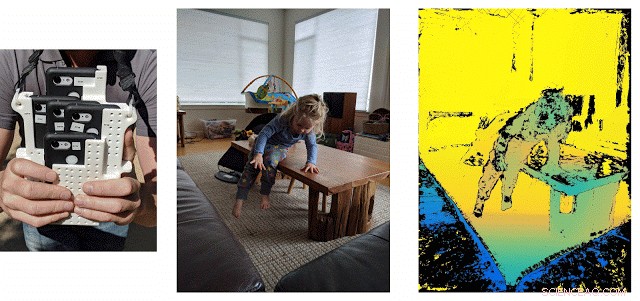

Links:Custom rig gebruikt om trainingsgegevens te verzamelen. Midden:een voorbeeld van het wisselen tussen de vijf afbeeldingen. Synchronisatie tussen de camera's zorgt ervoor dat we diepte kunnen berekenen voor dynamische scènes, zoals deze. Rechts:Grondwaarheidsdiepte. Lage vertrouwenspunten, d.w.z., punten waar stereo-overeenkomsten niet betrouwbaar zijn vanwege de zwakke textuur, zijn zwart gekleurd en worden niet gebruikt tijdens de training. Krediet:Sam Ansari en Mike Milne

"In fotografie en digitale fotografie, portretmodus is een functie van de digitale camera die wordt gebruikt wanneer u foto's maakt van een enkel onderwerp. Wanneer u foto's maakt in de portretmodus, de digitale camera gebruikt automatisch een groot diafragma om de achtergrond onscherp te houden door een kleine scherptediepte te gebruiken, zodat het onderwerp dat wordt gefotografeerd het enige is waarop is scherpgesteld."

Niet alleen het enkele onderwerp, maar meer:"Niet alleen zal de persoon in het portret scherp zijn, items in de buurt van datzelfde scherpstelvlak zullen ook scherper zijn, met een realistische toenemende onscherpte naarmate items zich verder voor en achter dat vlak bevinden, " zei Ryne Hager in Android-politie .

Heb het? Achtergrond opzettelijk onscherp; het onderwerp heeft de maximale impact in focus. Deze techniek wordt vaak gebruikt in advertenties en promotionele berichten om maximale aandacht op een gezicht te vestigen door de achtergrond te vervagen.

Google had wat foto's nodig om zijn AI te trainen. Voer in als een klontje met 5 telefoons - ok, beleefder gezegd, een verzameling van vijf telefoons. Ze spraken over dieptekaarten, trainingsgegevens en deze assemblage, de "Frankenfoon, " een tuig met 5 telefoons, alle Pixel 3, en op wifi gebaseerde oplossing.

CNET beschreef Frankenphone. "Een vijftal telefoons op elkaar geklemd genereerde de gegevens om de Pixel 3 te trainen om diepte te beoordelen." Stephen Shankland beschreef een "gehackte groep van vijf telefoons om de werking van de functie in de Pixel 3 van dit jaar te verbeteren."

Ze gebruikten TensorFlow Lite, een platformonafhankelijke oplossing voor het uitvoeren van machine learning-modellen op mobiele en embedded apparaten, en de GPU van de Pixel 3 om snel diepte te berekenen. Vervolgens, ze combineerden de resulterende diepteschattingen met maskers van hun "neuraal netwerk voor persoonssegmentatie om prachtige resultaten in de portretmodus te produceren."

Waarom dit van belang is, vereist niet veel analyse:mooiere opnamen in de portretmodus.

In het grotere geheel van smartphones die foto's maken, leveranciers accepteren dat hun verkooppraatje het beste verleidelijke camerafuncties kan bevatten. De computationele fotografiemethoden van Google kunnen Pixel een echt voordeel geven. "Smartphones hebben kleine beeldsensoren die qua beeldkwaliteit niet kunnen concurreren met traditionele camera's, maar Google loopt voorop met computationele fotografiemethoden die dingen kunnen doen zoals wazige achtergronden, resolutie verhogen, blootstelling aanpassen, schaduwdetails verbeteren en foto's maken in het donker, " zei Stephen Shankland, CNET.

© 2018 Wetenschap X Netwerk

Nieuw onderzoek vindt manieren om de nauwkeurigheid van laterale flowtests te verbeteren

Nieuw onderzoek vindt manieren om de nauwkeurigheid van laterale flowtests te verbeteren Vrijstaande microwire-array maakt flexibel zonnevenster mogelijk

Vrijstaande microwire-array maakt flexibel zonnevenster mogelijk Onderzoekers ontwikkelen katalysator voor selectieve omzetting van reactieve lithiumverbindingen

Onderzoekers ontwikkelen katalysator voor selectieve omzetting van reactieve lithiumverbindingen Was aan, wegsmelten

Was aan, wegsmelten Een veelbelovende strategie om de activiteit in antimicrobiële peptiden te verhogen

Een veelbelovende strategie om de activiteit in antimicrobiële peptiden te verhogen

Waarom heeft iedereen het over natuurlijke sequentielandbouw?

Waarom heeft iedereen het over natuurlijke sequentielandbouw? Pandemie en aanstaande stimuleringsfondsen kunnen klimaatdoelen in zicht brengen - of niet

Pandemie en aanstaande stimuleringsfondsen kunnen klimaatdoelen in zicht brengen - of niet Toenemende fabrieks- en auto-emissies verstoren de natuurlijke cyclus in de Oost-Chinese Zee

Toenemende fabrieks- en auto-emissies verstoren de natuurlijke cyclus in de Oost-Chinese Zee 38 doden door toenemende overstromingen in Mozambique na tweede cycloon

38 doden door toenemende overstromingen in Mozambique na tweede cycloon Ongerepte Antarctische fjorden bevatten vergelijkbare hoeveelheden microplastics als open oceanen in de buurt van grote beschavingen

Ongerepte Antarctische fjorden bevatten vergelijkbare hoeveelheden microplastics als open oceanen in de buurt van grote beschavingen

Hoofdlijnen

- Hartmonitors op wilde narwallen onthullen alarmerende reacties op stress

- Octopussen gestrand op het strand van Wales - hier zijn de wetenschappelijke theorieën waarom

- Rollen van celorganellen in mitose

- Verspilde vogelveren veranderd in voedsel

- Wat is een eencellige eukaryoot?

- Wat is Meiotic Interphase?

- Make-up en wetenschap Eerlijke ideeën

- De rol van microben in de industrie

- Onverwachte bevinding in de energiecentrale van cellen

- Burgerwetenschappers volgen straling zeven jaar na Fukushima

- WK-koorts zorgt voor slapeloze nachten voor vlaggenmakers in Bangladesh

- Termietendarmmicroben halen schone energie uit steenkool

- Samsung Electronics signaleert daling van 56% in bedrijfsresultaat Q2

- Navigatiemethode kan autonome last-mile levering versnellen

Eerste onderzoeksresultaten over de spectaculaire meteorietval van Flensburg

Eerste onderzoeksresultaten over de spectaculaire meteorietval van Flensburg Onderzoekers ontwikkelen duurzame energie-aanpak voor de productie van ammoniak

Onderzoekers ontwikkelen duurzame energie-aanpak voor de productie van ammoniak De weg vrijmaken voor kunstmatige fotosynthese:effect van doping op de fotokatalysator SrTiO3

De weg vrijmaken voor kunstmatige fotosynthese:effect van doping op de fotokatalysator SrTiO3 Pinterest-aandelen springen omhoog terwijl veranderingen hun vruchten afwerpen

Pinterest-aandelen springen omhoog terwijl veranderingen hun vruchten afwerpen Energieoogstontwerp is bedoeld om wifi-signalen om te zetten in bruikbare stroom

Energieoogstontwerp is bedoeld om wifi-signalen om te zetten in bruikbare stroom Beveiliging is een probleem dat kleine bedrijven moeten oplossen pronto

Beveiliging is een probleem dat kleine bedrijven moeten oplossen pronto Hoe de hoogte van een vlaggenmast te meten

Hoe de hoogte van een vlaggenmast te meten  Wetenschappers veranderen membraaneiwitten om ze gemakkelijker te bestuderen

Wetenschappers veranderen membraaneiwitten om ze gemakkelijker te bestuderen

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway | Italian |

-

Wetenschap © https://nl.scienceaq.com