Wetenschap

Wilt u dat computers beter zien in de echte wereld? Train ze in virtual reality

Wetenschappers hebben een nieuwe manier ontwikkeld om de manier waarop computers objecten in de echte wereld 'zien' en 'begrijpen' te verbeteren door de visuele systemen van de computers in een virtuele omgeving te trainen.

Het onderzoeksteam publiceerde hun bevindingen in IEEE/CAA Journal of Autmatica Sinica , een gezamenlijke publicatie van de IEEE en de Chinese Association of Automation.

Om computers objecten, zoals gebouwen, straten of mensen, de machines moeten vertrouwen op het verwerken van enorme hoeveelheden gelabelde gegevens, in dit geval, afbeeldingen van objecten met nauwkeurige annotaties. Een zelfrijdende auto, bijvoorbeeld, heeft duizenden afbeeldingen van wegen en auto's nodig om van te leren. Datasets spelen daarom een cruciale rol bij het trainen en testen van de computer vision-systemen. Met behulp van handmatig gelabelde trainingsdatasets, een computervisiesysteem vergelijkt zijn huidige situatie met bekende situaties en onderneemt de beste actie, wat dat ook mag zijn.

"Echter, het verzamelen en annoteren van afbeeldingen uit de echte wereld is te veeleisend in termen van arbeid en geldinvesteringen, " schrijft eerste auteur Kunfeng Wang, een universitair hoofddocent bij China's State Key Laboratory for Management and Control for Complex Systems. Wang zegt dat het doel van hun onderzoek is om de beperkingen van real-world beelddatasets te overwinnen, die onvoldoende zijn voor het trainen en testen van computers vision-systemen.

Om dit probleem op te lossen, Wang en zijn collega's hebben een dataset gemaakt met de naam ParallelEye. ParallelEye werd virtueel gegenereerd door gebruik te maken van in de handel verkrijgbare computersoftware, specifiek de videogame-engine Unity3D. Met behulp van een kaart van Zhongguancun, een van de drukste stedelijke gebieden in Peking, China, als hun referentie, ze creëerden virtueel een stedelijke omgeving door gebouwen toe te voegen, auto's en zelfs weersomstandigheden. Vervolgens plaatsten ze een virtuele "camera" op een virtuele auto. De auto reed rond in de virtuele Zhongguancun en creëerde datasets die representatief zijn voor de echte wereld.

Door hun "volledige controle" over de virtuele omgeving, Het team van Wang was in staat om uiterst specifieke bruikbare gegevens te creëren voor hun objectdetectiesysteem:een gesimuleerd autonoom voertuig. De resultaten waren indrukwekkend, het produceren van een duidelijke prestatieverbetering op bijna elke geteste metriek. Door op maat gemaakte datasets te ontwerpen, een grotere verscheidenheid aan autonome systemen zal praktischer zijn om te trainen.

Hoewel hun grootste prestatieverbeteringen het gevolg waren van het integreren van ParallelEye-datasets met real-world datasets, Wang's team heeft aangetoond dat hun methode in staat is om gemakkelijk verschillende sets afbeeldingen te maken. "Met behulp van het ParallelEye-visieraamwerk, enorme en gediversifieerde beelden kunnen flexibel worden gesynthetiseerd, en dit kan helpen bij het bouwen van robuustere computervisiesystemen, ", zegt Wang. De voorgestelde aanpak van het onderzoeksteam kan worden toegepast op veel visuele computerscenario's, inclusief visuele bewaking, medische beeldverwerking, en biometrie.

Volgende, het team zal een nog grotere set virtuele afbeeldingen maken, het realisme van virtuele beelden verbeteren, en verken het nut van virtuele beelden voor andere computervisietaken. Wang zegt, "Ons uiteindelijke doel is om een systematische theorie van parallelle visie op te bouwen die in staat is om te trainen, toets, begrijp en optimaliseer computervisiemodellen met virtuele beelden en zorg ervoor dat de modellen goed werken in complexe scènes."

Hoe kom je te weten van Cowbirds

Hoe kom je te weten van Cowbirds Wederzijds verzekerde vernietiging in een verhitte koraal-algenoorlog

Wederzijds verzekerde vernietiging in een verhitte koraal-algenoorlog Hoe weet je of een kardinale vogel mannelijk of vrouwelijk is

Hoe weet je of een kardinale vogel mannelijk of vrouwelijk is Copernicus Sentinel-1 maakt beeld van Rovaniemi, Lapland vanuit een baan om de aarde

Copernicus Sentinel-1 maakt beeld van Rovaniemi, Lapland vanuit een baan om de aarde Verder gaan dan de groene revolutie in het nieuwe hongertijdperk van Afrika

Verder gaan dan de groene revolutie in het nieuwe hongertijdperk van Afrika

Hoofdlijnen

- Nieuwe genen op verslechterend Y-chromosoom

- Wat zijn de drie belangrijkste verschillen tussen een plantencel en een dierencel?

- Drie soorten vezelig bindweefsel

- Wat betekent Kaukasisch echt?

- Wat zijn de verschillen tussen een CZS en een PNS?

- Hoe bacteriën met zout te doden

- Welk percentage botten in het lichaam bestaat uit het axiale skelet?

- Waarom zijn cellen belangrijk voor levende organismen?

- Puin van de tsunami van 2011 bracht honderden soorten over de Stille Oceaan

- Negatieve latentiepraat Stadia:gamers zeggen afwachten

- British Airways verwelkomt doorbraak in geschil over pilotenloon

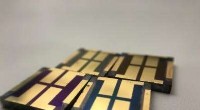

- Onderzoekers kijken in detail naar de interfaces in perovskiet-zonnecellen

- Facebook verbiedt advertenties met valse beweringen over nieuw virus

- Hoe een machine voor de rechtbank te kruisverhoren?

Waarom hebben kolenmijnen zoveel water nodig?

Waarom hebben kolenmijnen zoveel water nodig? Onderzoek identificeert de belangrijkste zwakheden in moderne computervisiesystemen

Onderzoek identificeert de belangrijkste zwakheden in moderne computervisiesystemen Katalysatoren voor isotactische polaire polypropylenen

Katalysatoren voor isotactische polaire polypropylenen Hoe de minimale stroomsnelheid van het koelwater te berekenen

Hoe de minimale stroomsnelheid van het koelwater te berekenen NASA vindt tropische cycloon Gelena in het midden van de Zuid-Indische Oceaan

NASA vindt tropische cycloon Gelena in het midden van de Zuid-Indische Oceaan Waarom het zo moeilijk is om schepen bij te houden die niets goeds doen?

Waarom het zo moeilijk is om schepen bij te houden die niets goeds doen? Hackers gebruiken angsten voor het coronavirus om u een computervirus te sturen:hoe u ze kunt stoppen

Hackers gebruiken angsten voor het coronavirus om u een computervirus te sturen:hoe u ze kunt stoppen Olievoorspellingstechniek aangepast voor spreadsheets kan de kosten voor schalieexploitanten verlagen

Olievoorspellingstechniek aangepast voor spreadsheets kan de kosten voor schalieexploitanten verlagen

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com