Wetenschap

Misinformatieproblemen kunnen zich vermenigvuldigen met deepfake-video's

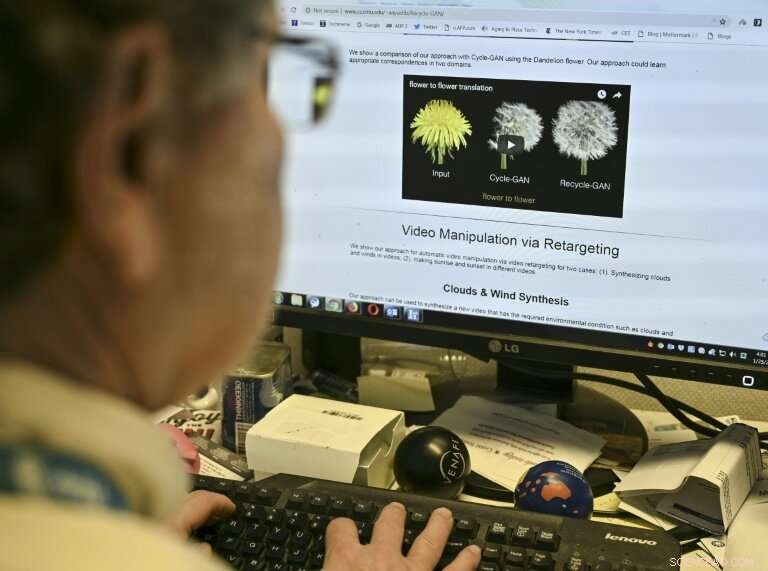

Paul Scharre van het Center for a New American Security kijkt naar een "deepfake" video van de voormalige Amerikaanse president Barack Obama, gemanipuleerd om hem de woorden te laten zien van acteur Jordan Peele op 24 januari, 2019, in Washington

Als je een video ziet van een politicus die woorden spreekt die hij nooit zou uiten, of een Hollywood-ster die onwaarschijnlijk in een goedkope pornofilm verschijnt, pas uw televisietoestel niet aan - u bent misschien getuige van de toekomst van 'nepnieuws'.

"Deepfake"-video's die de realiteit manipuleren, worden steeds geavanceerder door de vooruitgang in kunstmatige intelligentie, het creëren van het potentieel voor nieuwe soorten desinformatie met verwoestende gevolgen.

Naarmate de technologie vordert, er groeien zorgen over hoe deepfakes kunnen worden gebruikt voor snode doeleinden door hackers of statelijke actoren.

"We zijn nog niet zo ver dat we zien dat deepfakes worden bewapend, maar dat moment komt, "Robert Chesney, een professor in de rechten van de Universiteit van Texas die het onderwerp heeft onderzocht, vertelde AFP.

Chesney stelt dat deepfakes kunnen bijdragen aan de huidige onrust over desinformatie en operaties kunnen beïnvloeden.

"Een goed getimede en zorgvuldig gescripte deepfake of een reeks deepfakes kan een verkiezing doen kantelen, geweld aanwakkeren in een stad die klaar is voor burgerlijke onrust, versterken opstandige verhalen over vermeende gruweldaden van een vijand, of politieke verdeeldheid in een samenleving verergeren, "Chesney en professor Danielle Citron van de Universiteit van Maryland zeiden in een blogpost voor de Council on Foreign Relations.

Paul Scharre, een senior fellow bij het Center for a New American Security, een denktank gespecialiseerd in AI en veiligheidskwesties, zei dat het bijna onvermijdelijk was dat deepfakes zouden worden gebruikt bij de komende verkiezingen.

Digitale manipulatie is misschien goed voor Hollywood, maar nieuwe 'deepfake'-technieken kunnen een nieuw soort verkeerde informatie creëren, volgens onderzoekers

Een nepvideo kan worden ingezet om een kandidaat uit te smeren, Scharre zei, of om mensen in staat te stellen feitelijke gebeurtenissen te ontkennen die zijn vastgelegd op authentieke video.

Met geloofwaardige nepvideo's in omloop, hij voegde toe, "mensen kunnen ervoor kiezen om elke versie of elk verhaal te geloven dat ze willen, en dat is een echte zorg."

Chaplins terugkeer?

Videomanipulatie bestaat al tientallen jaren en kan onschadelijk of zelfs vermakelijk zijn - zoals in de digitaal ondersteunde verschijning van Peter Cushing in Rogue One:A Star Wars Story uit 2016, "22 jaar na zijn dood.

Onderzoekers van Carnegie Mellon University onthulden vorig jaar technieken die het gemakkelijker maken om deepfakes te produceren via machine learning om ontbrekende gegevens af te leiden.

In de filmindustrie, "de hoop is dat we oude filmsterren zoals Charlie Chaplin terug kunnen laten komen, ' zei Aayush Bansal.

Experts zeggen dat een belangrijke manier om met deepfakes om te gaan is om het publieke bewustzijn te vergroten, mensen sceptischer maken over wat vroeger als onweerlegbaar bewijs werd beschouwd

De popularisering van apps die realistische nepvideo's maken, dreigt het waarheidsbegrip in de nieuwsmedia te ondermijnen, strafprocessen en vele andere gebieden, onderzoekers wijzen erop.

"Als we iemand woorden in de mond kunnen leggen, dat is best eng, " zegt Siwei Lyu, een professor in computerwetenschappen aan de State University van New York in Albany, die onderzoek doet naar deepfake-detectie.

"Het vervaagt de grens tussen wat waar is en wat niet waar is. Als we er niet echt op kunnen vertrouwen dat informatie authentiek is, is het niet beter dan helemaal geen informatie te hebben."

Vertegenwoordiger Adam Schiff en twee andere wetgevers hebben onlangs een brief gestuurd naar Dan Coats, directeur van de nationale inlichtingendienst, met het verzoek om informatie over wat de regering doet om deepfakes te bestrijden.

"Vervalste video's, afbeeldingen of audio kunnen worden gebruikt om individuen te targeten voor chantage of voor andere snode doeleinden, ’ schreven de wetgevers.

"Van groter belang voor de nationale veiligheid, ze kunnen ook door buitenlandse of binnenlandse actoren worden gebruikt om verkeerde informatie te verspreiden."

De producenten van "Rogue One:A Star Wars Story, " digitaal nagemaakte acteurs Peter Cushing en Carrie Fisher na hun dood met behulp van technieken die vergelijkbaar zijn met die welke worden gebruikt voor "deepfake" video's

Nep van echt scheiden

Onderzoekers werken al langer aan betere detectiemethoden, met steun van particuliere bedrijven zoals Google en overheidsinstanties zoals het Defense Advanced Research projects Agency (DARPA) van het Pentagon, die in 2015 een media forensisch initiatief begon.

Lyu's onderzoek was gericht op het opsporen van vervalsingen, gedeeltelijk door de mate van knipperen van de ogen van een persoon te analyseren.

Maar hij erkent dat zelfs het detecteren van vervalsingen misschien niet genoeg is, als een video viraal gaat en tot chaos leidt.

"Het is belangrijker om het proces te verstoren dan om de video's te analyseren, ' zei Lyu.

Hoewel deepfakes zich al enkele jaren ontwikkelen, het onderwerp kwam in beeld met de creatie van afgelopen april van een video waarin de voormalige president Barack Obama een vloekwoord gebruikt om zijn opvolger Donald Trump te beschrijven - een gecoördineerde stunt van filmmaker Jordan Peele en BuzzFeed.

Een AFP-journalist bekijkt een voorbeeld van een 'deepfake'-video die is gemanipuleerd met behulp van kunstmatige intelligentie, door Carnegie Mellon University-onderzoekers

Ook anno 2018, een wildgroei aan 'face swap'-pornovideo's die afbeeldingen van Emma Watson gebruikten, Scarlett Johansson en andere beroemdheden leidden tot een verbod op deepfakes door Reddit, Twitter en Pornhub, hoewel het onduidelijk bleef of ze het beleid konden afdwingen.

Scharre said there is "an arms race between those who are creating these videos and security researchers who are trying to build effective tools of detection."

But he said an important way to deal with deepfakes is to increase public awareness, making people more skeptical of what used to be considered incontrovertible proof.

"After a video has gone viral it may be too late for the social harm it has caused, " hij zei.

© 2019 AFP

Veelzijdige bouwstenen maken constructies met verrassende mechanische eigenschappen

Veelzijdige bouwstenen maken constructies met verrassende mechanische eigenschappen Magnetische tanden zijn veelbelovend voor materialen en energie

Magnetische tanden zijn veelbelovend voor materialen en energie Goedkope en eenvoudige detectie van neurotoxische chemicaliën

Goedkope en eenvoudige detectie van neurotoxische chemicaliën Nieuwe computerondersteunde chemische synthesemethode vermindert onderzoekstijd en kosten

Nieuwe computerondersteunde chemische synthesemethode vermindert onderzoekstijd en kosten De oorsprong van oppervlakteruwheid:atoomvervorming binnen en op het oppervlak van een vaste stof

De oorsprong van oppervlakteruwheid:atoomvervorming binnen en op het oppervlak van een vaste stof

Gebruik van bomen

Gebruik van bomen  De effecten van Platypus Venom

De effecten van Platypus Venom  Nieuw door zonne-energie geïnduceerd chlorofylfluorescentieproduct heeft tot doel het onderzoek naar koolstofneutraliteit te verbeteren

Nieuw door zonne-energie geïnduceerd chlorofylfluorescentieproduct heeft tot doel het onderzoek naar koolstofneutraliteit te verbeteren Wetenschappers ontdekken overvloed aan plastic dat is opgebouwd in zee-ijs dat is verzameld in de noordwestelijke doorgang van het noordpoolgebied

Wetenschappers ontdekken overvloed aan plastic dat is opgebouwd in zee-ijs dat is verzameld in de noordwestelijke doorgang van het noordpoolgebied Opwarming van de aarde, El Nino kan nattere winters veroorzaken, drogere omstandigheden in andere maanden

Opwarming van de aarde, El Nino kan nattere winters veroorzaken, drogere omstandigheden in andere maanden

Hoofdlijnen

- Algemene kenmerken van Protista

- Genomische studie onderzoekt de evolutie van zachte killer-bijen in Puerto Rico

- Diffusie: wat is het? & Hoe gebeurt het?

- De vliegsnelheid van vogels is complexer dan eerder werd gedacht

- Wat is urushiol?

- Welke vormen over het midden van een cel nabij het einde van Telophase?

- Histologie maken Slides

- Hoe Dopamine sommige voedingsmiddelen verslavend maakt

- Voeding die de productiviteit in de intensieve veehouderij verhoogt

- Kunstmatige intelligentie gebruiken om leemten in oude teksten op te vullen

- VS bovenaan WEF-ranglijst voor concurrentievermogen, maar zwaarlijvigheid weegt op de score

- Leuke trucs mogelijk met Google Knowledge Boxen voor sommigen geen lachertje

- Volvo Cars en eigenaar Geely overwegen fusieovereenkomst

- Nieuwe Alphabet-chef Pichai ziet grote loonsverhoging

Regels voor het verwijderen van vleermuizen

Regels voor het verwijderen van vleermuizen Hoeveel zout heeft het nodig om een ei in water te drijven?

Hoeveel zout heeft het nodig om een ei in water te drijven?  Hoe een hoefijzermagneet op te laden

Hoe een hoefijzermagneet op te laden  Zou je in het laboratorium gemaakte vis eten? Deze startup baant een nieuwe weg in de alt-vleesindustrie

Zou je in het laboratorium gemaakte vis eten? Deze startup baant een nieuwe weg in de alt-vleesindustrie Jeugdrechtpraktijken in Europa kunnen praktijken in de VS informeren

Jeugdrechtpraktijken in Europa kunnen praktijken in de VS informeren Gedraaide elektronica opent de deur naar afstembare 2D-materialen

Gedraaide elektronica opent de deur naar afstembare 2D-materialen Nieuwe materialen verbeteren de levering van therapeutisch boodschapper-RNA

Nieuwe materialen verbeteren de levering van therapeutisch boodschapper-RNA Vluchtelingen worden geconfronteerd met armoede, voedselonzekerheid

Vluchtelingen worden geconfronteerd met armoede, voedselonzekerheid

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Spanish | Portuguese | Swedish | Dutch | Danish | Norway | Italian | German |

-

Wetenschap © https://nl.scienceaq.com