Wetenschap

4D-camera kan het robotzicht verbeteren, virtual reality en zelfrijdende auto's

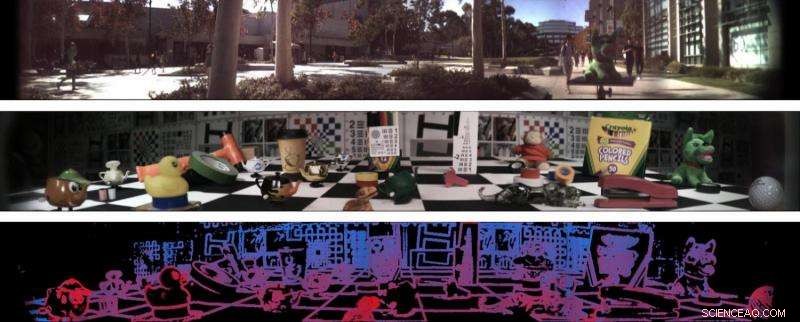

Twee lichtveldpanorama's van 138 graden (boven en midden) en een diepteschatting van het tweede panorama (onder). Credit:Stanford Computational Imaging Lab en Photonic Systems Integration Laboratory aan UC San Diego

Ingenieurs van Stanford University en de University of California San Diego hebben een camera ontwikkeld die vierdimensionale beelden genereert en 138 graden aan informatie kan vastleggen. De nieuwe camera - de allereerste single-lens, breed gezichtsveld, lichtveldcamera - kan informatierijke afbeeldingen en videoframes genereren waarmee robots beter door de wereld kunnen navigeren en bepaalde aspecten van hun omgeving kunnen begrijpen, zoals objectafstand en oppervlaktetextuur.

De onderzoekers zien deze technologie ook worden gebruikt in autonome voertuigen en augmented en virtual reality-technologieën. Onderzoekers presenteerden hun nieuwe technologie op de computervisieconferentie CVPR 2017 in juli.

"We willen nadenken over wat de juiste camera zou zijn voor een robot die pakketten door de lucht bestuurt of aflevert. We zijn geweldig in het maken van camera's voor mensen, maar moeten robots ook zien hoe mensen dat doen? Waarschijnlijk niet, " zei Donald Dansereau, een postdoctoraal onderzoeker in elektrotechniek aan Stanford en de eerste auteur van het artikel.

Het project is een samenwerking tussen de laboratoria van professoren elektrotechniek Gordon Wetzstein aan Stanford en Joseph Ford aan UC San Diego.

Onderzoekers van UC San Diego ontwierpen een sferische lens die de camera een extreem breed gezichtsveld geeft, die bijna een derde van de cirkel rond de camera omvat. De groep van Ford had eerder de sferische lenzen ontwikkeld in het kader van het DARPA "SCENICC"-programma (Soldier CENtric Imaging with Computational Cameras) om een compacte videocamera te bouwen die 360-graden beelden in hoge resolutie vastlegt, met 125 megapixels in elk videoframe. Bij dat project de videocamera gebruikte glasvezelbundels om de sferische beelden te koppelen aan conventionele platte brandvlakken, leveren van hoge prestaties maar tegen hoge kosten.

De nieuwe camera maakt gebruik van een versie van de sferische lenzen die de vezelbundels elimineert door een combinatie van lensjes en digitale signaalverwerking. De combinatie van het optica-ontwerp en de hardware-expertise op het gebied van systeemintegratie van het laboratorium van Ford en de signaalverwerking en algoritmische expertise van het laboratorium van Wetzstein resulteerde in een digitale oplossing die niet alleen leidt tot het creëren van deze extra brede beelden, maar ze ook verbetert.

De nieuwe camera is ook gebaseerd op een technologie die is ontwikkeld aan Stanford, genaamd lichtveldfotografie, dat is wat een vierde dimensie aan deze camera toevoegt:het legt de twee-assige richting vast van het licht dat op de lens valt en combineert die informatie met het 2D-beeld. Een ander opmerkelijk kenmerk van lichtveldfotografie is dat gebruikers afbeeldingen opnieuw kunnen scherpstellen nadat ze zijn gemaakt, omdat de afbeeldingen informatie bevatten over de lichtpositie en -richting. Robots kunnen deze technologie gebruiken om door regen en andere dingen heen te kijken die hun zicht kunnen belemmeren.

"Een van de dingen die je je realiseert als je met een omnidirectionele camera werkt, is dat het onmogelijk is om in elke richting tegelijk scherp te stellen - er is altijd iets dichtbij de camera, terwijl andere dingen ver weg zijn, Ford zei. "Met lichtveldbeeldvorming kan de vastgelegde video opnieuw worden scherpgesteld tijdens het afspelen, evenals het in kaart brengen van de diepte van de scène met één diafragma. Deze mogelijkheden openen allerlei toepassingen in VR en robotica."

"Het zou verschillende soorten kunstmatig intelligente technologie in staat kunnen stellen om te begrijpen hoe ver objecten zich bevinden, of ze bewegen en waar ze van gemaakt zijn, "Zei Wetzstein. "Dit systeem kan nuttig zijn in elke situatie waarin je beperkte ruimte hebt en je wilt dat de computer de hele wereld eromheen begrijpt."

En hoewel deze camera op grote afstanden als een conventionele camera kan werken, het is ook ontworpen om close-upbeelden te verbeteren. Voorbeelden waar het bijzonder nuttig zou zijn, zijn robots die door kleine gebieden moeten navigeren, landende drones en zelfrijdende auto's. Als onderdeel van een augmented of virtual reality-systeem, de diepte-informatie zou kunnen resulteren in meer naadloze weergaven van echte scènes en een betere integratie tussen die scènes en virtuele componenten ondersteunen.

De camera bevindt zich momenteel in de proof-of-concept-fase en het team is van plan een compact prototype te maken om te testen op een robot.

Geconjugeerde polymeren verbeteren massaspectrometrie en beeldvorming

Geconjugeerde polymeren verbeteren massaspectrometrie en beeldvorming Stabiele toevoer van elektrochroom metallo-supramoleculaire polymeer

Stabiele toevoer van elektrochroom metallo-supramoleculaire polymeer Een chemische onzichtbaarheidsmantel zou RNA-geheimen kunnen onthullen

Een chemische onzichtbaarheidsmantel zou RNA-geheimen kunnen onthullen Studie ontrafelt het mysterie van antimicrobiële kikkersecreties

Studie ontrafelt het mysterie van antimicrobiële kikkersecreties Organische zonnecellen die 10 jaar meegaan in de ruimte

Organische zonnecellen die 10 jaar meegaan in de ruimte

Heroverweeg de kosten-batenanalyse om de klimaatcrisis aan te pakken

Heroverweeg de kosten-batenanalyse om de klimaatcrisis aan te pakken Californische bosbranden hebben NorCals Air tot de ergste ter wereld gemaakt

Californische bosbranden hebben NorCals Air tot de ergste ter wereld gemaakt Verbeterde voorspelling van residuen van bestrijdingsmiddelen

Verbeterde voorspelling van residuen van bestrijdingsmiddelen Slow boat naar China:vrachtschepen aangespoord om snelheid en vervuiling te verminderen

Slow boat naar China:vrachtschepen aangespoord om snelheid en vervuiling te verminderen NASA volgt een gefragmenteerde, zwakkere tropische storm Hector in noordwestelijke Stille Oceaan

NASA volgt een gefragmenteerde, zwakkere tropische storm Hector in noordwestelijke Stille Oceaan

Hoofdlijnen

- Eenmaal uitgestorven verklaard, Lord Howe Island wandelende takken leven echt

- Nieuwe Peruaanse vogelsoorten ontdekt door zijn gezang

- Het verkennen van een oude gebeurtenis in pompoen, evolutie van kalebas en meloen

- Hoe de hormonen van de hypofyse te onthouden

- Haaienvinnenverboden helpen haaien misschien niet, wetenschappers zeggen:

- Wat is de fusie van twee gameten om een diploïde zygoot te vormen?

- Wat zijn de twee hoofdfasen van celdeling?

- Hoe zijn schimmels en planten vergelijkbaar?

- Hoe Charles Darwin werkte

- Large Hadron Collider drijft computergebruik tot het uiterste

- Onderzoekers halen een optisch apparaat uit het laboratorium en naar de kliniek om kanker in de vroegste stadia op te sporen

- Rocket Balloon Races, Two Ways

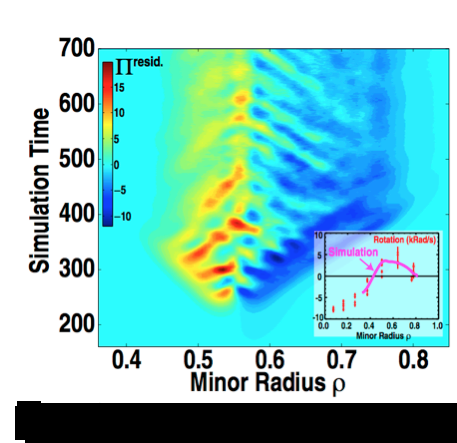

- Simulaties van DIII-D-experimenten werpen licht op mysterieuze plasmastromen

- 46 keer getuige zijn van de geboorte van baby-universums:het verband tussen zwaartekracht en soliton

Stikte, gewurgd en verdronken. Hoe ballonnen en plastic zakken zeedieren doden

Stikte, gewurgd en verdronken. Hoe ballonnen en plastic zakken zeedieren doden Medaka-vissen gebruiken gezichten om verschillende individuen te identificeren

Medaka-vissen gebruiken gezichten om verschillende individuen te identificeren Kinderen vanaf zeven jaar lijden onder discriminatie, studie toont

Kinderen vanaf zeven jaar lijden onder discriminatie, studie toont Fysische eigenschappen van stikstofgas

Fysische eigenschappen van stikstofgas op een dag, zelfs natte bossen kunnen verbranden door klimaatverandering

op een dag, zelfs natte bossen kunnen verbranden door klimaatverandering Hoe laag kan je gaan? Nieuw project om satellieten dichter bij de aarde te brengen

Hoe laag kan je gaan? Nieuw project om satellieten dichter bij de aarde te brengen Diagnostisch hulpmiddel voor coronavirus maakt belangrijke stap voorwaarts

Diagnostisch hulpmiddel voor coronavirus maakt belangrijke stap voorwaarts Onderzoekers ontdekken een verrassende eigenschap van glazen oppervlakken

Onderzoekers ontdekken een verrassende eigenschap van glazen oppervlakken

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com