Wetenschap

Een diepgaande leertechniek voor contextbewuste emotieherkenning

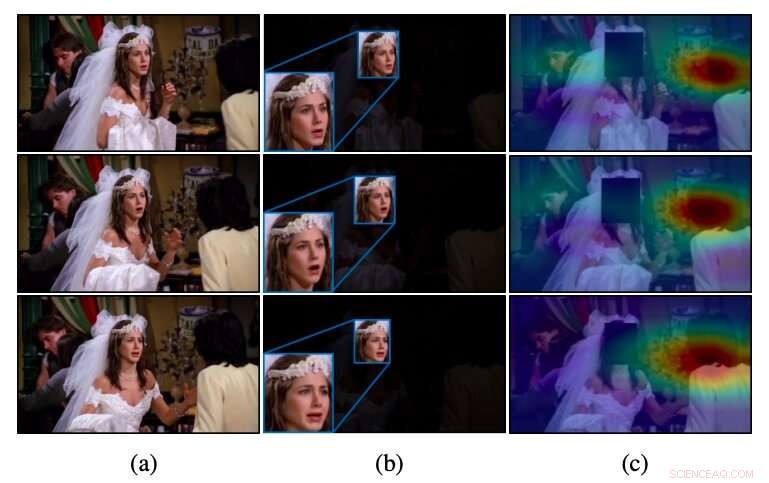

Intuïtie van CAER-Net voor ongeknipte video's, zoals in (a) conventionele methoden die alleen gebruikmaken van de gezichtsgebieden, zoals in (b), herkennen vaak emoties niet. In tegenstelling tot deze methoden, CAER-Net richt zich op zowel gezichts- als aandachtige contextregio's, zoals te zien in (c). Krediet:Lee et al.

Een team van onderzoekers van Yonsei University en École Polytechnique Fédérale de Lausanne (EPFL) heeft onlangs een nieuwe techniek ontwikkeld die emoties kan herkennen door de gezichten van mensen in afbeeldingen te analyseren, samen met contextuele kenmerken. Ze presenteerden en schetsten hun op deep learning gebaseerde architectuur, genaamd CAER-Net, in een paper dat vooraf is gepubliceerd op arXiv.

Voor meerdere jaren, onderzoekers over de hele wereld hebben geprobeerd hulpmiddelen te ontwikkelen voor het automatisch detecteren van menselijke emoties door beelden te analyseren, video's of audioclips. Deze tools kunnen tal van toepassingen hebben, bijvoorbeeld, het verbeteren van robot-mens interacties of het helpen van artsen om tekenen van mentale of neurale stoornissen te identificeren (bijv. , gebaseerd op atypische spraakpatronen, gezichtskenmerken, enzovoort.).

Tot dusver, de meeste technieken voor het herkennen van emoties in afbeeldingen zijn gebaseerd op de analyse van gezichtsuitdrukkingen van mensen, in wezen aannemend dat deze uitdrukkingen de emotionele reacties van mensen het beste overbrengen. Als resultaat, de meeste datasets voor het trainen en evalueren van tools voor emotieherkenning (bijv. de datasets AFEW en FER2013) bevatten alleen bijgesneden afbeeldingen van menselijke gezichten.

Een belangrijke beperking van conventionele instrumenten voor emotieherkenning is dat ze geen bevredigende prestatie leveren wanneer emotionele signalen op de gezichten van mensen dubbelzinnig of niet te onderscheiden zijn. In tegenstelling tot deze benaderingen, mensen zijn in staat om de emoties van anderen te herkennen, niet alleen op basis van hun gezichtsuitdrukkingen, maar ook op contextuele aanwijzingen (bijv. de acties die ze uitvoeren, hun omgang met anderen, waar zij zijn, enzovoort.).

Eerdere studies suggereren dat het analyseren van zowel gezichtsuitdrukkingen als contextgerelateerde kenmerken de prestaties van emotieherkenningstools aanzienlijk kan verbeteren. Geïnspireerd door deze bevindingen, de onderzoekers van Yonsei en EPFL wilden een op deep learning gebaseerde architectuur ontwikkelen die de emoties van mensen in afbeeldingen kan herkennen op basis van zowel hun gezichtsuitdrukkingen als contextuele informatie.

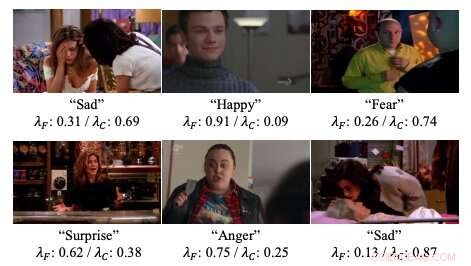

Voorbeelden van attentiegewichten in de door de onderzoekers ontwikkelde neurale netwerken. Krediet:Lee et al.

"We presenteren diepe netwerken voor contextbewuste emotieherkenning, genaamd CAER-Net, die niet alleen de menselijke gezichtsuitdrukking uitbuiten, maar ook contextinformatie, op een gezamenlijke en stimulerende manier, " schreven de onderzoekers in hun paper. "Het belangrijkste idee is om menselijke gezichten in een visuele scène te verbergen en andere contexten te zoeken op basis van een aandachtsmechanisme."

CAER-Net, de architectuur ontwikkeld door onderzoekers, is samengesteld uit twee belangrijke subnetwerken en encoders die afzonderlijk gezichtskenmerken en contextuele regio's in een afbeelding extraheren. Deze twee soorten functies worden vervolgens gecombineerd met behulp van adaptieve fusienetwerken en samen geanalyseerd om de emoties van mensen in een bepaald beeld te voorspellen.

Naast CAER-Net, de onderzoekers introduceerden ook een nieuwe dataset voor contextbewuste emotieherkenning, die ze CAER noemen. Afbeeldingen in deze dataset geven zowel de gezichten van mensen als hun omgeving/context weer, daarom zou het kunnen dienen als een effectievere benchmark voor het evalueren van technieken voor emotieherkenning.

De onderzoekers evalueerden hun techniek voor emotieherkenning in een reeks experimenten, met behulp van zowel de dataset die ze hebben samengesteld als de AFEW-dataset. Hun bevindingen suggereren dat het analyseren van zowel gezichtsuitdrukkingen als contextuele informatie de prestaties van emotieherkenningstools aanzienlijk kan verbeteren, zoals blijkt uit eerdere onderzoeken.

"We hopen dat de resultaten van deze studie verdere vooruitgang zullen vergemakkelijken in contextbewuste emotieherkenning en de bijbehorende taken, ’ schreven de onderzoekers.

© 2019 Wetenschap X Netwerk

Een nieuwe horizon voor vibrationele circulair dichroïsme spectroscopie

Een nieuwe horizon voor vibrationele circulair dichroïsme spectroscopie Bepaling van de geleidbaarheid in verbindingen

Bepaling van de geleidbaarheid in verbindingen  Maak een lijst van de drie soorten straling die tijdens het radioactieve decay

Maak een lijst van de drie soorten straling die tijdens het radioactieve decay Welke temperatuur is een propaantoorts?

Welke temperatuur is een propaantoorts?  Waarom is het belangrijk om een pH-meter en zijn elektroden tegen een buffer te kalibreren?

Waarom is het belangrijk om een pH-meter en zijn elektroden tegen een buffer te kalibreren?

Sri Lanka keert biologische landbouw terug terwijl thee lijdt

Sri Lanka keert biologische landbouw terug terwijl thee lijdt Opwarming van het noordpoolgebied om Euraziatische extreme koude gebeurtenissen te vergroten

Opwarming van het noordpoolgebied om Euraziatische extreme koude gebeurtenissen te vergroten Interessante feiten over de Hackberry Tree

Interessante feiten over de Hackberry Tree  Studie werpt licht op hoe planten hun stikstoffixatie krijgen

Studie werpt licht op hoe planten hun stikstoffixatie krijgen Daglicht niet regen belangrijkste voor Afrika groen-up fenomeen

Daglicht niet regen belangrijkste voor Afrika groen-up fenomeen

Hoofdlijnen

- Elementen van nucleïnezuren

- Studie van gierende kraanvogels onthult een band tussen paren zelfs voordat ze de paringsleeftijd hebben bereikt

- Bereken de percentages van adenine in een DNA-streng

- Monitoring van microben om marsonauten gezond te houden

- Een lijst met vijf kenmerken van chromosomen

- Planten evolueren geuren en kleuren om dieren aan te trekken voor zaadverspreiding

- Gekooide blauwe mosselen als milieudetectives

- Geofysicus vindt leermogelijkheden in filmfouten

- De Durian-industrie zou kunnen lijden zonder de bedreigde fruitvleermuis

- Elektronicagigant Philips boekt winstdaling van 27% in Q1

- Team ontwikkelt zeer flexibele high-energy textiellithiumbatterij voor draagbare elektronica

- Pyeongchang Olympics toont Koreaanse zelfrijdende voertuigen

- Hogere brandstofkosten knippen Lufthansas-vleugels in derde kwartaal

- Maak kennis met blauw, de goedkope, mensvriendelijke robot ontworpen voor AI

Klimaatverandering aan de gootsteen bestrijden:een gids voor groener afwassen

Klimaatverandering aan de gootsteen bestrijden:een gids voor groener afwassen Heeft het zijn smaak behouden? Kauwgom uit het stenen tijdperk levert menselijk DNA op

Heeft het zijn smaak behouden? Kauwgom uit het stenen tijdperk levert menselijk DNA op Kleine hoogspanningstransmissie-elektronenmicroscoop gebouwd in Japan

Kleine hoogspanningstransmissie-elektronenmicroscoop gebouwd in Japan Wat is functie notatie?

Wat is functie notatie?

Functie notatie is een compacte vorm die wordt gebruikt om de afhankelijke variabele van een functie uit te drukken in termen van de onafhankelijke variabele. Met behulp van de functie notatie is y

de afhankelijke Hoe maak je een magneet sterker

Hoe maak je een magneet sterker  Grafeenlaag zou de snelheid van condensatie-warmteoverdracht in productie-installaties kunnen verviervoudigen

Grafeenlaag zou de snelheid van condensatie-warmteoverdracht in productie-installaties kunnen verviervoudigen Onderzoekers ontwikkelen kleine gradiëntchip:systeem maakt het gemakkelijker om chemische reactiviteit te meten

Onderzoekers ontwikkelen kleine gradiëntchip:systeem maakt het gemakkelijker om chemische reactiviteit te meten Filippijnse slangen soorten

Filippijnse slangen soorten

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | French | Norway |

-

Wetenschap © https://nl.scienceaq.com