Wetenschap

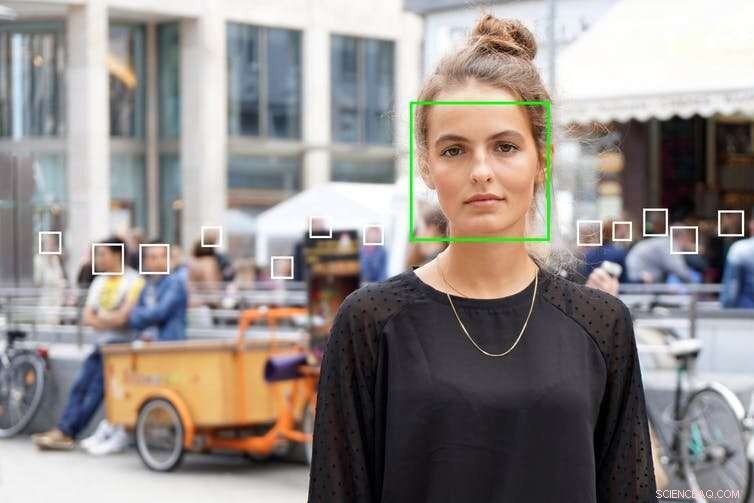

10 redenen waarom u zich zorgen zou moeten maken over gezichtsherkenningstechnologie

Krediet:Karelnoppe/Shutterstock

Gezichtsherkenningstechnologie verspreidt zich snel. Reeds wijdverbreid in China, software die mensen identificeert door afbeeldingen van hun gezichten te vergelijken met een database met gegevens, wordt nu in een groot deel van de rest van de wereld gebruikt. Het is gebruikelijk bij politiediensten, maar is ook gebruikt op luchthavens, treinstations en winkelcentra.

De snelle groei van deze technologie heeft geleid tot een hoognodig debat. activisten, politici, academici en zelfs politiediensten uiten hun ernstige bezorgdheid over de impact die gezichtsherkenning zou kunnen hebben op een politieke cultuur die gebaseerd is op rechten en democratie.

Zorgen over mensenrechten

Als iemand die onderzoek doet naar de toekomst van mensenrechten, Ik deel deze zorgen. Hier zijn tien redenen waarom we ons zorgen moeten maken over het gebruik van gezichtsherkenningstechnologie in openbare ruimtes.

(1) Het zet ons op weg naar geautomatiseerde algemene bewaking

CCTV is al wijdverbreid over de hele wereld, maar als overheden beelden tegen je willen gebruiken, moeten ze specifieke clips vinden waarin je iets doet dat ze als bewijs kunnen aanvoeren. Gezichtsherkenningstechnologie brengt monitoring naar een nieuw niveau. Het maakt de geautomatiseerde en willekeurige live bewaking van mensen mogelijk terwijl ze bezig zijn met hun dagelijkse bezigheden, autoriteiten de kans geven om al uw bewegingen te volgen.

(2) Het werkt zonder een duidelijk wettelijk of regelgevend kader

De meeste landen hebben geen specifieke wetgeving die het gebruik van gezichtsherkenningstechnologie regelt, hoewel sommige wetgevers dit proberen te veranderen. Deze juridische limbo opent de deur naar misbruik, zoals het verkrijgen van onze afbeeldingen zonder onze medeweten of toestemming en het gebruik ervan op manieren die we niet zouden goedkeuren.

(3) Het schendt de beginselen van noodzakelijkheid en evenredigheid

Een algemeen erkend mensenrechtenprincipe, erkend door organisaties van de VN tot het London Policing Ethics Panel, is dat toezicht noodzakelijk en evenredig moet zijn. Dit betekent dat toezicht moet worden beperkt tot het nastreven van ernstige criminaliteit in plaats van ongerechtvaardigde inmenging in onze vrijheid en grondrechten mogelijk te maken. Gezichtsherkenningstechnologie staat op gespannen voet met deze principes. Het is een controletechnologie die symptomatisch is voor het wantrouwen van de staat jegens zijn burgers.

(4) Het schendt ons recht op privacy

Het recht op privacy is belangrijk, ook in de openbare ruimte. Het beschermt de uitdrukking van onze identiteit zonder ongevraagde inmenging van de staat of van particuliere bedrijven. De willekeurige en grootschalige opname van gezichtsherkenningstechnologie, het opslaan en analyseren van onze afbeeldingen ondermijnt dit recht omdat het betekent dat we niets meer in het openbaar kunnen doen zonder dat de staat hiervan op de hoogte is.

Autoriteiten hoeven niet het imago van iedereen vast te leggen om de wet en orde te waarborgen. Krediet:Axel Buerckert/Shutterstock

(5) Het heeft een huiveringwekkend effect op onze democratische politieke cultuur

Algemene bewaking kan individuen ervan weerhouden openbare evenementen bij te wonen. Het kan deelname aan politieke protesten en campagnes voor verandering verstikken. En het kan non-conformistisch gedrag ontmoedigen. Dit huiveringwekkende effect is een ernstige inbreuk op het recht op vrijheid van vergadering, vereniging, en expressie.

(6) Het ontzegt burgers de mogelijkheid tot toestemming

Er is een gebrek aan gedetailleerde en specifieke informatie over hoe gezichtsherkenning daadwerkelijk wordt gebruikt. Dit betekent dat wij niet in de gelegenheid worden gesteld om in te stemmen met de opname, het analyseren en opslaan van onze afbeeldingen in databases. Door ons de kans te ontzeggen om in te stemmen, ons wordt de keuze en controle over het gebruik van onze eigen afbeeldingen ontzegd.

(7) Het is vaak onnauwkeurig

Gezichtsherkenningstechnologie belooft nauwkeurige identificatie. Maar talloze onderzoeken hebben aangetoond hoe de algoritmen die zijn getraind op raciaal vooringenomen datasets mensen van kleur verkeerd identificeren, vooral vrouwen van kleur. Dergelijke algoritmische vooringenomenheid is vooral zorgwekkend als het leidt tot onwettige arrestaties, of als het ertoe leidt dat overheidsinstanties en particuliere bedrijven vrouwen en mensen met een etnische minderheidsachtergrond discrimineren.

(8) Het kan leiden tot automatiseringsbias

Als de mensen die gezichtsherkenningssoftware gebruiken ten onrechte denken dat de technologie onfeilbaar is, het kan leiden tot slechte beslissingen. Deze "automatiseringsbias" moet worden vermeden. Door machines gegenereerde resultaten mogen niet bepalen hoe overheidsinstanties of particuliere bedrijven individuen behandelen. Opgeleide menselijke operators moeten een zinvolle controle uitoefenen en beslissingen nemen op basis van de wet.

(9) Het impliceert dat er geheime volglijsten van de overheid zijn

De databases die onze gezichtsbeelden bevatten, zouden alarmbellen moeten doen rinkelen. Ze impliceren dat particuliere bedrijven en wetshandhavingsinstanties onze afbeeldingen delen om volglijsten van potentiële verdachten op te bouwen zonder onze medeweten of toestemming. Dit is een ernstige bedreiging voor onze individuele rechten en burgerlijke vrijheden. De beveiliging van deze databases, en hun kwetsbaarheid voor de acties van hackers, is ook reden tot zorg.

(10) Het kan worden gebruikt om reeds kwetsbare groepen te targeten

Gezichtsherkenningstechnologie kan worden gebruikt voor algemene surveillance. Maar het kan ook selectief worden ingezet, bijvoorbeeld om migranten en vluchtelingen te identificeren. De verkoop van gezichtsherkenningssoftware aan instanties zoals de controversiële US Immigration and Customs Enforcement (ICE), die zwaar is bekritiseerd vanwege zijn tactiek in de omgang met migranten, Iedereen die om mensenrechten geeft, zou zich zorgen moeten maken. En het gebruik van draagbare mobiele apparaten met een app voor gezichtsherkenning door politiediensten wekt het schrikbeeld van verbeterde raciale profilering op straatniveau.

Debat hard nodig

Met zoveel zorgen over gezichtsherkenningstechnologie, we hebben dringend behoefte aan een prominenter gesprek over de impact ervan op onze rechten en burgerlijke vrijheden. Zonder de juiste regulering van deze systemen, we riskeren dystopische politiestaten te creëren in wat ooit vrij was, democratische landen.

Dit artikel is opnieuw gepubliceerd vanuit The Conversation onder een Creative Commons-licentie. Lees het originele artikel.

Science Fair-projecten over kleurvervaging

Science Fair-projecten over kleurvervaging  Covalente koolstof-koolstofbindingen veel flexibeler dan verondersteld

Covalente koolstof-koolstofbindingen veel flexibeler dan verondersteld Natuurlijke ingrediënten in supplementen, nutraceuticals krijgen een nieuw type barcode

Natuurlijke ingrediënten in supplementen, nutraceuticals krijgen een nieuw type barcode Meer dan H2O:technologie meet gelijktijdig 71 elementen in water, andere vloeistoffen

Meer dan H2O:technologie meet gelijktijdig 71 elementen in water, andere vloeistoffen Hoe te berekenen Percentage Abundances

Hoe te berekenen Percentage Abundances

Geschiedenis van Antarctische ijskappen bevat aanwijzingen voor onze toekomst

Geschiedenis van Antarctische ijskappen bevat aanwijzingen voor onze toekomst Een chemische cocktail van luchtvervuiling in Peking, China tijdens COVID-19-uitbraak

Een chemische cocktail van luchtvervuiling in Peking, China tijdens COVID-19-uitbraak Vier factoren die oceaanstromen veroorzaken

Vier factoren die oceaanstromen veroorzaken  NASA ziet Karen de status van tropische storm terugkrijgen

NASA ziet Karen de status van tropische storm terugkrijgen Verzoening van verschillen in interpretaties van de onderbreking van de opwarming van de aarde

Verzoening van verschillen in interpretaties van de onderbreking van de opwarming van de aarde

Hoofdlijnen

- Hoe jaloezie werkt

- Hoe een menselijke cel te maken voor een wetenschapsproject

- Elektronenmicroscoopbeelden laten zien hoe cellen een vitaal mineraal opnemen

- Hoe permeabiliteit uit te leggen

- De genetica van schijfziekte bij honden ontrafelen

- Onkruidverdelger glyfosaat, controversieel maar nog steeds het meest gebruikt

- Wat is het doel van de promotor en terminatorregio van de DNA-molecule?

- Antibiotica ontdekking in de afgrond

- Ambien

- Aankondiging van Arms Project Trillium kijkt naar processors voor AI

- Daniel Craigs Aston Martin haalt $ 468 op, 500 in New York

- Kunstmatige intelligentie om de chemische fabrieken van de toekomst te runnen

- GM waarschuwt dat Trump-tarieven kunnen leiden tot kleinere GM

- Opkomend tij:Drijvend apparaat een stap dichter bij het opwekken van groene stroom

Risicotool voor klimaatverandering om voor het eerst de impact op kinderen te beoordelen

Risicotool voor klimaatverandering om voor het eerst de impact op kinderen te beoordelen Kosteneffectief kwantum komt een stap dichterbij

Kosteneffectief kwantum komt een stap dichterbij Tropische storm Cristobal nadert US Gulf Coast

Tropische storm Cristobal nadert US Gulf Coast Hot Stuff:ongebruikelijke thermische diode corrigeert warmte in beide richtingen

Hot Stuff:ongebruikelijke thermische diode corrigeert warmte in beide richtingen Nieuw onderzoek onthult verborgen processen aan het werk in de harten van grote sterren

Nieuw onderzoek onthult verborgen processen aan het werk in de harten van grote sterren Dingen gemaakt van rubber

Dingen gemaakt van rubber Hoe sushi werkt

Hoe sushi werkt  Hoe kakkerlakken eruit zien?

Hoe kakkerlakken eruit zien?

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com