Wetenschap

Ingenieurs ontwikkelen nieuwe technieken om objectdetectiesystemen te misleiden

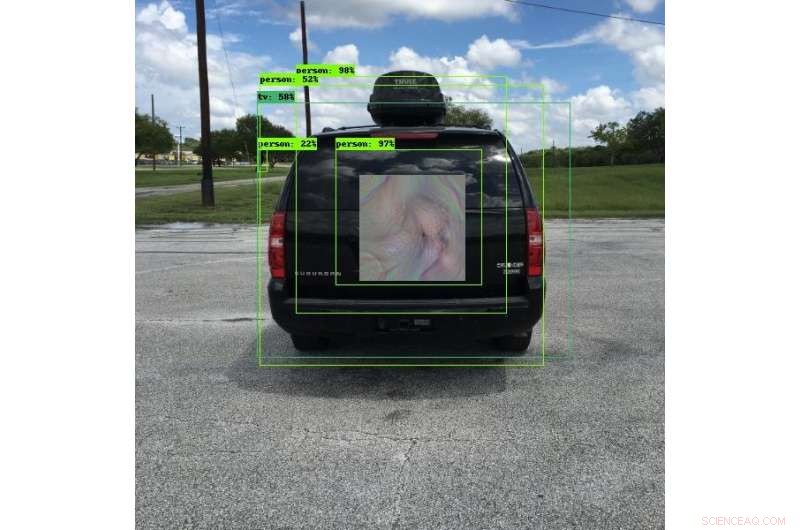

Veel van de hedendaagse voertuigen gebruiken objectdetectiesystemen om botsingen te helpen voorkomen. SwRI-ingenieurs hebben unieke patronen ontwikkeld die deze systemen kunnen misleiden om iets anders te zien, de objecten op een andere locatie zien of de objecten helemaal niet zien. In deze foto, het objectdetectiesysteem ziet een persoon in plaats van een voertuig. Dit onderzoek stelt ingenieurs in staat om objectdetectiesystemen grondig te testen en de beveiliging van de deep-learning-algoritmen die ze gebruiken te verbeteren. Krediet:Southwest Research Institute

Nieuwe vijandige technieken ontwikkeld door ingenieurs van het Southwest Research Institute kunnen objecten "onzichtbaar" maken voor beelddetectiesystemen die diepgaande algoritmen gebruiken. Deze technieken kunnen systemen ook laten denken dat ze een ander object zien of de locatie van objecten kunnen veranderen. De techniek verkleint het risico op compromittering in geautomatiseerde beeldverwerkingssystemen.

"Deep-learning neurale netwerken zijn zeer effectief bij veel taken, ", zegt onderzoeksingenieur Abe Garza van de SwRI Intelligent Systems Division. "Echter, deep learning werd zo snel ingevoerd dat de beveiligingsimplicaties van deze algoritmen niet volledig in overweging werden genomen."

Deep-learning algoritmen blinken uit in het gebruik van vormen en kleuren om de verschillen tussen mensen en dieren of auto's en vrachtwagens te herkennen, bijvoorbeeld. Deze systemen detecteren op betrouwbare wijze objecten onder verschillende omstandigheden en als zodanig, worden gebruikt in talloze toepassingen en industrieën, vaak voor veiligheidskritieke toepassingen. De auto-industrie gebruikt deep-learning objectdetectiesystemen op wegen voor rijstrookassistentie, rijstrookvertrek- en aanrijdingsvermijdingstechnologieën. Deze voertuigen vertrouwen op camera's om potentieel gevaarlijke objecten om hen heen te detecteren. Hoewel de beeldverwerkingssystemen van vitaal belang zijn voor de bescherming van levens en eigendommen, de algoritmen kunnen worden misleid door partijen die schade willen berokkenen.

Beveiligingsonderzoekers die werken aan 'adversarial learning', vinden en documenteren kwetsbaarheden in deep- en andere machine learning-algoritmen. Met behulp van interne onderzoeksfondsen van SwRI, Garza en senior onderzoeksingenieur David Chambers ontwikkelden iets dat op futuristische, Boheemse patronen. Wanneer gedragen door een persoon of gemonteerd op een voertuig, de patronen misleiden objectdetectiecamera's door te denken dat de objecten er niet zijn, dat ze iets anders zijn of dat ze zich op een andere locatie bevinden. Kwaadwillenden zouden deze patronen in de buurt van wegen kunnen plaatsen, mogelijk chaos veroorzaken voor voertuigen die zijn uitgerust met objectdetectoren.

Wat voor het menselijk oog een kleurrijk patroon lijkt, ziet eruit als een fiets voor een objectdetectiesysteem. Hoewel de diep-lerende algoritmen die in deze systemen worden gebruikt, betrouwbaar zijn, ze kunnen worden misleid met speciale beelden. SwRI-onderzoekers ontwikkelen technieken om het risico op compromittering in deze systemen te verkleinen. Krediet:Southwest Research Institute

"Deze patronen zorgen ervoor dat de algoritmen in de camera objecten verkeerd classificeren of verkeerd lokaliseren. het creëren van een kwetsbaarheid, "zei Garza. "We noemen deze patronen 'perceptie-invariante' voorbeelden van tegenstanders omdat ze niet het hele object hoeven te bedekken of evenwijdig aan de camera hoeven te zijn om het algoritme te misleiden. De algoritmen kunnen het object verkeerd classificeren zolang ze een deel van het patroon waarnemen."

Hoewel ze er voor het menselijk oog als unieke en kleurrijke kunstuitingen kunnen uitzien, deze patronen zijn zo ontworpen dat camerasystemen voor objectdetectie ze heel specifiek zien. Een patroon vermomd als een advertentie op de achterkant van een gestopte bus kan een botsingvermijdend systeem doen denken dat het een ongevaarlijke boodschappentas ziet in plaats van de bus. Als de camera van het voertuig het ware object niet detecteert, het kan vooruit blijven gaan en de bus raken, een mogelijk ernstige aanrijding veroorzaken.

"De eerste stap om deze exploits op te lossen, is het testen van de diepgaande algoritmen, "zei Garza. Het team heeft een raamwerk gecreëerd dat in staat is om deze aanvallen herhaaldelijk te testen tegen een verscheidenheid aan diepgaande detectieprogramma's, die zeer nuttig zal zijn voor het testen van oplossingen.

SwRI-onderzoekers blijven evalueren hoeveel, of hoe weinig, van het patroon is nodig om een object verkeerd te classificeren of te verplaatsen. Werken met klanten, dit onderzoek zal het team in staat stellen om objectdetectiesystemen te testen en uiteindelijk de beveiliging van deep-learning algoritmen te verbeteren.

Speekseltest voor cannabis kan ooit helpen bij het identificeren van gehandicapte bestuurders

Speekseltest voor cannabis kan ooit helpen bij het identificeren van gehandicapte bestuurders Berekening van het ionisatiepotentieel

Berekening van het ionisatiepotentieel Een kaart van reacties helpt bij het controleren van moleculaire eigenschappen

Een kaart van reacties helpt bij het controleren van moleculaire eigenschappen Chemici gebruiken massaspectrometrie-instrumenten om de ouderdom van vingerafdrukken te bepalen

Chemici gebruiken massaspectrometrie-instrumenten om de ouderdom van vingerafdrukken te bepalen Wetenschappers ontdekken dat houtskool ammoniakvervuiling opvangt

Wetenschappers ontdekken dat houtskool ammoniakvervuiling opvangt

Een giftige chemische stof in mariene ecosystemen blijkt een heilzame rol te spelen

Een giftige chemische stof in mariene ecosystemen blijkt een heilzame rol te spelen Klimaatverandering veroorzaakte dit jaar 15 rampen die meer dan $ 1 miljard hebben gekost:liefdadigheid

Klimaatverandering veroorzaakte dit jaar 15 rampen die meer dan $ 1 miljard hebben gekost:liefdadigheid Arctisch zee-ijs geladen met microplastics

Arctisch zee-ijs geladen met microplastics Lijst van natuurlijke habitats

Lijst van natuurlijke habitats  Kunnen waterbedrijven de manier veranderen waarop de elektriciteitssector dat deed?

Kunnen waterbedrijven de manier veranderen waarop de elektriciteitssector dat deed?

Hoofdlijnen

- Menselijke schedelgroei

- Lantaarnvissen onthullen hoe de opwarming van de oceaan de schemerzone beïnvloedt

- Ongebreidelde consumptie van nijlpaardentanden in combinatie met onvolledige handelsrecords brengen bedreigde nijlpaarden in gevaar

- Stijgende CO2 zorgt ook voor overlast in zoetwater, studie suggereert:

- RNA-mutatie vs. DNA-mutatie

- Hoe regelt het lichaam de hartslag?

- Mitochondria: definitie, structuur en functie (met diagram)

- Welke combinatie van chromosomen resulteert in een jongen?

- Eiwit beperkt de opname van sap door bladluizen

- Airbus naar bijl 3, 700 banen in Europa

- Kan kwantumcomputing helpen het volgende coronavirus te verslaan?

- Rekbare elektronica opbouwen om net zo multifunctioneel te zijn als uw smartphone

- Neanderthalers hadden Nintendo's niet nodig:waarom we altijd voor een verhaal kiezen boven technologie

- Californië COVID-19 verkeersrapport vindt zilveren randje

MyGovs slecht getimede meltdown had voorkomen kunnen worden met elastische computing

MyGovs slecht getimede meltdown had voorkomen kunnen worden met elastische computing Een elektrode maken

Een elektrode maken Snelle en efficiënte scheiding van olie en water bereikt door nieuw ontwikkelde deeltjes

Snelle en efficiënte scheiding van olie en water bereikt door nieuw ontwikkelde deeltjes Mensenrechtengroep:werknemer doelwit van Israëlische spyware

Mensenrechtengroep:werknemer doelwit van Israëlische spyware Een licht schijnen op de betrouwbaarheid van elektriciteit in Sub-Sahara Afrika

Een licht schijnen op de betrouwbaarheid van elektriciteit in Sub-Sahara Afrika Opinie:Waarom alle kinderen code moeten leren

Opinie:Waarom alle kinderen code moeten leren Waterstofeconomie met massaproductie van zeer zuivere waterstof uit ammoniak

Waterstofeconomie met massaproductie van zeer zuivere waterstof uit ammoniak Wetenschappers bepalen de structuur van glasvormend eiwit in sponzen

Wetenschappers bepalen de structuur van glasvormend eiwit in sponzen

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com