Wetenschap

Een stap dichter bij zelfbewuste machines:ingenieurs creëren een robot die zichzelf kan voorstellen

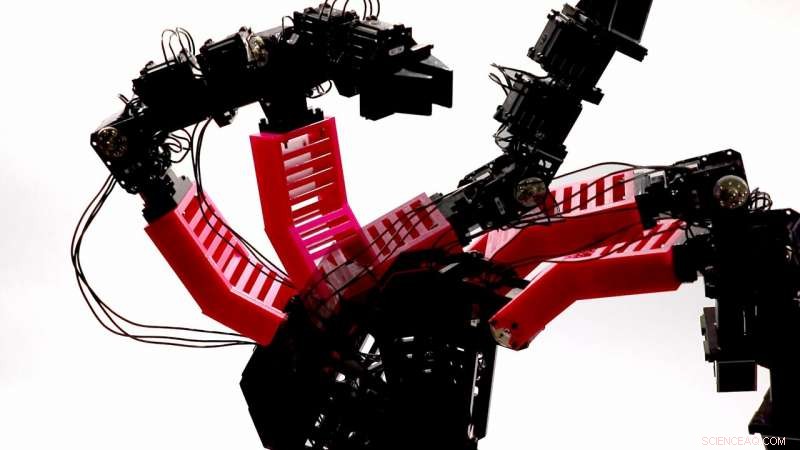

Een afbeelding van de vervormde robotarm in meerdere poses terwijl deze gegevens verzamelde door middel van willekeurige bewegingen. Krediet:Robert Kwiatkowski/Columbia Engineering

Zelfbewuste robots zijn al decennia lang sciencefictionvoer, en nu komen we misschien eindelijk dichterbij. Mensen zijn uniek in het vermogen om zichzelf voor te stellen - om zichzelf voor te stellen in toekomstige scenario's, zoals wandelen langs het strand op een warme zonnige dag. Mensen kunnen ook leren door ervaringen uit het verleden opnieuw te bekijken en na te denken over wat goed of fout ging. Terwijl mensen en dieren gedurende hun leven hun zelfbeeld verwerven en aanpassen, de meeste robots leren nog steeds met behulp van door mensen geleverde simulatoren en modellen, of door moeizaam, tijdrovende trial-and-error. Robots hebben niet geleerd zichzelf te simuleren zoals mensen dat doen.

Columbia Engineering-onderzoekers hebben grote vooruitgang geboekt in robotica door een robot te creëren die leert wat het is, vanaf het begin, zonder enige voorkennis van natuurkunde, geometrie, of motorische dynamiek. Aanvankelijk weet de robot niet of het een spin is, een slang, een arm - hij heeft geen idee wat zijn vorm is. Na een korte periode van "gebrabbel, " en binnen ongeveer een dag intensief computergebruik, hun robot creëert een zelfsimulatie. De robot kan die zelfsimulator vervolgens intern gebruiken om na te denken over en zich aan te passen aan verschillende situaties, nieuwe taken aan te pakken en schade in het eigen lichaam op te sporen en te herstellen. Het werk is vandaag gepubliceerd in Wetenschap Robotica .

Daten, robots hebben gewerkt door een mens de robot expliciet te laten modelleren. "Maar als we willen dat robots onafhankelijk worden, om zich snel aan te passen aan onvoorziene scenario's door hun makers, dan is het essentieel dat ze zichzelf leren simuleren, " zegt Hod Lipson, hoogleraar werktuigbouwkunde, en directeur van het Creative Machines-lab, waar het onderzoek is gedaan.

Voor de studie, Lipson en zijn Ph.D. student Robert Kwiatkowski gebruikte een scharnierende robotarm met vier vrijheidsgraden. aanvankelijk, de robot bewoog willekeurig en verzamelde ongeveer duizend trajecten, elk met honderd punten. De robot gebruikte vervolgens deep learning, een moderne machine learning-techniek, om een zelfmodel te maken. De eerste zelfmodellen waren nogal onnauwkeurig, en de robot wist niet wat het was, of hoe de verbindingen waren verbonden. Maar na minder dan 35 uur training, het zelfmodel kwam tot op ongeveer vier centimeter overeen met de fysieke robot. Het zelfmodel voerde een pick-and-place-taak uit in een gesloten lussysteem waardoor de robot zijn oorspronkelijke positie tussen elke stap langs het traject opnieuw kon kalibreren, volledig gebaseerd op het interne zelfmodel. Met de gesloten lusregeling, de robot was in staat om objecten op specifieke locaties op de grond te grijpen en met 100 procent succes in een bak te deponeren.

Zelfs in een open-loopsysteem, waarbij een taak wordt uitgevoerd die volledig is gebaseerd op het interne zelfmodel, zonder externe feedback, de robot was in staat om de pick-and-place-taak te voltooien met een slagingspercentage van 44 procent. "Dat is alsof je een glas water probeert op te pakken met je ogen dicht, een proces dat zelfs voor mensen moeilijk is, " merkte hoofdauteur Kwiatkowski van de studie op, een doctoraat student op de afdeling computerwetenschappen die in het lab van Lipson werkt.

De zelfmodellerende robot werd ook gebruikt voor andere taken, zoals het schrijven van tekst met een stift. Om te testen of het zelfmodel schade aan zichzelf kon detecteren, de onderzoekers 3D-printen een vervormd onderdeel om schade te simuleren en de robot was in staat om de verandering te detecteren en zijn zelfmodel opnieuw te trainen. Dankzij het nieuwe zelfmodel kon de robot zijn pick-and-place-taken hervatten met weinig prestatieverlies.

Een afbeelding van de intacte robotarm die werd gebruikt om alle taken uit te voeren Credit:Robert Kwiatkowski/Columbia Engineering

Lipson, die ook lid is van het Data Science Institute, merkt op dat zelfbeeldvorming de sleutel is om robots in staat te stellen weg te gaan van de beperkingen van zogenaamde "narrow-AI" naar meer algemene vaardigheden. "Dit is misschien wat een pasgeboren kind doet in zijn wieg, als het leert wat het is, " zegt hij. "We vermoeden dat dit voordeel ook de evolutionaire oorsprong kan zijn geweest van zelfbewustzijn bij mensen. Hoewel het vermogen van onze robot om zichzelf voor te stellen nog steeds primitief is in vergelijking met mensen, we geloven dat dit vermogen op weg is naar zelfbewustzijn van de machine."

Lipson gelooft dat robotica en AI een nieuw venster kunnen bieden op de eeuwenoude puzzel van het bewustzijn. "Filosofen, psychologen, en cognitieve wetenschappers hebben millennia nagedacht over het zelfbewustzijn van de natuur, maar relatief weinig vooruitgang hebben geboekt, " merkt hij op. "We verhullen ons gebrek aan begrip nog steeds met subjectieve termen als 'canvas of reality, ' maar robots dwingen ons nu om deze vage begrippen te vertalen in concrete algoritmen en mechanismen."

Lipson en Kwiatkowski zijn zich bewust van de ethische implicaties. "Zelfbewustzijn zal leiden tot meer veerkrachtige en adaptieve systemen, maar impliceert ook enig verlies van controle, waarschuwen ze. "Het is een krachtige technologie, maar er moet voorzichtig mee worden omgegaan."

The researchers are now exploring whether robots can model not just their own bodies, but also their own minds, whether robots can think about thinking.

Onderzoekers ontwikkelen lab-on-a-chip voor gepersonaliseerde monitoring van de werkzaamheid van geneesmiddelen

Onderzoekers ontwikkelen lab-on-a-chip voor gepersonaliseerde monitoring van de werkzaamheid van geneesmiddelen Chemici krijgen een kijkje in nieuwe fluorescentie in koolstofnanobuisjes

Chemici krijgen een kijkje in nieuwe fluorescentie in koolstofnanobuisjes Handapparaat kan controleren of visoliesupplementen verlopen zijn

Handapparaat kan controleren of visoliesupplementen verlopen zijn Hoe plankton en bacteriën oceaanspray vormen

Hoe plankton en bacteriën oceaanspray vormen Wetenschappers synthetiseren een nieuwe fosfor

Wetenschappers synthetiseren een nieuwe fosfor

NASA ziet subtropische storm 11S nog steeds wervelen

NASA ziet subtropische storm 11S nog steeds wervelen Wereldlanden nemen plan aan voor een planeet zonder vervuiling

Wereldlanden nemen plan aan voor een planeet zonder vervuiling Onderzoek suggereert dat hydro-elektrische dammen een grotere impact hebben op het Amazonebekken dan gedacht

Onderzoek suggereert dat hydro-elektrische dammen een grotere impact hebben op het Amazonebekken dan gedacht Nieuw aluminiumhydroxide stabiel bij extreem hoge druk

Nieuw aluminiumhydroxide stabiel bij extreem hoge druk Koetoiletten in Nederland willen e-moo-sessies verminderen

Koetoiletten in Nederland willen e-moo-sessies verminderen

Hoofdlijnen

- Hoe een prokaryotisch celmodel te maken

- Hebben alle mensen een uniek genotype en fenotype?

- Studie van keverflagellum biedt mogelijke manier om medische hulpmiddelen te verbeteren

- Orgelsystemen die betrokken zijn bij homeostase

- Is er een psychologische reden waarom mensen gemeen zijn op internet?

- Twee studies vinden dat stress cellen herprogrammeert

- Wat zijn de subeenheden van DNA?

- Wat is een Micel in Biochemie?

- Wat zijn de vier stikstofbasen van DNA?

SuperTIGER-ballon vliegt weer om zware kosmische deeltjes te bestuderen

SuperTIGER-ballon vliegt weer om zware kosmische deeltjes te bestuderen Aangelegde wetlands zijn de beste bescherming voor agrarische afvloeiing naar waterwegen

Aangelegde wetlands zijn de beste bescherming voor agrarische afvloeiing naar waterwegen Californië streeft ernaar om tegen 2045 fossiele brandstoffen voor elektriciteit te laten vallen (update)

Californië streeft ernaar om tegen 2045 fossiele brandstoffen voor elektriciteit te laten vallen (update) Brug in Italië had een ongebruikelijk ontwerp, vereist constant werk (update)

Brug in Italië had een ongebruikelijk ontwerp, vereist constant werk (update) Cambridge Analytica is slechts het begin, zegt data-expert

Cambridge Analytica is slechts het begin, zegt data-expert Hubble ziet galaxy vast in het midden

Hubble ziet galaxy vast in het midden Eenvoudige methode om carbonzuren om te zetten in boronaatesters en boronzuren

Eenvoudige methode om carbonzuren om te zetten in boronaatesters en boronzuren NASA ziet orkaan Irma die Zuid-Florida treft

NASA ziet orkaan Irma die Zuid-Florida treft

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway | Italian |

-

Wetenschap © https://nl.scienceaq.com