Wetenschap

Een nieuwe op machine learning gebaseerde intentiedetectiemethode met behulp van first-person-view camera voor Exo Glove Poly II

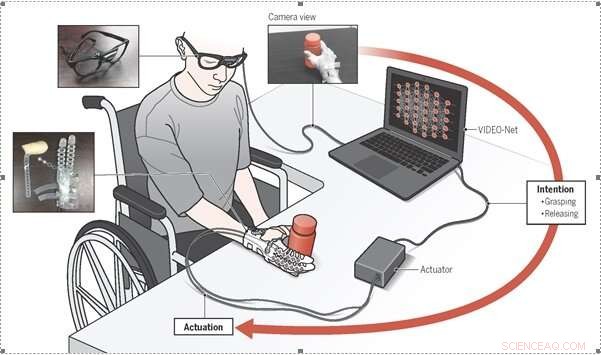

Een Koreaans onderzoeksteam creëerde een draagbare handrobot die gehandicapten kan helpen die hun handmobiliteit verloren. De robot kan de intentie van de gebruiker detecteren door het gedrag te verzamelen met een machine learning-algoritme. Krediet:Soft Robotics Research Center, Nationale Universiteit van Seoul

Een Koreaans onderzoeksteam heeft een nieuw paradigma voorgesteld voor een draagbare handrobot die mensen met verloren handmobiliteit kan helpen. De handrobot verzamelt gebruikersgedrag met een machine learning-algoritme om de intentie van de gebruiker te bepalen.

Professor Sungho Jo (KAIST) en Kyu-Jin Cho (Seoul National University) hebben een nieuw paradigma voor intentiedetectie voor draagbare handrobots voorgesteld. Het voorgestelde paradigma voorspelt het grijpen/loslaten van intenties op basis van gebruikersgedrag, waardoor patiënten met ruggenmergletsel (SCI) met verloren handmobiliteit objecten kunnen oppakken en plaatsen.

Ze ontwikkelden de methode op basis van een machine learning-algoritme dat gebruikersintenties voorspelt via een first-person-view camera. Hun ontwikkeling is gebaseerd op de hypothese dat gebruikersintenties kunnen worden afgeleid door het verzamelen van gebruikersarmgedrag en hand-objectinteracties.

Het machine learning-model dat in dit onderzoek is gebruikt, Vision-based Intention Detection netwerk vanuit een EgOcentric view (VIDEO-Net), is ontworpen op basis van deze hypothese. VIDEO-Net bestaat uit ruimtelijke en temporele subnetwerken, die het gedrag van gebruikersarmen herkennen, en een ruimtelijk subnetwerk dat hand-objectinteracties herkent.

Een dwarslaesie-patiënt die Exo-Glove Poly II draagt, een zachte draagbare handrobot, met succes verschillende objecten geplukt en geplaatst en essentiële activiteiten van het dagelijks leven uitgevoerd, zoals koffie drinken, zonder extra hulp.

Deze ontwikkeling is voordelig omdat het de intenties van de gebruiker detecteert zonder dat er persoonlijke kalibraties of aanvullende acties nodig zijn. Hierdoor kan een mens de draagbare handrobot naadloos gebruiken.

Interview met professor Kyu-Jin Cho

Vraag:Hoe werkt dit systeem?

A:Deze technologie is bedoeld om gebruikersintenties te voorspellen, specifiek grijpen en loslaten van de intentie in de richting van een doelobject, door gebruik te maken van een first-person-view camera gemonteerd op een bril. VIDEONet, een op deep learning gebaseerd algoritme, is ontworpen om gebruikersintenties van de camera te voorspellen op basis van het armgedrag van de gebruiker en hand-objectinteracties. In plaats van biosignalen te gebruiken, die vaak wordt gebruikt voor intentiedetectie van mensen met een handicap, we gebruiken een eenvoudige camera om erachter te komen of de persoon probeert te grijpen of niet. Dit werkt omdat de doelgebruikers hun arm kunnen bewegen, maar niet hun handen. We kunnen de intentie van de gebruiker om te grijpen voorspellen door de armbeweging en de afstand tot het object en de hand te observeren, en het interpreteren van de observatie met behulp van machine learning.

V:Wie profiteert van deze technologie?

A:Zoals eerder vermeld, deze technologie detecteert gebruikersintenties van menselijk armgedrag en hand-objectinteracties. Deze technologie kan worden gebruikt door iedereen met verminderde handmobiliteit als gevolg van een dwarslaesie, hartinfarct, hersenverlamming of een andere aandoening, zolang ze hun arm vrijwillig kunnen bewegen.

V:Wat zijn de beperkingen en toekomstige werken?

A:De meeste beperkingen komen voort uit de nadelen van het gebruik van een monoculaire camera. Bijvoorbeeld, als een doelobject wordt afgesloten door een ander object, de prestaties van deze technologie nemen af. Ook, als het handgebaar van de gebruiker niet zichtbaar is in de camerascène, de technologie is niet bruikbaar. Om het gebrek aan algemeenheid als gevolg van deze problemen te verhelpen, het algoritme moet worden verbeterd door andere sensorinformatie of andere bestaande methoden voor het detecteren van intenties op te nemen, zoals het gebruik van een elektromyografiesensor of het volgen van oogbesturing.

V:Om deze technologie in het dagelijks leven te gebruiken, wat heb je nodig?

A:Om deze technologie in het dagelijks leven te kunnen gebruiken, een gebruiker heeft een draagbare handrobot nodig met een bedieningsmodule, een computerapparaat, en een bril met een camera gemonteerd. We streven ernaar om de grootte en het gewicht van het computerapparaat te verminderen, zodat de robot draagbaar kan zijn voor gebruik in het dagelijks leven. We gebruikten een compact computerapparaat dat aan onze eisen voldoet, maar we verwachten dat neuromorfe chips die deep learning-berekeningen kunnen uitvoeren, commercieel beschikbaar zullen zijn.

Hulpfondsen voor coronavirus zouden gemakkelijk kunnen betalen om de ergste klimaatverandering te stoppen en tegelijkertijd economieën opnieuw op te starten

Hulpfondsen voor coronavirus zouden gemakkelijk kunnen betalen om de ergste klimaatverandering te stoppen en tegelijkertijd economieën opnieuw op te starten De onverzadigbare vraag naar cannabis heeft een gigantische ecologische voetafdruk gecreëerd

De onverzadigbare vraag naar cannabis heeft een gigantische ecologische voetafdruk gecreëerd Nieuwe modellen laten zien hoe grote rivieren zullen reageren op veranderende omgevingsomstandigheden

Nieuwe modellen laten zien hoe grote rivieren zullen reageren op veranderende omgevingsomstandigheden California Coastline Natural Resources

California Coastline Natural Resources Natuurlijke hulpbronnen van Wisconsin

Natuurlijke hulpbronnen van Wisconsin

Hoofdlijnen

- Studie vindt verband tussen ontbossing en visserijopbrengsten in de Amazone

- Het effect van zout en suiker op gedehydrateerde cellen

- Het overdrachtspotentieel van vliegen kan groter zijn dan gedacht, onderzoekers zeggen:

- Evolutionair gewasonderzoek:Egoplanten geven lagere opbrengst

- Het belang van plantaardige cellen

- Het bewijs zit in de voetafdruk:mensen kwamen eerder naar Amerika dan gedacht

- Voedselgeur verbetert de aantrekkelijkheid van mannelijke vliegen

- Een natte winter kan de invasieve soorten van San Francisco Bay opschudden

- Abiogenese: definitie, theorie, bewijs & voorbeelden

Screening van de gereedheid van de kleuterschool

Screening van de gereedheid van de kleuterschool Bewijs van een andere mogelijke planeet in een baan om Proxima Centauri

Bewijs van een andere mogelijke planeet in een baan om Proxima Centauri Trump heft mandaat voor koolstofafvang voor nieuwe kolencentrales op bron zegt

Trump heft mandaat voor koolstofafvang voor nieuwe kolencentrales op bron zegt Luchtvervuiling veroorzaakt door maïsproductie verhoogt sterftecijfer in VS

Luchtvervuiling veroorzaakt door maïsproductie verhoogt sterftecijfer in VS Studie lost waarom drinken je de munchies geeft

Studie lost waarom drinken je de munchies geeft  Amazon beëindigt de spanning over het hoofdkantoor door New York te kiezen, DC buitenwijk

Amazon beëindigt de spanning over het hoofdkantoor door New York te kiezen, DC buitenwijk The Gorillas Ecosystem

The Gorillas Ecosystem  Afbeelding:Flevoland, het gigantische landaanwinningsproject van Nederland

Afbeelding:Flevoland, het gigantische landaanwinningsproject van Nederland

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Portuguese | Swedish | Dutch | Danish | Norway | Spanish | German |

-

Wetenschap © https://nl.scienceaq.com