Wetenschap

Zelfrijdende auto's:waarom kunnen we niet verwachten dat ze moreel zijn?

Krediet:Marat Marihal/Shutterstock

Sinds bedrijven begonnen met het ontwikkelen van zelfrijdende auto's, mensen hebben gevraagd hoe ontwerpers omgaan met de morele vraag wie een zelfrijdende auto moet doden als een dodelijk ongeval onvermijdelijk is. Recent onderzoek suggereert dat deze vraag voor autofabrikanten misschien nog moeilijker te beantwoorden is dan eerder werd gedacht, omdat de morele voorkeuren van mensen zo sterk verschillen van land tot land.

De onderzoekers, gevestigd aan Harvard University en MIT, ontwikkelde een online game die situaties simuleert waarin een dodelijk auto-ongeluk onvermijdelijk was. Ze vroegen ongeveer 40 miljoen mensen uit meer dan 200 landen om te kiezen tussen verschillende ongevalsresultaten, zoals het doden van voetgangers in plaats van de passagiers van de auto.

De resultaten onthulden drie culturele clusters waar er significante verschillen waren in de ethische voorkeuren die mensen hadden. Bijvoorbeeld, in de zuidelijke cluster (die het grootste deel van Latijns-Amerika en enkele voormalige Franse koloniën omvatte), er was een sterke voorkeur voor het sparen van vrouwen boven mannen. De oostelijke cluster (waartoe zowel veel islamitische landen als China behoorden, Japan en Korea) hadden een lagere voorkeur voor het sparen van jongeren boven ouderen.

De onderzoekers concludeerden dat deze informatie ontwikkelaars van zelfrijdende auto's zou moeten beïnvloeden. Maar is dat echt zo? Hoewel dit artikel een interessante ontdekking belicht over globale variaties in morele voorkeuren, het wijst ook op een hardnekkig misverstand over AI, en wat het eigenlijk kan. Gezien de huidige AI-technologie die wordt gebruikt in zelfrijdende auto's, het idee dat een voertuig een morele beslissing zou kunnen nemen, is eigenlijk onmogelijk.

De 'morele machine'-fantasie

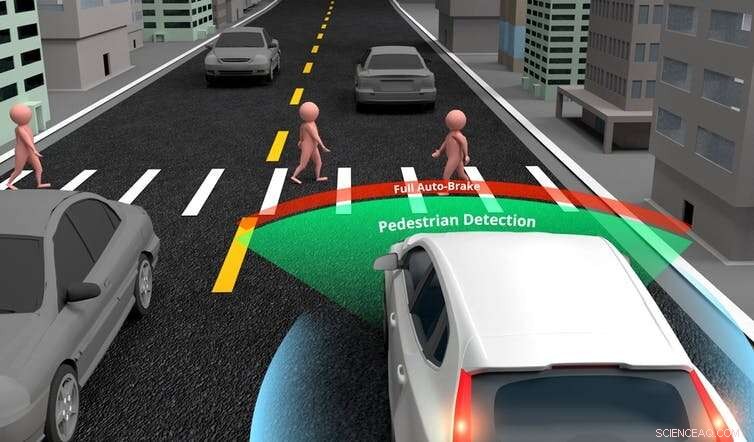

Zelfrijdende auto's zijn getraind om beslissingen te nemen over waar te sturen of te remmen, met behulp van specifieke (of zwakke) AI (kunstmatige intelligentie die is gericht op het voltooien van één enge taak). Ze zijn ontworpen met een reeks sensoren, camera's en lasers voor het meten van afstanden (lidar), die informatie doorgeven aan een centrale computer. De computer gebruikt vervolgens de AI om deze invoer te analyseren en een beslissing te nemen.

Hoewel de technologie momenteel relatief eenvoudig is, auto's zullen uiteindelijk beter presteren dan mensen in deze basisrijtaken. Echter, het is onrealistisch om te denken dat zelfrijdende auto's ook in staat zouden moeten zijn om een ethische beslissing te nemen waar zelfs de meest morele mens geen tijd voor zou hebben in een ongevalscenario. Een auto zou met algemene AI moeten worden geprogrammeerd als dit zou moeten.

Specifieke AI stelt zelfrijdende auto's in staat om basisoordelen te vellen over objecten in hun omgeving. Krediet:Akarat Phasura / Shutterstock

Algemene AI is het equivalent van wat ons mens maakt. Het is het vermogen om te converseren, geniet van muziek, dingen grappig vinden of morele oordelen vellen. Het produceren van algemene AI is momenteel onmogelijk vanwege de complexiteit van menselijk denken en emoties. Als we morele autonome voertuigen nodig hebben, zullen we er de komende decennia niet komen, als ooit.

Een ander probleem met het nieuwe onderzoek was dat veel van de situaties die deelnemers moesten beoordelen onrealistisch waren. In één scenario dat het beroemde "trolleyprobleem" weergalmt, deelnemers werd gevraagd wie de auto zou moeten doden als de remmen het begaven:de drie passagiers (een volwassen man, een volwassen vrouw en een jongen) of drie oudere voetgangers (twee mannen en een vrouw).

Bij het beantwoorden van een vragenlijst kunnen mensen goed nadenken over dit soort problemen. Maar bij de meeste echte ongevallen, een bestuurder zou geen tijd hebben om dergelijke beslissingen te nemen in de fractie van een seconde voordat het gebeurt. Dit betekent dat de vergelijking ongeldig is. En gezien de huidige AI-technologie van zelfrijdende auto's, deze voertuigen zullen deze beoordelingen ook niet kunnen maken.

De huidige zelfrijdende auto's hebben geavanceerde detectiemogelijkheden en kunnen voetgangers van andere objecten onderscheiden, zoals lantaarnpalen of verkeersborden. Echter, de auteurs van het onderzoek suggereren dat zelfrijdende auto's, zal en misschien moet kunnen meer geavanceerd onderscheid maken. Bijvoorbeeld, ze konden mensen herkennen die wenselijker werden geacht voor de samenleving, zoals artsen of atleten, en kies ervoor om ze op te slaan in een crashscenario.

De realiteit is dat het ontwerpen van auto's om dergelijke geavanceerde beoordelingen te maken, zou betekenen dat algemene AI moet worden geproduceerd, wat momenteel onmogelijk is. Het is ook de vraag of dit überhaupt wenselijk is. Als het ooit mogelijk is om een auto te programmeren om te beslissen welk leven moet worden gered, het is niet iets dat we volgens mij moeten toestaan. We mogen niet toestaan dat de voorkeuren die in onderzoek zijn geïdentificeerd, hoe groot de steekproefomvang ook is, om de waarde van een leven te bepalen.

In hun meest basale vorm, zelfrijdende auto's worden ontworpen om ongevallen te voorkomen als ze kunnen, en minimaliseer de snelheid bij een botsing als ze dat niet kunnen. Hoewel, zoals mensen, ze zijn niet in staat om een morele beslissing te nemen voor een onvermijdelijk ongeval. Maar zelfrijdende auto's zullen veiliger zijn dan menselijke bestuurders, omdat ze meer oplettend zijn, kan sneller reageren en zal de mogelijkheden van het remsysteem ten volle benutten in een ongevalscenario.

Momenteel, de grootste ethische uitdaging waarmee ontwerpers van zelfrijdende auto's worden geconfronteerd, is bepalen wanneer er voldoende bewijs is van veilig gedrag uit simulaties en gecontroleerde tests op de weg om zelfrijdende auto's op de weg te introduceren. Maar dit betekent niet dat ze "moreel" zijn, of binnenkort zal zijn. Dat zeggen is de specifieke AI van het uitvoeren van rijtaken verwarren met algemene AI, die waarschijnlijk niet zal bestaan in ons leven.

uiteindelijk, zelfrijdende auto's zullen veiliger zijn dan mensen. Ze zullen dit bereiken door ontwerp en het zoveel mogelijk vermijden van ongevallen, en het verminderen van schade waar niet. Echter, de auto's zullen geen morele beslissingen kunnen nemen die zelfs wij niet kunnen. Dit idee blijft een vergezochte fantasie, en niet een waar we op moeten hopen. In plaats daarvan, laten we ons concentreren op veiligheid:iets waar we een gerechtvaardigd vertrouwen in kunnen hebben.

Dit artikel is opnieuw gepubliceerd vanuit The Conversation onder een Creative Commons-licentie. Lees het originele artikel.

Hou je van een drankje? Japans team vindt houtalcohol uit

Hou je van een drankje? Japans team vindt houtalcohol uit Heteractis magnifica zeeanemonen kunnen helpen bij het bestrijden van de ziekte van Alzheimer

Heteractis magnifica zeeanemonen kunnen helpen bij het bestrijden van de ziekte van Alzheimer Winnaars van een wedstrijd van $ 20 miljoen maken beton om koolstofdioxide op te vangen

Winnaars van een wedstrijd van $ 20 miljoen maken beton om koolstofdioxide op te vangen Levensduur van brandstofcellen gemaximaliseerd met kleine hoeveelheden metalen

Levensduur van brandstofcellen gemaximaliseerd met kleine hoeveelheden metalen Nieuwe manier om teken af te stoten:hun speeksel opdrogen

Nieuwe manier om teken af te stoten:hun speeksel opdrogen

Hoofdlijnen

- Dierenartsen verplegen zieke bobcat, breng het terug naar het park waar het nodig is

- Welke moleculen komen in de Krebs-cyclus en welke moleculen verlaten de Krebs-cyclus?

- Evolutionaire relaties tussen prokaryoten en eukaryoten

- Waar vindt transcriptie plaats in een eukaryote cel?

- Onderzoekers vinden dat er minstens 14, 003 plantensoorten in het Amazonebekken

- Hoe eetbare plantencellen te maken

- Hoe lokale ecologische kennis bedreigde en zeldzame dieren kan redden

- Wat zijn de twee processen die ATP produceren?

- Onderzoekers zoeken burgerwetenschappers om bij te dragen aan het wereldwijd opsporen van muggen

Nanodruppels en ultrasone boren blijken effectief bij het aanpakken van hardnekkige bloedstolsels

Nanodruppels en ultrasone boren blijken effectief bij het aanpakken van hardnekkige bloedstolsels Hoe een semantische kaart te maken

Hoe een semantische kaart te maken AI- en NMR-spectroscopie bepalen in recordtijd de configuratie van atomen

AI- en NMR-spectroscopie bepalen in recordtijd de configuratie van atomen Elektronenbundels houden ionen koel bij RHIC

Elektronenbundels houden ionen koel bij RHIC NASA-studie vindt dat zonnestormen bodems kunnen veroorzaken bij manenpolen

NASA-studie vindt dat zonnestormen bodems kunnen veroorzaken bij manenpolen Geautomatiseerde ziektedetectie in maïs

Geautomatiseerde ziektedetectie in maïs Betere kathodematerialen voor lithium-zwavelbatterijen

Betere kathodematerialen voor lithium-zwavelbatterijen Onderzoekers vinden manier om hagelbuien vooraf te melden

Onderzoekers vinden manier om hagelbuien vooraf te melden

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com