Wetenschap

Autonome robot die interageert met mensen door middel van natuurlijke taal en beeldverwerking

Onderzoekers Jared Johansen (links) en Thomas Ilyevsky (rechts) beoordelen de autonome robot, Hoes, het beoordelen van de besturingssystemen in de omgeving. De robot zal autonoom een kamer lokaliseren, gebouw of individu door zijn integratieve visie en taalsoftware. Krediet:afbeelding Hope Sale / Purdue Research Foundation

Purdue University-onderzoekers in de School of Electrical and Computer Engineering ontwikkelen integratieve taal- en visiesoftware waarmee een autonome robot kan communiceren met mensen in verschillende omgevingen en navigatiedoelen kan bereiken.

"Het algemene doel van het project is om de robot te vertellen een bepaalde persoon te vinden, kamer of gebouw en laat de robot communiceren met gewone, ongetrainde mensen om in natuurlijke taal de weg naar een bepaalde plaats te vragen, " zei Jeffrey Mark Siskind, een universitair hoofddocent die het onderzoeksteam leidt. "Om deze taak te volbrengen, de robot moet veilig werken in het bijzijn van mensen, moedig hen aan om aanwijzingen te geven en hun informatie te gebruiken om het doel te vinden."

Promovendi Thomas Ilyevsky en Jared Johansen werken samen met Siskind aan de ontwikkeling van een robot genaamd Hosh die grafische en taalgegevens kan integreren in het navigatieproces om een specifieke plaats of persoon te lokaliseren. Het team ontwikkelt de robot via een subsidie die wordt gefinancierd door het National Robotics Initiative van de National Science Foundation.

Deze robot kan zelfrijdende auto's helpen communiceren met passagiers en voetgangers of kan kleinschalige taken op een zakelijke plek uitvoeren, zoals het bezorgen van post. De robot zou tegen 2025 bijdragen aan de verwachte groei van 14 miljard dollar van de consumentenrobotica-industrie. zoals geprojecteerd door de Boston Consulting Group.

De robot krijgt een taak om een specifieke kamer te lokaliseren, gebouw of individu op een bekende of onbekende locatie. Vervolgens, de robot zal nieuwe taal en visuele verwerking verenigen om door de omgeving te navigeren, de weg vragen, verzoek om deuren te openen of liftknoppen in te drukken en zijn doel te bereiken.

De onderzoekers ontwikkelen software op hoog niveau om de robot "gezond verstand kennis, " het vermogen om objecten en omgevingen te begrijpen met intuïtie op menselijk niveau, waardoor het navigatieconventies kan herkennen. Bijvoorbeeld, de robot zal zowel gesproken verklaringen als fysieke gebaren opnemen in zijn navigatieproces.

De autonome robot, genaamd Hosh, zal door omgevingen navigeren en met mensen omgaan. Op de bovenste foto is het computerscherm van de robot te zien, inclusief een kaart, cameraweergave en aanvullende besturingssoftware. De onderkant toont onderzoekers Jeffrey Mark Siskind (links), Thomas Ilyevsky (midden) en Jared Johansen (rechts) door de computervisie van de robot. Krediet:afbeelding Hope Sale / Purdue Research Foundation

"De robot heeft intuïtie op menselijk niveau nodig om navigatieconventies te begrijpen, "Zei Ilyevsky. "Hier komt kennis van gezond verstand om de hoek kijken. De robot moet weten dat oneven en even genummerde kamers tegenover elkaar in een gang zitten of dat kamer 317 zich op de derde verdieping van het gebouw zou moeten bevinden."

Om de kennis van het gezond verstand van de robot te ontwikkelen, de onderzoeken zullen integratieve natuurlijke taalverwerking en computervisiesoftware ontwikkelen. Typisch, natuurlijke taalverwerking stelt de robot in staat om met mensen te communiceren, terwijl de computer vision-software de robot in staat stelt om door zijn omgeving te navigeren. Echter, de onderzoekers verbeteren de software om elkaar te informeren terwijl de robot beweegt.

"De robot moet taal begrijpen in een visuele context en visie in een taalcontext, ' zei Siskind. 'Bijvoorbeeld, tijdens het lokaliseren van een specifieke persoon, de robot kan informatie ontvangen in een opmerking of fysiek gebaar en moet beide begrijpen binnen de context van zijn navigatiedoelen."

Bijvoorbeeld, als het antwoord is "Controleer naar die persoon in kamer 300, " de robot moet de verklaring in een visuele context verwerken en identificeren in welke kamer hij zich momenteel bevindt, evenals de beste route om kamer 300 te bereiken. Als het antwoord is:"Die persoon is daar" met een fysiek signaal, de robot zal de visuele cue moeten integreren met de betekenis van de verklaring om Persoon A te identificeren.

"Interactie met mensen is een onopgelost probleem in kunstmatige intelligentie, " zei Johansen. "Voor dit project, we proberen de robot te helpen bepaalde conventies te begrijpen waar hij tegenaan kan lopen of te anticiperen dat een tiental verschillende reacties allemaal dezelfde betekenis kunnen hebben."

"We verwachten dat deze technologie heel groot zal zijn, omdat de industrie van autonome robots en zelfrijdende auto’s erg groot wordt, Siskind zei. "De technologie kan worden aangepast in zelfrijdende auto's, waardoor de auto's de weg kunnen vragen of passagiers een specifieke bestemming kunnen opvragen, net zoals menselijke chauffeurs dat doen."

De onderzoekers verwachten de robot op autonome missies te sturen met toenemende complexiteit naarmate de technologie vordert. Eerst, de robot leert binnenshuis te navigeren op een enkele verdieping. Vervolgens, verhuizen naar andere verdiepingen en gebouwen, het zal mensen vragen om de lift te bedienen of deuren ervoor te openen. De onderzoekers hopen in het voorjaar door te gaan naar buitenmissies.

Petri-schalen steriliseren

Petri-schalen steriliseren Snel, nauwkeurige manier om pindaplanten te controleren op gezonde eigenschappen

Snel, nauwkeurige manier om pindaplanten te controleren op gezonde eigenschappen Wetenschappers ontwerpen ontdekking verdubbelt geleidbaarheid van indiumoxide transparante coatings

Wetenschappers ontwerpen ontdekking verdubbelt geleidbaarheid van indiumoxide transparante coatings Onderzoekers gebruiken hele levende cellen als sjablonen om naar bioactieve moleculen te zoeken

Onderzoekers gebruiken hele levende cellen als sjablonen om naar bioactieve moleculen te zoeken Waarom is koolstof zo belangrijk voor organische verbindingen?

Waarom is koolstof zo belangrijk voor organische verbindingen?

De strijd om de toekomst van de landbouw:wat u moet weten

De strijd om de toekomst van de landbouw:wat u moet weten Tot een derde van de familiebossen zal waarschijnlijk over vijf jaar van eigenaar veranderen

Tot een derde van de familiebossen zal waarschijnlijk over vijf jaar van eigenaar veranderen Nu moeten wijnliefhebbers iets weten over geologie - of toch niet?

Nu moeten wijnliefhebbers iets weten over geologie - of toch niet? Wat gebeurt er nadat vulkanen zijn afgebroken?

Wat gebeurt er nadat vulkanen zijn afgebroken?  Tropische cycloon savanne verdwijnt in Suomi NPP satellietbeelden

Tropische cycloon savanne verdwijnt in Suomi NPP satellietbeelden

Hoofdlijnen

- Onderzoekers maken een kaart van het microbiële landschap van de darmen

- Nieuwe tool kan helpen de kwaliteit te behouden tijdens de kaasproductie

- Onderzoekers leggen de basis vast voor de ontwikkeling van ledematen van gewervelde dieren in kraakbeenvissen

- Vissen hebben complexe persoonlijkheden, uit onderzoek blijkt

- Wat bepaalt de productie van eiwitten in uw lichaam?

- Wetenschappers ontrafelen mysteries van DNA-replicatie in maïs

- Hoeveel onontdekte wezens zijn er in de oceaan?

- De voordelen en nadelen van het Bacillus-expressiesysteem

- Gebruik van recombinant DNA in Agriculture

- Een oude computer verkopen op eBay? Mogelijk geeft u ook gegevens weg waarvan u dacht dat u ze had gewist

- Memory-jogging robot om mensen scherp te houden in slimme bejaardentehuizen

- Kosteneffectieve marketingcampagnes op sociale media

- Google aangeklaagd voor ongewenst volgen van telefoonlocaties

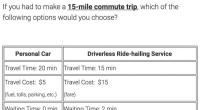

- Amerikanen rijden liever zelf naar hun werk dan dat een autonoom voertuig hen rijdt, studie zegt:

Video:Hoe superhydrofobe materialen volledig droog blijven

Video:Hoe superhydrofobe materialen volledig droog blijven Hoe een Sharknado zou werken

Hoe een Sharknado zou werken  Google onthult zoekwijzigingen om de EU tevreden te stellen

Google onthult zoekwijzigingen om de EU tevreden te stellen LHCb-experiment kondigt waarneming aan van een nieuw deeltje met twee zware quarks

LHCb-experiment kondigt waarneming aan van een nieuw deeltje met twee zware quarks Wetenschapsprojecten met ballonnen & geluidsvibratie

Wetenschapsprojecten met ballonnen & geluidsvibratie  Onderzoekers temmen silicium om te interageren met licht voor micro-elektronica van de volgende generatie

Onderzoekers temmen silicium om te interageren met licht voor micro-elektronica van de volgende generatie Een EMF-detector bouwen

Een EMF-detector bouwen  Met accessoires voor videogames kun je het gevoel, geluid en zetel van je spel

Met accessoires voor videogames kun je het gevoel, geluid en zetel van je spel

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com