Wetenschap

Kunstmatige intelligentiesysteem maakt gebruik van transparante, menselijke redenering om problemen op te lossen

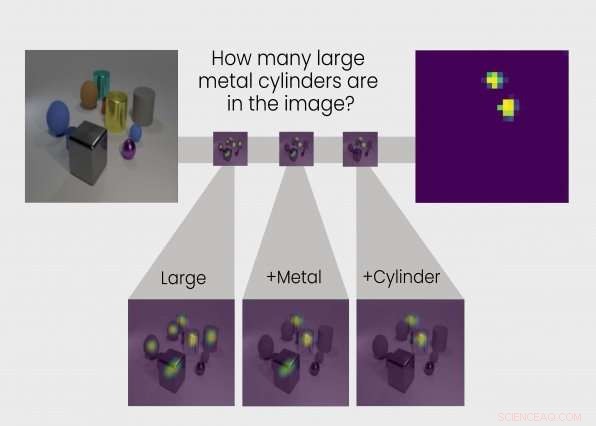

TbD-net lost het probleem van visueel redeneren op door het op te splitsen in een reeks subtaken. Het antwoord op elke subtaak wordt weergegeven in heatmaps die de interessante objecten markeren, waardoor analisten het denkproces van het netwerk kunnen zien. Credit:Intelligence and Decision Technologies Group

We leren door de rede hoe we de wereld moeten interpreteren. Dus, te, neurale netwerken doen. Nu heeft een team van onderzoekers van de Intelligence and Decision Technologies Group van MIT Lincoln Laboratory een neuraal netwerk ontwikkeld dat mensachtige redeneerstappen uitvoert om vragen over de inhoud van afbeeldingen te beantwoorden. Het Transparency by Design Network (TbD-net) genoemd, het model geeft het denkproces visueel weer terwijl het problemen oplost, waardoor menselijke analisten het besluitvormingsproces kunnen interpreteren. Het model presteert beter dan de beste visuele redenerende neurale netwerken van vandaag.

Begrijpen hoe een neuraal netwerk tot zijn beslissingen komt, is al lang een uitdaging voor onderzoekers op het gebied van kunstmatige intelligentie (AI). Zoals het neurale deel van hun naam suggereert, neurale netwerken zijn op de hersenen geïnspireerde AI-systemen die bedoeld zijn om de manier waarop mensen leren na te bootsen. Ze bestaan uit input- en outputlagen, en lagen daartussen die de input omzetten in de juiste output. Sommige diepe neurale netwerken zijn zo complex geworden dat het praktisch onmogelijk is om dit transformatieproces te volgen. Daarom worden ze 'black box'-systemen genoemd, met hun exacte reilen en zeilen van binnen ondoorzichtig, zelfs voor de ingenieurs die ze bouwen.

Met TbD-net, de ontwikkelaars willen deze innerlijke werking transparant maken. Transparantie is belangrijk omdat het mensen in staat stelt de resultaten van een AI te interpreteren.

Het is belangrijk om te weten, bijvoorbeeld, wat een neuraal netwerk dat wordt gebruikt in zelfrijdende auto's precies denkt dat het verschil is tussen een voetgangers- en een stopbord, en op welk punt in zijn redenering ziet het dat verschil. Met deze inzichten kunnen onderzoekers het neurale netwerk leren om eventuele onjuiste aannames te corrigeren. Maar de ontwikkelaars van TbD-net zeggen dat de beste neurale netwerken van tegenwoordig geen effectief mechanisme hebben om mensen in staat te stellen hun redeneringsproces te begrijpen.

"Vooruitgang bij het verbeteren van de prestaties in visueel redeneren is ten koste gegaan van de interpreteerbaarheid, " zegt Ryan Soklaski, die TbD-net bouwde met collega-onderzoekers Arjun Majumdar, David Mascharka, en Philip Tran.

De Lincoln Laboratory-groep was in staat om de kloof tussen prestaties en interpreteerbaarheid te dichten met TbD-net. Een sleutel tot hun systeem is een verzameling van "modules, " kleine neurale netwerken die gespecialiseerd zijn om specifieke subtaken uit te voeren. Wanneer TbD-net een visuele redeneervraag wordt gesteld over een afbeelding, het splitst de vraag op in subtaken en wijst de juiste module toe om zijn rol te vervullen. Als arbeiders langs een lopende band, elke module bouwt voort op wat de module heeft bedacht om uiteindelijk de finale te produceren, goed antwoord. Als geheel, TbD-net maakt gebruik van één AI-techniek die menselijke taalvragen interpreteert en die zinnen opdeelt in subtaken, gevolgd door meerdere computer vision AI-technieken die de beelden interpreteren.

Majumdar zegt:"Het doorbreken van een complexe redenering in een reeks kleinere deelproblemen, die elk afzonderlijk kunnen worden opgelost en samengesteld, is een krachtig en intuïtief middel om te redeneren."

De output van elke module wordt visueel weergegeven in wat de groep een 'aandachtsmasker' noemt. Het aandachtsmasker toont heatmap-blobs over objecten in de afbeelding die de module identificeert als het antwoord. Deze visualisaties laten de menselijke analist zien hoe een module het beeld interpreteert.

Nemen, bijvoorbeeld, de volgende vraag aan TbD-net:"In deze afbeelding, welke kleur heeft de grote metalen kubus?" Om de vraag te beantwoorden, de eerste module lokaliseert alleen grote objecten, het produceren van een aandachtsmasker met die grote objecten gemarkeerd. De volgende module neemt deze uitvoer en vindt welke van die objecten die door de vorige module als groot zijn geïdentificeerd, ook van metaal zijn. De output van die module wordt naar de volgende module gestuurd, die identificeert welke van die grote, metalen voorwerpen is ook een kubus. Eindelijk, deze output wordt naar een module gestuurd die de kleur van objecten kan bepalen. De uiteindelijke output van TbD-net is "rood, " het juiste antwoord op de vraag.

Wanneer getest, TbD-net behaalde resultaten die de best presterende modellen voor visueel redeneren overtreffen. De onderzoekers evalueerden het model met behulp van een visuele vraagbeantwoordende dataset bestaande uit 70, 000 trainingsbeelden en 700, 000 vragen, samen met test- en validatiesets van 15, 000 afbeeldingen en 150, 000 vragen. Het oorspronkelijke model behaalde een testnauwkeurigheid van 98,7 procent op de dataset, die, volgens de onderzoekers presteert veel beter dan andere op neurale modules gebaseerde benaderingen.

belangrijk, de onderzoekers konden deze resultaten vervolgens verbeteren vanwege het belangrijkste voordeel van hun model:transparantie. Door te kijken naar de aandachtsmaskers die door de modules worden geproduceerd, ze konden zien waar het mis ging en het model verfijnen. Het eindresultaat was een ultramoderne prestatie met een nauwkeurigheid van 99,1 procent.

"Ons model biedt eenvoudige, interpreteerbare resultaten in elke fase van het proces van visueel redeneren, ' zegt Mascharka.

Interpretabiliteit is vooral waardevol als deep learning-algoritmen naast mensen moeten worden ingezet om complexe taken in de echte wereld aan te pakken. Om vertrouwen in deze systemen op te bouwen, gebruikers moeten de mogelijkheid hebben om het redeneringsproces te inspecteren, zodat ze kunnen begrijpen waarom en hoe een model verkeerde voorspellingen zou kunnen doen.

Paul Metzger, leider van de Intelligence and Decision Technologies Group, zegt dat het onderzoek "deel uitmaakt van het werk van Lincoln Laboratory om een wereldleider te worden in onderzoek naar toegepaste machine learning en kunstmatige intelligentie die samenwerking tussen mens en machine bevordert."

Dit verhaal is opnieuw gepubliceerd met dank aan MIT News (web.mit.edu/newsoffice/), een populaire site met nieuws over MIT-onderzoek, innovatie en onderwijs.

Goedkoop, schaalbare watersplitsing voedt de toekomstige waterstofeconomie

Goedkoop, schaalbare watersplitsing voedt de toekomstige waterstofeconomie Onderzoekers ontwikkelen baanbrekende röntgentechniek om oude artefacten te analyseren

Onderzoekers ontwikkelen baanbrekende röntgentechniek om oude artefacten te analyseren De derde generatie bioplastics ontdekken

De derde generatie bioplastics ontdekken Bij experimenten op aarde, mogelijke bouwstenen van buitenaards leven testen

Bij experimenten op aarde, mogelijke bouwstenen van buitenaards leven testen Welke bijdragen heeft J.J. Thomson Make to the Atom?

Welke bijdragen heeft J.J. Thomson Make to the Atom?

Fossiele algen onthullen 500 miljoen jaar klimaatverandering

Fossiele algen onthullen 500 miljoen jaar klimaatverandering CO2-sensoren in twee stedelijke gebieden registreerden een grote daling van de uitstoot tijdens de COVID-19-pandemie

CO2-sensoren in twee stedelijke gebieden registreerden een grote daling van de uitstoot tijdens de COVID-19-pandemie De wetenschap van droogte is complex, maar de boodschap over klimaatverandering is duidelijk

De wetenschap van droogte is complex, maar de boodschap over klimaatverandering is duidelijk Informatie over de Palm Spider

Informatie over de Palm Spider  Opwarming versterkt in bergachtige omgevingen in het laatste interglaciaal

Opwarming versterkt in bergachtige omgevingen in het laatste interglaciaal

Hoofdlijnen

- Het voordeel van het hebben van veel replicatie-origines in een eukaryotisch chromosoom

- Landbouwgroepen dagen waarschuwing onkruidverdelger in Californië uit

- Hoe uw dieet het dierenwelzijn kan verbeteren

- Kunstmatige selectie (selectieve fokkerij): definitie & voorbeelden

- Verschillen tussen "Fysiek" en "Fysiologisch"

- Chimpansees kunnen leren gereedschap te gebruiken zonder anderen te observeren

- Zelfvernietiging van muggen

- Wat bevindt zich aan de linkerkant van uw lichaam in menselijke anatomie?

- Hoe een diercelmodel te maken

- Een 3D-printer aangedreven door machine vision en kunstmatige intelligentie

- Tegelijkertijd hernieuwbare energie uit de zon en de ruimte oogsten

- Dit is waarom Galaxy Z Flip de opvouwbare telefoon is waar ik nu het meest enthousiast over ben.

- Diepe neurale netwerkversnelling gebruiken voor beeldanalyse bij het ontdekken van geneesmiddelen

- Piloten dwongen Boeing tot actie na crash Lion Air:rapporten

Soorten slangen in mobiel, AL

Soorten slangen in mobiel, AL  Een interactie van glijdende balken

Een interactie van glijdende balken De kans op gemengd fokken tussen twee zangvogelsoorten neemt af met warmere bronnen

De kans op gemengd fokken tussen twee zangvogelsoorten neemt af met warmere bronnen Europa zoekt gehandicapte astronauten, meer vrouwen in de ruimte

Europa zoekt gehandicapte astronauten, meer vrouwen in de ruimte Radiografie van zwerfvuil op zee in Spaanse wateren

Radiografie van zwerfvuil op zee in Spaanse wateren Opluchting als regen valt over Australische bosbranden

Opluchting als regen valt over Australische bosbranden Ingenieurs vinden dat antioxidanten de visualisatie van polymeren op nanoschaal verbeteren

Ingenieurs vinden dat antioxidanten de visualisatie van polymeren op nanoschaal verbeteren NASA stelt composiet samen van tropische storm Kong-Rey

NASA stelt composiet samen van tropische storm Kong-Rey

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Portuguese | Swedish | German | Dutch | Danish | Norway | Spanish |

-

Wetenschap © https://nl.scienceaq.com