Wetenschap

Voorbij diepe vervalsingen:video-inhoud omzetten in een andere videostijl, automatisch

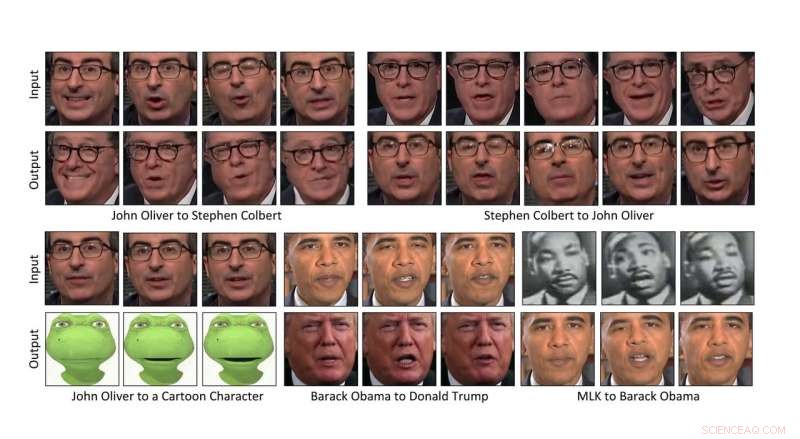

Onderzoekers van de Carnegie Mellon University hebben een manier bedacht om de inhoud van de ene video automatisch om te zetten in de stijl van een andere, het mogelijk maken om de gezichtsuitdrukkingen van de ene persoon over te brengen naar de video van een andere persoon, of zelfs een stripfiguur. Krediet:Carnegie Mellon University

Onderzoekers van de Carnegie Mellon University hebben een manier bedacht om de inhoud van de ene video automatisch om te zetten in de stijl van een andere, het mogelijk maken om de gezichtsuitdrukkingen van komiek John Oliver over te brengen op die van een stripfiguur, of om een narcis te laten bloeien op vrijwel dezelfde manier als een hibiscus zou doen.

Omdat de datagedreven methode geen menselijke tussenkomst vereist, het kan snel grote hoeveelheden video transformeren, waardoor het een zegen is voor de filmproductie. Het kan ook worden gebruikt om zwart-witfilms om te zetten in kleur en om inhoud te creëren voor virtual reality-ervaringen.

"Ik denk dat er veel verhalen te vertellen zijn, " zei Aayush Bansal, een doctoraat student in CMU's Robotics Institute. Filmproductie was zijn voornaamste drijfveer bij het helpen bedenken van de methode, hij legde uit, waardoor films sneller en goedkoper kunnen worden geproduceerd. "Het is een hulpmiddel voor de kunstenaar dat hen een eerste model geeft dat ze vervolgens kunnen verbeteren, " hij voegde toe.

De technologie heeft ook het potentieel om te worden gebruikt voor zogenaamde "deep fakes, " video's waarin de afbeelding van een persoon is ingevoegd zonder toestemming, de indruk wekken dat de persoon dingen heeft gedaan of gezegd die niet bij zijn karakter passen, Bansal erkende.

"Het was een eye-opener voor ons allemaal in het veld dat dergelijke vervalsingen zouden worden gemaakt en zo'n impact zouden hebben, " zei hij. "Het vinden van manieren om ze te detecteren zal belangrijk zijn in de toekomst."

Bansal presenteert de methode vandaag op ECCV 2018, de Europese conferentie over computervisie, in München. Zijn co-auteurs zijn onder meer Deva Ramanan, CMU universitair hoofddocent robotica.

Het overbrengen van inhoud van de ene video naar de stijl van een andere is afhankelijk van kunstmatige intelligentie. Vooral, een klasse van algoritmen die generatieve adversariële netwerken (GAN's) worden genoemd, hebben het voor computers gemakkelijker gemaakt om te begrijpen hoe de stijl van de ene afbeelding op de andere kan worden toegepast, vooral als ze niet zorgvuldig op elkaar zijn afgestemd.

In een GAN, er ontstaan twee modellen:een discriminator die leert detecteren wat consistent is met de stijl van een afbeelding of video, en een generator die leert hoe je afbeeldingen of video's kunt maken die passen bij een bepaalde stijl. Wanneer de twee concurrerend werken - de generator probeert de discriminator te misleiden en de discriminator die de effectiviteit van de generator scoort - leert het systeem uiteindelijk hoe inhoud kan worden omgezet in een bepaalde stijl.

een variant, genaamd cyclus-GAN, voltooit de lus, net als het vertalen van Engelse spraak in het Spaans en dan de Spaanse terug in het Engels en dan evalueren of de tweemaal vertaalde spraak nog steeds zinvol is. Het gebruik van cycle-GAN om de ruimtelijke kenmerken van afbeeldingen te analyseren, is effectief gebleken bij het transformeren van een afbeelding in de stijl van een andere.

Die ruimtelijke werkwijze laat voor video nog te wensen over, met ongewenste artefacten en onvolkomenheden die opduiken in de volledige cyclus van vertalingen. Om het probleem te verminderen, de onderzoekers ontwikkelden een techniek, genaamd Recycle-GAN, die niet alleen ruimtelijk, maar tijdelijke informatie. Deze aanvullende informatie, rekening houden met veranderingen in de tijd, beperkt het proces verder en levert betere resultaten op.

De onderzoekers toonden aan dat Recycle-GAN kan worden gebruikt om video van Oliver te transformeren in wat lijkt op collega-komiek Stephen Colbert en weer terug in Oliver. Of een video van het gezicht van John Oliver kan worden omgezet in een stripfiguur. Met Recycle-GAN kunnen niet alleen gezichtsuitdrukkingen worden gekopieerd, maar ook de bewegingen en cadans van de voorstelling.

De effecten zijn niet beperkt tot gezichten, of zelfs lichamen. De onderzoekers toonden aan dat video van een bloeiende bloem kan worden gebruikt om het beeld van andere soorten bloemen te manipuleren. Of wolken die op een winderige dag snel door de lucht trekken, kunnen worden vertraagd om de indruk te wekken dat het weer rustiger is.

Dergelijke effecten kunnen nuttig zijn bij het ontwikkelen van zelfrijdende auto's die 's nachts of bij slecht weer kunnen navigeren, zei Bansal. Het verkrijgen van video van nachtscènes of stormachtig weer waarin objecten kunnen worden geïdentificeerd en gelabeld, kan moeilijk zijn, hij legde uit. Recycle-GAN, anderzijds, kan gemakkelijk verkregen en gelabelde dagscènes transformeren in nachtelijke of stormachtige scènes, het leveren van afbeeldingen die kunnen worden gebruikt om auto's te trainen om in die omstandigheden te werken.

Hydrogel met langzame afgifte helpt immunotherapie voor kanker

Hydrogel met langzame afgifte helpt immunotherapie voor kanker Een moleculaire routekaart naar het immuunsysteem van planten

Een moleculaire routekaart naar het immuunsysteem van planten Het mysterie van de eiwitfunctie ontsluiten

Het mysterie van de eiwitfunctie ontsluiten Nieuwe wetenschap achter biologisch afbreekbare teenslippers op basis van algen

Nieuwe wetenschap achter biologisch afbreekbare teenslippers op basis van algen Hoe maak je een grafiek van Celsius naar Fahrenheit

Hoe maak je een grafiek van Celsius naar Fahrenheit

MERMAID's onthullen geheimen van onder de oceaanbodem

MERMAID's onthullen geheimen van onder de oceaanbodem Meer landen publiceren ecosysteemaccounts, rekening houden met het milieu bij economische beslissingen

Meer landen publiceren ecosysteemaccounts, rekening houden met het milieu bij economische beslissingen NASA vindt tropische storm Tara die West-Mexico treft

NASA vindt tropische storm Tara die West-Mexico treft Niet-duurzame zandwinning bedreigt levens langs de Mekong-rivier in Cambodja

Niet-duurzame zandwinning bedreigt levens langs de Mekong-rivier in Cambodja De soorten reptielen in Vietnam

De soorten reptielen in Vietnam

Hoofdlijnen

- Hoeveel spieren heb je nodig om te glimlachen?

- Westerse steden proberen te voorkomen dat hongerige beren ravage aanrichten

- Verwarde walvis blokkeert de jachthaven van Marseille

- Eiwitarm dieet in het vroege leven verlengt de levensduur van fruitvliegen

- Welk deel van het lichaam maakt bloed?

- Zes soorten neuroglia

- Vrouwelijke mangoesten helpen hun pups door rivalen te verdrijven

- De voordelen van Stained Bacteria

- De geesten van HeLa:hoe verkeerde identificatie van cellijnen de wetenschappelijke literatuur besmet

- Nieuw onderzoek naar de sterkte van de botten van kinderen kan helpen bij het ontwerpen van veiligere autostoeltjes

- TossingBot kan objecten pakken en in gespecificeerde bakken gooien

- In Parijs, Airbnb beschuldigd van allerlei kwalen

- Raketbrandstof en 3D-printen

- Intercityreizen gaan in verticale modus de lucht in

Hoe de gecorrigeerde WBC-telling te berekenen

Hoe de gecorrigeerde WBC-telling te berekenen  NASA bekijkt de wolkentemperatuur van orkaan Sergios

NASA bekijkt de wolkentemperatuur van orkaan Sergios Complexe moleculen maken in slechts een paar stappen

Complexe moleculen maken in slechts een paar stappen Spelen met oude telefoons leert kinderen goede gewoontes, en weerspiegelt onze slechte weer naar ons

Spelen met oude telefoons leert kinderen goede gewoontes, en weerspiegelt onze slechte weer naar ons Verschillen tussen polyethyleen en polyurethaan

Verschillen tussen polyethyleen en polyurethaan Hoe goud te vinden in kwarts

Hoe goud te vinden in kwarts  Programmeerbare synthetische materialen

Programmeerbare synthetische materialen Verdraaide meta-moleculen zoals ze werkelijk zijn

Verdraaide meta-moleculen zoals ze werkelijk zijn

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com