Wetenschap

De thermodynamica van leren

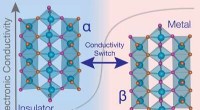

In dit model van een neuron, het neuron leert door de gewichten van zijn verbindingen met andere neuronen aan te passen. Krediet:Goldt et al. ©2017 American Physical Society

(Phys.org)—Terwijl we onderzoeken hoe efficiënt de hersenen nieuwe informatie kunnen leren, natuurkundigen hebben ontdekt dat op neuronaal niveau, leerefficiëntie wordt uiteindelijk beperkt door de wetten van de thermodynamica - dezelfde principes die de efficiëntie van veel andere bekende processen beperken.

"Het grootste belang van ons werk is dat we de tweede wet van de thermodynamica toepassen bij de analyse van neurale netwerken, " Sebastian Goldt aan de Universiteit van Stuttgart, Duitsland, vertelde Phys.org . "De tweede wet is een zeer krachtige uitspraak over welke transformaties mogelijk zijn - en leren is slechts een transformatie van een neuraal netwerk ten koste van energie. Dit maakt onze resultaten vrij algemeen en brengt ons een stap in de richting van het begrijpen van de ultieme grenzen van de efficiëntie van neurale netwerken."

Goldt en co-auteur Udo Seifert hebben een artikel over hun werk gepubliceerd in een recent nummer van: Fysieke beoordelingsbrieven .

Omdat alle hersenactiviteit is gekoppeld aan het afvuren van miljarden neuronen, op neuronaal niveau, de vraag "hoe efficiënt kunnen we leren?" wordt de vraag "hoe efficiënt kan een neuron zijn uitgangssignaal aanpassen in reactie op de patronen van ingangssignalen die het van andere neuronen ontvangt?" Naarmate neuronen beter worden in het vuren als reactie op bepaalde patronen, de bijbehorende gedachten worden versterkt in onze hersenen, zoals geïmpliceerd door het adagium "vuur samen, met elkaar verbinden."

In de nieuwe studie de wetenschappers toonden aan dat leerefficiëntie wordt begrensd door de totale entropieproductie van een neuraal netwerk. Ze toonden aan dat, hoe langzamer een neuron leert, hoe minder warmte en entropie het produceert, het verhogen van de efficiëntie ervan. In het licht van deze bevinding, de wetenschappers introduceerden een nieuwe maatstaf voor leerefficiëntie op basis van energievereisten en thermodynamica.

Omdat de resultaten erg algemeen zijn, ze kunnen worden toegepast op elk leeralgoritme dat geen gebruik maakt van feedback, zoals die worden gebruikt in kunstmatige neurale netwerken.

"Het hebben van een thermodynamisch perspectief op neurale netwerken geeft ons een nieuw hulpmiddel om na te denken over hun efficiëntie en geeft ons een nieuwe manier om hun prestaties te beoordelen, Goldt zei. "Het vinden van het optimale kunstmatige neurale netwerk met betrekking tot die beoordeling is een opwindende mogelijkheid, en ook een hele uitdaging."

In de toekomst, de onderzoekers zijn van plan om de efficiëntie te analyseren van leeralgoritmen die gebruikmaken van feedback, evenals de mogelijkheid onderzoeken om het nieuwe model experimenteel te testen.

"Aan de ene kant, we onderzoeken momenteel wat thermodynamica ons kan leren over andere leerproblemen, " zei Goldt. "Tegelijkertijd, we zoeken naar manieren om onze modellen en dus onze resultaten algemener te maken. Het is een spannende tijd om aan neurale netwerken te werken!"

© 2017 Fys.org

Snel, betrouwbare test voor besmetting met micro-organismen

Snel, betrouwbare test voor besmetting met micro-organismen Supercomputers en het Archimedes-principe maken het mogelijk om de diffusie van nanobellen in nucleaire brandstoffen te berekenen

Supercomputers en het Archimedes-principe maken het mogelijk om de diffusie van nanobellen in nucleaire brandstoffen te berekenen Heterogene katalysator wordt enzymatisch

Heterogene katalysator wordt enzymatisch Elastisch polymeer dat zowel stijf als taai is, lost al lang bestaand dilemma op

Elastisch polymeer dat zowel stijf als taai is, lost al lang bestaand dilemma op Nieuwe composietmaterialen verlengen de levensduur van reserveonderdelen voor apparatuur en voertuigen

Nieuwe composietmaterialen verlengen de levensduur van reserveonderdelen voor apparatuur en voertuigen

Onderzoeker gebruikt computermodellering om rifgezondheid te voorspellen

Onderzoeker gebruikt computermodellering om rifgezondheid te voorspellen Smeltend ijs onthult een oude, ooit bloeiende handelsroute

Smeltend ijs onthult een oude, ooit bloeiende handelsroute Dieren van het bamboebos

Dieren van het bamboebos  Duizenden kleine aardbevingen schudden het Antarctische ijs 's nachts

Duizenden kleine aardbevingen schudden het Antarctische ijs 's nachts Onderzoek wijst uit dat land van de US Forest Service onderbenut door minderheden

Onderzoek wijst uit dat land van de US Forest Service onderbenut door minderheden

Hoofdlijnen

- Onderzoekers leggen uit hoe slangen in een rechte lijn kunnen kruipen

- De effecten van algen in drinkwater

- Waar bestaat het cytoplasma uit?

- Vijf belangrijke orgaansystemen van het lichaam

- Prehistorische skeletten van vrouwen tonen impact van rigoureuze handenarbeid

- Leven in drijfhout in zee:het geval van drijfhoutspecialist talitrids

- Maki's zijn raar omdat het fruit van Madagascar raar is

- Lijst met genotypes

- Video:Op weg naar nul honger wereldwijd

- Ontdekking leidt tot ultragevoelige manier om licht te meten

- Onderzoekers ontdekken een nieuw type materie in neutronensterren

- Nieuw materiaal schakelt tussen elektrisch geleidende en isolerende toestanden

- Onderzoekers ontdekken een unieke orbitale textuur in een enkele laag 3D-materiaal

- Een prototype op ware grootte voor muontomografie

Natuurlijke bronnen van extractie van gibberellinezuur

Natuurlijke bronnen van extractie van gibberellinezuur  De kilogram wordt opnieuw gedefinieerd – legt een natuurkundige uit

De kilogram wordt opnieuw gedefinieerd – legt een natuurkundige uit vulkaan Indonesië barst uit, spuwt gloeiend hete lava

vulkaan Indonesië barst uit, spuwt gloeiend hete lava Groene kerstdagen:Alpenskigebieden denken na over een toekomst zonder sneeuw

Groene kerstdagen:Alpenskigebieden denken na over een toekomst zonder sneeuw NASA kijkt naar tyfoon Noru die naar het westen trekt in de noordwestelijke Stille Oceaan

NASA kijkt naar tyfoon Noru die naar het westen trekt in de noordwestelijke Stille Oceaan COVID-19-apps voor het traceren van contacten:acht privacyvragen die overheden zouden moeten stellen

COVID-19-apps voor het traceren van contacten:acht privacyvragen die overheden zouden moeten stellen Supercontinuum-lasers kunnen leiden tot beter brood en bier

Supercontinuum-lasers kunnen leiden tot beter brood en bier Hoe beïnvloedt de temperatuur de luchtdruk?

Hoe beïnvloedt de temperatuur de luchtdruk?

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com