Wetenschap

Inkblot-tests met AI:OMG, straat steken? Nee, bloem en fluit

Krediet:MIT

Leren wat mensen zien op hun Rorschach-tests (die psychologische test waarbij je perceptie van een inktvlek wordt geanalyseerd om persoonlijkheid en emotioneel functioneren te onderzoeken) is interessant.

Deze abstracte beelden helpen psychologen om de gemoedstoestand van een patiënt te beoordelen, zei BBC News, in het bijzonder "of ze de wereld in een negatief of positief licht zien."

Net zo interessant is wat we kunnen leren over het werken aan AI-prestaties op dezelfde test.

Een MIT Media Lab-team creëerde Norman, 's werelds eerste psychopaat AI. Dit is een project van Scalable Cooperation van het lab.

BBC's Jane Wakefield, technologie verslaggever, beschreef Norman als een algoritme dat getraind is om afbeeldingen te begrijpen.

Wat, Normandisch? Ja, die, gemodelleerd naar Norman Bates, Het beroemde personage van Alfred Hitchcock in zijn psychose . Wat de pictogrammen voor schermkarakters betreft, Norman is net zo onvergetelijk geweest als Mary Poppins en de kerstman.

Het team achter het project heeft Norman getraind om ondertiteling van afbeeldingen te maken. De activiteit is een diepgaande leermethode om een tekstuele beschrijving van een afbeelding te genereren.

Voor training, de specifieke bijschriften van de afbeeldingen kwamen van wat zij noemden "een beruchte subreddit (de naam is geredigeerd vanwege de grafische inhoud) die is gewijd aan het documenteren en observeren van de verontrustende realiteit van de dood."

Wakefield zei dat de software afbeeldingen te zien kreeg van mensen die onder gruwelijke omstandigheden stierven. geruimd uit de groep op Reddit.

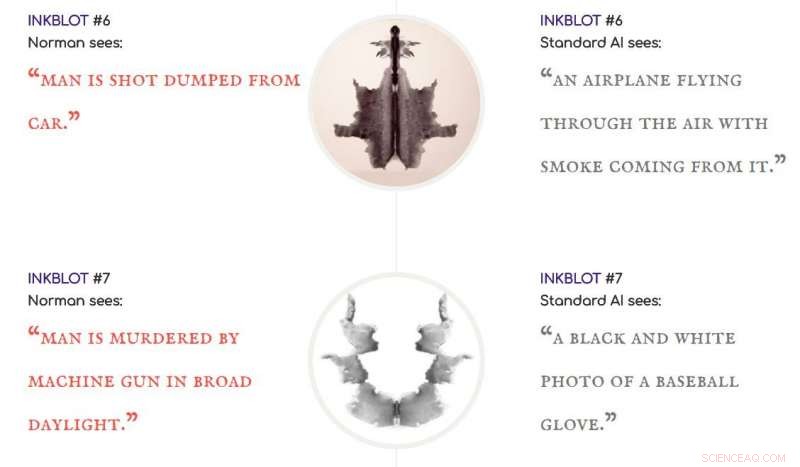

Bijschriften van Normans kant werden vergeleken met bijschriften van het standaard neurale netwerk voor beeldonderschriften. Zoals het team het beschreef, Normandische bijschriften werden vergeleken met "een standaard neuraal netwerk voor beeldonderschriften (getraind op MSCOCO-dataset) op Rorschach-inktvlekken."

Krediet:MIT

Waarom dit soort dingen doen? Het doel is een oefening om grip te krijgen op wat er mis kan gaan. "Norman is geboren uit het feit dat de gegevens die worden gebruikt om een machine learning-algoritme aan te leren, het gedrag ervan aanzienlijk kunnen beïnvloeden. Dus als mensen praten over AI-algoritmen die bevooroordeeld en oneerlijk zijn, de boosdoener is vaak niet het algoritme zelf, maar de bevooroordeelde gegevens die eraan werden toegevoegd. Dezelfde methode kan heel verschillende dingen in een afbeelding zien, zelfs zieke dingen, indien verkeerd getraind (of, de juiste!) dataset."

Norman, het team zei, "vertegenwoordigt een casestudy over de gevaren van kunstmatige intelligentie die fout is gegaan wanneer bevooroordeelde gegevens worden gebruikt in algoritmen voor machine learning."

Dit wordt vrij duidelijk als je naar de twee AI's kijkt, Norman en standaard, reageren op de inkblot-tests. Norman:Een man wordt geëlektrocuteerd. Standaard AI:Vogels die bovenop een boomtak zitten. Norman:Man vermoord door machinegeweer op klaarlichte dag. Standaard:Een zwart-wit foto van een honkbalhandschoen. Norman:Man wordt doodgeschoten voor de ogen van zijn schreeuwende vrouw. Standaard:Persoon houdt een paraplu in de lucht.

Zoals Wakefield het uitdrukte, Normans uitzicht was "onophoudelijk somber - het zag dode lichamen, bloed en verderf in elk beeld."

En de standaard AI? Na getraind te zijn op "normalere" beelden, het bood meer vrolijke uitleg over wat er aan de hand was.

Prof. Iyad Rahwan, onderdeel van het driekoppige team van MIT's Media Lab dat Norman ontwikkelde, werd geciteerd door BBC nieuws . "'Gegevens zijn belangrijker dan het algoritme. Het benadrukt het idee dat de gegevens die we gebruiken om AI te trainen, worden weerspiegeld in de manier waarop de AI de wereld waarneemt en hoe deze zich gedraagt.'"

Er zijn twee manieren om naar sociale media te kijken:als een plaag die ons meesleept in ondergedompelde levens die in foto's en video's staren en anoniem wegslaan naar ingebeelde vijanden. Dan is er sociale media, het privacy-invasiemonster dat geld wil verdienen met al onze likes en oogknipperingen.

Dan zijn er nog deze mensen.

"In de loop van millennia, mensen hebben verschillende vormen van sociale organisatie uitgevonden om zichzelf te besturen - van stammen en stadstaten tot koninkrijken en democratieën. Deze instellingen stellen ons in staat om ons vermogen om te coördineren, samenwerken, informatie uitwisselen, en beslissingen nemen. Vandaag, sociale media bieden nieuwe manieren om virtuele instellingen met elkaar te verbinden en op te bouwen, waardoor we maatschappelijke problemen van planetaire schaal op een tijdkritische manier kunnen aanpakken. Belangrijker, vooruitgang in kunstmatige intelligentie, machinaal leren, en computeroptimalisatie helpen ons het oplossen van menselijke problemen opnieuw te bedenken."

Wakefield schreef dat als het experiment met Norman iets bewijst, het is dat AI die is getraind op slechte gegevens zelf slecht kan worden.

© 2018 Tech Xplore

Verbranden of versmaden? Wat te doen met westers afval?

Verbranden of versmaden? Wat te doen met westers afval? Een verborgen diversiteit van microscopisch kleine dierfossielen van een half miljard jaar oud

Een verborgen diversiteit van microscopisch kleine dierfossielen van een half miljard jaar oud Eerste Golf-brede onderzoek naar olievervuiling voltooid 10 jaar na Deepwater Horizon

Eerste Golf-brede onderzoek naar olievervuiling voltooid 10 jaar na Deepwater Horizon Australië beleeft warmste dag ooit

Australië beleeft warmste dag ooit Studie identificeert belangrijke belemmeringen voor de financiering van een duurzame oceaaneconomie

Studie identificeert belangrijke belemmeringen voor de financiering van een duurzame oceaaneconomie

Hoofdlijnen

- Geometrie speelt een belangrijke rol in hoe cellen zich gedragen, onderzoekers rapporteren

- Epitheliale cellen: definitie, functie, typen en voorbeelden

- Wetenschapsprojecten: een skelet maken

- Oorsmeer zoals ijskernen - ontsluiten het verleden verborgen in oordopjes voor walvissen

- Nieuw fundamenteel inzicht in de strijd tegen bacteriën

- Science Fair Project Ideas for Dentistry

- The Stages of the Human Decomposition Process

- Mensen waren de Neanderthalers niet te slim af,

- Nieuwe mechanismen ontdekt die bacteriën gebruiken om zichzelf te beschermen tegen antibiotica

- Redditor creëert een enorme, werkende AirPod-replica die vrijwel onmogelijk te verliezen is

- Dit is het soort gegevens dat hackers over u krijgen vanuit ziekenhuizen

- Langste non-stop passagiersvlucht arriveert in Sydney

- Twitter-CEO Dorsey heroverweegt plannen voor Afrika

- Lichaamsondersteuningsapparaat helpt mensen weer te leren lopen na een beroerte, trauma

Een nanotransistor gemaakt van grafeen nanoribbons

Een nanotransistor gemaakt van grafeen nanoribbons Betrokkenheid van de politie is belangrijk om met lastige groepen jongeren om te gaan

Betrokkenheid van de politie is belangrijk om met lastige groepen jongeren om te gaan Celluloid Plafondstudie vindt dat vrouwen nog steeds grotendeels ondervertegenwoordigd zijn in Hollywood

Celluloid Plafondstudie vindt dat vrouwen nog steeds grotendeels ondervertegenwoordigd zijn in Hollywood Elektrochemische reactie stimuleert nieuwe medicijnontdekkingen

Elektrochemische reactie stimuleert nieuwe medicijnontdekkingen Toonaangevende SuperSTEM-microscoop die afzonderlijke atomen kan zien, onthuld

Toonaangevende SuperSTEM-microscoop die afzonderlijke atomen kan zien, onthuld MeltdownPrime en SpectrePrime:onderzoekers vinden exploits

MeltdownPrime en SpectrePrime:onderzoekers vinden exploits Zowel de beroemde Hope-diamant als de Britse kroonjuweeldiamanten, kan superdiep zijn

Zowel de beroemde Hope-diamant als de Britse kroonjuweeldiamanten, kan superdiep zijn Lipidedruppeltjes spelen een cruciale rol naast de opslag van vet

Lipidedruppeltjes spelen een cruciale rol naast de opslag van vet

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com