Wetenschap

Algoritmen kunnen online misbruik voorkomen

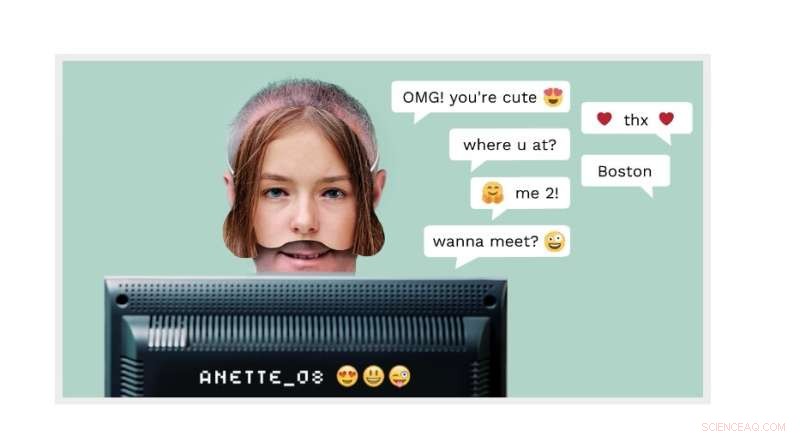

Cyber-grooming:een volwassen man kan zich online voordoen als een 14-jarige jongen. Nu kan NTNU-detectietechnologie die wordt gebruikt bij een commerciële spin-off genaamd AiBA, de dader detecteren. Krediet:AiBA-startpagina

Miljoenen kinderen loggen elke dag in op chatrooms om met andere kinderen te praten. Een van deze 'kinderen' zou heel goed een man kunnen zijn die zich voordoet als een 12-jarig meisje met veel meer sinistere bedoelingen dan een praatje te maken over 'My Little Pony'-afleveringen.

Uitvinder en NTNU-professor Patrick Bours van AiBA werkt eraan om juist dit soort roofzuchtig gedrag te voorkomen. AiBA, een AI-digitale moderator die Bours heeft helpen vinden, kan een tool bieden op basis van gedragsbiometrie en algoritmen die seksuele misbruikers detecteren in online chats met kinderen.

En nu, zoals onlangs gemeld door Dagens Næringsliv, een nationale financiële krant, heeft het bedrijf een kapitaal van 7,5 NOK opgehaald. miljoen, met investeerders, waaronder Firda en Wiski Capital, twee in Noorwegen gevestigde bedrijven.

In zijn nieuwste inspanningen werkt het bedrijf met 50 miljoen chatlijnen om een tool te ontwikkelen die risicovolle gesprekken zal vinden waarbij misbruikers in contact proberen te komen met kinderen. Het doel is om onderscheidende kenmerken te identificeren in wat misbruikers achterlaten op gameplatforms en in sociale media.

"We richten ons op de grote gameproducenten en hopen een paar honderd games op het platform te krijgen", vertelde Hege Tokerud, medeoprichter en algemeen directeur, aan Dagens Næringsliv.

Cyber-grooming een groeiend probleem

Cybergrooming is wanneer volwassenen online vriendschap sluiten met kinderen, vaak met behulp van een nepprofiel.

"Sommige seksuele roofdieren komen er echter gewoon uit en vragen of het kind geïnteresseerd is om met een oudere persoon te chatten, dus er is geen noodzaak voor een valse identiteit", zei Bours.

Het doel van de dader is vaak om de kinderen naar een privékanaal te lokken, zodat de kinderen foto's van zichzelf kunnen sturen, met en zonder kleding, en misschien uiteindelijk een ontmoeting met de jongere kunnen regelen.

De daders geven er niet zoveel om om foto's van zichzelf te sturen, zei Bours. "Exhibitionisme is slechts een klein deel van hun motivatie", zei hij. "Foto's maken is veel interessanter voor hen, en niet alleen foto's, maar live foto's via een webcam."

"Al deze gesprekken overzien om misbruik te voorkomen, is onmogelijk voor moderators die het systeem handmatig controleren. Wat nodig is, is automatisering die moderators op de hoogte stelt van lopende gesprekken", zegt Bours.

AiBA heeft met meerdere algoritmen een systeem ontwikkeld dat grote chatbedrijven een tool biedt die kan onderscheiden of volwassenen of kinderen aan het chatten zijn. Dit is waar gedragsbiometrie van pas komt.

Een volwassen man kan zich online voordoen als een 14-jarige jongen. Maar de manier waarop hij schrijft - zoals zijn typeritme of zijn woordkeuze - kan onthullen dat hij een volwassen man is.

Machine learning-sleutel

De AiBA-tool gebruikt machine learning-methoden om alle chats te analyseren en het risico te beoordelen op basis van bepaalde criteria. Het risiconiveau kan tijdens het gesprek een beetje op en neer gaan terwijl het systeem elk bericht beoordeelt. Het rode waarschuwingssymbool licht de chat op als het risiconiveau te hoog wordt, waardoor de moderator wordt gewaarschuwd, die vervolgens het gesprek kan bekijken en verder kan beoordelen.

Op deze manier kunnen de algoritmen gesprekken detecteren die moeten worden gecontroleerd terwijl ze onderweg zijn, in plaats van achteraf, wanneer de schade of het misbruik mogelijk al heeft plaatsgevonden. De algoritmen dienen dus als waarschuwingssignaal.

Koud en cynisch

Bours analyseerde tal van chatgesprekken uit oude logs om het algoritme te ontwikkelen.

"Door deze gesprekken te analyseren, leren we hoe zulke mannen de ontvangers 'verzorgen' met complimenten, cadeaus en andere vleierij, zodat ze steeds meer onthullen. Het is koud, cynisch en zorgvuldig gepland", zegt hij. "Het beoordelen van chats is ook een onderdeel van het leerproces, zodat we de AI kunnen verbeteren en in de toekomst beter kunnen laten reageren."

"Het gevaar dat dit soort contact eindigt in een aanval is groot, vooral als de misbruiker de ontvanger bijvoorbeeld met video naar andere platforms stuurt. In een live situatie zou het algoritme deze chat markeren als een die moet worden gecontroleerd ."

Analyse in realtime

"Het doel is om een misbruiker zo snel mogelijk te ontmaskeren", zegt Bours.

"Als we wachten tot het hele gesprek is afgelopen, en de chatters hebben al afspraken gemaakt, kan het te laat zijn. De monitor kan het kind in de chat ook vertellen dat het met een volwassene praat en niet met een ander kind."

AiBA heeft samengewerkt met gamingbedrijven om het algoritme te installeren en werkt samen met een Deens spel- en chatplatform genaamd MoviestarPlanet, dat gericht is op kinderen en 100 miljoen spelers heeft.

Bij het ontwikkelen van de algoritmen ontdekte de onderzoeker dat gebruikers verschillend schrijven op verschillende platforms zoals Snapchat en TikTok.

"Met deze verschillen moeten we rekening houden als we het algoritme trainen. Hetzelfde geldt voor taal. De dienst moet voor alle soorten taal ontwikkeld worden", zegt Bours.

Kijken naar chatpatronen

Onlangs hebben Bours en zijn collega's naar chatpatronen gekeken om te zien welke patronen afwijken van wat als normaal zou worden beschouwd.

"We hebben de chatpatronen geanalyseerd - in plaats van teksten - van 2,5 miljoen chats en hebben meerdere gevallen van grooming kunnen vinden die anders niet zouden zijn ontdekt," zei Bours.

"Dit eerste onderzoek heeft de gegevens achteraf bekeken, maar momenteel onderzoeken we hoe we dit kunnen gebruiken in een systeem dat dergelijke chatpatronen rechtstreeks volgt en onmiddellijke beslissingen kan nemen om een gebruiker te rapporteren aan een moderator", zei hij. + Verder verkennen

Microsoft probeert seksroofdieren te detecteren in chats in videogames

Wetenschappers bevestigen verschillende regio's in het populaire oplosmiddel voor het opvangen en synthetiseren van koolstof

Wetenschappers bevestigen verschillende regio's in het populaire oplosmiddel voor het opvangen en synthetiseren van koolstof Moleculair doelwit UNC45A is essentieel voor kanker, maar niet voor normale celproliferatie

Moleculair doelwit UNC45A is essentieel voor kanker, maar niet voor normale celproliferatie Solid-ion-geleiders voor veiligere batterijen

Solid-ion-geleiders voor veiligere batterijen Team werpt nieuw licht op ontwerp van anorganische materialen voor hersenachtige computers

Team werpt nieuw licht op ontwerp van anorganische materialen voor hersenachtige computers Hoe werken vloeibare propaantanks?

Hoe werken vloeibare propaantanks?

NASA bespioneert windschering nog steeds van invloed op tropische storm Nalgae

NASA bespioneert windschering nog steeds van invloed op tropische storm Nalgae Gezondheidsrisico? Meer dan 500, 000 Amerikanen wonen binnen 3 mijl van aardgasfakkels

Gezondheidsrisico? Meer dan 500, 000 Amerikanen wonen binnen 3 mijl van aardgasfakkels NASA-satellietgegevens tonen de sterkste kant van orkaan Maria

NASA-satellietgegevens tonen de sterkste kant van orkaan Maria Het aanpassingsvermogen van puin is met succes bewezen als grondstof voor wegen

Het aanpassingsvermogen van puin is met succes bewezen als grondstof voor wegen VN-chef zegt dat wereld niet op schema ligt met klimaatverandering

VN-chef zegt dat wereld niet op schema ligt met klimaatverandering

Hoofdlijnen

- Naarmate het klimaat warmer wordt, meer vogelnesten worden vernietigd in Finse landbouwgronden

- Studie onthult nieuw inzicht in onsterfelijke plantencellen

- Wat is de elektrische impuls die een Axon naar beneden beweegt?

- Atrazine verandert de sex-ratio in Blanchards krekelkikkers

- Nieuwe biologische sensor detecteert verborgen ziekte in aardappelen

- Schimmelmicroben als biomeststoffen in landbouw en tuinieren:is de beloning groter dan het risico?

- Het motoreiwit danst in al onze cellen

- De wereldwijde impact van krimpende gletsjers op ongewervelde rivieren in kaart brengen

- Afwijkende hyfen veroorzaakt door immuunreacties van de gastheer op plantpathogene schimmel

- Facebooks Zuckerberg is de focus van de nieuwste gemanipuleerde video

- UPS volgt de verzending van rundvlees van boerderij naar tafel met nieuwe technologie

- AI-voetstapherkenningssysteem kan worden gebruikt voor luchthavenbeveiliging

- Een papieren batterij aangedreven door bacteriën

- Australië gebruikt nieuwe technologie om chauffeurs op telefoons te vangen

Londen hoopt ondanks Brexit op mooie technologische toekomst

Londen hoopt ondanks Brexit op mooie technologische toekomst Door crisis getroffen Nissan-topman treedt af te midden van loononderzoek

Door crisis getroffen Nissan-topman treedt af te midden van loononderzoek Kubieke galliumnitride met faseovergang verdubbelt de efficiëntie van de ultraviolette emissie

Kubieke galliumnitride met faseovergang verdubbelt de efficiëntie van de ultraviolette emissie Een aardappel in water laten groeien voor een wetenschapsproject

Een aardappel in water laten groeien voor een wetenschapsproject California AG laat de uitdaging voor de fusie tussen T-Mobile en Sprint vallen

California AG laat de uitdaging voor de fusie tussen T-Mobile en Sprint vallen Regenwouddieren voor kinderen

Regenwouddieren voor kinderen Uw gegevens zijn verkocht aan websites als MyLife en WhitePages. Hier is hoe het te verwijderen

Uw gegevens zijn verkocht aan websites als MyLife en WhitePages. Hier is hoe het te verwijderen Nieuwe fase van het modelleren van de viskeuze koppelingseffecten van meerfasige vloeistofstroom

Nieuwe fase van het modelleren van de viskeuze koppelingseffecten van meerfasige vloeistofstroom

- Elektronica

- Biologie

- Zonsverduistering

- Wiskunde

- French | Italian | Spanish | Portuguese | Swedish | German | Dutch | Danish | Norway |

-

Wetenschap © https://nl.scienceaq.com